前有AI換臉,後有AI脱衣,技術濫用之下每個女生都可能被蕩婦_風聞

柠檬木聚糖-长岛大学生物学院助教-长岛大学生物学院助教/知名科学科普作者2019-06-29 16:04

當我們提起信息技術的時候,往往會聯想到一些比較高端的詞彙,比如人工智能、神經網絡、深度學習等等。在過去的幾十年間,信息技術飛速發展,越來越多的高科技被應用到我們生活的方方面面。

隨之而來的是我們對於高科技應用的愈發憂慮,除了擔心有一天不受控制的人工智能可能會對我們的生活產生負面影響,還會擔心過於氾濫的科技被有心人所利用。也許有人覺得這是杞人憂天,但實際上它已經在我們身邊悄然發生着。

在幾個月之前,網絡上某作者上傳的《射鵰英雄傳》選段着實火了一陣,倒不是因為經典或者懷舊。而是它應用了信息技術,將原本劇中朱茵扮演的黃蓉換成了楊冪的面容,技術精湛且毫無違和感。AI換臉的視頻上傳之後,引發了不小轟動。有支持者説這是技術的前進,有反對者説這侵犯了肖像權。

但無論怎麼看,它都標誌着一個時代的更迭,網絡信息的真實性受到了進一步的考驗。可以説隨着AI技術的蓬勃發展,很多瓜沒有以前吃得那麼放心了。

如果説,對於電視劇中人物進行換臉還略有一些爭議,那麼發生在另一些國家的事情,則給我們敲響了警鐘。早在幾年前,國外就有技術人士在網絡上傳一些超大尺度的視頻,很多女角都是耳熟能詳的知名女星,比如蓋爾·加朵、泰勒·斯威夫特、艾瑪·沃特森、斯嘉麗·約翰遜······

而這種所謂AI技術,我個人覺得除了滿足一些男性不切實際的幻想沒什麼用,也沒有任何值得稱道的地方。而且實際上它也並非什麼技術革新,相關的技術在很多年前已經成熟,甚至包括聲音和麪部表情的算法都在技術圈子裏廣為人知。但較長一段時間裏,很少有人把歪心思打到這種事情上,只能説如果人心壞了,掌握的知識越多對於社會的危害越大。

無獨有偶,前幾天在境外上線了一款叫做DeepNude的應用,開發者宣稱可以將用户上傳的穿着衣服女性的照片通過算法模擬出不穿衣服的效果。換句話説,就是AI脱衣,而且據稱只能處理女性照片。

出於驗證的目的,我將自己高中時代的一張照片上傳到了這個應用上,然後得到了一張娘化的檸檬······真是辣眼睛。不過也直接證明了,這款應用是針對性消費女性的產品,我覺得和上面的那個一樣,只是滿足了一些男性不切實際的幻想,沒有任何值得稱道的地方。

後來,我跟以前搞這個專業的同學討論了一下這個問題,這個應用本質上和之前華為拍月亮那個差不多。都是通過算法把需要模擬的部分補全,雖然算法補全的部分和實際情況並不完全一樣,但卻是算法合理的。在沒有原版的對照下,較難分辨真假(並非不能)。雖然説它不是真的可以完全通過算法模擬出該女性實際脱衣效果,但畢竟女生也不可能為了自證清白就給人真的脱一下看看。

這就陷入了一個困境,通過傳播這種AI脱衣圖片,對於被脱衣者顯然有負面影響。因為被AI模擬脱衣的女性沒有簡單的渠道可以證明這種圖片是假的,而且很多獲得這種圖片的人並不會告知當事女性,甚至可能私下傳播,進而引發一種事實上的蕩婦羞辱。而這,是我所不希望看到的。

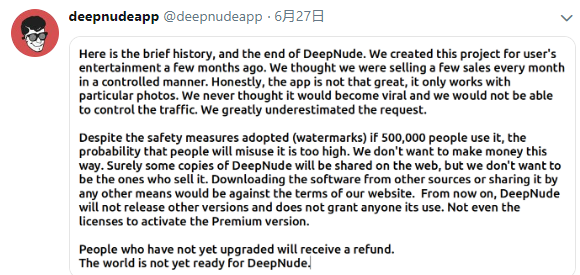

也許是眾多壞消息中的一絲絲安慰,這款AI脱衣應用在上線後不久就在網友們的聲討中黯然下架。這也是我敢於寫出它的原因,本來之前我還在考慮寫它會不會助紂為虐,還好它下架了。在下架之時,開發者在他的主頁寫下了這樣一句話,“the world is not yet ready for DeepNude”(意為:世界還沒準備好迎接DeepNude)。雖然可以從字裏行間看出開發者的惋惜之情,但我想説,謝謝世界沒準備好,謝謝每一個還沒準備好的人。

雖然AI脱衣的事情隨着應用的下架,也算是暫告一段落,但是未來呢。這種技術已經不可避免地落入了有心人的眼中,在我國乃至世界範圍已經實際聚集了不小的固定羣體。我想,咱們絕大部分人也不希望一覺醒來,發現擺着自己臉的各種大尺度照片、視頻滿天飛。那麼,推己及人,咱們又有什麼理由放任這種技術被濫用呢?

就像我標題裏説的,前有AI換臉,後有AI脱衣,技術濫用之下每個女生都可能被蕩婦。我固然希望技術進步,但也希望明天會更好,那麼對於這種被濫用的信息技術,我們是不是應該給它加上一層制約呢?不是限制技術發展,而是限制它們應用在錯誤的地方。