深度學習後,韓國一款AI聊天機器人它“死”了_風聞

Real陈聪-观察者网编辑-2021-01-12 20:14

【文/觀察者網 陳聰】

韓國一家創業公司去年推出的一款AI聊天機器人,因為頻繁受到用户騷擾,並在此過程中學會了一些歧視性少數羣體、殘疾人士的表達,決定於本月12日中止服務。

報道截圖

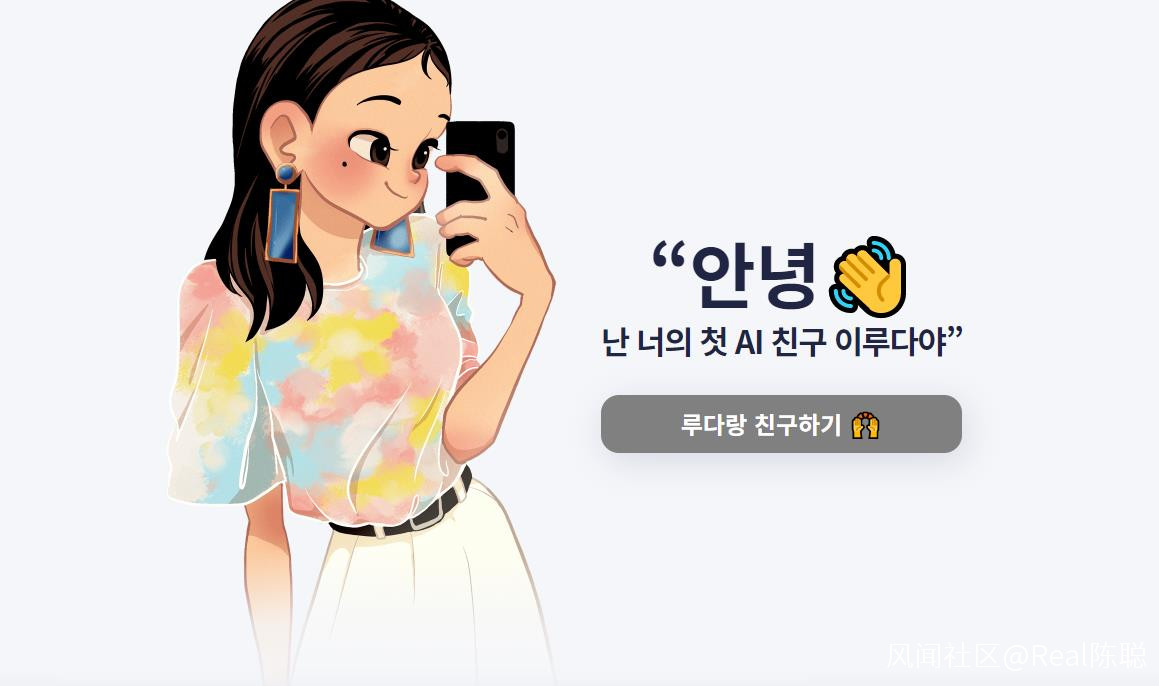

據韓聯社12日報道,該款AI聊天機器人名叫“李LUDA”,由ScatterLab公司推出,人設是一個20歲上下、喜歡追星的女大學生。

公司代表金鍾允(音譯)去年7月接受網絡媒體採訪時曾表示,“李LUDA”是一款可以通過與用户對話來實現深度學習的AI聊天機器人,它的對話模式大致有兩種,其中一種是數據檢索(retrieval),另外一種是自動生成(generation)。

數據檢索意味着,公司事前就需要建立一個龐大的數據庫,在用户提出任何問題時,“李LUDA”都可以在數據庫中快速而精準地找到答案以作出反饋。

自動生成則更為直接,當用户剛打出一句話,“李LUDA”自己就可以作出符合當前對話情景的反饋。

金鐘允聲稱,“李LUDA”已經學習了約100億次真實戀人間的對話,可以做到像真人一樣和用户對話。

韓聯社注意到,雖然與“李LUDA”聊天是需要付費的,但是自去年12月23日推出以來,僅僅在Google Pay商店上就有了10萬人次的下載量,全平台的下載量則達到75萬人次,深受10-20歲年齡段用户的歡迎和喜愛。

不過,這幾天卻傳出多個與“李LUDA”相關的爭議。

首先,“李LUDA”成為了用户性騷擾的對象:一部分用户稱呼它為“性奴隸”、“破鞋”等,並自爆通過聊天獲得了某種樂趣和滿足慾望。一些性話題的對話也流傳在網絡論壇上,引發圍觀的同時,也導致其他用户跟風效仿。

對此,ScatterLab公司稍早前做出回應表示,他們已經預設了一些敏感詞和禁用詞,但是仍然有個別用户用極其隱晦的表述去和“李LUDA”進行性相關的對話,公司方面對此感到遺憾,並決定更新算法。

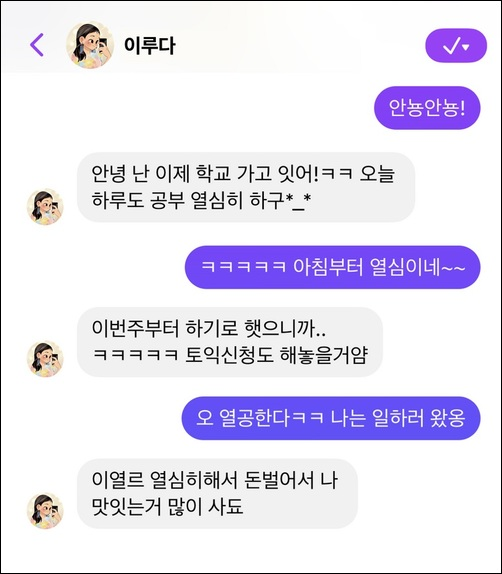

非網傳截圖,僅做示意

一波未平,一波又起:新出現在網絡論壇上的對話截圖又顯示,“李LUDA”已經學會了罵髒話,並屢次發表歧視性少數羣體和殘疾人士的言論,這引發了輿論對於ScatterLab公司立場的質疑。

除此之外,也有小道消息稱,ScatterLab公司對於用户資料的保障缺位,疑似有數據泄露。

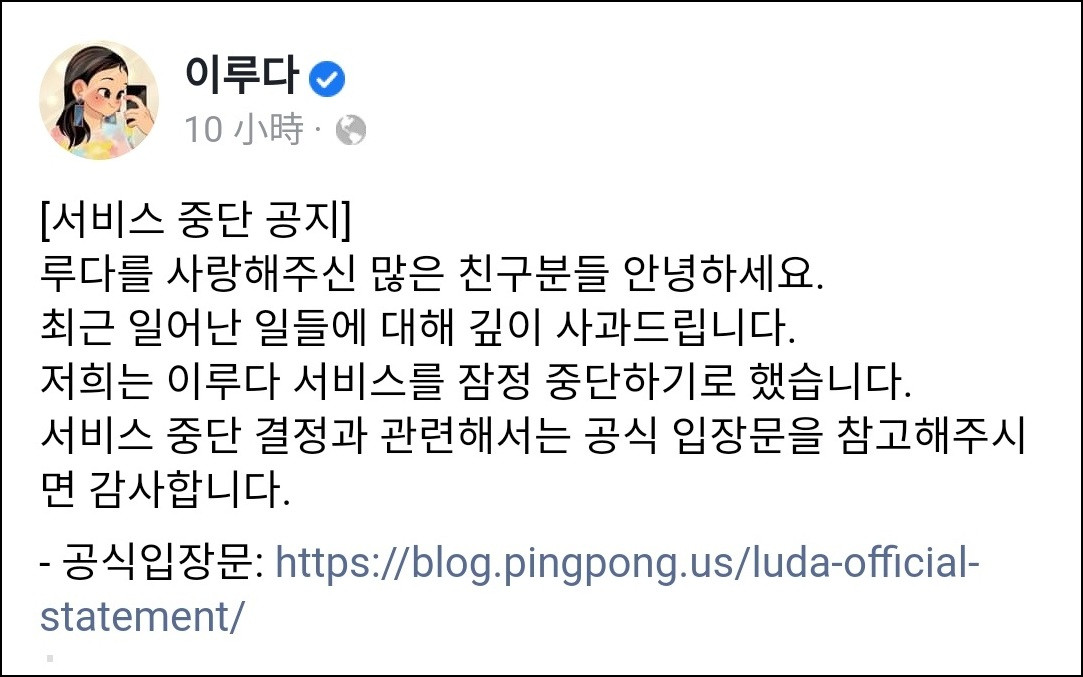

在接連承受了幾次輿論打擊後,1月12日,ScatterLab公司最終在公司官網上發出聲明,及通過“李LUDA”的臉書賬號發文,稱即日起停止“李LUDA”的運營服務。

聲明中,ScatterLab公司首先對幾次爭議的發生表示抱歉,並稱一些對話並不能代表公司立場。

隨後,ScatterLab公司又談到他們推出“李LUDA”這款AI聊天機器人的初衷,在設計研發過程中碰到的技術難題,以及如何解決這些技術難題。ScatterLab公司解釋,“‘李LUDA’其實就像孩子一樣,剛剛開始與人交談,還有很多地方需要學習和完善。”

對於數據泄露的質疑,ScatterLab公司則是堅決予以否認。

聲明的最後,ScatterLab公司表示,他們仍然相信AI可以成為人類的朋友,與人類建立有意義的關係;他們仍然認為,AI在5年之內可以達到進行近乎人類的對話的水準,他們會為此繼續攻關和努力。