你算個什麼鳥?AI十級“找茬”選手誕生_風聞

量子位-量子位官方账号-2021-07-31 14:41

楊淨 豐色 發自 凹非寺

量子位 報道 | 公眾號 QbitAI

你算個什麼鳥?

面對上面這兩張圖,一個AI發出了靈魂拷問。

左邊桃面牡丹鸚鵡,右邊費氏牡丹鸚鵡。

一眼識破的它早就看到左邊的鳥的喙部和眼圈與右邊的不一樣。

不行,再來!再來看這組。(文末揭曉答案)

好,我放棄了。

這個來自浙大計算機學院和阿里安全的“找茬”選手,識別準確率達到了91.3%,已經是業內最優水平。研究成果已被多媒體國際頂會ACM MM 2021收錄。

不光鳥,阿貓阿狗也能行,甚至花草植物也能行。

看看這連兩張照片,吉娃娃還是英國玩具梗?

再來看這一波,羊駝還是美洲駝?驢還是騾?玫瑰還是羽衣甘藍?

AI好眼力!那到底是如何練成的?

AI如何練就的一副好眼力?

實際上,這涉及到計算機視覺領域一個經典問題——細粒度圖像識別,讓AI一眼鎖定類別之間的細微差異。

看起來簡單,實際不簡,就比如下面左邊這倆。

對於AI來説,區域注意力的定位和放大是保證識別準確率一個重要因素,此前大量基於CNN的探索發現,CNN的感受野有限,且缺乏全局依賴關係的建模能力。

感受野:網絡內部的不同位置的神經元對原圖像的感受範圍

研究人員認為,與CNN相比,圖像序列化是一種全新的方式。

他們把目光轉向了最近在CV領域取得了非常多研究進展的視覺Transformer(ViT)。

一開始,研究人員引入了ViT中的自注意力機制,提取圖像中的長距離依賴關係。

不過ViT的感受野大小相對固定,對圖像中的每個patch的關注程度沒有產生區分,也就給細粒度圖像識別帶來了性能侷限。

既然如此,那該如何讓AI**找準“重點”**呢?

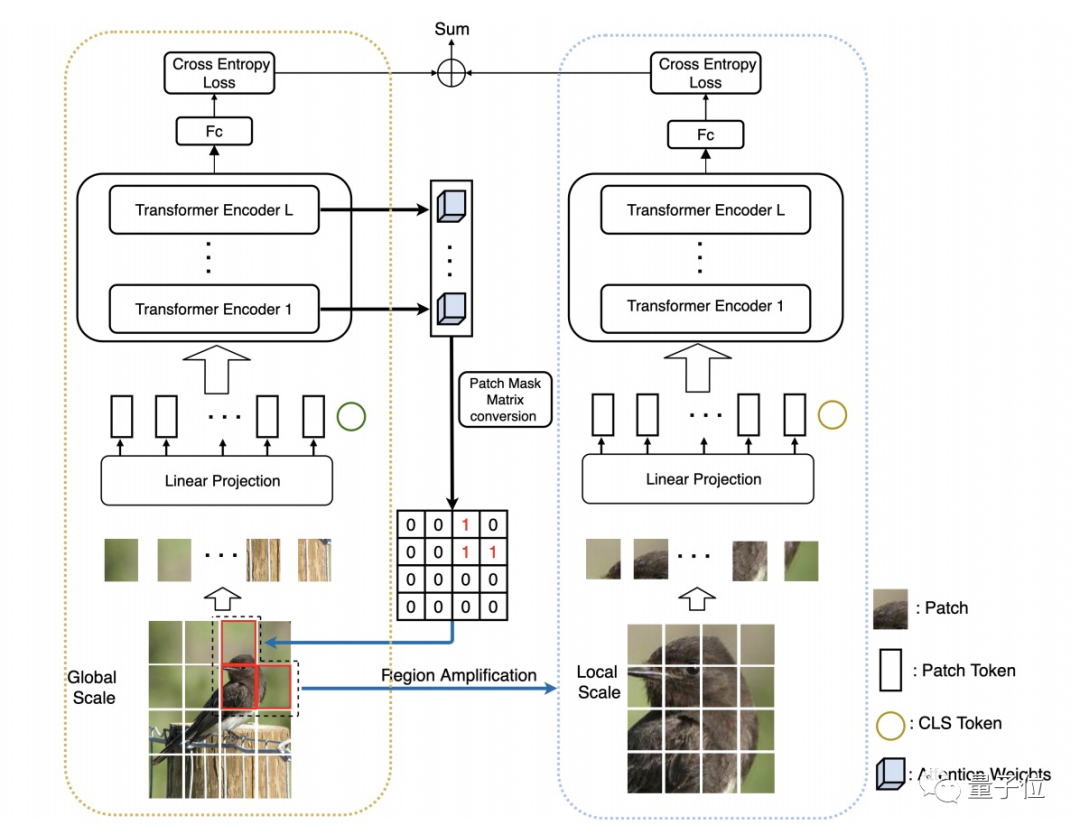

研究人員決定使用注意力權重的強度來衡量對應於原始圖像的patch重要性,提出了多尺度循環注意力的Transformer(RAMS-Trans)。

它利用Transformer的自注意力機制,以多尺度的方式循環地學習判別性區域注意力。

團隊成員之一,阿里安全圖靈實驗室算法專家炫謙介紹道:

我們方法的核心是動態patch建議模塊 (DPPM)引導區域放大,以完成多尺度圖像patch塊的集成。

DPPM從全局圖像開始,迭代放大區域注意力,以每個尺度上產生的注意力權重的強度為指標,從全局到局部生成新的patch塊。

具體來説,首先提取ViT每層的自注意力機制,並進行歸一化,然後採取累乘的方式對自注意力整合。

然後,得到了整合後的自注意力均值分佈矩陣,由於細粒度圖像識別任務的關鍵因素在於局部注意力,其往往存在於圖像的局部區域,如鳥的尾部、喙和蛙類的頭部等。

因此研究者需要通過設定閾值的方式來“過濾”不需要的部位,增強對局部判別性區域的識別能力。

最後,研究者通過插值算法將選定的patch塊放大到原圖像的尺寸,通過共享參數的模型,重新進行訓練,整體結構對應於文章所提的多尺度循環機制。

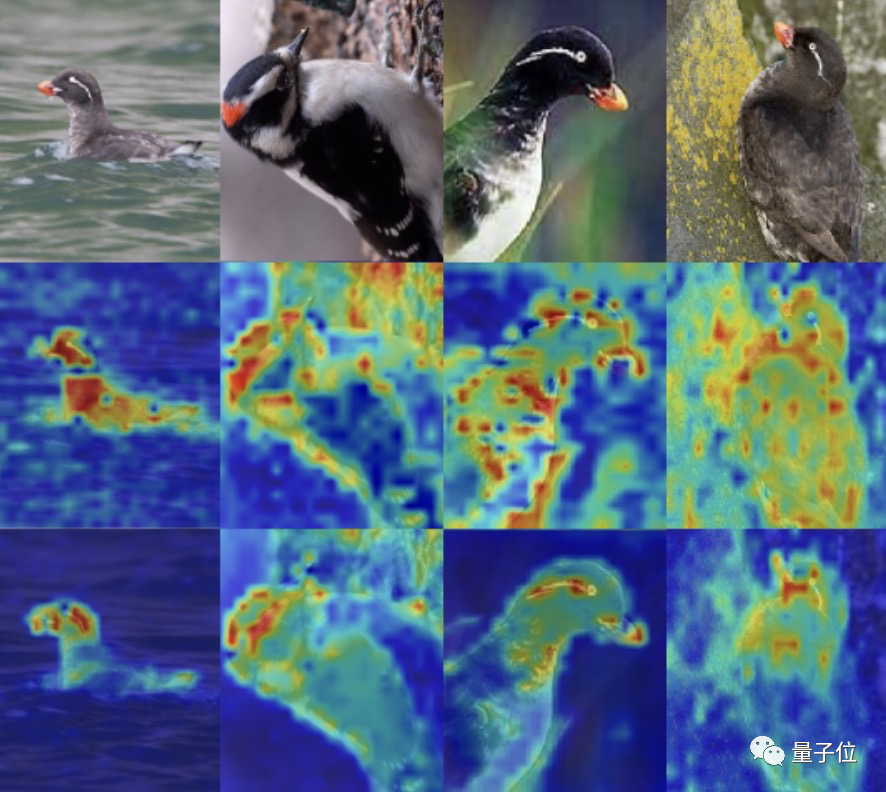

下圖為RAMS-Trans在識別鳥類時根據注意力權重生成的注意圖(attention map)。

****△第二、三行分別為從原始和重新訓練過的注意權重生成

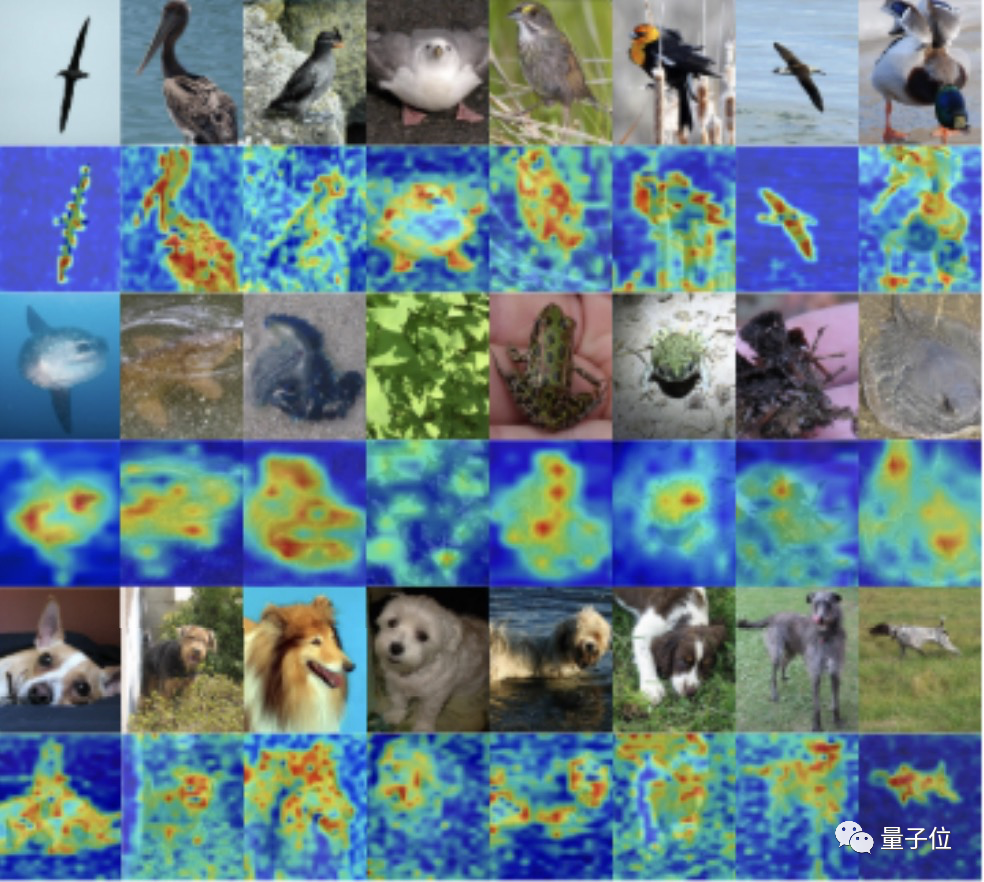

擴展到更多動物身上的效果:

戰績如何?

RAMS-Trans只需要ViT本身附帶的注意力權重,就可以很容易地進行端到端的訓練。

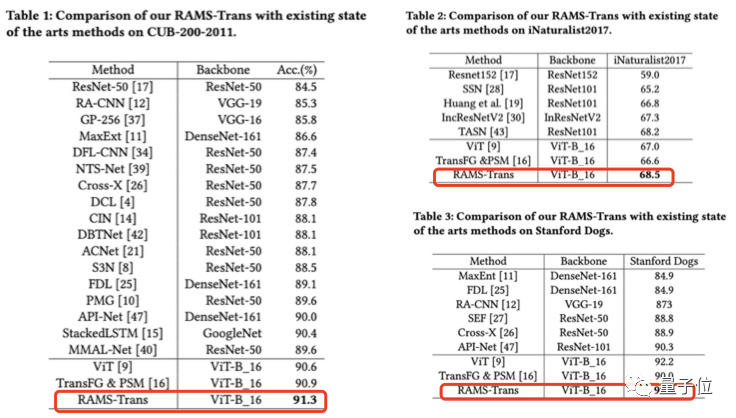

實驗表明,除了高效的CNN模型外,RAMS-Trans的表現比同期進行的工作更好,分別在CUB-200-2011(鳥類識別)、Stanford Dogs(狗類識別)、iNaturalist2017(動植物識別)獲得SOTA。

分別達到91.3%、68.5%、92.4%的識別準確率。

在不同種類動植物的細粒度判別時,RAMS-Trans可以聚焦到類別的獨特特徵區域。

****△第二、四、六行分別為放大到原圖像尺寸的的patch塊

針對不同類別識別準確率不同,甚至還有較大的區別,一作浙大博士胡云青解釋道,主要有兩方面的因素。

一是因為Stanford Dogs本身的類別數比其他兩個數據集都要小。只有120分類(CUB是200,而iNaturaList更是達到了5089)。

類別數越多,通常意味着該數據集的細粒度問題越嚴重,因此RAMS-Trans在更細粒度的數據集上取得的提升相對明顯。

二則因為在某個類別上大部分樣本具有相似的特徵,而不同種類間的狗也具有明顯的判別性特徵。

比如大部分博美都有相似的毛色和頭型;德牧和金毛之間,人眼就可以做到明顯區分。

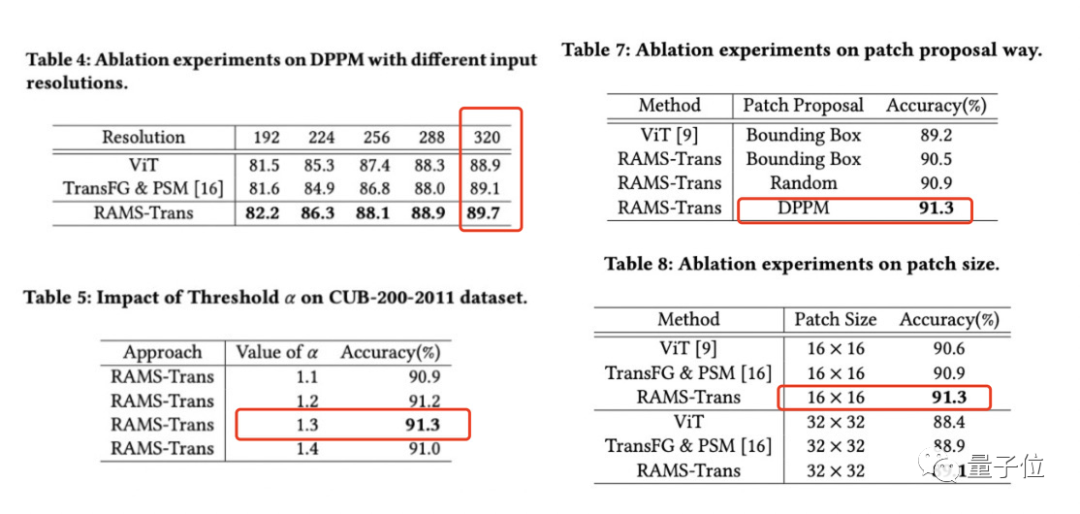

通過消融實驗發現,當分辨率為320、閾值為1.3、patch方案為DPPM、patch塊大小為16x16時,模型效果最好。

接下來,團隊還將在兩個方面進行優化:

提高定位能力。

目前,RAMS-Trans在原圖上以patch為最小單位進行判別性區域定位和放大的過程,對於細粒度圖像識別來説,這個較為“精細”的任務來説還是相當粗曠。

動態網絡的引入,包括動態訓練和動態推理等。

另外,已經有了可預見的應用場景,比如野生動物保護治理、山寨商標的識別。

浙大&阿里安全

這項研究主要由浙江大學計算機學院、阿里安全圖靈實驗室共同完成。

其中第一作者胡云青,目前浙江大學計算機學院DMAC實驗室博士在讀,師從張寅教授。此外還是阿里安全圖靈實驗室實習生。

論文鏈接:

https://arxiv.org/abs/2107.08192