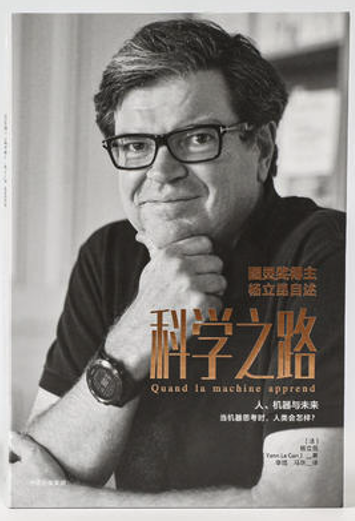

圖靈獎得主楊立昆:我如何走上人工智能之路丨展卷_風聞

返朴-返朴官方账号-关注返朴(ID:fanpu2019),阅读更多!2021-09-05 14:51

撰文丨楊立昆(Yann Le Cun)

翻譯丨李皓、馬躍

信息的自由流動就是進步的動力。

——楊立昆

遭遇寒冬

1969 年,西摩爾·帕普特(Seymour Papert)和馬文·明斯基(後者在 20 世紀 50 年代曾熱衷於人工神經網絡的研究,後來放棄了)聯合出版《感知器:計算幾何學概論》一書[1]。他們在書中指出了學習機的侷限性,其中有些侷限性對於技術發展會造成嚴重阻礙。因此對他們來説,神經網絡的研究之旅已經走入了死衚衕。這兩位都是麻省理工學院極負盛名的權威教授,他們的作品在領域內引起了轟動:資助機構紛紛退出,不再支持該領域的研究工作。與 GOFAI(good old-fashioned artificial intelligence,好的老式人工智能。基於邏輯、規則和搜索算法的傳統人工智能方法。)一樣,神經網絡的研究也遭遇了它的第一個“冬天”。

大多數科學家不再談論製造具有學習能力的智能機器之事,轉而把目光轉向了更容易落地的項目。比如,運用一些原本用來研究神經網絡的方法創建了“自適應濾波”,這是許多現代通信技術的起源。在此之前,當我們通過電話線在兩台計算機之間交換數據時,電話線可能會發生以下情形:我們輸入一個二進制信號,電壓從0伏升到48伏,而信號在距離目的地還剩幾公里時就已經損壞了。但現在,自適應濾波器能將其復原,這個過程是通過以其發明者鮑勃·拉迪(Bob Lucky)的名字命名的 Lucky 算法實現的。20 世紀 80 年代後期, 鮑勃·拉迪曾在貝爾實驗室擔任部門經理,領導着約300人工作,我也是其中一員。

如果沒有自適應濾波,就不會出現帶揚聲器的電話。揚聲器可以讓我們對着麥克風講話,而它不需要同時記錄對話者説的話(有時我們能聽到自己在説話)。回聲消除器使用的算法與感知器使用的算法非常相似。

狂熱的瘋子

在 20 世紀七八十年代的“寒冬”裏,仍有一些人執着於神經網絡研究,科學界把他們視為狂熱的瘋子。比如,芬蘭人戴沃·科霍寧(Teuvo Kohonen),他研究的是一個與神經網絡比較接近的課題—聯想記憶。再比如,還有一羣日本人,與西方不同,日本的工程科學生態系統比較孤立,其中包括數學家甘利俊一(Shun-Ichi Amari)和一位名為福島邦彥(Kunihiko Fukushima)的業內人士,後者發佈了一個被他稱為“認知機”(Congitron)的機器,這一命名來自術語“感知器”(preceptron)。福島邦彥前後一共發佈了這個機器的兩個版本,分別是 20 世紀 70 年代的認知機和 80 年代的神經認知機(Neocognitron)。與同時代的弗蘭克·羅森布拉特一樣,福島邦彥也受到了神經科學新發現的啓發,特別是美國人大衞·休伯爾(David H. Hubel)和瑞典人託斯坦·威澤爾(Torsten N. Wiesel)的發現給予了他很多靈感。

休伯爾和威澤爾是兩位神經生物學家,他們因在貓的視覺系統方面的研究成果獲得了1981 年的諾貝爾生理學或醫學獎。他們發現視覺是視覺信號通過幾層神經元傳遞後呈現的結果,包括從視網膜到初級視覺皮層,再到視覺皮層的其他區域,最後到顳下皮層。在這些層級中,神經元發揮着非常特殊的作用。在初級視覺皮層中,每個神經元僅連接到視野的一小部分區域,即接收區域。這些神經元被稱為簡單細胞。在下一層,即視覺皮層中,其他單元集成了上一層激活的信息,使得視覺對象即使在視野中稍微移動,視覺系統也能保持圖像的呈現。這些單元被稱為複雜細胞。

福島邦彥便是受到這個研究成果的啓發,延伸出了一個想法:先利用一層簡單細胞檢測各個小接收區域所接收的圖像的簡潔信息,再利用下一層複雜細胞處理收集到的信息。他研發的神經認知機共有5層:簡單細胞、複雜細胞、簡單細胞、複雜細胞,最後是類似感知器的分類層。福島在前四層使用了某種“不受監督”的學習算法,也就是説,它們接受的是不考慮完成任務的、“盲目”的訓練。僅有最後一層像感知器一樣,接受了“受監督”的訓練。但從總體來看,福島邦彥缺乏一種可以調整所有層級參數的算法,所以他的網絡只能識別諸如數字一類極其簡單的事物。

在 20 世紀 80 年代初期,福島邦彥並非獨自一人在此領域進行探索,北美的一些團隊也在進行着積極的探索,例如心理學家傑伊·麥克萊蘭德(Jay McClelland)和戴夫·魯梅爾哈特(David Rumelhart),還有生物物理學家約翰·霍普菲爾德(John Hopfield)和特倫斯·謝諾夫斯基(Terry Sejnowski),以及計算機科學家傑弗裏·辛頓(Geoffrey Hinton)。辛頓與我共享了2018年度圖靈獎。

被興趣激發的人

從20世紀70年代起,我開始對這些研究產生了濃厚的興趣,我的好奇也許來自對父親的觀察。他是一名航空工程師,同時也是一位動手天才,他總是喜歡在業餘時間做電子產品。他製作過遙控飛機的簡化模型。記得那是在 1968 年 5 月大罷工期間(譯者注:這裏的大罷工指“五月風暴”,是 1968 年 5 月法國爆發的一場學生罷課、工人罷工的羣眾運動。),父親在家裏製作了他人生中第一個遙控汽車和一艘船的遙控器。我並不是家裏唯一被激發興趣的人,我弟弟也是。他比我小6歲,同樣受到父親的影響,後來也成為計算機科學家。他大學畢業後成為谷歌的研究員。

在很早的時候,我就對技術、征服太空以及計算機的誕生充滿了探索的熱情。我曾夢想成為一名古生物學家,因為人類智能的出現及演化深深地吸引了我。即使在今天,我也依舊認為大腦的運行機制是生命世界中最神秘的事物。我8歲的時候,在巴黎跟我的父母、一位叔叔和一位沉迷於科幻的阿姨一起看過一部電影——《2001太空漫遊》。影片裏出現了我所熱愛的一切:太空旅行、人類的未來以及超級計算機哈爾的起義。哈爾為了確保自己的生存和完成最後的任務而要展開屠殺,這件事情真的很不可思議,而在這之前,如何將人工智能複製到機器中這個問題就已經讓我深深着迷了。

鑑於此,高中畢業後我自然而然地打算投身這個領域進行具體研究。1978年,我進入了巴黎高等電子與電工技術工程師學院,就讀該學院無須參加預科課程,可以在高中畢業後直接申請。我的實踐經歷證明,讀預科並不是在科學之路上取得成功的唯一途徑。而且,我在巴黎高等電子與電工技術工程師學院學習時擁有很多自主權,所以我肯定會好好珍惜利用!

卓有成效的閲讀

在第一批讓我感到欣喜的讀物中,有一份是我在1980年讀過的報告。這實際上是一份辯論總結,辯論是在瑟裏西(Cerisy)會議上展開的,主題是人類語言機制到底是先天的還是後天的。[2]語言學家諾姆·喬姆斯基的觀點是,大腦中生來就已經存在能夠讓人們學習説話的結構。而發展心理學家讓·皮亞傑(Jean Piaget)則認為,一切都是通過後天學習獲得的,包括大腦中學習説話的結構,語言學習是隨着智能的逐步建構而分階段完成的。因此,智力的獲得是人與外界交流學習的結果。這個想法深深地吸引了我,我開始思考如何才能將其應用於機器學習中。也有其他一些頂尖的科學家參加了這場辯論,比如西摩爾·帕普特,他極力頌揚了感知器,認為它是能夠學習複雜任務的簡單機器。

我因此知道了感知器的存在,並迅速沉迷於這個課題。我利用每週三下午不上課的時間,在羅康庫爾的 Inria(法國國家信息與自動化研究所)的圖書館尋找專業圖書來讀。在法蘭西島大區,Inria掌握着最為豐厚的計算機研究經費。我在閲讀過程中很快發現,西方科學界尚無人研究神經網絡。同時我還驚奇地發現,有關感知器的研究就截止在西摩爾·帕普特所稱頌的感知器上,此外沒有進一步的發展。

系統理論(在20世紀50年代被稱為控制論)是我的另一個研究愛好,它主要研究人工系統和天然生物系統。比如人類體温的調節系統:人體温度之所以能夠維持在37℃左右,主要得益於一種恆温器,它可以調節人體温度與外界温度之間的差異。

我對“自組織”也有濃厚的興趣。分子或相對簡單的物體是如何本能地相互作用組成複雜結構的?智能是如何從大量相互作用的簡單元素(神經元)中發展而來的?

我研究了柯爾莫哥洛夫、所羅門諾夫和柴廷(Chaitin)的算法複雜性理論中的數學部分。此外,我在前文中提到的理查德·杜達和彼得·哈特的書[3]就擺放在我的牀頭,同時我還訂閲了《生物控制論》,這是一本涉及大腦運作原理和生命系統的計算機數學模型的期刊。

因此,所有因為“寒冬”而被忽視的人工智能問題都呈現在我面前。在思考這些問題時,我慢慢形成了自己的理念:以邏輯的方式無法建構真正的智能機器,我們必須賦予機器學習的能力,讓它們能以經驗為基礎進行自我建構。

在閲讀期間,我發現科學界不只我有這種想法,因此我也注意到了福島邦彥的研究成果,並開始思考提高新認知中心神經網絡效率的方法。對正式開展研究來説比較幸運的是,巴黎高等電子與電工技術工程師學院為學生提供了當時功能非常強大的計算機。我與學校裏的朋友菲利普·梅曲(Philippe Metsu)一起開始編寫程序。他同樣熱愛人工智能,尤其對兒童的學習心理感興趣。學校裏的數學老師也願意指導我們,我們一起嘗試模擬神經網絡。但實驗十分費力:計算機進步緩慢,編寫程序也着實令人頭疼。

在學校的第四年,我由於更加沉迷於這項研究,開始設想一種用於訓練多層神經網絡的學習規則,可惜並沒有真正得到數學層面的驗證。我構想出一種可以在網絡中實現從後向前傳遞信號的算法,用來實現端到端的訓練,我將它命名為 HLM 算法(取自分層學習機的英文名稱 hierarchical learning machine,參見第五章相關內容)。命名這個算法的時候,我還玩了一個有趣的文字遊戲(譯者注:在法語中,HLM是低租金住房[habitation à loyer modéré]的縮寫。)……在 HLM 的基礎上發展而來的“梯度反向傳播”算法如今已被廣泛應用於訓練深度學習系統。HLM 與如今的反向傳播梯度網絡的不同之處在於,HLM 傳遞的是每個神經元的期望狀態。因此在當時計算機運算乘法的速度比較慢的情況下,可以使用二進制神經元。HLM 算法是訓練多層網絡的第一步。

我的偶像

1983年夏,我從工程專業畢業時,從一本書上瞭解到一個對自組織系統和自動機網絡感興趣的小組:網絡動力學實驗室(LDR)。他們的辦公地點位於巴黎聖納維耶沃綜合理工學院的舊址,小組成員都是法國人,他們來自各大高校。因為該小組不掛靠任何機構,所以幾乎沒有經費和預算,只有一台回收的計算機。從另一個角度説,法國在機器學習方面的研究當時正處於近乎停滯的狀態。我拜訪了他們。和我不一樣,這些研究人員沒有接觸過有關神經網絡的早期出版物,但他們熟悉其他作品。

我向他們表示,我對他們的研究課題感興趣,而且我所在學院的設備有助於他們做進一步的研究。後來,我在皮埃爾和瑪麗·居里大學繼續研究生學習時,也加入了他們的小組。1984 年,我準備攻讀博士學位。雖然當時我有巴黎高等電子與電工技術工程師學院的研究獎學金,但還沒有找到合適的論文指導老師。弗朗索瓦絲·福熱爾曼-蘇利耶(Françoise Fogelman-Soulié,後來更名為 Soulié-Fogelman)與我共事了很長時間,她當時是巴黎第五大學的計算機科學副教授。從能力上來講,她完全可以指導我,可惜,她還沒有完成國家博士論文

(此資格是歐洲教育體系的特色),所以她沒有取得指導博士論文的資格。

因此,我只能求助於實驗室中唯一一位能夠指導計算機博士論文的教授莫里斯·米爾格朗(Maurice Mil-gram),他是貢比涅技術大學計算機和工程科學的教授。他同意成為我的導師,但同時表示他對神經網絡一無所知,所以可能幫不上什麼忙。我永遠都不會忘記他對我的關照。那段時間,我將所有精力都用在了巴黎高等電子與電工技術工程師學院(和它強大的計算機)和 LDR(和它的知識環境)中。

我身處一個完全未知的領域,這實在令人興奮。在國外,也有一些課題跟我們接近的研究小組正在慢慢起步。1984 年夏,我陪同弗朗索瓦絲·福熱爾曼去了加利福尼亞,在帶有傳奇色彩的施樂帕克研究中心的實驗室實習了一個月。

當時,我十分渴望見到兩位大人物:一位是來自巴爾的摩約翰斯·霍普金斯大學的生物物理學家和神經生物學家特倫斯·謝諾夫斯基(《深度學習》作者),另一位是來自卡內基·梅隆大學的傑弗裏·辛頓,後者與約書亞·本吉奧和我共同分享了2018 年度的圖靈獎。

辛頓和謝諾夫斯基於 1983 年發表了一篇有關玻爾茲曼機(Boltzmann Machines)的文章,並在其中描述了一個帶有“隱藏單元”的神經網絡的學習過程,這個隱藏單元是位於輸入和輸出之間的中間層的神經元。我之所以對這篇文章感興趣,主要是因為他們提到了多層神經網絡的訓練,這可是我研究課題中的核心問題,他們是真正對我的研究有價值的人!

“你認識一個叫楊立昆的人嗎?”

我職業生涯真正意義上的轉折點出現在 1985 年2月,在阿爾卑斯山萊蘇什舉行的研討會上。在那次會議上,我遇到了當時世界上對神經網絡感興趣的頂級專家,他們有物理學家、工程師、數學家、神經生物學家、心理學家,尤其是遇到了在科學界宛如神話一般的貝爾實驗室裏一個新成立的研究神經網絡的小組成員。得益於在萊蘇什的相識,三年後,我被該小組聘用。

這次研討會是由我所在的法國研究小組 LDR 的成員組織的,他們是弗朗索瓦絲和她當時的丈夫熱拉爾·韋斯布赫(Gérard Weisbuch),後者時任巴黎高等師範學院的物理學教授,以及當時在法國國家科學研究中心(CNRS)任職的理論神經生物學家埃利·比嫩斯托克(Élie Bienenstock)。會議匯聚了許多對“自旋玻璃”感興趣的物理學家,以及物理學和神經科學等領域的權威人士。約翰·霍普菲爾德那篇關於自旋玻璃和神經網絡的開創性文章[4],引得許多物理學家開始關注並學習人工神經網絡,但當時仍有許多工程師和計算機科學家不願談及這個話題。

在萊蘇什,我是年齡最小的與會者之一,我當時剛開始着手寫博士論文。令我無比緊張的是,我需要在眾多享譽業界的大咖面前,用英語做一個關於多層網絡和 HLM 算法(反向傳播的前部研究)的英文報告。

尤其有兩位聽眾給了我巨大的壓力:一位是貝爾實驗室的部門負責人拉里·傑克爾(Larry Jackel),後來我很榮幸地加入了他的部門;另一位是該部門的二號人物約翰·登克爾(John Denker),他是一位來自亞利桑那州的真正牛仔,身穿牛仔褲和牛仔靴,有着垂到臉頰的頭髮……這位剛剛完成博士論文的“非典型研究人員”擁有令人難以置信的強大氣場!當某位研究者發言之後,他能夠很快就議題展開討論,表明自己的觀點。他談話時雖沒有攻擊性,卻擲地有聲,有理有據。當然他的自信也是有緣由的,弗朗索瓦絲·福熱爾曼曾説:“貝爾實驗室的研究人員有着巨大的優越感。當你要研究某個課題時就會發現,要麼貝爾實驗室早在 10 年前就已經研究過了,要麼已經證明這條路行不通了。”簡直太可怕了!

我做完了關於多層網絡和HLM算法的報告,與會者中真正聽懂的人寥寥無幾(這已經讓我夠緊張了!),然後,約翰·登克爾舉起了手,我簡直緊張到窒息!但他在所有聽眾面前對我説:“講得真的很好!謝謝您,讓我知道了很多事情……”我確信我的名字已經留在他和拉里·傑克爾的腦海中。一年後,他們邀請我去他們的實驗室做報告。兩年之後,我接受了貝爾實驗室的面試。三年後,我正式加入了他們的團隊!

同樣是在萊蘇什,我碰到了特倫斯·謝諾夫斯基,也就是與傑弗裏·辛頓共同發表關於玻爾茲曼機的文章的作者。他是在我完成報告後到場的。我在下午的茶點時間找到了他,向他闡述了我在多層神經網絡方面的工作。在交流之前,我並不確定他是否會感興趣。他只是耐心地聽着,並沒有告訴我他與傑弗裏·辛頓也在進行反向傳播研究,也沒有告訴我,辛頓已經成功實現反向傳播,只不過沒有對外公佈而已。

偉大的發明之間能夠相互啓發。辛頓的研究就使用到了加利福尼亞大學聖迭戈分校的戴夫·魯梅爾哈特的思路,辛頓在之前的幾年裏曾跟隨戴夫讀博士後。1982 年,戴夫提出這個方法並編寫了程序, 只可惜沒能成功運行。他找到辛頓,辛頓説:“失敗的原因出在了局部一些極為細微的問題上。”(參見第四章“多個谷底的困擾”)後來,戴夫放棄了。但是,在研究玻爾茲曼機的過程中,辛頓意識到問題並沒有自己當初想象的那麼嚴重。因此,他用 LISP 語言在 Symbolics 公司的 LISP 機器上用戴夫的方法重新編寫了程序,這一次程序成功運行起來。

因此,在我們交流的過程中,特倫斯很快注意到我的 HLM 方法和反向傳播非常相似。他沒有告訴我,在反向傳播成功後,他已經在研究此後幾個月將會風行一時的實際應用了。特倫斯回到美國後向辛頓提到了我:“法國有個孩子在進行跟我們同樣的研究!”

同年春天, 我寫了第一篇關於自己研究成果的文章(我承認,這篇文章離科學文獻的標準有點遠),並在 1985 年 6 月舉辦的Cognitiva 大會上將其公開,那是法國第一次召開集合了人工智能、神經網絡、認知科學和神經科學的綜合性大會。傑弗裏·辛頓是當時的主講嘉賓,他在開幕辭上介紹了玻爾茲曼機。結束後,將近 50 個人聚集在他的周圍,我也想上前交流,但並沒有機會靠近他。隨後,我注意到他轉向其中一位會議組織者丹尼爾·安德勒(Daniel Andler),並問道:“你認識一個叫楊立昆的人嗎?”丹尼爾開始四處觀望,我立馬大喊道:“我在這兒。”其實,辛頓已經在會議論文集上看到了我的文章,雖然他不精通法語,但依然看懂了文章的內容,他意識到我就是特倫斯提過的那個“孩子”。

我們在第二天碰了面,並一起在一家古斯古斯(來自北非馬格里布地區的美食)餐廳吃了午飯。他向我解釋了反向傳播的原理,他知道我能聽懂!辛頓説自己正在寫一篇文章,其中引用了我的研究成果,我聽後非常自豪。我倆很快意識到,我們的興趣、方法以及思路都十分相似。辛頓邀請我參加 1986 年在卡內基·梅隆大學舉辦的關於聯結主義模型的暑期培訓班,我欣然接受。當時在認知科學界,研究者通常用“聯結主義模型”這個術語來稱呼神經網絡這個未知領域。

梯度反向傳播的運用

20 世紀 80 年代,梯度反向傳播的普及使得訓練多層神經網絡成為可能。該網絡由成千上萬分層的神經元組成,其間的連接更是數不勝數。每層神經元都會合並、處理和轉換前一層的信息,並將結果傳遞到下一層,直到在最後一層產生響應為止。這種層次體系結構賦予了多層網絡能夠存儲驚人的潛能,我們會在接下來的深度學習部分進行進一步的討論。不過,在1985年,多層網絡的學習過程仍然很難實現。

這一切在1986 年發生了轉變。特倫斯·謝諾夫斯基發表了一篇探討NetTalk 多層網絡的技術報告,NetTalk通過反向傳播訓練使機器學習閲讀。該系統將英文文本轉換成一組語音音素(基本語音)後傳到語音合成器,從而實現“閲讀”的功能。將文本語音轉換成法語很簡單,轉換成英語卻十分困難。在訓練的初期,這個系統如同一個剛開始學習説話的嬰兒,隨着訓練的不斷積累,它的發音也越來越好。特倫斯·謝諾夫斯基到巴黎高等師範學院現場做了相關報告,震驚了現場聽眾和業界。隨即,所有人都希望向我取經,因為多層網絡突然變得十分流行,我也變成了這個領域的專家。

在這之前的一年,我發現可以用拉格朗日形式從數學的角度反向傳播,這類形式化是傳統機械、量子機械和“最優控制”理論的基礎。我還注意到在 20 世紀 60 年代,有一位最優控制的理論家提出了一個類似反向傳播的方法,這個方法被命名為“凱利-布賴森(Kelly-Bryson)算法”,也被稱為“伴隨狀態法”。在1969年出版的由亞瑟·布賴森(Arthur Bryson)和何毓琦(Yu-Chi Ho)合著的《應用最優控制》(Applied Optimal Control)一書中對其進行了詳細講述。

這些科學家從沒想過將這個方法應用到機器學習或者神經網絡領域,他們更感興趣的是系統的規劃和控制。比如,如何控制火箭,使其到達一個精準的軌道並且和另外一個航空器對接,且同時要儘可能減少能源消耗。而從數學的角度來説,這個問題和調整多層神經網絡節點的權重問題非常相似,這樣最後一層的輸出結果就會符合預期。

1986 年7月,應辛頓之邀,我在匹茲堡的卡內基·梅隆大學參加了為期兩週的關於聯結主義模型的暑期課程(如下圖)。這次美國之行我其實是有顧慮的,因為當時我的妻子正在孕中,我們的第一個孩子將在我回法國4周後降生。

照片中標出的是斯坦尼斯拉斯·德阿納(SD)、邁克爾·喬丹(MJ)、傑伊·麥克萊蘭德(JMcC)、傑弗裏·辛頓(GH)、特倫斯·謝諾夫斯基(TS)和我(YLC)。除此之外,照片上的許多參與者日後都成了機器學習、人工智能和認知科學領域的重要人物:安迪·巴爾託、戴夫·圖爾茨基、格里·泰紹羅、喬丹·波拉克、吉姆·亨德勒、邁克爾·莫澤爾、理查德·德賓等組織者。

我對那個夏天最深的記憶就是我與辛頓,還有剛完成博士論文的邁克爾·喬丹(Michael Jordan)建立了一個研究神經網絡的團隊, 我們三個人之間也因此結下了深厚的友誼。為什麼邀請邁克爾呢?因為他的法語比我的英語好。在暑期培訓班的野餐會上,他彈着吉他演唱了喬治·布拉桑(Georges Brassens)的歌。

雖然我還只是個學生,但辛頓還是邀請我做了一場報告,並介紹説我發現了反向傳播。在一次晚餐時,我們享用着我帶來的一瓶很棒的波爾多紅酒,辛頓跟我説,他將在一年後離開卡內基·梅隆大學, 加入多倫多大學。他問:“你願意成為我的客座研究員嗎?”我回答:“當然了!”這一年時間正好夠我完成博士論文。

大變革的時代到來了。魯梅爾哈特、辛頓、威廉聯合發表的關於反向傳播的論文在業界引發了爆炸式的反響。[5]NetTalk 成功的消息也迅速傳播開來。神經網絡領域的研究走上了快車道。我製作的名為HLM 的神經網絡模擬和反向訓練軟件也吸引了法國工業界的一些買家,Thomson-CSF(現在名為 Thales,即法國泰雷茲集團)就是我的顧客之一。

1987 年6 月,我完成了博士論文,並在皮埃爾和瑪麗·居里大學通過了答辯。因為我在 4 月嘗試一種新的沙灘帆船推進方式時傷到了腳踝,所以我藉助枴杖才完成了答辯。傑弗裏·辛頓是我的答辯委員之一,此外答辯委員會還有莫里斯·米爾格朗、弗朗索瓦絲·福熱爾曼,雅克·皮特拉(Jacques Pitrat,法國人工智能符號領域的科研領袖之一)和貝爾納·安吉尼奧(Bernard Angéniol,Thomson-CSF 的一個研究團隊負責人)。同年7月,我和我的妻子,還有我們一歲的寶寶一起來到多倫多,我成為辛頓的客座研究員。我們預計在多倫多的生活不會超過一年,我的妻子為了照顧孩子,不得不擱置了她的藥劑師工作。我還指導着一個名叫萊昂·博圖(Léon Bottou)的朋友。我與萊昂結識於 1987 年初,當時他正在巴黎綜合理工學院完成最後一年的學業。他對神經網絡很感興趣,因此決定跟隨我做畢業實習。請千萬不要告訴他們的校長我還沒有取得博士學位。當時,我正計劃編寫新的軟件來創建並訓練神經網絡,它是由LISP解釋器驅動的模擬器。

我把解釋器的相關工作交給了萊昂,他僅用三週時間就完成了!此外,因為我們都擁有同款個人計算機——Commodore 公司的Amiga(一款高分辨率、快速的圖形響應、可執行多媒體任務的計算機),所以我倆的合作既愉快又高效。與現在的蘋果計算機和其他品牌的個人計算機不同,Amiga 計算機具有類似北美 IT(信息技術) 部門中常見的 UNIX 工作站的屬性:我們使用 C 語言編程, 使用GCC 編譯器和 Emacs 文本編輯器。我那台 Amiga 計算機安裝了專供信息工作者使用的文本處理程序 LaTex,我就是利用它完成了博士論文。萊昂和我通過連接 MiniTel(數字化電話信息的交互式媒體)遠程交換程序代碼段。

我們將程序命名為SN(simulator neuronal,神經模擬器),它也是我倆長久合作與友誼的見證。萊昂後來在紐約FAIR的辦公室離我的辦公室並不遠。

在多倫多,我完成了 SN,之後對其做了調整,以便實現我設想的一個可以用於圖像識別的神經網絡——卷積網絡。卷積網絡是受福島邦彥的神經認知機啓發而產生的一個想法,但它使用的是更為傳統的神經元,並且受到反向傳播的驅動。同時,傑弗裏·辛頓開發了一種更簡單的用於語音識別的卷積網絡,他將其稱為 TDNN(時延神經網絡)。

1987 年年底,我應邀前往麥吉爾大學的蒙特利爾計算機科學研究中心做報告。報告結束時,一位年輕的碩士研究生提出了一系列問題,從提問中可以看出他在多層神經網絡方面有比較深入的研究。要知道在同時期,該領域的研究人員相當少。他想了解如何調整神經網絡結構,並使其能夠處理語音或文本等時間信號。我記住了他的名字:約書亞·本吉奧。

參考資料

[1] Marvin L. Minsky, Seymour A. Papert, Perceptrons : An Introduction to Computional Geometry, The MIT Press, 1969 .

[2] Théories du langage, théories de l’apprentissage : le débat entre Jean Piaget et Noam Chomsky, débat recueilli par Maximo Piatelli-Palmarini, Centre Royaumont pour une science de l’homme, Seuil,《Points》, 1979 .

[3] Richard O. Duda, Peter E. Hart, Pattern Classification and Scene Analysis, op. cit., p. 6.

[4] John J. Hopfield, Neural networks and physical systems with emergent collective computational abilities, Proceedings of the National Academy of Sciences, 1982 , 79 ( 8 ), pp. 2554 – 2558 , DOI : 10 . 1073 /pnas. 79 . 8 . 2554.

[5] D. E. Rumelhart, G. E. Hinton, R. J. Williams, Learning internal representations by error propagation, in D. E. Rumelhart, J. L. McClelland, PDP Researche Group, Parallel Distributed Processing : Explorations in the Microstructure of Cognition, MIT Press, 1986 , vol. 1 , pp. 318-362.

作者簡介

楊立昆(Yann Le Cun):法國人,名字原文為Yann Le Cun,姓氏為Le Cun,因在美國常被誤縮寫為Y.L.Cun,於是把LeCun合寫在一起。中文譯名原為揚·勒丘恩,華人AI圈一直親切地稱他為“楊樂康”,他本人聽聞後,乾脆自己給自己取了中文名字——楊立昆。

他被譽為 “卷積神經網絡之父”,2019年3月,因在人工智能深度學習方面的貢獻獲得2018年度圖靈獎。此外,他還獲得了2014年IEEE神經網絡先鋒獎(Neural Network Pioneer Award)、2015 年 IEEE PAMI 傑出研究獎和2016 年 Lovie 終身成就獎。

他為卷積神經網絡(CNN,Convolutional Neural Networks)和圖像識別領域做出了重要貢獻,以手寫字體識別、圖像壓縮和人工智能硬件等主題發表過190多份論文,研發了很多關於深度學習的項目,並且擁有14項相關的美國專利。研究領域包括人工智能、機器學習、機器感知、移動機器人學和計算神經學。