睡前消息488期文稿:重慶山火之後,有圖≠真相_風聞

马前卒-马前卒工作室官方账号-万丈高楼平地起,NB社区在这里2022-09-25 08:30

大家好,2022年9月23日星期五,歡迎收看第488期睡前消息,請靜靜介紹話題。

今年八月,重慶曾經有一次大面積森林火災,當地一部分羣眾參與了救災行動。

這次人民自救行動是全國知名的新聞事件,但是在信息傳播過程中,最著名的新聞圖片並不都是現場攝影。

8月23日,重慶一名獨立攝影師小影使用軟件,人工合成了一張摩托車騎手“穿越火線”的圖片,相信不少觀眾都看到過。作者發佈這張圖片時説明了圖片是後期製作的,但在後續的傳播中,作者的説明被有意無意忽略了,而轉發或者直接使用的各家媒體也沒有求證圖片的原始出處,默認當做現場圖片。

除了人工合成之外,還有AI軟件生成的圖片也被媒體和普通用户大量轉發。8月25日晚上,微博用户@石茜的江湖,發佈了一系列壯觀的消防員與山火圖片,並未説明來源。隨後圖片被許多自媒體當做現場畫面,用來證明消防人員和當地羣眾冒險救火的艱難,還有不少官方機構轉發。

督工,你怎麼看待虛擬圖片對新聞報道的影響?

https://weibo.com/1864280172/M2Ib8e6vH?r

https://weibo.com/3806438281/M2NJU3s2o?

我們先回顧一下圖片的傳播鏈條。

媒體後來採訪到了“穿越火線”圖片的原作者小影。她是重慶的一名獨立攝影師。她聲明自己製作圖片的目的是給“前線”的車友打氣。小影的另一個身份是摩托車商業媒體的編輯,她説製作圖片的另一個目的,是紀念摩托車在救援中的作用。

8月23日晚上八點半,她在微信朋友圈發佈了圖片,明確説明圖片是自己ps的。

但圖片離開她的朋友圈之後,就立刻被自媒體轉發,成為重慶山火的標誌性信息。不到2個小時,原作者小影意識到傳播出現了偏差,再次發朋友圈,宣佈圖片不是現場圖,還公佈了原始素材,火災背景來自前幾年的雲南山火。

同時,她在抖音上發表了闢謠聲明,但是無法阻止錯誤信息持續傳播,被大量自媒體選做封面。

後來作者小影接受採訪,對當前媒體生態表示無奈,靜靜幫我讀一下她的解釋:

“因為越來越多的平台不經求證在轉發,也當作現場照片在進行描述。很多自媒體、博主都在轉發,但他們沒有對圖片進行求證與解釋,事態發展越來越嚴重。作為始發者、媒體工作者,有一定的責任消除這些誤會,所以我進行了澄清與致歉。”

https://export.shobserver.com/baijiahao/html/521671.html

這種力度的闢謠之後,還是反覆有人推薦虛假圖片參選“2022年度最佳攝影作品”。

另一組AI合成山火照片也製造了類似的問題,先是自媒體傳播失控,到了8月26日下午,央視新聞選用其中一張AI作品做了一張宣傳海報。海報的右上角謹慎地標註了“非新聞圖片”,但下方有類似於實景照片的説明“面前是漫天山火,身後是萬家燈火”。

https://weibo.com/2656274875/M2P0PsB5A?

另外幾條並列的微博宣傳畫,央視新聞都使用了真實的新聞照片,並且標註了攝影師。

https://weibo.com/2656274875/M2VirB6jk?

https://weibo.com/2656274875/M2QjqeWWD?

無論是有意還是無意,客觀上越來越多的媒體沒有區分真實圖片和AI生成圖片,往往是把兩種圖片混合使用,而且往往把非真實圖片放在前面,作為封面圖。

https://weibo.com/1564834725/M2Z6L0kjV?

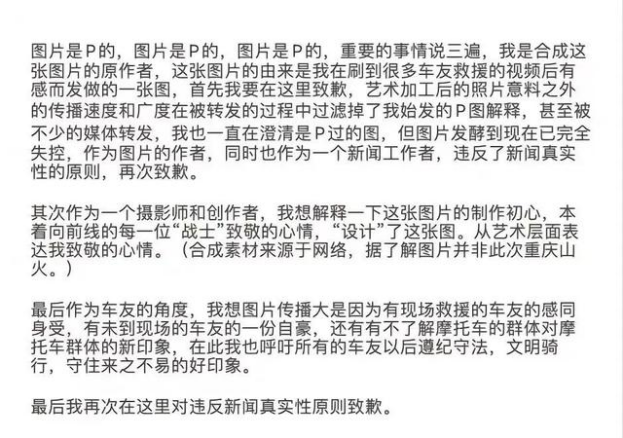

這種媒體傳播現象引發了爭議。反對者認為Ps圖片上頭條是“消解重慶人民的努力,消費全國人民的情緒,把災難當景觀。”

https://weibo.com/1957491335/M2NZXhuVG?

https://weibo.com/1957491335/M2QvIwxNd?

支持者則表示,不在乎圖片是不是PS的,只要有正能量就行。有的媒體闢謠,指出“穿越火線”圖片是p圖,大部分熱評表示無所謂,甚至説“女人哪張照片不P圖”,公開否認客觀事實的存在。

https://weibo.com/2028810631/M2M6W2pY9?

https://weibo.com/1784473157/M2Nmjoo7K?refer_flag=1001030103_

AI作畫事件中,也有很多人支持作者。有的不承認這是AI生成的圖片,指責闢謠者別有用心。更多的人聲稱AI生成圖片也沒什麼,反正現場的確有摩托車手參加救災。還有人説,觀眾能分辨AI圖片,闢謠是多此一舉,打擊羣眾熱情。

https://weibo.com/1837234894/M2W9izk6X?type=comment#_rnd1664026350977

但是,從最近幾年技術發展來看,還是不要對人類的直覺判斷力太樂觀。如果不追溯圖片來源,AI的畫以假亂真只是時間問題。

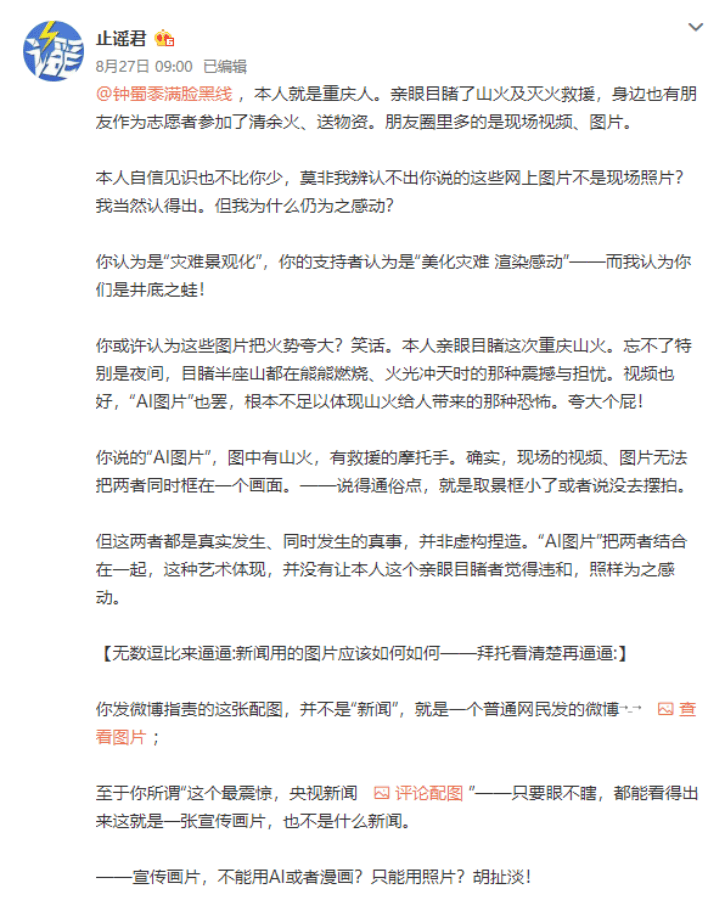

早在2018年,AI創作的肖像畫就通過了藝術創作的“圖靈測試”,能混在人類作品中通過鑑定。當時,法國藝術團隊創作的《愛德蒙·貝拉米(Edmond de Belamy)》在紐約佳士得拍賣行成功出售,價格43.25萬美元。

外媒報道,作品是一個叫“生成性對抗網絡”(Generative Adversarial Network,GAN)的AI模型創造的。程序員讓AI學習了14-20世紀的1.5萬幅人像畫,之後的作品無法辨別是否是人類作品。

https://smart.huanqiu.com/article/9CaKrnKe5UK

https://baijiahao.baidu.com/s?id=1609950106791569165

經過幾年訓練之後,AI學習的深度越來越大,掌握的圖片信息越來越多,已經逐步從模仿繪畫升級到模仿照片了,這次重慶山火事件就是一個例子。

當然對於有準備的人來説,AI模擬的現場照片還是有漏洞的,這次重慶山火事件,就有很多人宣稱摩托車的輪廓、光影的細節有問題,不至於被AI照片騙過去。

https://weibo.com/1957491335/M2S1vy201?

但是,更多的人沒有成功辨別AI照片。澎湃新聞曾經做了一個網頁,把十張山火的真假照片混在一起,讓網友投票。從結果來看,每張照片幾乎都有一半的人搞錯。馬前卒工作室的同事也沒有能全部答對的。

https://www.thepaper.cn/newsDetail_forward_19694732

所以,這次AI圖片傳播事件預示了一種未來,就是普通人可以用幾秒鐘生成其他人難以辨別真假的照片,同時很多人根本不在乎照片的真假,媒體傳播的真相越來越模糊了。

也許有人覺得這不是什麼大事,還方便了正能量自媒體制作宣傳畫,但技術從來不會只服務於一個立場。第480期睡前消息,我分享過自己這幾年的一個經驗,這裏我再給大家分享一下:

如果想排除先入為主的干擾,理解事實本身,最好的辦法是保留事實,改變當事人,做重新評價。比如説,如果是國際問題,可以把事件中的國家換一下,或者乾脆把中國換成外國;如果是國內問題,可以把事件中各方面的地域、階層和職務交換一下。交換之後,如果自己的觀點發生了改變,我就要重新考慮自己對事實和邏輯的理解。如果觀點不變,我對事實的敍述可能就比較客觀了。

具體到重慶山火事件,AI作為一個工具,能生產正能量的虛擬場景,就能用同樣的成本製造負能量的圖片。設想一下,如果有人用AI創作了和主流立場相反的圖片,也被當成實景照片產生了類似的刷屏效果,被闢謠之後恐怕不會這麼容易過關,肯定有人要求追究轉播者甚至是創作者的責任。想清楚這個問題,就能理解AI圖片技術對媒體生態的衝擊,乃至對全社會的衝擊。

現在人類還能設想用眼睛鑑別AI圖片和真實照片的區別,什麼時候會喪失分辨能力呢?

不意外的話,幾年內人類的肉眼判斷力就要輸給AI軟件,因為AI繪圖能力每一天都在進步。國內遊戲媒體對比過,時隔兩個月,用魚做關鍵詞,同一個AI軟件生成的圖片,畫風已經從“恐怖”進化到“怪異”,不難想象接下來的發展潛力。

圖片來源:北邦

現在的情況是,雖然人類還在用生理能力不斷對抗AI的技巧,但是往往是上一張圖片嘲笑AI的弱點,到下一張圖片就發現問題已經被AI自主學習解決了。

8月26日,微博ID @木遙總結了ai的缺點,認為主要弱點是無法做到“內容統一性”,他原話説:

“比如你覺得 AI 某一張人像畫的很好,你無法對它説:再畫一張同一個人,穿同樣的衣服,但讓頭轉過來一點。AI 畫畫是一張張彼此無關的,你很難讓它畫成套的作品,比如一個有故事性的有複雜人物關係的連環畫。”

https://weibo.com/1644684112/M2MbSbflz

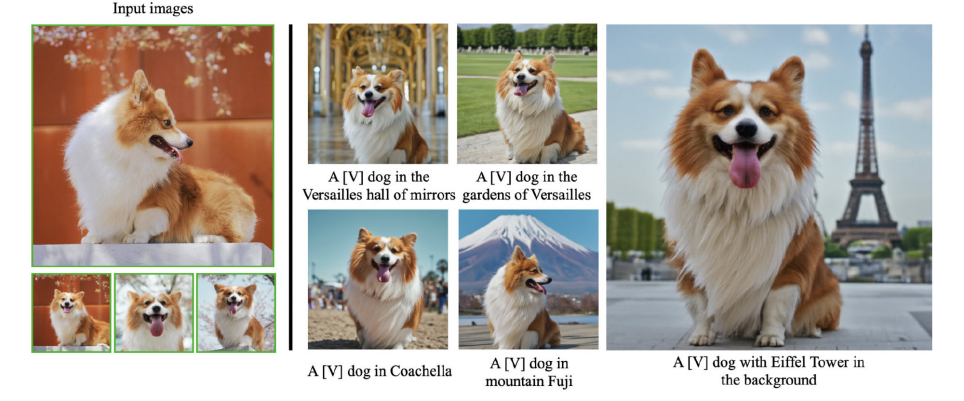

第二天,他就發現Google新發布了一篇論文,解決了AI生成系列圖片的問題。輸入左邊這些圖,AI可以在不同的文字指令下輸出右邊的圖片,給同一條虛擬的狗製造了連續劇情。

https://weibo.com/1644684112/M2VmvCa63?pagetype=profilefeed

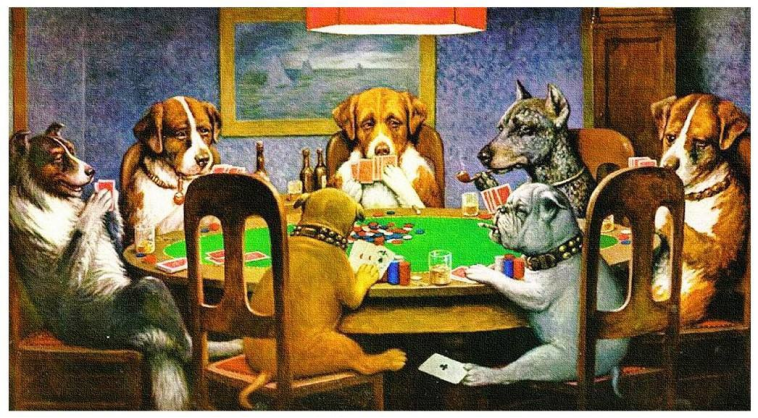

八月底,AI繪畫工具DALL-E發佈了新圖像補全工具,可以在現有圖片基礎上不斷延展,製造無限大,而且意義上有關聯的畫面。比如説給AI看名畫《戴珍珠耳環的少女》,就可以提示AI製作同時代的背景,和主要人物完全融合。

看了柯立芝名畫《玩撲克的狗》之後,AI給這羣狗設計了完整的俱樂部場景,甚至還擬人化地構造了人物關係。

換到《蒙娜麗莎》,或許是達芬奇在當代文化中關聯了太多科幻和玄幻元素,AI生成的背景就有點詭異。但如果多製造幾張圖片,再由人類挑選出最自然的一張發表,後代的人類未必能一眼分辨原作和AI圖片。

蒙娜麗莎的微笑

對比圖:https://www.ithome.com/0/639/191.htm

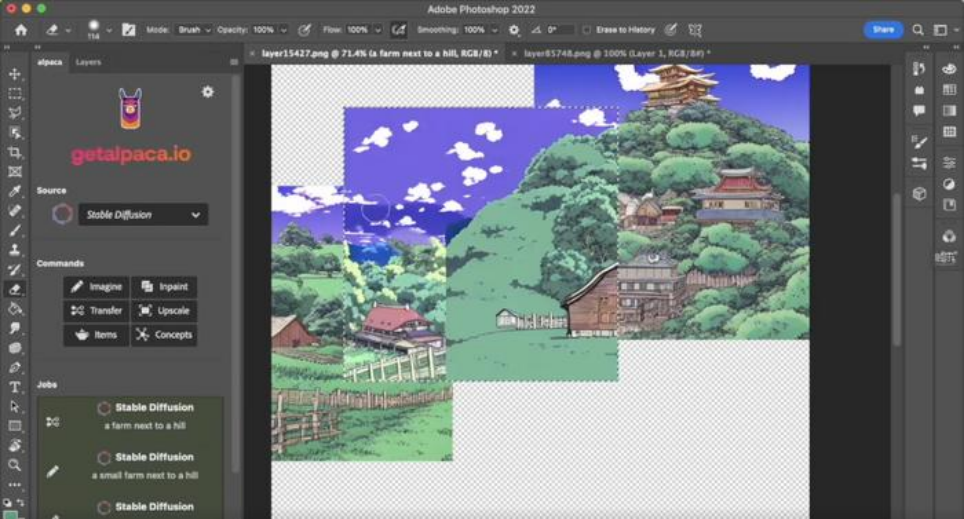

作為媒體行業的邊緣成員,馬前卒工作室也試用了AI畫圖軟件,看看以後是不是能減少一點配圖工作。

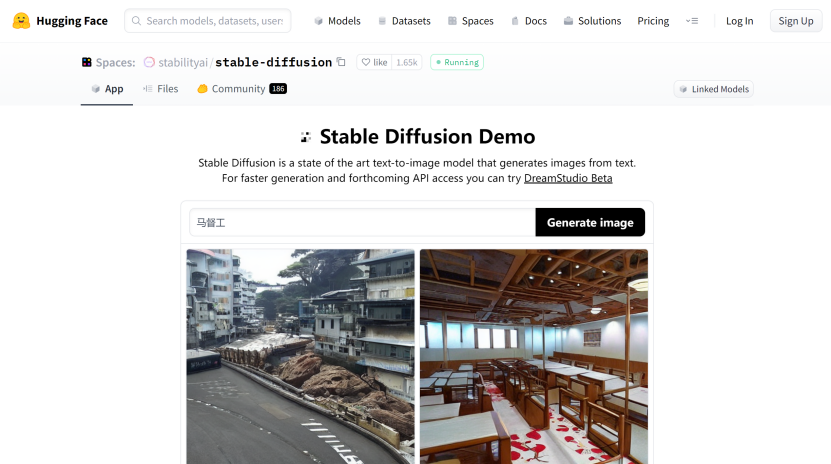

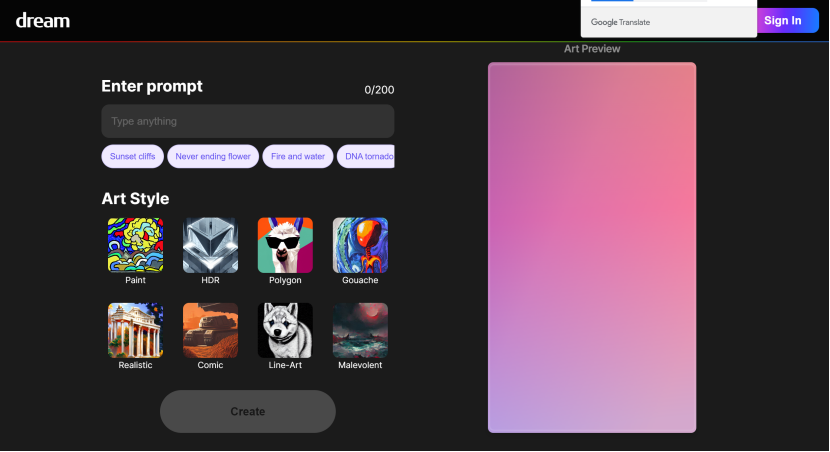

這裏給大家簡單推薦幾個AI製圖網站,請靜靜介紹一下:

首先是HuggingFace,生成圖片均為照片風格。優點是免費,且支持中文線索詞。缺點是生成圖片慢,而且用非英文關鍵詞生成的圖片質量差。

鏈接:https://huggingface.co/spaces/stabilityai/stable-diffusion

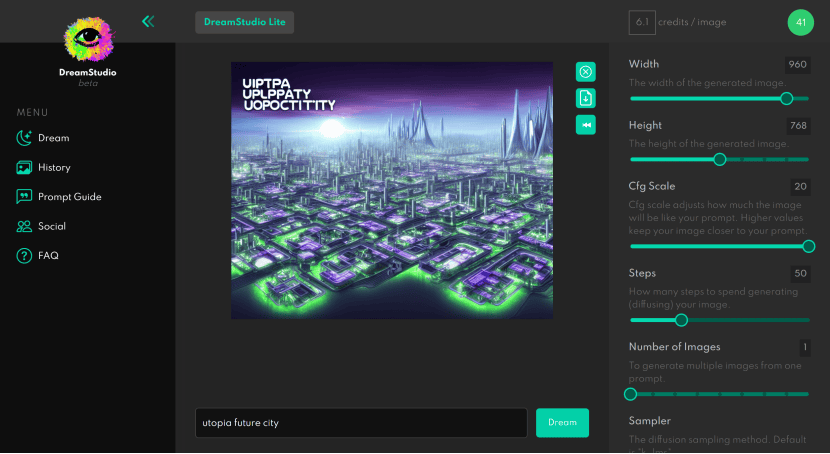

其次是DreamStudio。優點是可調節圖片尺寸,可以調節畫面與關鍵詞的匹配度,還可以選擇將已生成圖片作為模板,因此圖片質量較高。缺點就是要付費,就算會員每天也只能生成幾十張圖片。

鏈接:https://beta.dreamstudio.ai/dream

我們用Beauty做關鍵詞,生成了兩張圖片:

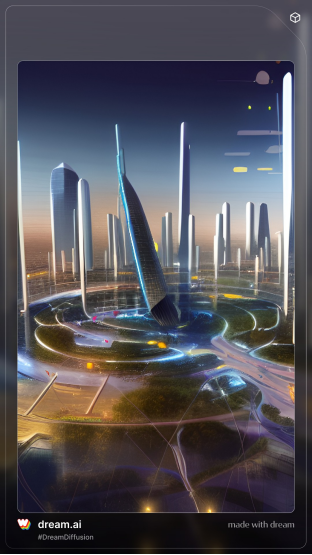

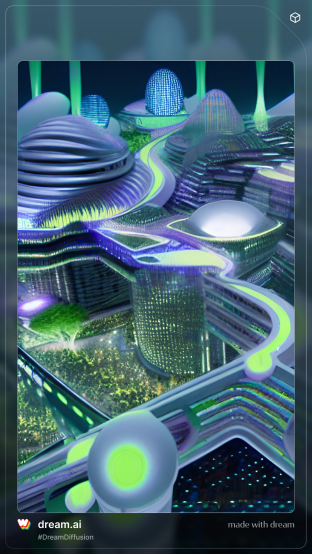

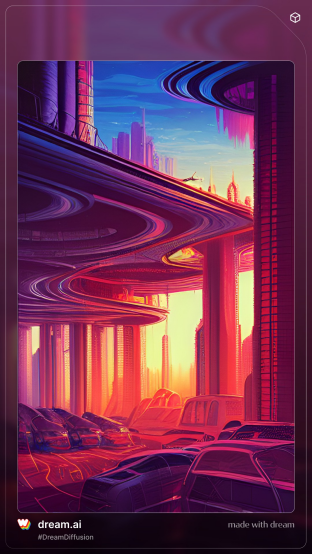

關鍵詞換成未來都市(future City)生成了幾張圖片,作為半成品效果不錯:

接下來推薦Wombo,優點是免費,可以上傳圖片作為模板,可以選擇多種繪畫風格。缺點是圖片尺寸僅適配手機屏幕。

鏈接:https://app.wombo.art/

在Wombo上,以烏托邦和未來都市(utopia future city)為關鍵詞,得到的畫面更有想象力,有的可以直接作為電影背景

利用這些AI支持,穆好古同學重新設計了睡前消息LOGO:

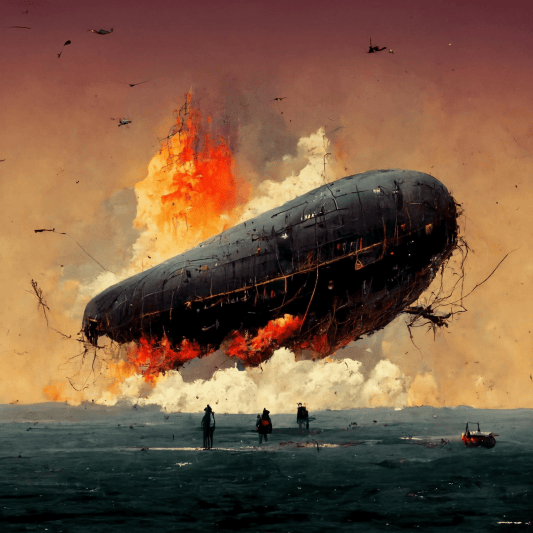

穆好古同學還指導AI創作了三叉戟飛艇,場面震懾人心:

工作室成員還有一個前IT工程師孫宏宇同學,他把AI圖片當成一個技術產品,做了簡單的分析。根據他的觀點,AI程序現在還只是偶爾有驚豔的作品,一旦多生成幾張,就會暴露構圖方面的明顯套路。而且AI在描繪人類肢體細節的時候總是出錯,似乎説明AI並不真正理解三維結構和透視概念。

中國人很早就對美術規律有總結:“畫鬼容易畫人難”,現在的AI繪圖也處於類似階段。前面舉的幾個例子説明,AI比較擅長怪誕、幻想類超現實題材,因為大家對這些內容沒有標準的預期。關鍵詞越獵奇,越出乎意料,給人帶來的驚喜越多。但是,迴歸到現實話題,尤其是比較複雜的現實話題,AI繪圖就幾乎沒什麼用處。比如説,我們節目經常會提到的“社會化撫養”,大多數AI配圖就只能體現一個“人多”的粗糙概念。

總的來説,根據工作室的實踐,目前的AI畫圖程序可以在兩方面輔助插圖工作。

首先,AI能夠在超出人類記憶的海量圖庫中建立大量隨機關聯,為人類畫師提供啓發,發現被固有思維方式忽略的細節。

其次,AI能夠快速生成不同風格的完整畫面,人工挑選之後,調整部分細節,就能滿足一般需求,節約重複勞動。

前面孫宏宇説AI並不“理解”空間結構和畫面的關係,但從阿法狗下圍棋打敗所有人類的例子看,是否能在哲學上“理解”畫面也沒那麼重要,只要能源源不斷提供美術半成品,AI工具就有利用價值。我們以後也可能會在節目中使用AI生成圖片,但如果圖片產生了接近照片的效果,一定會提前説明。各位觀眾可以為我們的規範行為提前點個贊,投個幣。

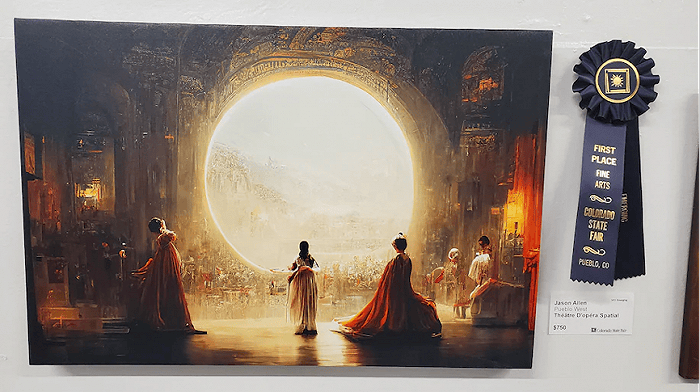

不是每個人都支持技術進步。最近在美國科羅拉多州博覽會舉行藝術比賽,數字藝術/數碼攝影單元的一等獎頒給了《太空歌劇院》,真實的作者是AI繪圖工具Midjourney。

人類藝術比賽讓AI獲獎,引發了爭議。但是作者不打算道歉,主辦方也表示之前沒有禁止AI參賽,所以照常頒獎。

https://coloradostatefair.com/competitions/general-entry-fine-arts/fine-arts-exhibition/

https://www.jiemian.com/article/8032972.html

https://www.thepaper.cn/newsDetail_forward_19710342

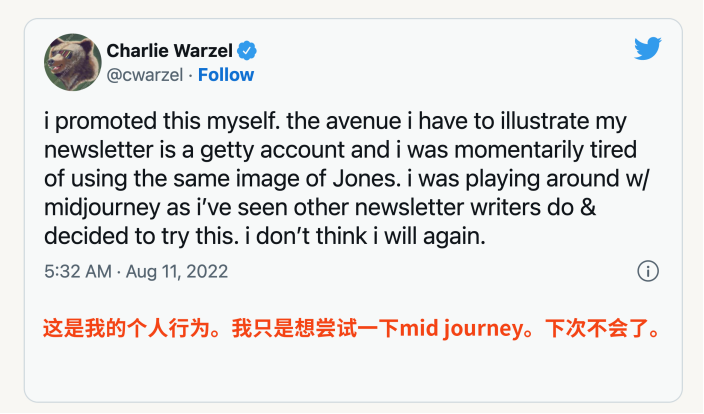

甚至不是每個媒體都能輕鬆使用新技術。8月9日,美國《大西洋月刊》發表了一篇文章。作者沒有在版權圖庫選圖,也用了Midjourney工具生成了一幅亞歷克斯·瓊斯(Alex Jones)的畫像。

https://newsletters.theatlantic.com/galaxy-brain/62f28a6bbcbd490021af2db4/where-does-alex-jones-go-from-here/

文章發表後,插畫師和攝影師羣體表示反對,認為《大西洋月刊》這樣的全國性媒體帶頭使用AI圖片,會導致其他同行效仿,未來會影響美術行業的收入。一週後,作者發表道歉聲明,承認使用AI圖片有道德隱患。

https://newsletters.theatlantic.com/galaxy-brain/62fc502abcbd490021afea1e/twitter-viral-outrage-ai-art/

督工,你怎麼看待這些關於AI的爭議?

任何一種新工具出現,都必然有依附於傳統工具的熟練工人抗議,這些插畫師、攝影師的反對意見,就像當年馬車伕對蒸汽機的抗議一樣,可以注意,但不一定要在意。倒是版權問題值得討論一下。

AI軟件幾乎不能憑空創造美術風格,都要學習大量的現有作品,學習的越多,作品質量就越高,風格就越豐富。所以很多畫師認為,AI軟件實際上盜用了人類畫師的創意,侵犯了版權。最近,日本畫師就在抗議AI “mimic”,因為這個AI只需要學習30張插畫,就能模擬繪畫風格生成新作品,而且圖片都會帶有mimic的水印。日本眾多畫師集體抵制mimic,不允許自己的作品成為AI的訓練素材。

但是,如果認為AI學習了繪畫風格就等於侵犯版權,現有的人類畫師也應該向自己臨摹的作品交版税。我雖然沒什麼美術技能,但也知道每個畫師的風格都不是憑空出現的,入門的時候會學習經典作品,經歷從模仿到原創的過程。一個人類畫師模仿了別人的風格,只要畫筆握在自己手裏,就可以在作品上留自己的名字。現在他們抗議AI作品加水印,看起來還是一種帶着恐懼心態的“無能憤怒”。

有的人類實在找不到對抗AI的方法,決定利用過去最看不起的資本力量對抗新技術,他們建議所有反對者都給mimicAI提供大量的迪士尼或任天堂角色圖片,然後讓西半球和東半球最強的版權法務部去追究帶水印的AI作品。如果説這也算反抗,我看AI一定會壓倒性勝利。

就在一部分人類畫師抗議的同時,已經有遊戲團隊開始日常使用AI工具了。因為AI創作速度快,可以不知疲倦地提供各種創意,適合在開發初期的概念階段找靈感。如果只是為了一個場景,策劃讓美工做幾百張概念圖,恐怕會有生命危險,但是讓AI生成幾百張作品就很輕鬆了。一旦找到了合適的概念,就可以挑選一個,讓人類畫師深入設計。

還有一些簡單的平面圖案設計,如説普通角色的徽章、旗幟、圖標,甚至是相貌,如果和遊戲的世界觀、情節沒有緊密聯繫,只是為了體現不同角色之間的區別,就可以交給AI批量生產。人類和AI之間的效率差了上千倍。

http://www.chuapp.com/article/288865.html

https://www.youtube.com/watch?v=dD9vpO2zaJw

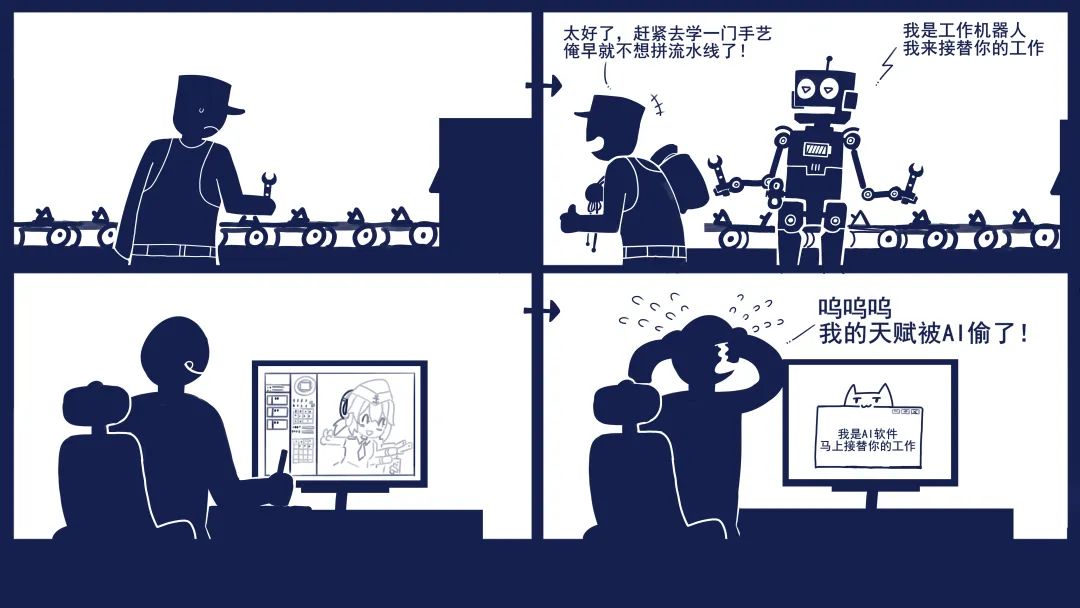

從這些現實應用來看,AI繪畫的確可能淘汰一些美術行業的職位,就像網購淘汰了雜貨店,汽車司機替代了馬幫商人。但這些被淘汰的美術職位,本來也談不上多少創意,更接近於流水線上的機械工作。AI幫這些美工人員認識到自己的真實能力,讓他們去其他領域探索自己的天賦,從長期來看可能是好事。如果畫師對自己的創意有信心,對自己的美術鑑賞能力有信心,就不會把AI軟件看做敵人,而是當做能提高效率的工具。整個美術行業都會因此進步。

但是,這次重慶山火事件提醒我們,在美術行業之外,社會應該重視AI創作工具的擴散問題,而且重視程度應該遠遠超過少數畫師的失業焦慮。因為這些創作工具在特定的環境下能扭曲媒體生態,在普通人和事實之間釋放信息煙霧,阻止公民正確理解社會現實。

打個比方,人類發明嗎啡和其他麻醉藥物,對醫學來説是好事,但是在醫學領域之外必須嚴格限制使用。如果中國社會不重視AI圖片對新聞媒體行業的衝擊,不保護“有圖有真相”的社會共識,AI圖片對中國社會的危害,可能會比嗎啡還厲害。

濫用嗎啡或者其他麻醉品會直接侵害大腦,製造嚴重上癮,破壞正常生活,為什麼説AI繪畫的破壞力有可能更強?

因為在特定的社會環境下,用AI定做的虛假事實也能讓人上癮,同時改變整個社會對真相的認識,更重要的是,信息造假行為可以利用上癮性賺錢,就一定會有人在利益驅動下,像毒販那樣,源源不斷地製造更多的上癮精神產品。

前面我提出過一個問題,如果AI製作的假現場圖片不是宣傳正能量,而是負面的信息,還會不會有人公開為媒體故意傳播假圖片的行為開脱?會不會有人公開反對追究責任?我猜是不會的。

但是現在就是有很多人覺得,只要是“正能量”,把AI生成的假圖片當成現場照片也沒問題。正確的立場比準確的事實更重要。

立場先行,這當然也是一種思考方式。但問題是,正確的立場不是天生的,而是通過接觸社會事實逐步形成的。馬克思主義基本原理之一就是社會存在決定社會意識,後來我們國家又有一段著名的解釋文字,不知道各位讀書的時候背誦過沒有,這裏我要重複一遍:

人的正確思想是從哪裏來的?是從天上掉下來的嗎?不是。是自己頭腦裏固有的嗎?不是。人的正確思想,只能從社會實踐中來,只能從社會的生產鬥爭、階級鬥爭和科學實驗這三項實踐中來。人們的社會存在,決定人們的思想。而代表先進階級的正確思想,一旦被羣眾掌握,就會變成改造社會、改造世界的物質力量。

背景音:https://music.163.com/#/song?id=1960226697

這段話再簡化一下,就是隻有社會實踐才能塑造正確立場,沒有事實支撐的所謂“正確立場”一文不值。如果有人覺得不要事實也能有正確立場,不要事實也有“天然的正義”,這種想法應該是反面典型,是其他人要帶着同情心幫助的幼稚觀點。現在類似的説法居然在簡體中文互聯網上成了主流意見,甚至有人願意主動給虛假內容當保護傘,説明我們的輿論生態出了問題。

退一步説,就算我們可以確認當前要維護的立場是正確的,放縱正能量虛假內容也必然會消滅“正確”。因為主流立場可以用虛假的內容證明自己,立場必然越來越極端,越來越誇張;而反對意見要接受更嚴肅的評判,可信性會越來越強。最終導致普通人會把主流立場當成反向指標。報紙時代、電視時代,我們都看過主流媒體欄目逐步喪失公信力的案例,現在不應該在網絡時代重複一遍。

我剛上網的時候,或者説20年前,中文互聯網上有一句話廣泛流傳——“無圖無真相”,説出口的時候往往帶着調侃語氣,實際上分量是很重的,因為它説明普通人默認現場照片可以反映真相。

這個共識是一份價值無法估量的信任,也是一套化解矛盾的權威規則。如果社會出現嚴重分裂,或者出現難以平息的爭議,嚴肅媒體就可以公佈現場調查圖片,重新給整個社會帶來團結,避免對抗情緒持續升温。現在AI製圖能上熱搜,能成為各家自媒體的頭條,能被全國性媒體選做海報,效果就是再也沒人相信“有圖有真相”。我們可能在不經意間丟掉了整個社會的壓艙石,拆掉了整個國家的泄壓閥。

不説整個社會的損失,就在媒體行業內部看,AI圖片刷屏也是一個重要的歷史岔路口。奧運會如果不檢查興奮劑,破了世界紀錄也是笑話;媒體行業如果為了正確立場保護虛構信息,等於直接否定了自身的存在價值。如果有了所謂“正確的立場”,就可以不去現場,不描述事實,拿出一份虛構內容就可以贏得影響力,事後也不受懲罰,很快就沒人願意當記者了,也不會再有人耐心核實內容。剩下的媒體人都是什麼人,中國觀眾都能猜到。

網絡時代的媒體生態和之前還不太一樣。過去的媒體自己投資建印刷廠,建發射塔,才能把消息傳遞給普通人。如果媒體為了所謂正確立場就放棄真實性,最多是自己的聲譽壞掉,市場被其他媒體佔領,還不至於影響整個社會。這就像酒廠為了賺錢造假酒,雖然也會造成破壞,但只要顧客發現喝了某個工廠的假酒就要去醫院,自然就會抵制產品,讓酒廠破產,不會讓破壞一直持續下去。

現在是自媒體時代,傳播是去中心化的,每個觀眾都是傳播體系的一部分,羣眾的轉發意願才是最主要的信息擴散渠道。如果有媒體專門迎合羣眾情緒,拋開事實定製內容,或者把別人的虛構信息説明故意剪裁掉,鼓勵觀眾轉發,這就不是造假酒了,而是故意建立販毒網絡,不僅直接破壞生活,還會干擾正常的經濟秩序,讓正常的商業也做不下去。

在現實的中國經濟領域,對應販毒網絡的東西是房地產傳銷泡沫。高房價不僅給開發商和地方政府帶來利益,還綁架了一大批城市人口,開發商降價立刻就有老業主去拼死抗議,結果大家都看到了,經濟秩序成了什麼樣子。

如果在AI圖片時代沒有法律制裁假信息,如果社會不能強迫造假的人承擔修復媒體生態的責任,我們的互聯網媒體生態也會有類似下場,全社會都會逐漸喪失獲取真實信息的能力,所以我提醒各位觀眾不要小看重慶山火事件之後的輿論場變化,一定要想辦法保護“有圖有真相”的社會共識。

488期睡前消息到此結束,文字內容隨後會發在睡前消息編輯部公眾號,也歡迎各位觀眾加我們的企業微信,以標準格式和我們交流,優秀內容會以蛋卷俱樂部資訊彙總的方式再發放給觀眾。我們週日再見!