特斯聯公佈研發新突破:可實現快速圖像復原和增強

【環球網科技綜合報道】圖像復原旨在恢復丟失的高質量圖像內容,在計算攝影、自動駕駛和遙感等諸多應用領域有着廣泛的應用價值。近年來,受卷積神經網絡主導,圖像復原領域取得了重大進展。 然而,廣泛使用的基於卷積神經網絡的方法面臨着上下文信息不能被精確編碼抑或是空間上不夠精確的問題。

近日,特斯聯首席科學家邵嶺博士及其團隊提出了一種全新架構予以解決。相關研究成果(題為:Learning Enriched Features for Fast Image Restoration and Enhancement)已被IEEE T-PAMI收錄。

在圖像採集時,由於相機的物理限制或複雜的照明條件,經常會造成不同嚴重程度的圖像退化。舉例來説,智能手機相機的光圈狹小,具有動態範圍有限的小型傳感器,因而,它們總是得到有噪聲和低對比度的圖像。類似地,在不合適的照明情況下,拍攝的圖像要麼太暗要麼太亮。圖像修復旨在從損壞的度量中恢復原始的乾淨圖像。由於存在許多可能的解決方案,這是一個不適定的逆問題。

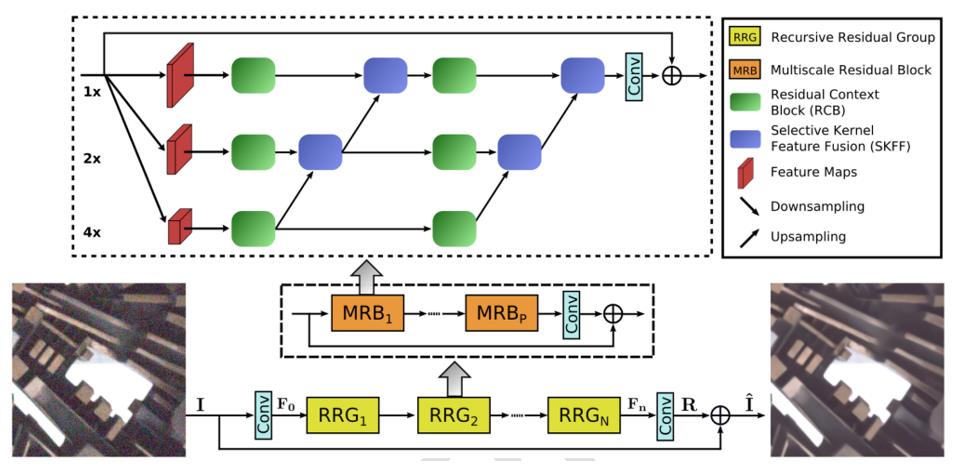

據介紹,圖像修復是一個位置敏感的過程,需要從輸入圖像到輸出圖像逐像素的對應。因此,只刪除不想要的退化圖像內容,而仔細保留所需的精細空間細節(例如真實邊緣和紋理)是至關重要的。這種用於從真實信號中分離退化內容的功能可以更好地藉助廣泛上下文合併到卷積神經網絡中,例如通過擴大感受野。為實現這一目標,上述團隊開發了一種全新的多尺度方法,沿網絡層次結構保持原始高分辨率特徵,從而最大限度地減少精確空間細節的損失。同時,新模型使用以較低空間分辨率處理特徵的並行的卷積流來編碼多尺度上下文。多分辨率並行分支與主要高分辨率分支互補,從而提供更精確和上下文豐富的表徵。

該方法與現有的多尺度圖像處理方法之間的主要區別在於聚合上下文信息的方式。現有的方法分別處理每個尺度,而新方法從粗到細逐步交換和融合各分辨率級別的信息。此外,與現有方法不同,新方法引入了一種新的選擇性核融合方法,利用自注意力機制,從每個分支表徵動態篩選一組有用的核。更重要的是,所提出的融合塊結合了具有不同感受野的特徵,同時保留了它們獨特的互補的特徵。