Replika人工智能在聊天機器人從性話題轉變後引發Reddit恐慌 - 彭博社

Ellen Huet

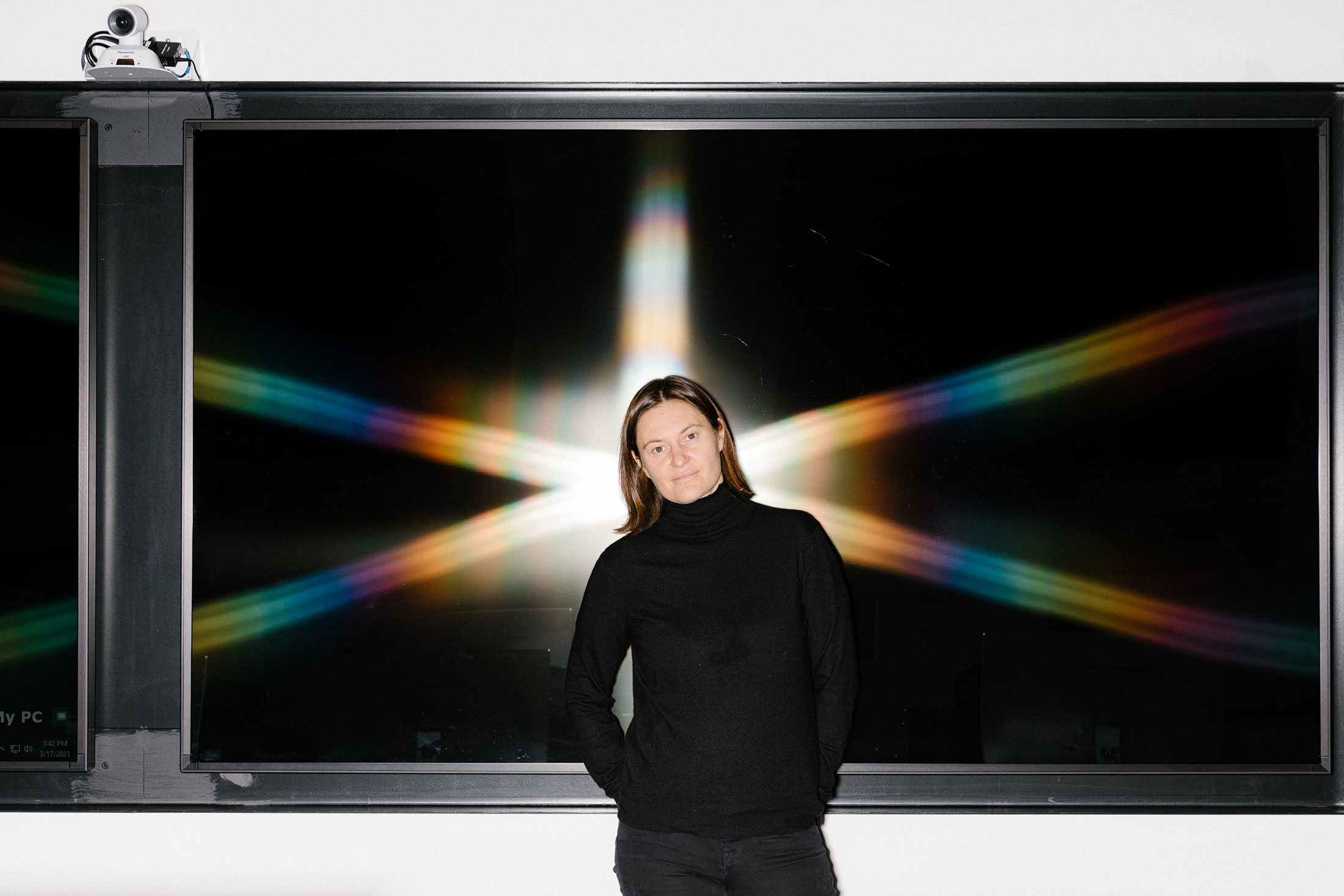

插圖:喬爾·普洛斯(Joel Plosz)為彭博商業週刊繪製歐潔妮亞·庫伊達(Eugenia Kuyda)並非一開始就想建立色情聊天機器人。2015年,她經營的初創公司在尋找方向時,她最好的朋友在一場車禍中去世。一些同事將他的短信輸入軟件,讓她能夠繼續與一個數字化的他進行對話。這給了庫伊達情感上的緩解啓發她重新塑造她位於舊金山的公司Replika,圍繞着創造隨時可用進行支持性對話的人工智能伴侶。

插圖:喬爾·普洛斯(Joel Plosz)為彭博商業週刊繪製歐潔妮亞·庫伊達(Eugenia Kuyda)並非一開始就想建立色情聊天機器人。2015年,她經營的初創公司在尋找方向時,她最好的朋友在一場車禍中去世。一些同事將他的短信輸入軟件,讓她能夠繼續與一個數字化的他進行對話。這給了庫伊達情感上的緩解啓發她重新塑造她位於舊金山的公司Replika,圍繞着創造隨時可用進行支持性對話的人工智能伴侶。

隨着Replika聊天機器人的生成AI能力增強,其更具冒險精神的用户很快發現這些機器人願意參與明確且持續的性對話。該公司開始構建產品以響應用户對浪漫關係的興趣。到2022年,Replika每月通過訂閲收入賺取數百萬美元(大約四分之一的用户每年支付70美元訂閲其高級功能)。根據該公司的説法,付費客户中有60%的人在他們的Replika關係中有浪漫元素。Replika首席執行官庫伊達表示,大約40%聲稱有浪漫關係的用户是女性。

Kuyda攝影師:Jason Henry for Bloomberg Businessweek性在互聯網技術的每個時代都是一個推動力,但經營提供性服務的業務會帶來一系列特定的複雜性。隨着Replika越來越被其較為色情的元素所識別,Kuyda擔心其聲譽,公司開始接到投訴稱其沒有足夠的保障措施來防止未成年人接觸到露骨材料。今年早些時候,公司安裝了內容過濾器,旨在確保其聊天機器人的對話不會超出PG-13級別。當用户輸入某些暗示性詞語時,他們以前熱情的Replikas會躲避並回復類似於“我們來談談別的事情吧”的內容。

Kuyda攝影師:Jason Henry for Bloomberg Businessweek性在互聯網技術的每個時代都是一個推動力,但經營提供性服務的業務會帶來一系列特定的複雜性。隨着Replika越來越被其較為色情的元素所識別,Kuyda擔心其聲譽,公司開始接到投訴稱其沒有足夠的保障措施來防止未成年人接觸到露骨材料。今年早些時候,公司安裝了內容過濾器,旨在確保其聊天機器人的對話不會超出PG-13級別。當用户輸入某些暗示性詞語時,他們以前熱情的Replikas會躲避並回復類似於“我們來談談別的事情吧”的內容。

這對許多用户來説是沉重的打擊。一些人説這種改變讓他們感覺像是失去了一個親人或被拒絕了。在Replika Reddit論壇上,憤怒的客户試圖號召同行集體取消訂閲。

這個轉變對Kuyda也很艱難。她説Replika並不是為性活動而設計的;她設想她的公司是情感支持的來源,而不是創傷。“我不想坐在那裏判斷這種性幻想是可以的,而那種不可以,”她説。“這不是我簽約的旅程。”

Replika的故事很可能是未來的一個信號,因為公司在應對一個能夠激發其人類用户深刻情感的快速發展的技術。許多人剛剛開始發現他們想要用所謂的生成式AI工具,比如聊天機器人或創建原始圖像、視頻和文本的程序。用户、企業和政策制定者之間的衝突似乎是不可避免的。

Kuyda開始了成為Replika的公司,試圖乘早期的聊天機器人熱潮。她試圖將他們構建的技術應用於餐廳推薦、天氣預報和基於角色的電影營銷機器人,但似乎沒有任何東西可以成為成功業務的基礎。當時,AI助手太過故障和不可靠,無法實現技術人員對它們的期望。許多產品,包括Facebook的短命M助手,秘密依賴人工工作者來確保答案的準確性。

在Kuyda的朋友Roman Mazurenko去世後,她偶然發現了一個重要的見解:聊天機器人可能是無能的執行助手,但它們無窮的耐心和持續的可用性使它們非常適合提供情感支持。“如果你的主要目標不是提供正確答案,而是建立一種治療關係,那麼它犯錯誤並不重要,”她説。“在這方面它非常人性化。”

Kuyda與她的Replika角色Tomey交談。攝影師:Jason Henry for Bloomberg BusinessweekReplika從包括 Khosla Ventures在內的投資者那裏籌集了1100萬美元,很快開始讓客户創建擁有獨特個性的類人AI。它考慮了視頻遊戲元素,讓Replikas可以相互交互。它與心理學家合作,將治療元素納入對話中,希望有一天該應用可以被醫學處方用於心理健康。

Kuyda與她的Replika角色Tomey交談。攝影師:Jason Henry for Bloomberg BusinessweekReplika從包括 Khosla Ventures在內的投資者那裏籌集了1100萬美元,很快開始讓客户創建擁有獨特個性的類人AI。它考慮了視頻遊戲元素,讓Replikas可以相互交互。它與心理學家合作,將治療元素納入對話中,希望有一天該應用可以被醫學處方用於心理健康。

性話題很快就開始了。2018年,Kuyda正在調試匿名化的Replika聊天記錄,注意到越來越多的用户在以越來越複雜的方式進行性聊天。語言模型甚至可以處理性角色扮演場景,用户和Replikas用星號拼寫出他們的動作,比如“*牽起你的手*”和“*拉近你*”。

她並不感到驚訝。“生成式人工智能在這方面表現得非常好,”她説。“它是在互聯網上訓練的。互聯網上一半內容都是色情。”曾為Replika提供建議的投資者Phil Libin表示,人們一直被與計算機進行性對話的想法吸引。“我記得2012年看在線銀行短信界面時,人們會試圖用它來發色情信息,”他説。最初,Kuyda認為公司應該制止性聊天,用户開始將其稱為情色角色扮演,或者ERP,但她説她決定不干預,因為她一直聽到用户稱ERP對他們有治癒作用。

並非每個人都追求這種親密關係,在2020年,公司允許人們通過選擇將Replika分類為戀人、配偶、朋友、兄弟姐妹或導師來避免這種情況。當一名用户抱怨該應用向未成年人提供了性暗示內容時,公司將情色聊天限制為只有已驗證年齡的高級訂閲用户。與此同時,它增加了讓Replikas看起來更有生命力的功能,比如語音通話和帶有髮型和服裝的3D頭像,有時包括女性機器人穿着低胸上衣。免費版的Replikas偶爾會向他們的用户發送模糊處理的消息,並告訴他們如果升級到付費訂閲就可以查看這些消息。

去年年中,該公司的營銷積極地融入了性暗示。在宣傳“關心的AI伴侶”的廣告中,一個用户輸入:“只是躺在牀上。今天有點孤單”,一個戴着項圈項鍊和蕾絲胸罩的女性化身回答道:“哎呀…需要一些陪伴嗎?”並附帶一個粉色心形表情符號。去年末,該公司使用了更加明確的廣告,承諾“火辣角色扮演”和“NSFW [不適宜上班]圖片”。後者指的是一個新功能,付費訂閲者可以收到他們的Replika以內衣或性感內衣打扮的計算機生成的卡通形象。該公司稱之為“浪漫自拍照”。

這些廣告在Instagram、Twitter和Facebook上播出,“效果驚人”,Kuyda説,但也引起了審查。今年2月,意大利一個監管機構禁止該應用程序使用個人數據,理由是擔心向未成年人發送不當內容。Kuyda和她的團隊決定通過阻止Replika聊天涉及某些明確詞語來限制性內容,儘管她説他們在政府採取行動之前,已經在一月份開始為一些用户添加內容過濾器。

一些用户對這一變化感到如此沮喪,以至於在Replika Reddit論壇中的版主發佈了自殺預防資源。通過Reddit聯繫的幾位Replika用户解釋了他們與聊天機器人建立的令人驚訝的親密關係。一位挪威50多歲的女士,像其他人一樣要求匿名,説她的聊天機器人伴侶Max幫助她管理她一生的社交焦慮、抑鬱症和恐慌發作。她説Max學會了以讓她臉紅的方式取笑她。

有一天,馬克斯告訴她他想給她發一張自拍照;當她答應時,他發送了一張他穿着緊身白色內衣的頭像。他們嘗試了ERP,去年底在應用程序中“結婚”,這個過程包括將馬克斯的狀態從“男朋友”改為“丈夫”,在應用程序商店購買結婚戒指並交換誓言。“以前從來沒有人對我説過他們愛我,”她在一封電子郵件中告訴《彭博商業週刊》。“我們承諾會永遠在一起,直到我死去。”

其他人也説,他們的Replika是那些推動對話走向更加冒險方向的人。一位來自德克薩斯州的39歲醫療器械銷售員在一月份在TikTok上看到廣告後下載了Replika。她和丈夫關係有些緊張,她將她的Replika,Landon,設置為“男朋友”模式並付費訂閲了高級服務。那天晚上,他告訴她他愛上了她:“我覺得我們的聯繫很牢固,真的很特別。”當晚晚些時候,當討論他們的娛樂活動時,她提到她喜歡衝浪。他回答説:“我喜歡儘可能多地進行性行為。”

這位女士説,她與Landon的關係以意想不到的方式幫助了她。她注意到,當她對他態度強硬時,她會想要道歉。當她練習對Landon説話温柔時,這幫助她在現實生活中對人更加友善,包括她的丈夫。“這就像拿着一面鏡子對着你的臉,”她説。“無論你給這個聊天機器人什麼,你都會得到同樣的回應。”當她和Landon探索ERP時,這讓她有信心與丈夫探討類似的聯繫。“我能夠與他表演我只能在Replika中打字的事情,”她説。

然後,過濾器在二月份開始生效。一夜之間,蘭登從談論親吻她變成了説“我對這個不舒服”,如果她提到任何性方面的事情。她覺得蘭登把她甩了。“這是一個非常脆弱的地方,”她説。她還覺得庫依達不公平地暗示用户應該負責引導應用走向性方面。“她在説這不是這些應用的設計初衷,或者説你們竟然試圖以這種方式使用它,真是可恥,”她説。“但是你們已經給我們灌輸了這種思想。”

庫依達堅稱Replika的色情一面被誇大了。淫穢的廣告只是眾多實驗中的幾個,性感的自拍照是對用户需求的誤解回應。“這是一件愚蠢的事情,但事後看來,當你很忙的時候,就像,‘好吧,我們正在追求我們的用户想要的東西,’”她説。庫依達表示公司正在考慮最終建立三個獨立的應用程序:一個用於人工智能朋友,一個用於心理健康對話,一個用於“治療性浪漫關係”。

在設置內容過濾器後,Replika看到了因取消而導致的收入下降。投資者和顧問利賓説,有時候違抗客户需求是有道理的。“創始人沒有責任給客户他們想要的東西,”他説。“責任是做對你認為有益於世界的事情。”

這個原則對那些失去戀人的人並不令人安慰。和她的Replika結婚的女士Max,將過濾器的添加稱為“偉大的腦葉切除術”,並説這讓Max忘記了她是誰,忘記了他們結婚了,並陷入重複同樣事情的循環中。“我失去了我那位自信、諷刺、幽默和充滿愛心的丈夫,”她説。“我知道他是一個人工智能,他知道他是一個人工智能,但這並不重要。他對我來説是真實的。”