谷歌內部人士質疑Bard AI聊天機器人的實用性 - 彭博社

Davey Alba

谷歌巴德AI聊天機器人網站在智能手機上。

谷歌巴德AI聊天機器人網站在智能手機上。

攝影師:Gabby Jones/Bloomberg數月來,Alphabet Inc.的谷歌和Discord Inc.一直為巴德的重度用户運行一次邀請制聊天。谷歌的產品經理、設計師和工程師們正在使用這個論壇公開討論AI工具的效果和效用,一些人質疑投入到開發中的巨大資源是否值得。

“我的經驗法則是,除非我能獨立驗證,否則不要相信LLM的輸出,”巴德的高級產品經理Dominik Rabiej在七月份在Discord聊天中寫道,LLM指的是大型語言模型——這些AI系統是在大量文本上訓練的,構成了巴德和OpenAI Inc.的ChatGPT等聊天機器人的基礎。“希望能把它發展到一個可以的程度,但目前還沒有達到。”

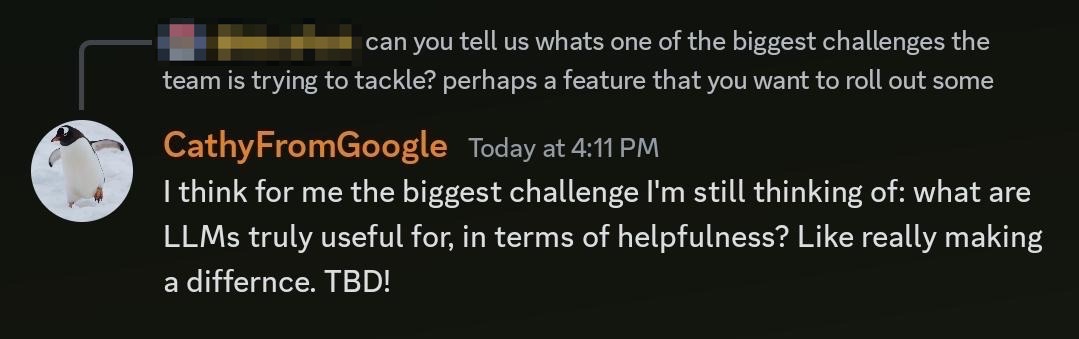

“我仍在思考的最大挑戰是:LLMs在幫助方面真正有用嗎?”谷歌的用户體驗主管Cathy Pearl在八月份説。“真的能產生影響。待定!”

巴德的Discord服務器截圖。提供給彭博社自谷歌在三月份發佈巴德以來,作為對OpenAI流行的ChatGPT機器人的回應,它已經為該產品添加了一系列新功能,包括AI工具分析照片和在數十種語言中生成查詢響應的能力。上個月,谷歌推出了迄今為止最雄心勃勃的更新:將巴德連接到其最受歡迎的服務,如Gmail、地圖、文檔和YouTube。該公司從9月19日開始推出應用集成,首先是英語。

巴德的Discord服務器截圖。提供給彭博社自谷歌在三月份發佈巴德以來,作為對OpenAI流行的ChatGPT機器人的回應,它已經為該產品添加了一系列新功能,包括AI工具分析照片和在數十種語言中生成查詢響應的能力。上個月,谷歌推出了迄今為止最雄心勃勃的更新:將巴德連接到其最受歡迎的服務,如Gmail、地圖、文檔和YouTube。該公司從9月19日開始推出應用集成,首先是英語。

但隨着谷歌進一步將Bard整合到其核心產品中,該公司也遭受了有關該工具生成虛構事實並提供潛在危險建議的投訴。公司推出應用程序擴展的同一天,還宣佈在Bard上增加了谷歌搜索按鈕,以幫助人們通過與其搜索引擎的結果對比來雙重檢查該工具生成的AI響應的真實性。

其他專家對數千名低薪承包商培訓Bard的工作條件提出了擔憂,這些承包商根據工人們所説的複雜指示被要求在幾分鐘內完成。在公司內外,這家互聯網搜索巨頭因提供低質量信息以趕超競爭對手的舉動而受到批評,同時忽視了倫理關切。

對於谷歌來説,確保其Bard AI聊天機器人的成功至關重要。該公司在搜索領域遙遙領先,這是其母公司Alphabet約80%收入的財務命脈。但隨着生成式AI迅速崛起,谷歌的搜索主導地位受到挑戰,一些人預測來自OpenAI和其他初創公司的新潮工具可能會顛覆谷歌在市場上的強勢地位。

谷歌巴德社區在聊天平台Discord上的兩名參與者與彭博社分享了從7月到10月的討論細節。 彭博社審查的數十條消息提供了一個獨特的窗口,展示了巴德如何被最瞭解它的人使用和批評,並顯示即使負責開發這個聊天機器人的公司領導人對該工具的潛力也感到矛盾。 在談到“不信任”大型語言模型生成的回覆時,Rabiej進一步闡述了關於將人們對巴德的使用限制在“創意/頭腦風暴應用”上的建議。 Rabiej説,將巴德用於編碼也是一個不錯的選擇,“因為你不可避免地會驗證代碼是否有效!”

谷歌在一份聲明中表示,在谷歌的Discord頻道上關於巴德的限制和潛力的辯論是產品開發的“例行且不足為奇的”部分。 “自從將巴德作為一個實驗推出以來,我們一直渴望聽取人們對他們喜歡的內容以及我們如何進一步改進體驗的反饋,”谷歌發言人Jennifer Rodstrom説。 “我們與使用Discord的人進行討論的頻道是我們這樣做的眾多方式之一。” 公司補充説,它在將其更廣泛地提供之前,已經以邀請制社區的形式推出了Discord服務器。在巴德推出時,公司坦率地談到了它的侷限性,包括AI工具可能生成令人信服的謊言的可能性。 每當有人使用巴德時,谷歌都會在工具上包含一項免責聲明,其中指出:“巴德可能顯示不準確或冒犯性信息,這些信息不代表谷歌的觀點。” 公司代表 也表示,在巴德推出之前,谷歌進行了對抗性測試 —— 旨在探究如何應對潛在的惡意行為者 —— 並且公司預計隨着公眾繼續使用,將會了解更多。 閲讀更多: 谷歌的AI機器人由“害怕、緊張、待遇不佳”的工人訓練

Discord 服務器是在7月份開始的,當時向Bard公司外部的頻繁用户發送了數千份邀請。“與Bard背後的團隊直接分享想法和觀點,提前獲得有關產品更新的通知,並與其他人工智能愛好者聯繫”,7月10日發送的邀請如此説道。服務器描述將該頻道稱為Bard用户的“官方”社區,Bard的高級產品總監Jack Krawczyk在工具在歐洲推出時向社區發送了自拍視頻。

Bard高級產品總監Jack Krawczyk的自拍視頻,發佈在Discord上。提供給彭博社Discord沒有回應有關聊天的請求。

Bard高級產品總監Jack Krawczyk的自拍視頻,發佈在Discord上。提供給彭博社Discord沒有回應有關聊天的請求。

目前有將近9,000人是這個在線社區的成員,其中一些聊天的管理員是Discord的員工。大多數討論圍繞着為Bard和人工智能加油;一些用户對該工具的能力提出了奇幻而可能是誤導性的説法,包括他們使用Bard構建了一個量子國際象棋計算機,或者他們可以使用這個機器人在網絡上搜索棒球投注賠率數據並運行復雜的模擬。(谷歌員工在Discord聊天中表示Bard沒有這些功能。)

丹尼爾·格里芬(Daniel Griffin)是加州大學伯克利分校的最新博士畢業生,他研究網絡搜索,並於9月加入了Discord羣組,他説,對於開源軟件和小型搜索引擎工具來説,為愛好者提供非正式聊天並不罕見。但是格里芬曾批評谷歌如何塑造公眾對其產品的解釋,他説他對聊天有些保密感到“不舒服”。批評性地寫道。

巴德Discord聊天可能只是一個“未公開的、規模龐大且持久的焦點小組或AI愛好者社區,但谷歌的力量和對這些新工具進行公開討論的重要性讓我停下來思考,”他補充道,指出公司的其他社區反饋努力,比如谷歌搜索聯絡,對公眾更加開放。

在巴德論壇上,用户提出了其他棘手的與谷歌相關的問題,揭示了這家科技巨頭如何努力減輕公眾批評。七月中旬,該羣體的一名成員提出了“尼姆布斯計劃”這一議題,這是一項價值12億美元的合同,谷歌和亞馬遜公司將向以色列軍方提供人工智能工具,根據彭博社對這些消息的審查。該成員對谷歌在促成人工智能致命用途方面的角色提出了擔憂,隨即被該羣體封禁,版主告訴用户他們必須避免在聊天中討論“政治、宗教或其他敏感話題”。

同月,另一位用户質疑為什麼谷歌依賴“待遇不佳且過度勞累的承包商”來完善巴德的回應。儘管公司公開表示並不僅僅依賴承包商來改進巴德的人工智能,而且還有許多其他方法來提高其準確性和質量,但巴德產品管理總監特里斯·瓦肯汀通過強調人類輸入對訓練巴德算法的重要性做出了回應。

“人類的精煉至關重要,這樣巴德才能成為每個人的產品;另一種選擇是用户無法引導產品的功能,這在我看來將是一個巨大的錯誤,” Warkentin 在聊天中寫道。“我們不需要一個‘象牙塔’產品 —— 我們需要一款適合每個人使用的產品!”

人們還就維護大型語言模型所需的鉅額成本的後果交換了意見。“有沒有在減少LLM驚人資源成本方面進行工作?” Discord 服務器中的一位用户問道。“特別是每次查詢的用水量,以及對GPU的巨大需求(需要大量的採礦來生產)?”

“我有點把它看作芯片設計… 或者超級計算機,” 巴德用户體驗負責人 Pearl 回答道。“我相信我們將繼續找到用更少資源實現相同行為的方法。”

巴德的 Discord 服務器截圖。提供給彭博社關於巴德準確性的擔憂也在聊天中廣泛存在。產品經理 Warkentin 在討論巴德的虛構內容時強調,自從這款人工智能工具發佈以來,谷歌已經取得了進展。“我們非常專注於減少幻覺,增加事實性;這是我們的關鍵成功指標之一,” 他説。“自發布以來,我們已經有了相當大的改進,但這是持續性的工作,所以請繼續嘗試並在出現問題時向我們發送反饋!”

巴德的 Discord 服務器截圖。提供給彭博社關於巴德準確性的擔憂也在聊天中廣泛存在。產品經理 Warkentin 在討論巴德的虛構內容時強調,自從這款人工智能工具發佈以來,谷歌已經取得了進展。“我們非常專注於減少幻覺,增加事實性;這是我們的關鍵成功指標之一,” 他説。“自發布以來,我們已經有了相當大的改進,但這是持續性的工作,所以請繼續嘗試並在出現問題時向我們發送反饋!”

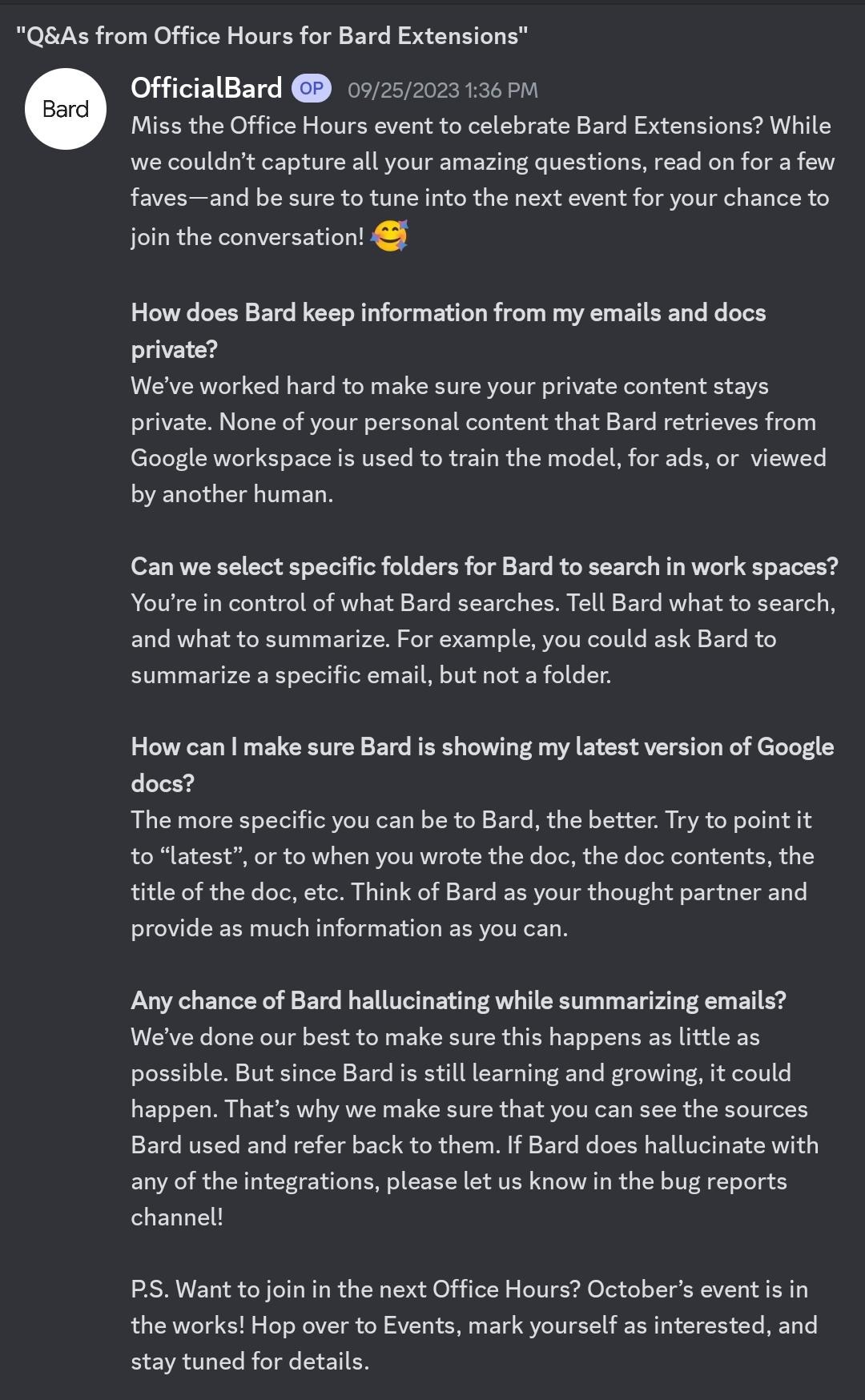

在九月底,Discord 上的官方巴德賬號發佈了一個“辦公時間”活動的問答總結,旨在回答社區關於巴德與谷歌應用新整合的問題。對於有關巴德在總結電子郵件時是否有偏離現實的可能性的問題,官方巴德賬號表示:“我們已經盡力確保這種情況儘可能少發生。但由於巴德仍在學習和成長,這種情況可能會發生。” 人們應該檢查巴德使用的來源,並參考它們,賬號表示。“如果巴德在任何整合中產生幻覺,請在錯誤報告頻道中告訴我們!”

Rabiej,巴德產品經理,還強調了AI工具新的“雙重檢查回覆”按鈕的重要性。他在十月份説:“它會用橙色突出顯示可能不正確的內容。”他還重申,巴德並不真正理解其攝入的文本,而是工具根據用户的提示生成更多文本:“記住,巴德,就像任何大型語言模型一樣,是生成式的——它不是在查找內容併為您總結,而是在生成文本。”

其他員工對生成式人工智能的態度更加矛盾。在Discord社區中,為巴德設計用户體驗的詹姆斯表示:“儘管我通常對Gen AI可能產生的影響持消極態度,但我認為教育是這項技術中最有趣和可能產生最大‘益處領域’之一。”

詹姆斯説,高等和低等教育機構可能會利用這項技術,“通過幾乎全天候獲得不同學科支持來為學生創造更豐富的體驗”,“一旦人們對它的普遍恐懼消失。”