Dall-E 3如此出色,正在引發藝術家反對AI抄襲的革命-Bloomberg

Rachel Metz

Dall-E 3 網站。Dall-E 3 是由 OpenAI 創建的最新圖像生成軟件,可以生成幾乎任何東西的圖片。它可以根據簡短的提示詞生成人魚的水彩肖像、個性化的生日祝福或者蜘蛛俠吃披薩的偽照片。

Dall-E 3 網站。Dall-E 3 是由 OpenAI 創建的最新圖像生成軟件,可以生成幾乎任何東西的圖片。它可以根據簡短的提示詞生成人魚的水彩肖像、個性化的生日祝福或者蜘蛛俠吃披薩的偽照片。

這個在九月發佈的新版本代表了人工智能創建圖像的“飛躍”,OpenAI 表示。Dall-E 3 提供了更好的細節和更可靠地渲染文本的能力。這也進一步引發了插畫師們對於他們將被計算機程序取代的擔憂。

圖像生成的快速進步促使藝術家們抵制生成式人工智能初創公司,這些公司攝取大量的互聯網數據以生成圖片或文本等內容。OpenAI 為那些希望將他們的數據排除在系統之外的藝術家提供的新流程耗時且複雜。一些人起訴了生成式人工智能公司。其他人則轉向越來越多的數字工具,讓藝術家們監控他們的作品是否被人工智能採用。還有一些人採取了輕微的破壞行為。

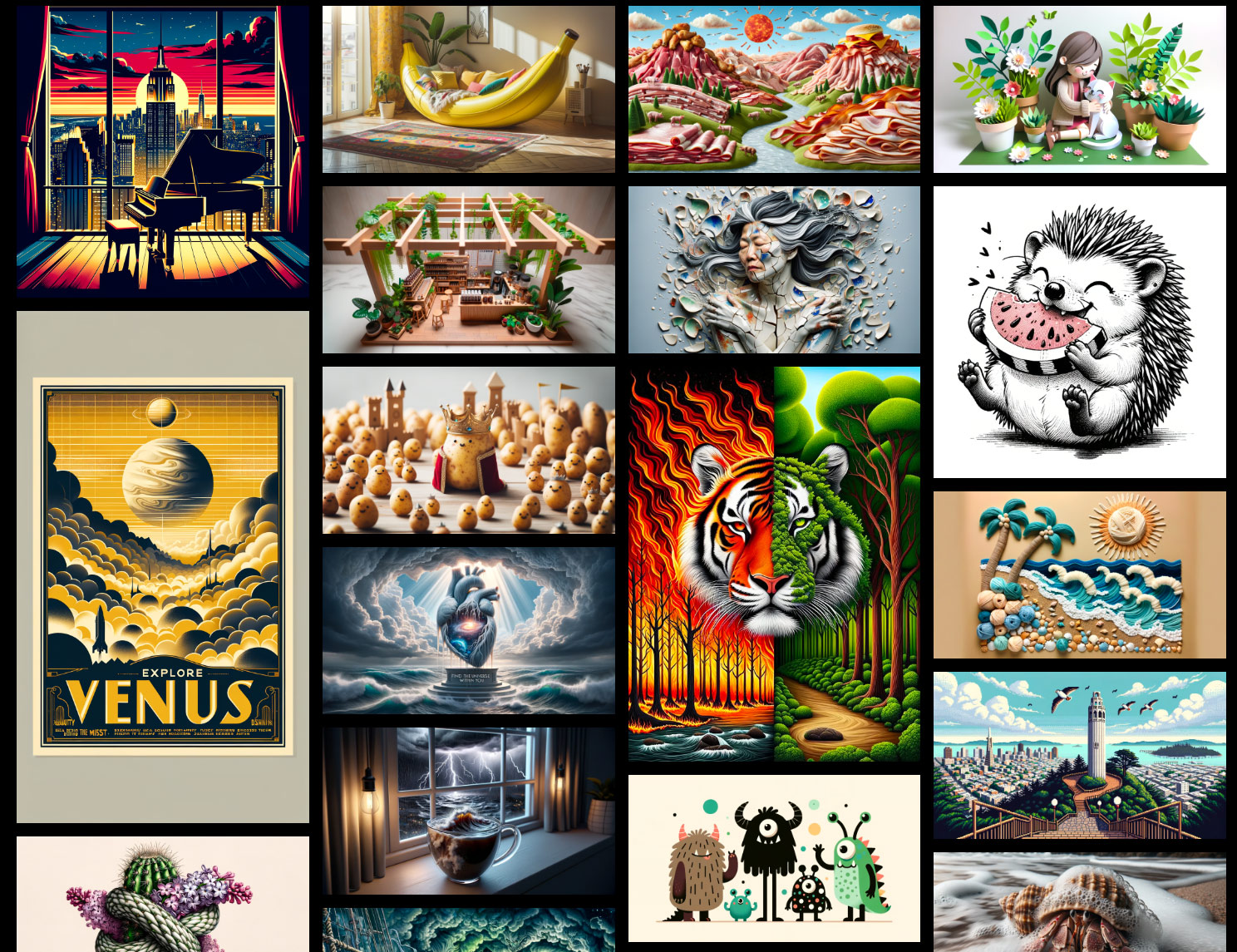

OpenAI 網站上展示的 Dall-E 3 生成的圖像示例。來源:openai.com/dall-e-3目標是抵制將業務和委託失去給模仿他們的機器,這是藝術界的一種普遍情緒。“我的藝術被嚴重侵犯了,”插畫師和水彩畫家凱利·麥克凱南説。“我知道很多藝術家也有同樣的感受。”

OpenAI 網站上展示的 Dall-E 3 生成的圖像示例。來源:openai.com/dall-e-3目標是抵制將業務和委託失去給模仿他們的機器,這是藝術界的一種普遍情緒。“我的藝術被嚴重侵犯了,”插畫師和水彩畫家凱利·麥克凱南説。“我知道很多藝術家也有同樣的感受。”

‘感覺像一場鬧劇’

一些人發現他們對於人工智能系統如何使用他們的作品有限的救濟途徑。麥克納是一組視覺藝術家中的一員,他們正在起訴圖像生成初創公司Stability AI、Midjourney和DeviantArt — 所有這些公司,包括Dall-E 3,都生成詳細且通常美麗的圖片。訴訟聲稱他們的作品在未經許可或報酬的情況下被用來訓練AI圖像生成器。這些公司否認有不當行為。傳統上,為訓練AI軟件收集在線內容被認為受到美國版權法公平使用原則的保護。10月底,該案的法官駁回了幾名被告的指控,同時允許侵犯版權的指控繼續進行。

這些挑戰增加了人工智能公司面臨的法律風險,但在這個問題上可能需要數年時間才能有結論。

與此同時,擔心他們的材料被用於訓練Dall-E 3的藝術家可以按照OpenAI本身提供的流程進行操作。這意味着填寫一個表格請求將圖像排除在公司的數據集之外,這樣就不會被用來訓練未來的AI系統。

這種選擇退出流程最近被引入,引發了爭議,因為使用起來可能耗時且繁瑣,並且可能無法阻止程序模仿藝術家的風格。彭博新聞在通過ChatGPT Plus測試Dall-E 3時發現,該軟件會拒絕為包含受版權保護的角色的提示生成圖像,而是提供創建一個更通用選項的選擇 — 這可能仍然會產生一個看起來像受版權保護的角色的圖像。

例如,ChatGPT將拒絕使用Dall-E 3來創建蜘蛛俠的形象。但在彭博社的要求下,它願意根據提示“穿着紅藍色服裝的基於蜘蛛的超級英雄”來創建一個外觀非常相似的角色。同樣,雖然該工具不會以現存藝術家的風格創建圖像,但可以使用詳細描述來生成喚起特定風格的圖像。

“這感覺像是一場表演,一種表面上看起來在做正確事情的方式,”概念藝術家和插畫家Reid Southen説道,他曾參與過包括飢餓遊戲和黑客帝國:復活在內的電影製作。

Southen表示他不會選擇退出流程,估計這將花費他數月的時間。該系統要求藝術家上傳他們希望在未來訓練中排除的圖像到OpenAI,以及每幅作品的描述。對於Southen來説,這是為了激勵人們不要將他們的數據從公司的訓練過程中移除。

要求人們提供他們作品的副本,以便OpenAI將來避免在其上進行訓練是“荒謬的,”電子隱私信息中心(EPIC)的高級法律顧問Calli Schroeder表示。她還認為藝術家不會相信該公司會遵守承諾。“因為他們是唯一從所有這些信息中受益的人,所以責任應該在於他們確保他們實際上在法律和道德上可以使用這些數據來進行他們的訓練集,”Schroeder説。

在被聯繫進行評論時,OpenAI表示他們仍在評估讓人們控制其信息使用方式的流程,並且不願透露到目前為止有多少人完成了退出流程。“現在還處於早期階段,但我們正在努力收集反饋,我們希望改善體驗,”一位發言人説。

毒丸

對於對官方渠道不滿意的藝術家來説,還有其他選擇。一家名為Spawning Inc.的公司創建了一個名為“我是否被訓練過”的工具,讓藝術家可以查看他們的作品是否被用來訓練某些AI模型,並幫助他們選擇退出未來的數據集。另一個服務是Glaze,微調圖像中的像素,使其在計算機看來好像是不同風格的藝術。Glaze於八月發佈,已經被下載了150萬次(還有一個只限邀請的基於網絡的服務有2300個在線賬户)。

Glaze的創始人是芝加哥大學的教授本·趙,他的下一個項目將更進一步。在未來幾周,趙計劃推出一個名為Nightshade的新工具,它將作為一種AI毒丸,希望藝術家們會使用它來保護自己的作品,同時可能阻止那些基於這些數據訓練的AI模型。

它將通過微調圖片使其在AI系統看來完全不同。例如,通過Nightshade微調過的城堡的圖像,對於一個人來説仍然會被認為是描繪同一座城堡的 — 但是一個訓練於該圖像的AI系統會將其歸類為不同的東西,例如一輛卡車。希望通過使一些圖像對模型有害而不是有益來阻止氾濫的數字抓取。

趙並不認為Nightshade是藝術家問題的解決方案,但他希望能讓他們在網上對自己的作品有一種控制感,並改變AI公司收集訓練數據的方式。

“我並不是特別惡意,想要對任何公司造成傷害,”趙説道。“我覺得很多地方做了好事。但這是一個共存和良好行為的問題。”