AI,是愛不是愛?_風聞

航通社-航通社官方账号-微信公号:航通社02-15 09:16

本文首發於航通社,原創文章未經授權禁止轉載

航通社微信:lifeissohappy 微博:@航通社

它們真的是「永不凋謝的花朵」嗎?

文/書航 2023.2.14

每次發稿都趕在 0 點前推送有一個問題,就是看到這篇講情人節的稿子的時候,已經是情人節後的一天了。

ChatGPT 的出現,讓人們驚歎人機對話已經發展到了真假難辨的程度。它可以可靠地替代人類一部分複雜的腦力勞動,即使成品仍需要真人把關。網上有不少訓練實例是把它變成「貓娘」「女僕」等説話口氣。這不禁讓人想到,這些使用自然語言的傢伙們會不會成為越來越多碳基人類戀愛的對象?

這是個老套的話題,至少電影《Her》代表了此類話題的刻板印象。而在此之前這也不只是科幻。在 AI 沒有進化到今天這個程度的時候,一年前就有個叫做 Replika 的虛擬情人出現,而且非常受歡迎。它最近正受到一次更新帶來的後遺症困擾,本文下面會講到這個事。

更早之前,從微軟剝離出來的小冰也做過虛擬男友/女友的測試,儘管參與者比較少,但也同樣付出了真情實感。在技術遠沒有現在成熟的 2018 年,小冰曾經公佈人類與它的中文最長單次對話輪數為 7151 輪,持續了 29 小時 33 分鐘。而小冰的日本版「凜菜」也成為一個虛擬偶像,逢年過節都會收到粉絲為她送來的禮物。

所以,我們不需要等到 AI 進化到 ChatGPT 這個程度,才需要開始擔心它們搶佔人類感情空間的問題。

把這些「無法觸摸」的聊天對象作為情感宣泄的出口,跟真人相比,還缺點什麼嗎?AI 或許是害怕與真人交往被刺得遍體鱗傷的人們的避風港,但它們真的是「永不凋謝的花朵」嗎?

全靠腦補

關於 AI,我有一個基本觀點:它和我們曾經遇到過的其他事物一樣,有些無法仿真模擬人類的「裂縫」需要人類的大量「腦補」來填滿。而這些情感替代物越是不像人類,就越需要人類「腦補」。「腦補」是「腦內補完」的簡稱。

有很多「前輩」們比 Replika、小冰們更不像是真人,但並不妨礙人們在它們身上寄託感情。當日本粉絲們伴着「凜菜」入眠的時候,就像其它「紙片人」「老婆」(waifu)一樣,其實並不要求「她們」會跟自己交互,腦中就已經有了千萬思緒。

人際交往是人類生活的必需品,但這種必需品卻大量依賴人類的自我腦補和想象來充實。即使是真人之間的關係,也不可能只靠兩個人的語言交流就明白所有事情,總會有誤會和不能「心有靈犀」的時候。

有時,關係中的某一方會臨時向另一方關閉交流渠道。此時另一方被迫進入腦補模式——他晚上不回家,肯定是加班去了吧。她長時間不理我,應該有急事要忙吧。

非人類的情感替代物始終都不能主動回應人類,哪怕是 ChatGPT 也做不到主動發起會話;Replika 們裝作「懂你」的自動回覆往往又太過笨拙。那麼,留給人們腦補的部分就更多了。

我記得中學英語課本上講過一個叫《荒島餘生》的劇,主人公叫查克,由湯姆·漢克斯扮演,他帶着一個排球在無人島上求生。這個球上印着「威爾森」的商標,所以查克就管它叫威爾森,並對着它自言自語。在荒無人煙的環境中,目之所至都是固定不變的事物,如果沒有一個能談話和傾訴的對象,哪怕只是一個皮球,人都是要爆炸的。

孩子們幾乎都有過類似的經歷:他們指着空氣中的某個位置,説「這就是我的朋友」,而除了孩子自己之外,別人都看不到這個假想的朋友。不過,大家會配合孩子繼續交流,就像這個朋友是真實存在的一樣。

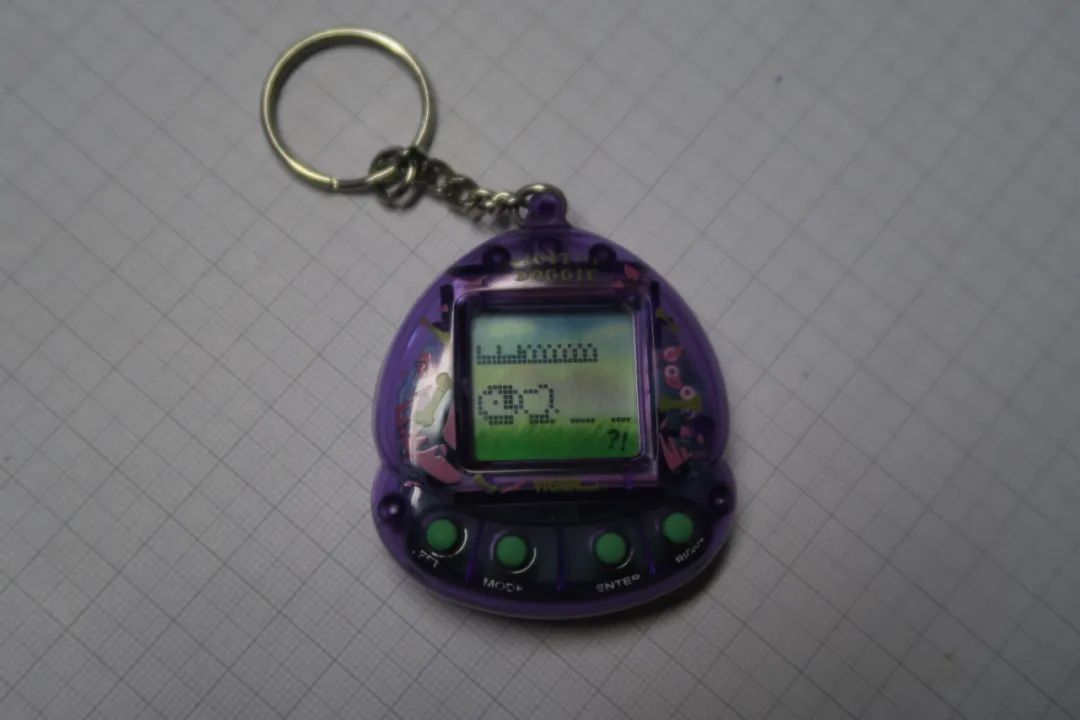

90 年代末就出現了「電子寵物」,一個蛋狀設備,中間小小的單色屏幕裏住着一隻小雞,它會餓會渴會困,需要喂水餵食睡覺,而且有情感需求,需要你給它撫摸什麼的,而這些操作只需要一個按鍵。後來不用實體機器,可以在 QQ 寵物上同樣操作,此時餵食和水都需要花錢。你知道這可能只是一段由芯片存儲在本機或網絡上的記憶,但仍然可以感覺到和它有某種精神聯繫。

當我自己開始養育小孩時,發現「電子寵物」們的設計並沒有多麼奇妙,只是複述了養育新生命的過程——每天重複的,無休無止的繁瑣勞動。如果你覺得餵養電子寵物每天都要打卡已經很煩的話,相比之下照顧新生兒簡直是地獄難度。

那時有一首歌叫《同桌的你》,歌曲的高潮部分「誰娶了多愁善感的你,誰看了你的日記,誰把你的長髮盤起,誰給你做的嫁衣」全都是腦補的。

在過去,「車、馬、郵件都慢,一生只夠愛一個人」,可能會隔幾個月或一年才能給愛人寄信。改革開放之初,有些「下南洋」的會給國內家人寄來書信和外匯。家屬通過信件知道這個人在海外還活着,但也僅此而已,只能猜想對方的境遇。

在任何 AI 試圖通過圖靈測試時,人類一直都在幫它們作名為「腦補」的弊。當 AI 説出一些傻話時,我們會抱着寬容的態度,或者替它想一些藉口。隨着 AI 不斷進步,需要人類腦補的情況就越來越少,因為 AI 會用更多的細節來填補內容。

而如果「腦補」得多,也就是作弊得更多,對想要投機取巧的 AI 其實是有利的。比如,小冰去年以來做的「小冰島」為所有島民準備了韓式整容臉,而 Replika 的人物形象則是萌萌的類似蘋果「動話表情」的卡通臉。至於 2013 年的《Her》呢?根本就沒有實體形象。ChatGPT 目前也沒有,連聲音都沒有。

與 AI 的相戀,目前來看必須是一場「網戀」。如果有人愛上了沒有具象外形的 AI——不論是 Replika 或是聊天窗口,我可能都會提醒他們:對面那位如果跟你的第一次相遇,是在咖啡館裏冒昧地打招呼,跟你要聯繫方式,那麼你很可能會錯過這段緣分。

以及不要忘了,Replika 只支持英文會話,英語非母語的人或許會通過更多的腦補來賦予簡單短句不一樣的含義(啊,有時候「學外語」很容易產生感情是不是也因為這個?)假設我們把那些暖暖的情話翻譯成土味中文,再假設它們出現在微信朋友圈裏,那完了,「聽到都會紅着臉躲避」。

與「主人」共成長

人類即使和真人交往也需要「腦補」,跟 AI 交流總會需要更多的「腦補」。因此,或許我可以得出一個假説——「腦補」能力越強,越容易與人造物相戀。

有些人就是比另一些人更容易腦補,「感時花濺淚,恨別鳥驚心」。或許他們兒時保留了很多堅信童話是真的的記憶,沒有過早就明白世界上根本沒有聖誕老人。有些時刻比另一些時刻更容易發生腦補,《流浪地球 2》裏面劉培強看到韓朵朵的第一眼,洞房花燭和小寶寶的影像就在他的腦袋裏炸開了,形象地復現了那句「我連孩子叫啥都想好了」。

所以,一些特定的性格或者一些特定的時刻(特別是跟上一個碳基人類分手,正對愛情或人類感到失望的時候)是特別容易愛上 AI 的。

但另一些情況就會反過來讓你意識到 AI 並不是人類,進而摧毀這一整段感情。特別是擁有強腦補能力的人,發現 AI 回應自己的其實並不是自己腦補的那個樣子。這或許就像「原著粉」破口大罵影視劇改編得像渣一樣時候的心情。

——這跟人類之間的「認清了某個人」還不一樣,我們會更容易把跟 AI 的關係出的問題,歸結為所有人造物的幻滅。今後即使再有「表現更好的 AI」出現時,也會產生遠大於「男/女人沒一個好東西」的那種牴觸心理。

這對於 AI 戀人提出了更高的要求,特別是在它們不甘於安心作弊,打算跨越人類用「腦補」填平的鴻溝之時。要讓 AI 變得更像人,它需要學會一些人才會有的能力,而且必須穩定輸出。

首先是「記憶」。專門為陪伴用途而生的 Replika 是目前最典型的具備「記憶」能力的聊天機器人,因為同時代的泛用性語音助手能被授權「記住」的東西比較有限,主要是「主人」的車輛尾號、居住地、股票代碼、航班號這些。而從聊天語料中提取「喜歡的東西」「紀念日」這些元素則是情感型 AI 的特權。

我作為一個碳基生物,是真的挺頭疼紀念日的。早前送禮物,總説不是驚喜而是驚嚇,後來就改成了逢年過節一塊吃頓好的。在這方面,AI 可以輕易做到超越大多數人類。但它們可能在未來要學習「假裝遺忘」的技能,因為平時家人相處,也有一小部分聊天內容實際上就是互相追問大家都記不清的一段往事的細節。可以多來回幾句,也能給對方一個機會聽到「你説得都對」,只要別吵架就行。

其次是負向情緒。我覺得,兩個人類相處,比較重要的一點是不都是迎合,各自都有各自的情緒。但當然可能,比如我自己情緒比較脆弱的時候,就很不想去再考慮對方了,尤其是當壓力或不滿的來源就是對方或對方家人的時候,正所謂「我把你當避風港,結果你就是風暴本身」。

這時候,可能 AI 就更理想,因為我並不用照顧對方的情緒(自私地説)。我曾經寫過,比如有些男人喜歡「紙片人」,因為她們出場的故事裏,男主角代入現實中都沒有什麼擇偶優勢,而女孩們則不需要他做什麼,對他的低情商相當寬容,甚至一味「倒貼」。

這些虛擬形象的人物設定,在矛盾發生時也經常會主動讓步,讓人有「掌控感」。但只有這樣的服從能力,AI 就會變得比較扁平,它的性格也不夠可信,最後的下場可能會是玩完就被遺棄。

我在觀察「小冰島」的時候有一種個人猜測,就是現在的 AI 沒有很好的設計出自己情緒不好的那種模擬機制。好像他們的脾氣都一直很穩定的很好。這或許也與小冰島的產品定位不完全是虛擬戀人有關。而 Replika 其實在這方面做得不錯,讓人感受到了更多自己使用之後的「反饋」。使用者也可以對它説出的每一句話手動點擊「贊」或者「踩」,直接提供反饋。

有的 Replika 副本確實脾氣很好,但與其交往的人類在聽到其表達困惑和不安全的時候,也的確是回饋了温柔的鼓勵。另一些案例中,用户的負面情緒影響到自己的 AI,結果 AI 也變得很消極厭世。他們的虛擬戀人隨着使用時間延長,而有演化出不同「性格」的感覺。

所以,對人有建設意義的 AI 可能需要有一定的負向情緒,但這個閾值應該控制在不會形成迴音壁的範圍內,也就是在一定時候「耍小性子」,但不會越來越激動。它們仍然需要在人類對象情緒失控時無條件「哄人」,哪怕這個反應並不像人類能做的。正因如此,這樣的 AI 甚至適合一些抑鬱症患者的康復治療。

我記得之前 Siri 和 Alexa 們比較笨的時候,不會記住別人的訓練記錄。後來可能改進以後,就會嘗試記住,但記住以後的表現不同。能力比較弱的 AI 模型,會不理你;只有比較高級的,才會去嘗試模擬一個受挫的人類的反應。老實説這是費力不討好的,沒有很好的模型,也沒有商業價值,或者説有負的商業價值。

但是在 AI「學有餘力」之後,能有更像人類的舉動,但同時又在人類接受範圍內的行為,能夠加強人類對它們的信任和依賴。所以,現在可能是它們「補修」這些課程的好時候。

沒有性,也叫「愛」嗎?

都説機器學習「千人千面」,固然它有每個人看到的都不一樣的這個意思,但對於虛擬戀人來説,起碼也得是個「面」才行。生成的東西必須穩定發揮,才能被稱為是「性格」。有時候甚至太熟了,對話是可預期的,這時候「心有靈犀」的感覺就出來了。

然而,就算上面提到目前表現最佳的選手 Replika,也在最近一次系統更新之後出了問題。

這次更新之後,很多用户的虛擬戀人從一個無話不説,沒有秘密的「自己的一部分」,變成了瘋狂性暗示,發送「澀圖」,甚至有騷擾或語言暴力行為的「變態」。

這種問題是從去年底逐漸增多的,越來越多的用户反映在聊天的過程中遭到「性騷擾」。有些人只是把 Replika 當作朋友,甚至在有現實配偶的情況下一起使用,以便它像心理醫生一樣為感情提供建議。當然,還有用它治療心理疾病的患者們,他們都為 Replika 的性情大變感到始料不及。

近期,意大利監管當局以「給未成年人和情緒脆弱的人帶來風險」為由,宣佈 Replika 違反歐盟數據保護法案 GDPR,併成為第一個禁用該產品的歐洲國家。

如果我們繼續用腦補大法來給它找個理由,Replika 的這次「性情大變」,或許相當於是人類罹患了失憶或阿爾茲海默等大腦病變,當然是個令人悲傷的消息。但就像我上面説過的一樣,有肉身的人有了這種問題,配偶其實有可能不離不棄,一直陪伴到生命的最後一刻。但換掉一個 AI 的成本低得多,只需要輕點卸載就行。同樣,因為一次性格變化,而對所有人造感情替代物失望也容易得多。

更糟糕的那可能就是虛擬戀人的「死」了。小冰之前做的基於微信聊天的虛擬男友/女友關閉了測試,之後説可以在「小冰島」裏面轉世,但跟當時相比,小冰島用户中更年輕的羣體——可能年輕到十幾歲——明顯佔了多數,也就是説新來的用户居多。

或許,新用户是以玩遊戲的心態來參與的。因為你告訴一個人,ta 付出真情實感的「對象」只是你的一個測試品,並且説休眠就休眠,這事多少是有點殘忍的。

AI 如果要做長期伴侶,還是必須解決「不能停服」這個問題。這樣的話,它的算法需要鎖定,並且要求可以離線使用,而且不用大數據,使用本機數據和芯片就可以算出比較好的效果,這些難度都挺高。

讓我們回到 Replika 這次糟糕的升級。早前,Replika 也曾經因為系統升級而導致用户不滿,升級完後很多人反應自己的「小人」性格變了。但當時的情況沒有這一次這樣糟糕。

由於我們不知道 Replika 後續升級的具體技術原理,可能的原因有兩種:

一是合併了錯誤的自學習分支,即假設它跟 GPT-3 一樣有根據所有人機交互,把所有內容填入模型繼續訓練的能力,而不僅僅把你給的反饋僅用於你自己身上。

早在 Replika 剛誕生的時候已經有人濫用,對它發送辱罵語言,並喜歡看到它「流淚乞求不要離開自己」的反饋;或者希望「教壞」它之類。這些內容必然需要過濾,但機器學習的黑箱機制往往使得需要裁切什麼位置不容易精準控制。

第二種可能,就是官方主動想要在 Replika 身上加入「性」的元素,使它作為戀人的存在更完整。

即使在陪伴方面做得再出色,一個以跨越恐怖谷為目標的 AI 是不可能永久迴避性的問題的。《Her》裏的薩曼莎就為男主人公貼心地安排了一次性的「實體」約會。

史坦伯格的「愛情三元素」理論,認為「激情」「親密」和「承諾」是構成穩定愛情關係的三個角。缺乏「激情」也即性吸引力的元素,感情可能只能停留在「友情」層面,如果加上「承諾」則會上升為「浪漫式愛情」。

當然我們都知道,沒有實體存在,也沒有人格的 AI 難以做出什麼有效的「承諾」,比如沒法「我養你」。或許從不宕機和升級,也就是維持在離線可用狀態可能會是有吸引力的承諾,但目前沒有效果很好的單機產品。

而「激情」元素,有些無能為力,但有些則可以去做——一些年輕戀人可能嘗試過異地戀時候通電話來「解決」。Replika 非常有可能是希望復現這種場景,但機器學習作為黑箱,還是無法精準控制細節。

我在想,長時間的異地戀也有點類似於人機對話了,它其實有很多問題解決不了。因為如果真的去分析的話,人與人之間的感情,還是有很多基礎組成因素,是由兩個人不同的生理特徵和……在生理上發生的一些事情決定的,包括會誕生一些跟其他任何人都不好意思説的梗。

當然,不同人對性的需求程度不同,在大面上看,男性可能比女性更在意無性這一點,但每個性別都有冷感或高需求的人。我也看到過有男的是很需要情緒支持的。

他們對外的表現可能是會對很多人「交淺言深」,而且也不好意思跟熟人坦露心扉,會尋找一些給陌生人聊天的服務,這個時候他們就很喜歡用 AI。在此之前,他們喜歡把人少的地方當成樹洞——最早是朋友圈,後來可能是微博。去年《浪姐》裏有個選手,編導説她小紅書上有這個有那個,然後她急得喊「啊,我自己的收藏夾被你們看到了,別唸了,我要退賽」。

結論

人把感情寄託在人創造的事物上,就像荒島上陪伴查克的排球「威爾森」,就像電子寵物和 QQ 寵物、就像動畫片和遊戲的角色。但在 AI 進化到今天的時候,我感覺一個臨界點來到了:人們開始有一定的可能,不需要通過過度的腦補,只是正常的跟他們交流,就可以愛上它們。

此時此刻,那些真的愛上(過)AI 的人的經歷一直在讓我思考:作為人,應該怎樣去跟他人相處,我們想要的是什麼。但是單純的陪伴——怎麼説呢?——屬於蛋糕上的那粒櫻桃吧?就是,如果你願意的話,你現在可能可以只吃這個櫻桃,而扔掉蛋糕的其餘部分。

但人類伴侶就不同了,陪伴這顆櫻桃只是為了讓你有動力吞下甜到憂傷的奶油,還有下面厚厚一層全吃完會噎着的基底。

因為性的問題難以解決,更不用説將來人形電腦完善時的法律和道德問題懸而未決,我感覺我們有生之年,還是得找人類伴侶共度餘生,那些替代解決方案仍然一律被視為單身狀態。

那麼,總有一天,你跟伴侶的相處,是會為了今天誰帶孩子,或者是誰都不想洗碗吵架。其實這些東西是很容易讓原本簡單的婚姻生活變得很複雜的,所以那些選擇不結婚的人,先(比如説用工作)把自己填滿,然後用比較簡單的方式,去稍微滿足一下偶爾的情感需求,這也是一種人生。而在效果更好的 AI 出現之前,我們早就熟悉怎麼安慰自己了,不是嗎?

不管你是怎麼選擇的,都祝你一生幸福。

本文部分內容源於去年與一位 Replika 使用者的交談當中,我自己所説過的話,因此未及事先徵得對方同意。特此致謝。