英偉達狂飆,今年市值大漲65%_風聞

半导体行业观察-半导体行业观察官方账号-专注观察全球半导体最新资讯、技术前沿、发展趋势。02-24 15:37

據路透社報道,隨着人工智能熱潮的興起,英偉達有望成為芯片製造商中最大的贏家——儘管不是唯一的贏家。

人工智能已成為科技行業投資的亮點,該行業增長放緩導致大規模裁員和實驗性投資減少。

但興趣激增幫助 Nvidia 週三公佈了好於預期的季度收益,並預測銷售額高於華爾街預期,這與競爭對手英特爾公司預計虧損和削減股息形成鮮明對比。

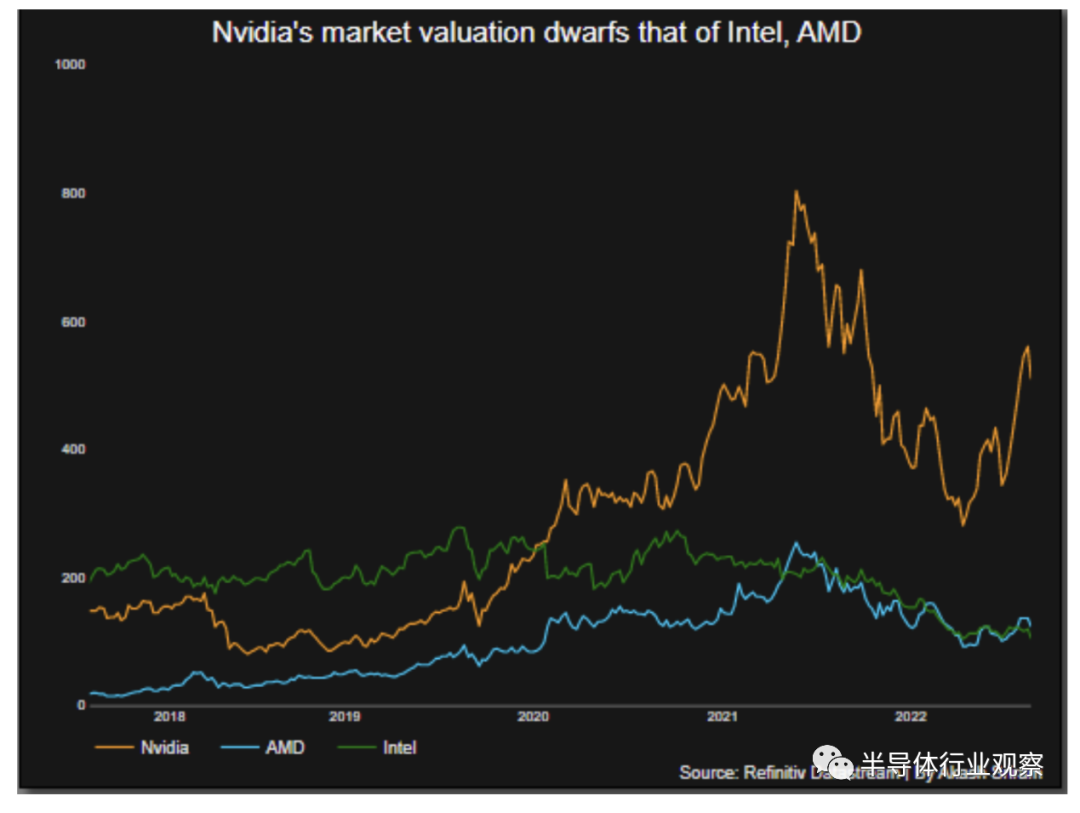

Nvidia 股價週四上漲近 14% 至 236.70 美元。自今年年初以來,它們的漲幅已超過 65%,幾乎是費城半導體指數漲幅的三倍。該公司通過幫助視頻遊戲看起來更逼真,開始了 PC 的圖形芯片業務,然後隨着其芯片用於採礦而乘着加密貨幣浪潮。現在,下一個推動力來自生成式 AI。

GPU市場的王者

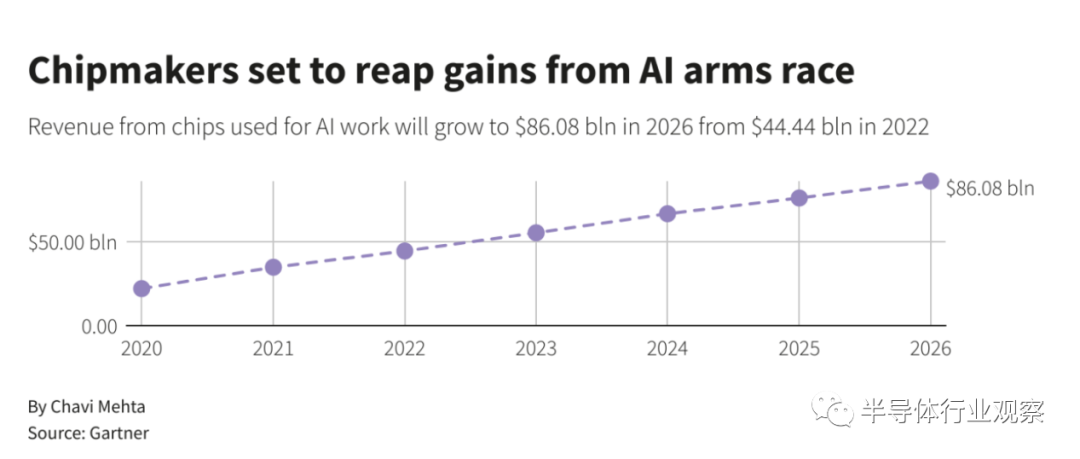

圖形處理單元旨在非常高效地處理人工智能計算中涉及的特定類型的數學,而英特爾的通用中央處理器 (CPU) 可以以較低的效率處理更廣泛的計算任務。但人工智能正在接管科技行業,據研究公司 Gartner 稱,到 2026 年,數據中心使用的 GPU 等專用芯片的份額預計將從 2020 年的不到 3% 上升到 15% 以上。

AMD是 GPU 行業的第二大玩家,其股價在週三 Nvidia 財報公佈後也有所上漲,市場份額約為 20%。

“在硬件和處理方面引領 AI 革命的兩家公司是 Nvidia 和 AMD,在我們看來,這兩家公司遙遙領先於其他公司,”Piper Sandler 分析師 Harsh Kumar 説。

Lisa Su 領導的 AMD 近年來在 AI 方面進行了大量投資,包括一系列旨在與 Nvidia 最快的產品競爭的芯片。作為對比,英特爾佔有不到 1% 的份額。

英偉達在 AI 行業的實力也引起了風險投資家和初創公司的關注,他們正在投資數十億美元,並承諾進行諸如降低電力消耗等改進。但到目前為止,它們都沒有對 Nvidia 的業務造成重大影響。

所有這一切對英特爾來説都是壞消息,英特爾在數據中心和個人電腦行業的 CPU 市場份額也正在被 AMD 奪走,而 AMD 曾一度佔據主導地位。該公司現在面臨失去該行業下一個增長點的風險。近幾個月來,它努力加強對 GPU 的關注,包括在 12 月將其圖形芯片部門一分為二:一個專注於個人電腦,另一個專注於數據中心和人工智能。

不過,分析人士表示,在英特爾在市場上佔有一席之地之前,該公司還有很長的路要走。

Wedbush Securities 分析師 Matthew Bryson 表示:“英特爾有更多的設計試圖滲透(AI)市場,但迄今為止,儘管其解決方案過多,但它的牽引力令人失望。”

ChatGPT 助力英偉達狂飆

華爾街日報在最近的報道中指出,芯片製造商熱衷於科技領域的最新熱點:人工智能工具可以在最少提示的情況下生成文本,但這需要強大的計算能力才能運行,並有望給相關供應商帶來豐厚的新收入來源。

分析師估計,對於半導體製造商而言,新工具如果得到廣泛採用,可能會帶來數百億美元的年淨銷售額。

自去年年底發佈總部位於舊金山的 OpenAI 聊天機器人ChatGPT以來,市場對所謂的生成式 AI 的興奮已經達到了狂熱的程度。該技術通過產生令人信服的真實反應(有時甚至是不準確的反應)吸引了用户,幫助它從微軟公司吸引了數十億美元。

NVDA英偉達公司首席執行官黃仁勳甚至表示,該技術已達到拐點。“生成式 AI 的多功能性和能力引發了全球企業開發和部署 AI 戰略的緊迫感,”他在公司週三公佈季度收益並公佈了一項新的雲計算計劃以利用商業機會時表示。

他説,對此類人工智能工具的興趣正在促使公司重新調整他們的業務預期。“毫無疑問,由於過去 60 天、90 天,我們對今年的看法在進入新一年時已經發生了相當大的變化。”

隨着個人電腦、智能手機和其他電子產品銷售疲軟,芯片行業正在努力應對半導體行業的急劇下滑,令人興奮之際。由於對經濟衰退的擔憂導致消費者和企業縮減支出,大多數芯片製造商都報告稱銷售放緩。

Nvidia 是無可爭議的 AI 芯片市場領導者,在數據中心的單調世界中,ChatGPT 等工具進行計算並輸出結果。據 Omdia 估計,截至 2020 年,它在此類 AI 處理器中的份額約為 80%。

不過,有這麼多資金可供爭奪,其他芯片製造商也想加入其中。

英特爾公司首席執行官帕特基辛格週三表示,他的公司擁有一套廣泛的芯片來應對生成人工智能的機會,包括面向人工智能計算的專業芯片、數據中心的圖形芯片和新一代數據中心中央處理器——計算機的數字大腦——他説這在人工智能工作中表現良好。

“隨着人工智能融入未來的每一個應用程序,我們期望的性能將成為計算的主流,”他説。

AMD為 AI 量身定製 CPU、圖形芯片和其他硬件,同時押注運行該技術所必需的許多計算的大型雲計算公司將大力投資芯片。AMD 首席執行官Lisa Su上個月底表示 ,這項業務明年應該會開始變得更有意義。

美國銀行分析師 Vivek Arya 表示,到 2027 年,生成式人工智能每年可為整個人工智能芯片市場增加 200 億美元。他説,Nvidia 應該能夠保持至少 65% 的人工智能芯片市場份額。

互聯網搜索巨頭谷歌是Alphabet Inc.的子公司,本月展示了其稱為 Bard 的ChatGPT 本土競爭對手。中國的百度公司正在開發一種名為 Ernie Bot 的類似於 ChatGPT 的人工智能聊天機器人,它計劃在下個月推出。微軟已經在其 Bing 搜索引擎結果中為用户提供了有限的 ChatGPT 體驗。

至少在短期內,Nvidia 在 AI 領域的主導地位可能是它獲利的最佳位置。該公司通過允許軟件開發人員利用其圖形芯片的特性獲得了領先地位,這些芯片從大約 15 年前開始就被證明擅長 AI。瑞銀分析師在一份報告中表示,現在,該公司的芯片是唯一可用於創建大規模 AI 語言系統的可行產品,並補充説,他們估計 ChatGPT 需要大約 10,000 個該公司的圖形芯片來訓練。

黃仁勳在財報説明會上建議該公司下個月可能會更新其潛在市場規模的前景,大約一年前,黃預測其從提供視頻遊戲芯片到汽車的業務將達到 1 萬億美元。

“由於生成式人工智能令人難以置信的能力和多功能性,以及去年年中和年底發生的所有融合突破,我們可能會遲早達到那個[市場規模],”他説。“毫無疑問,這對計算機行業來説是一個非常重要的時刻。”

Nvidia 正試圖通過開始為企業提供雲計算服務來更快地實現這一目標,以使用其硬件和軟件開發生成式 AI 聊天機器人和其他工具。該服務將通過成熟的雲計算公司提供,旨在降低人工智能在商業中的應用普及的門檻。

Nvidia 表示,它正在與所有主要的雲計算提供商(包括亞馬遜、微軟和谷歌)就生成人工智能工具以及消費者互聯網公司和初創公司展開合作。

上萬美金的A100是新武器

在CNBC看來,在當前火熱的AI芯片市場,售價上萬美金的Nvidia A100已經成為了該市場的新武器。

A100 目前已成為人工智能專業人士的“主力”,投資者Nathan Benaich 説。他發佈了一份涵蓋人工智能行業的時事通訊和報告,其中包括使用 A100 的超級計算機的部分清單。根據 New Street Research 的數據,Nvidia 佔據了可用於機器學習的圖形處理器市場的95%份額。

在他看來,A100 非常適合支持ChatGPT、Bing AI或Stable Diffusion等工具的機器學習模型。它能夠同時執行許多簡單的計算,這對於訓練和使用神經網絡模型很重要。

A100 背後的技術最初用於在遊戲中渲染複雜的 3D 圖形。它通常被稱為圖形處理器或 GPU,但如今 Nvidia 的 A100 配置和目標是機器學習任務,並在數據中心運行,而不是在發光的遊戲 PC 中運行。

開發聊天機器人和圖像生成器等軟件的大公司或初創公司需要數百或數千個 Nvidia 芯片,並且要麼自行購買,要麼從雲提供商處安全訪問計算機。

例如在開發當前火熱的ChatGPT所需的大型語音模型,就需要數百個 GPU來訓練。這些芯片需要足夠強大以快速處理數 TB 的數據以識別模式。之後,還需要像 A100 這樣的 GPU 來進行“推理”,或者使用模型生成文本、進行預測或識別照片中的對象。

這意味着 AI 公司需要獲得大量 A100,該領域的一些企業家甚至將他們獲得的 A100 數量視為進步的標誌。

“一年前我們有 32 塊A100,”Stability AI 首席執行官 Emad Mostaque在一月份的推特上寫道。“Dream big and stack moar GPUs kids. Brrr.” 他繼續寫道。Stability AI 是幫助開發 Stable Diffusion 的公司,Stable Diffusion 是去年秋天引起關注的圖像生成器,據報道其估值超過10 億美元。

根據 State of AI 報告的一項估計,Stability AI 現在可以使用超過 5,400 個A100 GPU ,該報告繪製並跟蹤了哪些公司和大學擁有最多的 A100 GPU——儘管它不包括雲提供商,它們不公開公佈他們的數字。

Nvidia 首席執行官黃仁勳週三在與分析師的電話會議上不停地談論人工智能,暗示最近人工智能的繁榮是公司戰略的核心。

黃説:“過去 60 天,圍繞我們構建的 AI 基礎設施的活動,以及使用 Hopper 和 Ampere 影響大型語言模型的推理活動剛剛爆發。” “毫無疑問,無論我們對今年的看法如何,因為過去 60 天、90 天,在我們進入這一年之際,都發生了相當大的變化。”

“雲服務”帶來的新可能

與其他類型的軟件(如網頁服務)相比,它偶爾會以微秒為單位突發性地使用處理能力,而機器學習任務可能會佔用整個計算機的處理能力,有時長達數小時或數天。

這意味着發現自己擁有熱門 AI 產品的公司通常需要購買更多 GPU 來處理高峯期或改進他們的模型。這些 GPU 並不便宜。除了可以插入現有服務器的卡上的單個 A100 之外,許多數據中心還使用一個包含八個 A100 GPU 協同工作的系統。

這個來自Nvidia的,名為DGX A100的建議售價接近 200,000 美元,但它配備了所需的芯片。週三,Nvidia 表示將直接出售對 DGX 系統的雲訪問,這可能會降低修補匠和研究人員的入門成本。

很容易看出 A100 的成本是如何增加的。

例如,New Street Research 的一項估計發現,Bing 搜索中基於 OpenAI 的 ChatGPT 模型可能需要 8 個 GPU 才能在不到一秒的時間內響應問題。按照這個速度,微軟將需要超過 20,000 台 8-GPU 服務器才能將 Bing 中的模型部署給每個人,這表明微軟的功能可能需要 40 億美元的基礎設施支出。

“如果你來自微軟,並且你想擴展它,以 Bing 的規模,那可能是 40 億美元。如果你想擴展到谷歌的規模,每天服務 8 或 90 億次查詢,你實際上需要在 DGX 上花費 800 億美元。” New Street Research 的技術分析師 Antoine Chkaiban 説。“我們得出的數字是巨大的。但它們只是反映了這樣一個事實,即每個使用如此大型語言模型的用户在使用它時都需要一台大型超級計算機。”

根據 Stability AI 在線發佈的信息,最新版本的圖像生成器 Stable Diffusion 在256 個 A100 GPU或 32 台機器上進行了訓練,每台機器有 8 個 A100,總計 200,000 個計算小時。

Stability AI 首席執行官莫斯塔克在 Twitter 上表示,以市場價格計算,僅訓練模型就花費了 60 萬美元,他在推特交流中暗示,與競爭對手相比,這個價格異常便宜。這還不包括“推理”或部署模型的成本。

Nvidia 首席執行官黃仁勳在接受 CNBC 的 Katie Tarasov 採訪時表示,就這些模型所需的計算量而言,該公司的產品實際上並不昂貴。

“我們將原本價值 10 億美元的運行 CPU 的數據中心縮小為 1 億美元的數據中心,”Huang 説。“現在,1 億美元,當你把它放在雲端並由 100 家公司共享時,幾乎什麼都不是。”

Huang 表示,Nvidia 的 GPU 允許初創公司以比使用傳統計算機處理器低得多的成本訓練模型。“現在你可以用大約 10 到 2000 萬美元構建類似大型語言模型的東西,比如 GPT,”Huang 説。“這真的非常實惠。”他補充説。

也許,在談到這個英偉達“雲服務”的時候,很多人會把他看作類似AWS、AZURE和谷歌這樣的公有云競爭者。但按照nextplatform的説法,英偉達只是將其自己的 DGX 系統真正地放入大雲中,這樣客户就可以在雲上使用與他們可以安裝在自己的數據中心中的完全相同的服務。

“這類似於VMware在 2016 年秋季放棄雲,與亞馬遜合作構建 VMware Cloud on AWS的嘗試”,nextplatform説。

但無論如何,在其他競爭對手還在掙扎的時候,英偉達似乎已經正式復甦並邁入了新時代。