百度的文心一言是鸚鵡學舌還是烏鴉能力,是決定它是否能比肩GPT3的關鍵_風聞

Lawrenceglow-七字符03-15 20:19

【本文來自《剛剛,ChatGPT-4發佈,全方位碾壓老版本,甚至能看懂網梗表情包為什麼好笑》評論區,標題為小編添加】

- Starchaser

- 就看明天百度的文心一言了。

都不好説文心一言能不能超過GPT3……

因為OpenAI 大語言模型發展中的關鍵技術突破— GPT3之後“湧現”出的“烏鴉”能力,

過往機器學習的範式——鸚鵡學舌

機器學習,包括深度學習,所遵循的範式是“data fitting”,即找到數據中的“對應關係”並應用。“尋找對應關係”這個能力,可以人臉識別,高效推薦廣告;下圍棋。

但是鸚鵡學舌式的AI,只能根據指令來達成一些目標,並不真的“懂”指令。

鸚鵡的設計師,是很難窮盡世界上所有的語言應用組合的。

因此“懂”這件事,是過往AI夢寐以求都想突破的瓶頸。

ChatGPT可能的新範式——烏鴉能力

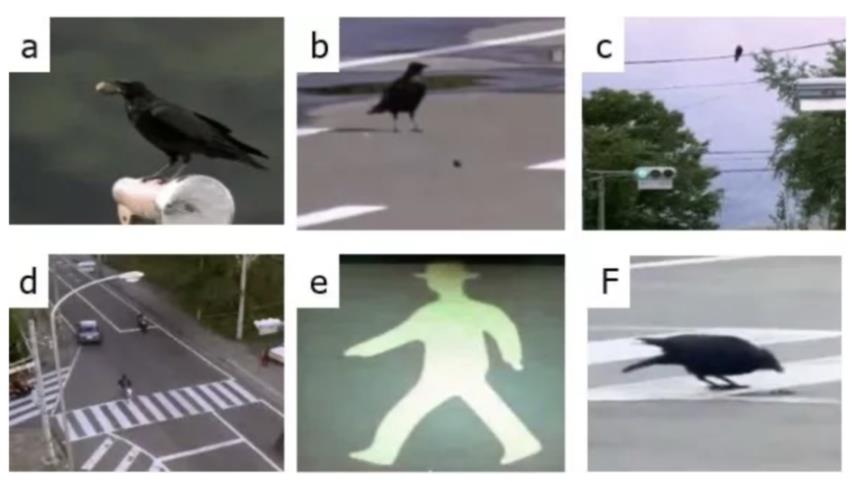

如圖a的一隻烏鴉是野生的,沒人管,沒人教。它必須靠自己的觀察、感知、認知、學習、推理、執行,完全自主生活。

首先,烏鴉無法砸碎堅果,但是它發現車軋果子可以做到(圖b),但是發現它到一個車水馬龍的路中間去吃是一件很危險的事。然後,它觀察到紅綠路燈會讓車子和人停下(圖c_)

它領悟出紅綠燈、斑馬線、行人指示燈、車子停、人流停這之間複雜的因果鏈。

搞清楚之後,烏鴉在斑馬線上方的一根電線,蹲下來了(圖d)。

它把堅果拋到斑馬線上,等車子軋過去,然後等到燈亮了(圖e)。它從容不迫地走過去,吃到了地上的果肉。

總結一下,烏鴉通過觀察,自主串通了:汽車能壓碎堅果——紅綠燈能控制汽車——車能撞死我這三件事情,從而利用紅綠燈和汽車,來幫自己達到“安全打開堅果”這一任務結果。

描繪最接近的詞彙可能是“inference”,是“基於證據和邏輯推演,得到結論”的過程

**ChatGPT看似擁有烏鴉能力的證據(**之所以説“看似”,是因為我們並不知道烏鴉為什麼會有inference的能力,我們也不完全知道LLM為什麼會有“達成inference效果”的能力。)

1、ChatGPT能“聽懂”錯在哪兒了,並向正確的方向修正。

2、描述越詳細清楚,ChatGPT回答得越好(要知道,越詳細的描述,在預訓練的文本里越難匹配到)

3、在詢問ChatGPT互聯網上並不存在內容的時候,能給出較好答案

4、ChatGPT能通過信息猜你心中的想法

5、你可以制定一個全新的遊戲規則讓ChatGPT和你玩,ChatGPT可以理解。

過往模型一定需要針對具體的問題進行具體設計,而且只要説的話稍稍不夠“結構化”,模型的表現就很難保證,更別提在模型資料庫裏,沒有出現過的問題了(想起了制杖音箱)。

而ChatGPT是一個“開竅”之後擁有“理解”能力的人。理解能力帶來了舉一反三的能力,邏輯推演的能力,“知錯”就改的能力。

提煉對比一下的話:

過往ML:需要“喂”,之後“模仿”,基於的是“對應關係”

ChatGPT:需要“教”,之後“懂”,基於的是“內在邏輯”

——而這次發佈的GPT-4會大幅提升ChatGPT的能力,效率提升很多,不確定“湧現哪些新能力”。

提問題的能力和判斷力也許是人類最重要的兩個能力。在AI自然語言處理紀元中**,**GPT4快做到了,

百度的文心一言是鸚鵡學舌還是烏鴉能力,是決定它是否能比肩GPT3的關鍵,然而OpenAI發佈了的GPT4幾乎可以肯定是領先它的。