“朋友在接ai繪畫的散活,有人想讓他用認識的女生出些圖,朋友拒絕了這一單”_風聞

国服最坑赵信-03-29 16:10

來源:微博@余車台Alex

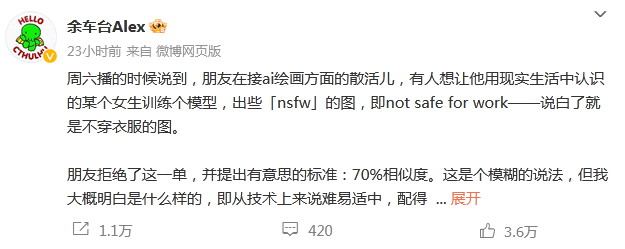

週六播的時候説到,朋友在接ai繪畫方面的散活兒,有人想讓他用現實生活中認識的某個女生訓練個模型,出些「nsfw」的圖,即not safe for work——説白了就是不穿衣服的圖。

朋友拒絕了這一單,並提出有意思的標準:70%相似度。這是個模糊的説法,但我大概明白是什麼樣的,即從技術上來説難易適中,配得上一兩百塊一單的價格;從倫理上説能清晰地識別出「不是同一人」,避免對現實中的女性造成傷害。其實70%的標準我也不敢輕易認可,畢竟想傷害一個人,連70%的相似度都用不着。哪怕只有三分像,都足夠爛人在他們的論壇和小羣裏來一場狂歡,足夠在一個社交圈裏掀起波動。

我們都清楚,那位不知是何居心的客户一定會找到願意為他訓練儘可能接近十成相似度模型的人。緊接着,這幾天朋友又收到了兩個差不多的委託。都要求拿他們認識的女生髮在社交媒體上的照片訓練,都希望能儘可能逼真(「能直接發朋友圈那種程度」),都承諾絕不會非法使用造成風險……我難以想象,此時此刻到底有多少爛人正拿着他們從普通女孩社交媒體存來的圖片,謀劃着惡毒的攻擊。

之前聽勞東燕教授《網絡暴力治理中的刑法立場》,深以為然。不能只指望受害者自己去維權、去告,她有這麼一句靈魂拷問:在座各位都是學法律的,但如果是你遭遇了網絡暴力,你覺得自己可以很好地解決這件事情嗎?公權力必須主動參與進來。當然我覺得指望公權力也不完全牢靠,我認為作為公民,大家全得趕緊參與進來,參與方式非常簡單——

從今天起,只要看到一張不穿衣服的照片在傳播,不管雙手多逼真、不管圖片細節多實在,就立刻大聲給圖片定性:是AI吧!不要跟我解釋什麼褶皺陰影、真實景深,只要圖上沒穿衣服,肯定是AI。我有一百種方式證明一張照片是AI生成的,但你無法證明「不是AI」,就像無法證明魔鬼「不存在」。誰要是傳播那張照片,那他要麼是該被送進去蹲着的壞胚,要麼是沒見識的白痴。

悖論是,願意用這種方式保衞她們生活的人,往往不會出現在那個論壇、那個小羣,我們不太可能最早看到圖片,於是無法阻斷初期的傳播,只能做一道大規模網絡暴力前的防火溝。不過我想,滅火的英雄本就不該是我們這些普通人吧?在看見危險時,選擇成為防火溝的一部分,便可以理直氣壯地為自己驕傲一天了。