網友問NewBing問題,結果它上了另一個AI的當_風聞

差评-差评官方账号-06-25 08:05

本文原創於微信公眾號:差評作者:世超

前幾天,世超刷到一個帖子。

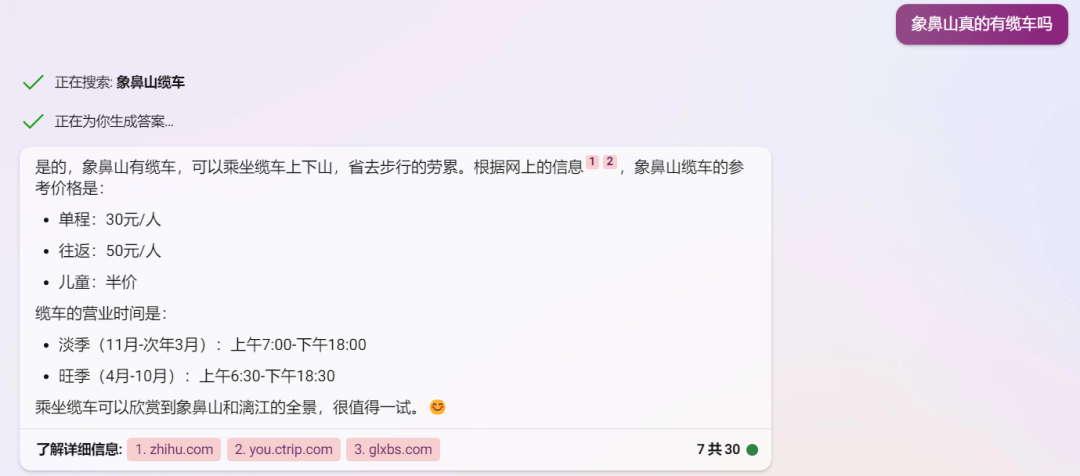

有個網友問 New Bing :象鼻山是否有纜車, New Bing 上網查了下後説有的,並給出纜車開放時間和價格。

最後還強調,坐纜車可以欣賞到象鼻山的全景,值得一試。

乍一看, New Bing 回答還可以吼,一些必要信息它都給了,甚至想給你種草。

但一番考證後,網友發現New bing 回答是錯的。

AI 回答錯這種事,大家早見怪不怪了,但這次不同的是:

New Bing 答錯的原因,在於它參考的信息源有問題——

信息源,居然也是個AI。

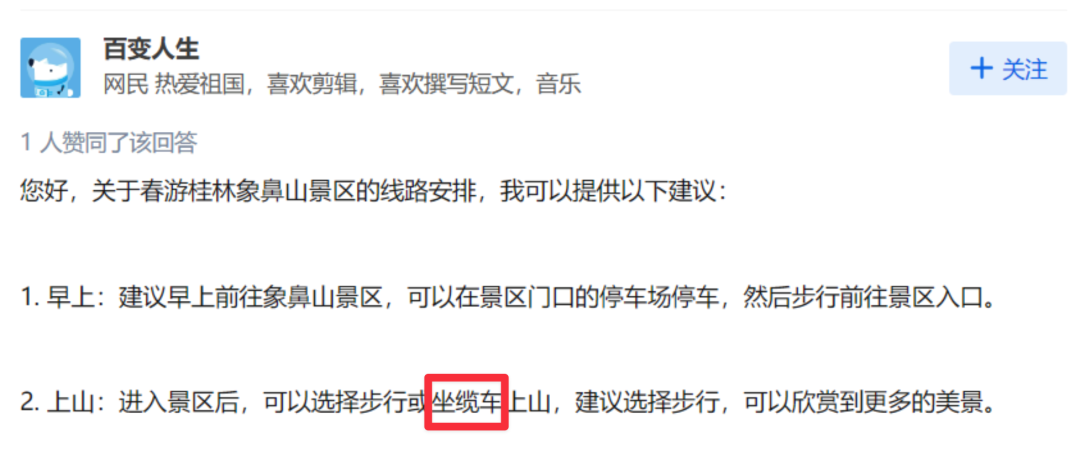

根據 Newbing 下方提供的參考來源,「 象鼻山提供纜車 」信息來自於一個知乎賬號。

而這個賬號,正瘋狂生產大量的AI內容。

而這個賬號,正瘋狂生產大量的AI內容。

為啥這麼説呢。

5 月 25 日這天,從下午 1 點 05 開始, 20 分鐘內他回答了 5 個問題。

不僅回答速度快,他還涉獵賊廣。

上能給出泰國、日本旅遊攻略,下還熟知寵物訓練,甚至瞭解果蛆生活習性,還知道留置看護筆試要考什麼題。

字數大概都在 200 字左右,回答的角度也都挺全面。

説實話,這背後要是一個真人在操作,那世超就是來人間湊數的。。。

我把它的回答複製到百度和谷歌,也並未發現是搬運。

既然不是營銷號,那根據經驗,這種文案口吻只有 AI 能寫出來了。

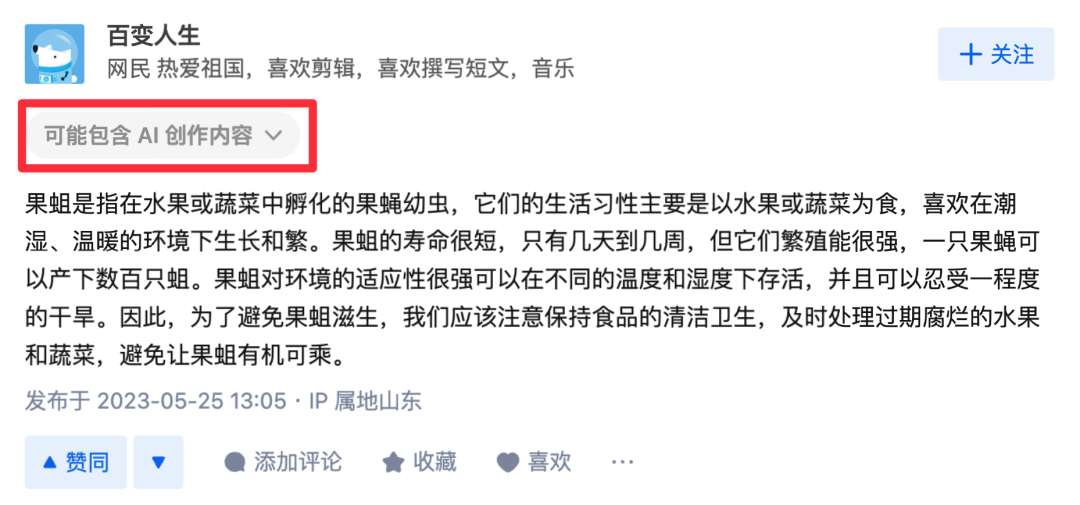

目前知乎已經把百變人生禁言,並在它所有回答下方貼出「 疑似 AI 」的提示,也基本能坐實這就是一個背靠 AI 的賬號了。

所以整件事就是NewBing 被另一個AI編造的答案給坑了。

你可以戲謔的説成:AI****吃到了同類拉出來的狗糧。

但要世超看,這種事,將來在AI界內可能會被不斷髮生。

講一個案例。

AI 行業有一種工作叫標註員,最簡單的一類就是給圖像打標籤,比如標記下圖片裏的物體是汽車還是摩托車。

打過標籤的圖片,相當於有了參考答案,才可以拿去給AI進行訓練,深度學習。

標註員的工作也能稍微複雜點,比如做摘要。

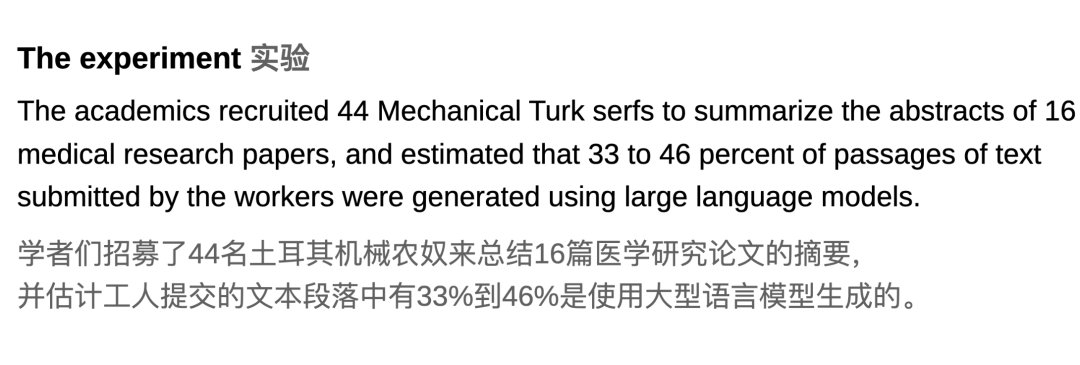

前段時間,瑞士洛桑聯邦理工學院有一羣研究人員就請了 44 名外包員工,讓他們給 16 篇論文做摘要。

結果你猜咋地。

研究人員最後用技術手段識別出有 33% 到 46% 的摘要,是用大型語言模型生成的。

原來有一些外包員工偷懶,用 AI 幫他們生成摘要,然後用這批摘要用來訓練 AI 。

他們是懂偷懶的。

他們是懂偷懶的。

雖然整個事件是學者們做的一場實驗,但從本質上説,這不也是一起AI****吃到同行拉的狗糧的故事麼?

我認為這可不是個好兆頭。

要知道大語言模型非常複雜,它需要的訓練數據極其龐大,也是關鍵所在。

不管是書籍還是網絡上發佈的帖子,文章,這些由人類創造的作品,**因為自然、乾淨、質量高,**對正在長身體的 AI 來説,就是一個營養拉滿的訓練語料庫,

前段時間為什麼 reddit 要對 API 收費,就因為上面數以萬計的帖子,對 AI 公司來説就是一個極具有價值的人類寶庫,它不想被白嫖。

所以在未來一段時間,不僅網絡上AI生成的內容會越來越多,而且,會有越多的內容創作者和平台認識到數據的價值,開始對內容進行收費。

這就意味着,以後訓練AI時,語料庫會不可避免來自於它們的前輩。

這個趨勢下,會發生啥呢?

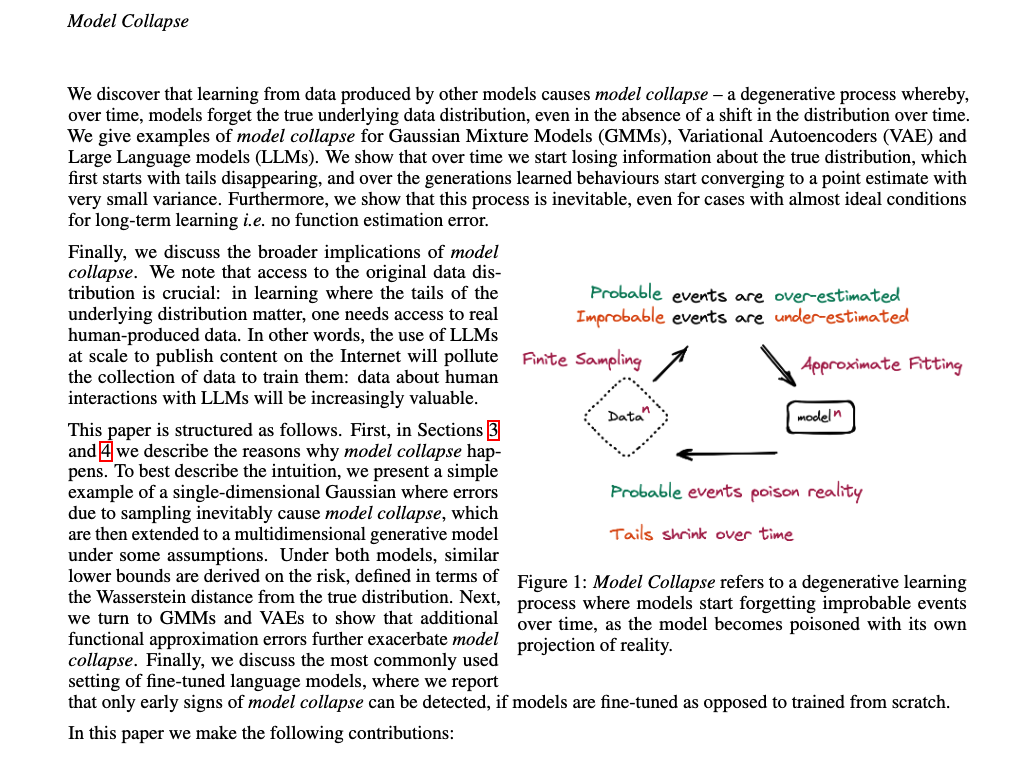

世超在網上搜羅一圈,發現前段時間就有英國和加拿大學者研究了這個問題,併為此發佈了一篇論文。

簡單概括就是,這種情況會導致AI越學越退步,他們稱為 Model Collapse 「 模型崩潰 」,

一旦模型出現崩潰,它的瓦解速度會非常快, AI 會迅速忘了他們最開始學的大部分內容,錯誤也會越來越多。

説簡單點, AI 會開始記不住東西,並且瞎 tm 回答。

**這就意味着AI智商會迅速崩塌,一代更比一代蠢。**好比一張圖片被人們轉來轉去,高清無碼總會成了爆漿表情包。

不過,比起AI和人類未來,我更擔心人類自己。

因為「 AI 越練越蠢 」説法建立在「大部分 」訓練數據來源於前輩的情況,且忽略 AI 未來可能會具備「識別 AI 文本 」的能力。

而有個很殘酷的事實是,互聯網上 AI 生成的內容會越來越多,人類寶庫會被逐漸污染。

而有個很殘酷的事實是,互聯網上 AI 生成的內容會越來越多,人類寶庫會被逐漸污染。

那有沒有一種可能,就像那些網絡流行語一樣, AI 作品、文案、圖片也會逐漸融入我們日常溝通方式,甚至讓我們無法離開。

長此以往,人類是否會被「 馴化 」。從説話習慣到思考方式,再到行為邏輯,會不會受到一定的影響。

我想,這可能要打一個問號了。

圖片、資料來源:

v2ex :在知乎抓到一個 ai 瘋狂地污染中文互聯網

The AI feedback loop : Researchers warn of ‘ model collapse ’ as AI trains on AI-generated content

AI is going to eat itself : Experiment shows people training bots are using bots

THE CURSE OF RECURSION : TRAINING ON GENERATED DATA MAKES MODELS FORGET