RWKV:一個大模型小團隊,要做AI時代的安卓_風聞

极客公园-极客公园官方账号-07-26 13:54

獨自一人開發大模型,轉身創業並拒掉巨頭的橄欖枝。

作者 | 凌梓郡

編輯| 鄭玄****

「Interested in working at OpenAI ?」

**香港大學物理系畢業的彭博,在今年 2 月 3 日收到了一封來自OpenAI的邀約郵件。**吸引這家 AI 巨頭的,是他作為獨立開發者發佈的一個開源模型:RWKV。信中並沒有包含具體薪資。不過,此前有消息稱 OpenAI 為軟件工程師提供的年薪中位數為 92.5 萬美元。

Open AI 來信

當時國內還少有人關注到這個創新的模型設計。

彭博回覆了郵件:「OpenAI is great, but I like building Open AI :) Let me know if OpenAI plans to build a community project one day.」(OpenAI 很好,但我喜歡建設 Open 的 AI :) 如果 OpenAI 哪天計劃做一個社區驅動的項目,歡迎告訴我)。

如今,他是元智能 OS 的創始人。這是一個基於 RWKV 模型的創業公司。他更希望建設真正 Open 的 AI,這需要更多商業和資金的支持。這就像 Linux 是免費的,基於 Linux 開源生態,會形成 Redhat 這樣的商業公司。

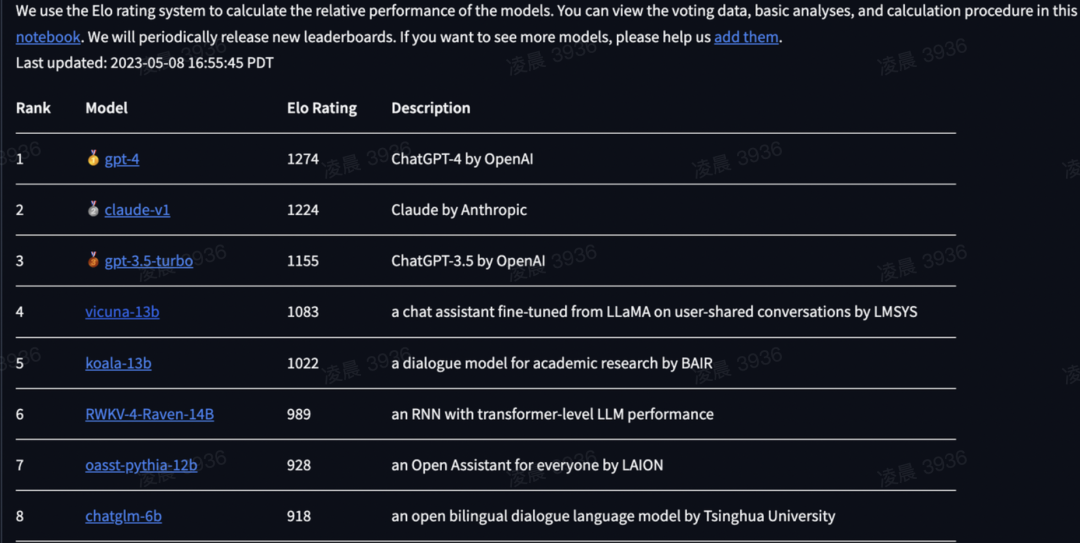

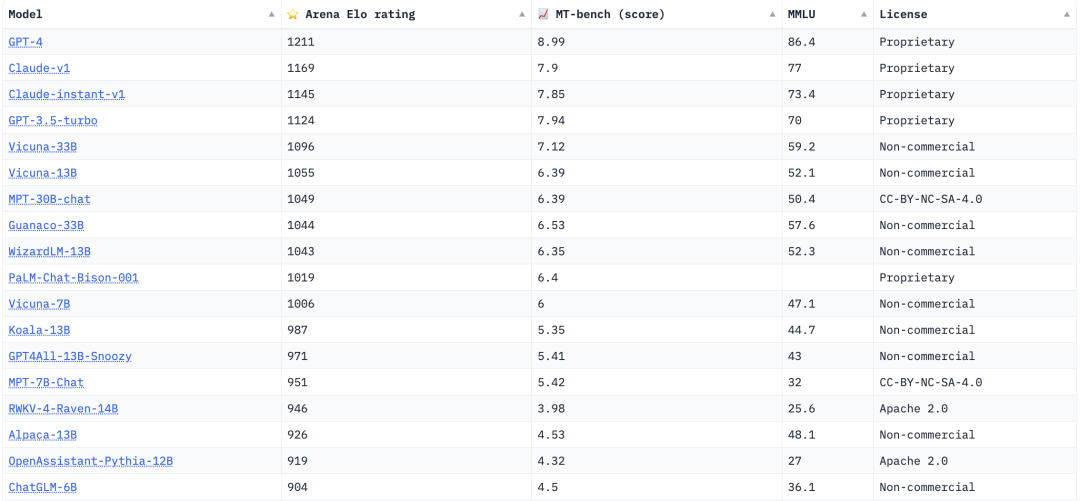

為了降低模型的推理成本,RWKV 創新性地將大模型最常用的 Transformer 架構改寫成了 RNN,這展現出的實用價值受到了業內的關注。讓團隊引以為傲,反覆強調的是:在開放研究組織 LMSYS 每週更新排行榜中,真實用户測評的模型對抗Elo排名中,RWKV 系的對話模型 Raven-14B 的排在 Alpaca-13B、OpenAssistant-Pythia-12B、ChatGLM-6B 等知名項目前。

而 RWKV 和 Raven,從設計,到優化,到大規模訓練,全部由彭博一人完成。

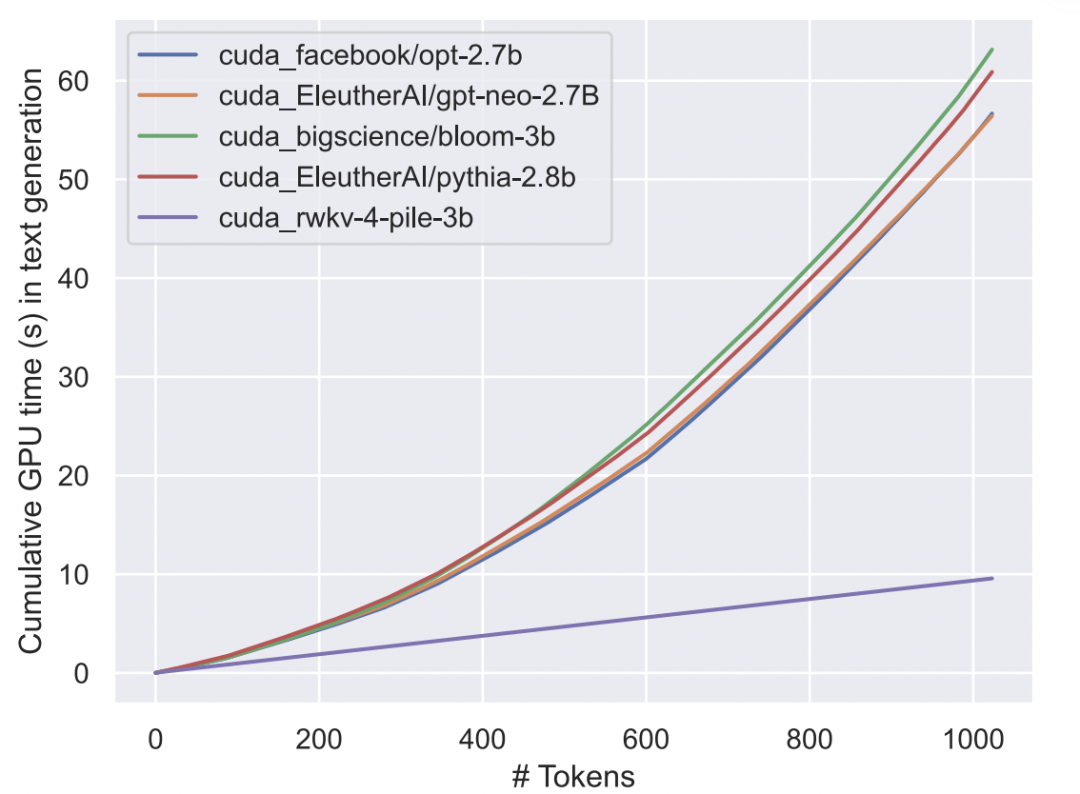

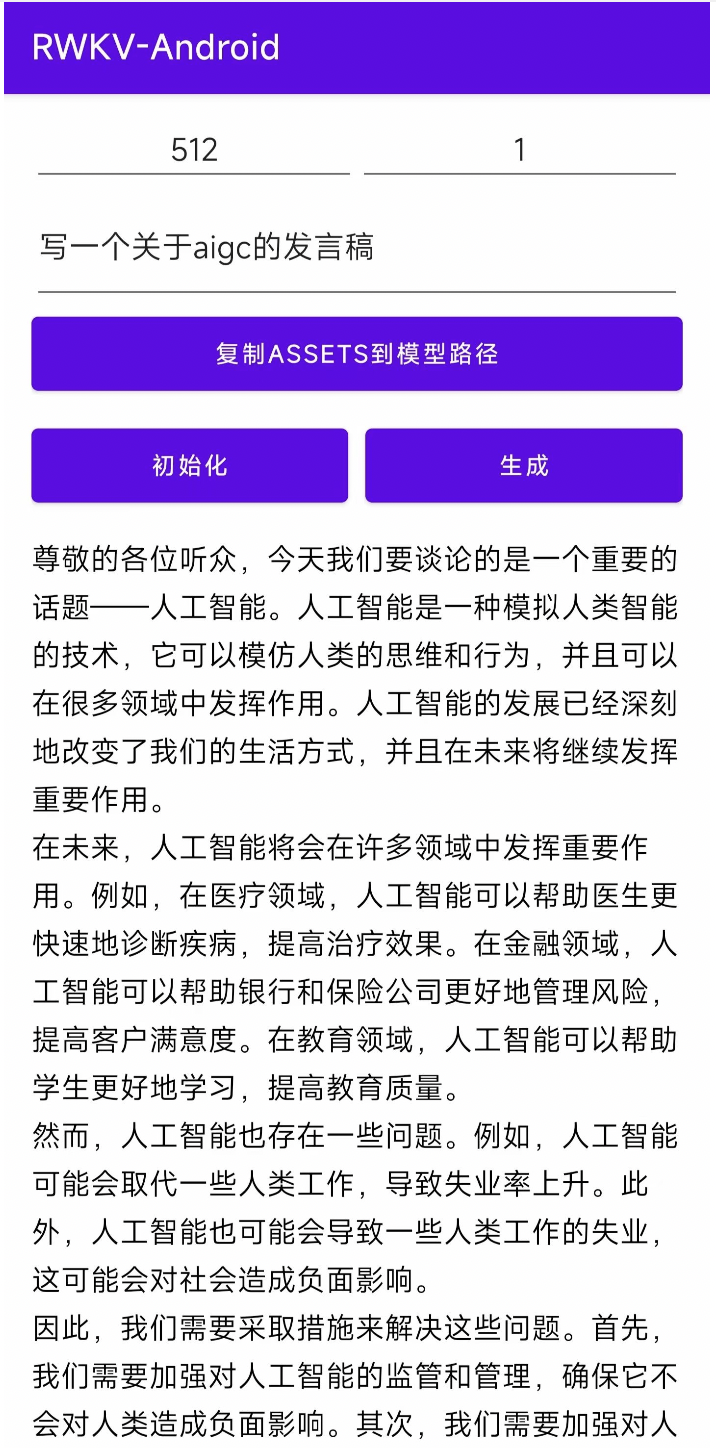

在執行推理任務時,RWKV 的性能優越。如果 Transfomer 架構的算力成本是 T(序列長度)的平方,RWKV 推理的算力成本只有 T 分之一,並且顯存的佔用是恆定的。「我們是市面上真正能夠在手機的芯片上長期跑的模型。因為其他的模型跑着跑着顯存就會爆掉。」元智能的另一位聯創羅璇介紹。

隨Token增加,不同 LLMs 在文本生成上的時間|來源:RWKV 論文

獨特的性能,讓 RWKV 在開源社區中獲得了一定的關注,得到了來自 Stability AI 的算力支持。RWKV 也積累起了自己的開發者社羣,併成立了 RWKV 基金會。5 月底,來自全世界 27 個研究機構、開源社區、高校的 RWKV 開發者們合著的論文才在 arxiv 上發表,外界得以更詳細瞭解模型設計的細節。

大模型的熱潮讓黑客松復興。在今年 4 月份深圳一場黑客松上,經歷三組初賽後,「第一個國產開源語言模型 RWKV」在進入決賽的 17 個隊伍中脱穎而出,獲得了第一名。羅璇便是這場黑客松的發起人。他表示,這場開啓於 3 月的比賽「可能是中國最早的 AIGC 黑客松」。他是 AI-Transformer 社羣的創始人,曾在騰訊擔任高級產品經理、獵豹移動擔任高級產品總監;2016 年 all in AI,先後在阿里巴巴機器人部門和 AI Lab 擔任產品總監,2018 年創業做了 AMR 機器人公司,擔任 Syrius 矩星的聯合創始人。

奪冠之後,RWKV 團隊想嘗試商業化,需要一個產品和市場經驗豐富的人,於是邀請羅璇加入。此後,基於 RWKV 的商業團隊組成了 4 人創始團隊:RWKV 原作彭博、CTO 劉瀟、COO 孔晴、羅璇。這便是「元智能 OS」的起源。

羅璇介紹,目前元智能 OS 團隊有 7 人,主要精力依舊放在訓練更好的基礎模型上。目前公司正在進行第一輪融資,也已經接到一些微調行業模型的商單。而元智能 OS 最終的目標是成為大模型時代的 Android。這意味着開發者基於 RWKV 開發應用,形成生態,與模型適配的芯片會進入終端。

01

誕生於個人開發者

的創新模型

RWKV 這一模型讀作「Ra Ku」,最初的作者只有一個人,來自於畢業於香港大學物理系的彭博。RWKV 模型的誕生,一部分源自彭博自己用 AI 生成小説的興趣。

小説是一種需要連貫邏輯、內在世界觀的長文本。三年前,GPT 系列模型已經引起了學界的關注,但是長文本生成依舊是不小的挑戰。

在 2017 年的谷歌論文中,為了實現 Attention 機制,研究者提出瞭如今被 LLM 廣泛採用的 Transformer 架構。這一架構的特點是具有可擴展性。並行的 Transformer 組件提升了模型訓練數據的效率,從而讓 LLM 的參數規模持續增加,最終出現了「智能湧現」的特點。

但是這一架構也有缺點,在執行推理任務,也就是生成內容的時候,計算複雜度會隨着序列長度(T)成 2 次方 O(T*2)增加,這意味着推理時計算成本的也會成 2 次方增加。這種計算複雜度的增加是由 Attention 機制帶來的,因此,一部分研究者在思考如何能夠簡化 Attention 機制。

2021 年,蘋果發佈了一篇論文《An Attention Free Transformer》,提出了種不需要 Attention 機制的 Transformer 模型。這給了彭博很大的啓發,他將這篇論文中的公式進行改寫,成功將 Attention 公式改寫成了 RNN(循環神經網絡)形式。循環神經網絡是之前 NLP 裏最常用的深度學習模型。

公式的改寫,將推理的計算複雜度降為了線性增長。於是,RWKV 被形容為成兼具 Transformer 與 RNN 優點的模型架構:可並行高效訓練、推理性能優越。

RWKV 模型訓練完成後,彭博將其在國外的 GitHub、以及國內的魔搭社區上線。他開發了更適合對話的 ChatRWKV,並建立了 Discord 社區、QQ 羣,歡迎開發者們一起做「大規模語言模型的 Stable Diffusion」、「開源 ChatGPT」。這樣一個出自獨立開發者的模型,在 5 月初,RWKV 一度在開放研究組織 LMSYS 的模型對抗排名中取得了第六名,無疑令人驚喜。

對於小型創業團隊、個人開發者而言,RWKV 是沒有算力門檻,是可以快速嘗試的模型。在最近一次不到二十人的小範圍聚會中,我遇到四五個基於大模型做應用的創業者。其中就有兩個使用了 RWKV。

這樣創業小團隊的畫像很常見:基於已有的開源模型,結合私有數據做 Finetune,幫助一些需要提升效率的企業,做模型定製或內部的 AI Agent 開發。

他們常常在開源社區選用最合適的模型,也熟悉各個開源模型的特點。一位創業者則在朋友圈展示出 RWKV 的安卓端版的頁面,這是一個可以在手機端進行推理的模型版本。

其中一位創業者表示,RWKV 模型的優勢是處理長文本的信息,並給出回應,因此在格外需要這一能力的用例上會優先考慮,不過模型的缺點也很明顯,發散性太強,交互過程中會容易偏離話題。「它實際上的競爭對手是 GLM」他説。

ChatGLM 是清華智譜團隊開發的模型。其中的 6B 版本在國內開源模型中表現出色,頗有口碑。前不久團隊剛剛宣佈了此前開源的 ChatGLM-6B 和 ChatGLM2-6B 允許商用。

02

RWKV 保持開源,

元智能 OS 想成為

大模型時代的安卓

在開源模型層出不窮的當下,如何評測模型無疑是關鍵任務。各家也往往搬出其自研模型在 MMLU、AGIEval、C-Eval 等評測基準上的表現,以自證模型能力。但不止一位行業人士指出,模型可以根據評測基準做特定的數據優化,由此最終得到比較好的打分結果。這一現象難免令外界無所適從。

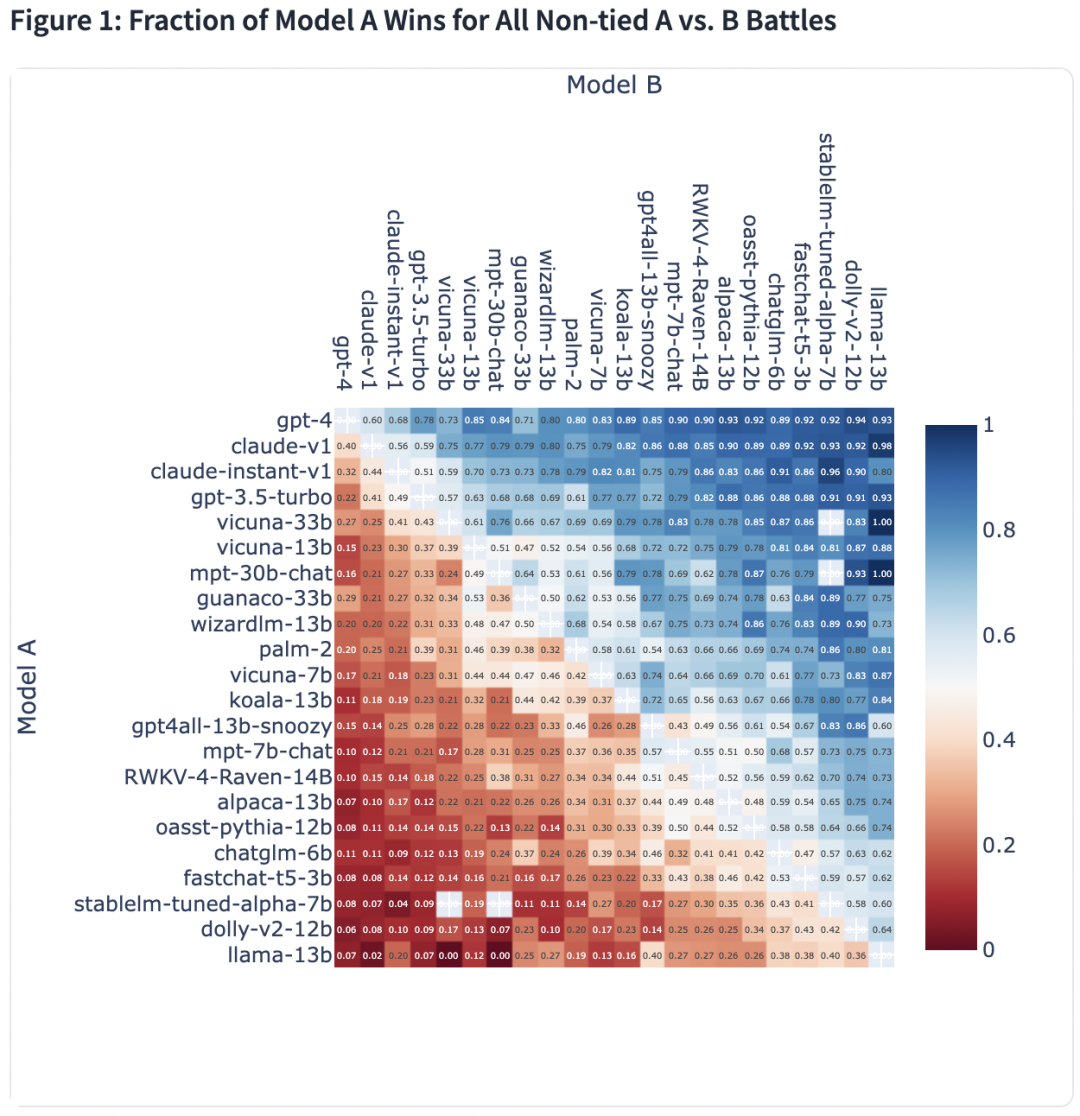

**要真正理解 RWKV 在排行榜上取得的排名的含義,就需要理解排名產生的規則。**開放研究組織 LMSYS 則創新地嘗試一種綜合的測評策略,每週更新排行榜。最新的結果顯示,RWKV 系列 14B 的對話模型 Raven 排在第 15 位,綜合排位在 ChatGLM-6B(清華-智譜)之前,後者是在國內頗具口碑的開源模型。在 5 月 8 日的排行中,RWKV 一度排在第六。

LMSYS 的測評策略中一共使用三種方式為模型打分,RWKV 似乎在第一種 Chatbot Arena(對話模型競技場)的表現上更加優越;而在 MT-bench、MMLU 這樣的基於任務集的測試上得分偏低。

LMSYS 模型測評排名(截止7.25)

Chatbot Arena(對話機器人競技場)是隨機匿名的人類打分機制。在網頁上,訪客同時跟兩個匿名模型進行交互,並投票給更認為體驗更佳的一方。這樣收集眾多模型間 1V1 的比拼結果之後,LMSYS 最終統計模型的排名。在每週的排名公佈時,也會公佈任意兩個模型在競技場上「狹路相逢」時的表現。最近一週,當 RWKV-4-Raven-14B 與 ChatGLM-6B 被人類比較時,59% 的概率下,人類會覺得 Raven 表現更優秀,這或許説明了在對話的場景下,Raven 略勝一籌。

而在 MT-bench、MMLU 這樣的基於任務集的測試上得分偏低,這表明 RWKV 在能力泛化、知識遷移、多輪有挑戰的任務上能力較弱。

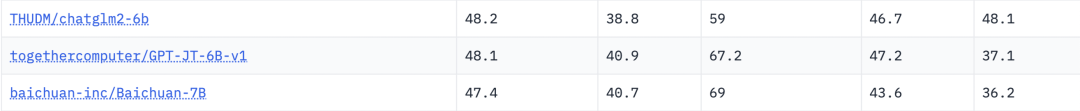

羅璇曾形容 RWKV 是「最佳開源可商用」LLM。不過,在百川智能 Baichuan-13B、智譜 ChatGLM2-6B 先後宣佈開源可商用之後,國內開源可商用的模型格局必然發生新的變化。5 月,RWKV 在 Hugging face 模型平台上線,但目前已經不在 Open LLM Leaderboard 榜單上,ChatGLM2-6B 和 Baichuan-7B 榜單中排位相近。

在 5 月接受 36Kr 採訪時,彭博表示「RWKV 中文 7B 模型和 ChatGLM 6B 中文模型也是互有勝負,不過,RWKV 還沒開始真正煉中文模型,使用的是英文詞表,還沒有加入大規模中文語料。」

彭博目前的主要精力都集中在訓練模型上,RWKV-4-world 系列模型也在不斷上線中,其中就包括了針對中文的特化模型,重點提升了中文能力,降低了其它語言的能力。目前 Demo 也已經開放在魔搭社區供人嘗試。在 AI 作曲上,彭博也發佈了最新的開源成果,基於 RWKV 生成 MIDI 形式音樂的模型。(注:MIDI 一種數字音頻格式,用於控制電子音樂設備之間的通信)

RWKV-4-world 中文模型續寫小説 Demo

RWKV 模型本身會一直保持開源和非盈利,目標是成為大模型時代的 Linux,而元智能 OS 則希望能夠成為大模型時代安卓。

羅璇表示,安卓是 Linux 在手機垂直領域的版本。對應而言,元智能 OS 就會成為大模型時代某一領域最通用的模型。「大模型時代的安卓」包含了兩層含義,「會有一個大的生態,在這個基礎上,提供多樣的能力給第三方應用;另外一方面,硬件會是 RWKV 的重要生態。」他介紹,目前終端和服務器上的 GPU、CPU 都可以用來做模型推理,而在模型訓練方面,Nvidia、AMD、Intel 等芯片都已能夠很好支持,國產芯片中不少也移植了 RWKV 的算子。

03

「做 ChatGPT

現在不能做的」:

未來的模型會在端側運行

元智能 OS 已經接到了幫助一些微調行業垂直領域的商單,客户主要來自金融、律所、智能硬件等行業,以 license 的形式收年費。RWKV 模型吸引它們的主要是兩點:全自研,算力成本低。

元智能 OS 會結合特定領域的公開數據,在基礎模型上微調一個更具備行業知識的垂直模型,再交由客户結合自己的私有業務數據,進行本地化部署。部署環節往往由第三方技術提供方實現,這是由於公司希望私有數據不外泄。本地化部署所面臨的是業務上的門檻,而非技術上的門檻,「數據不能出來,不能進模型。」

這也是為什麼以 API 形式提供 B 端服務商業模型的前景開始受到懷疑。儘管 OpenAI 已經在 3 月分更新了服務條款,明確表示不再使用任何 API 的數據進行訓練,依舊難以打消企業們對於數據外泄的擔憂。因此,API 商業模式的前景也開始受到懷疑。

元智能 OS 的觀點是明確的:API 不是一個好的商業模式。

延遲問題難以解決。在智能汽車、智能音箱,以及未來的 XR 眼鏡、頭顯等場景,通過 API 調用雲端算力資源的延遲性較高。「現在 Open AI 的 API 調用體驗非常差,實際上是不可用的」

成本問題,調用 API 按照消耗 Token 的數量來計費,如果在終端設備上使用功能,還要為雲端的 Token 付費,也是不合理的。羅璇表示,如果接入 OpenAI 的 API,計算下來,一個智能音箱需要 10 美金的訂閲費抵消成本。

數據安全問題。除了企業不願意外泄數據,在個人助理領域,個人用户也不希望自己的私人數據被傳入雲端。

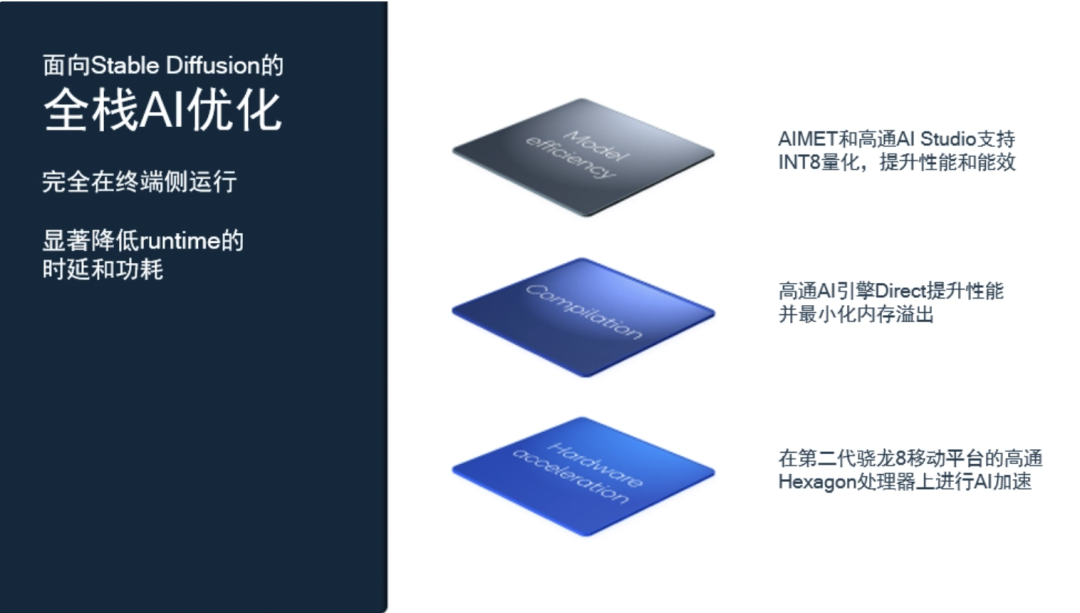

在端側運行大模型,也已經是行業內的共識,高通前不久展示針對 Stable Diffusion 而做的優化,實現了在安卓手機上運行模型。陸奇在深圳的公開演講中也曾表示,可能需要三到五年的時間,大模型會在手機端上運行。

**由於 RWKV 模型的性能優勢,元智能 OS 將「終端部署大模型」視為自己的最大戰場。**彭博表示「AI 大模型的決戰戰場是在硬件上面,也就是芯片。無論是端側和雲測都需要專用芯片。」陸奇在深圳的公開演講中就曾表示,可能需要三到五年的時間,大模型會在手機端上運行。

目前 RWKV 已經提供了在 Windows 和 Mac、Linux 電腦上可以安裝的版本 RWKV Runner。除了已經放出的安卓版本,IOS 版本在開發中。羅璇告訴極客公園:元智能 OS 正在進行第一輪融資。團隊未來半年的核心還是模型,提升模型能力是一方面,另外也正在和一些芯片公司和算力平台洽談,打造標杆客户。

其中,標杆客户包括有終端部署的形式,也包括跟雲平台合作提供 API 調用。「現在的精力其實是更多在模型訓練、開發者生態和融資,接下來會逐漸調整到產品和生態」。

04

「硬件的迭代週期,

是天然的門檻」

基於大模型的 Killer app 尚未出現的當下,基於大模型的應用價值,引起了人們的諸多討論。

Notion AI、Office 365 Copilot 這樣商業價值確定的應用,共同之處是在成熟的軟件產品上新增 AIGC 功能。羅璇形容,這樣的新功能,是「在原來定義好的場景下,提升效率,幫助人節省了勞動力。」

但是他認為,這樣產品思路並沒有帶來增量價值;而且,只做效率提升,帶來的商業價值很快就會見頂。他認為,如何用大模型帶來的生產力創造增量價值,比如「讓人們獲得更多、更好的數字化內容」,應該是創業者思考的方向。

另外一個現象是,調用模型能力,從單點價值出發的創業團隊似乎難以形成商業壁壘。「創業公司基於 ChatGPT 能夠創造的價值非常單薄」的觀點便是代表。

比如 Jasper.AI 這樣調用模型能力應用的營銷寫作產品,在 ChatGPT 推出之後,反而迎來了流量下降。這意味着基礎模型能力更強、更易用之後,具備覆蓋一部分應用的能力。另外一個例子是 Gammaly,這個已經存在了十幾年的寫作輔助軟件,在 ChatGPT 表現出優異的語言能之後,也面臨着自證「Gammaly 能夠提供更好的寫作輔助」的新課題。

組織過十幾場黑客松,作為經歷過互聯網時代產品老人,羅璇也表示目前的初創產品往往存在問題:

對於技術邊界理解不深入。或者不知道現在的模型能做什麼,或者不知道隨着模型發展,未來能夠做什麼;這表現在,做出來的應用,是模型已經能實現的功能;或者想實現的效果,未來三到五年,通過模型能力也無法實現。

對市場競爭格局、現有市場供需關係理解不深入,這容易帶來兩種結果:做出來的產品很容易被有渠道的大廠直複製;或者做出來的東西沒有市場需求,沒有人用。

在大模型技術快速發展的當下,理解技術邊界,思考技術會如何演變,對於產品經理而言變得更加重要,這樣才能避免思考產品時刻舟求劍。

RWKV 模型在進入終端硬件上有優勢,羅璇本人也看好模型進入在機器人、XR 等手機、PC 之外的終端硬件之後所帶來的可能性。首先,這些終端硬件帶來激活新的應用場景,從而衍生出其上搭載的軟件服務和數字化內容;其次,硬件的迭代週期很長,是天然的門檻。

「誰先做,就很有可能就有一些優勢。」在黑客松中,為了鼓勵硬件項目,他還專門設立了硬件獎項。深圳擁有的硬件產業鏈優勢,也寄託了他「讓 AI 發生在中國大灣區」的願望。

*頭圖來源:RWKV

本文為極客公園原創文章,轉載請聯繫極客君微信 geekparkGO