微軟寫了份GPT-4V説明書:166頁講解又全又詳細,提示詞demo示例一應俱全_風聞

量子位-量子位官方账号-10-05 14:14

克雷西 蕭簫 發自 凹非寺

量子位 | 公眾號 QbitAI

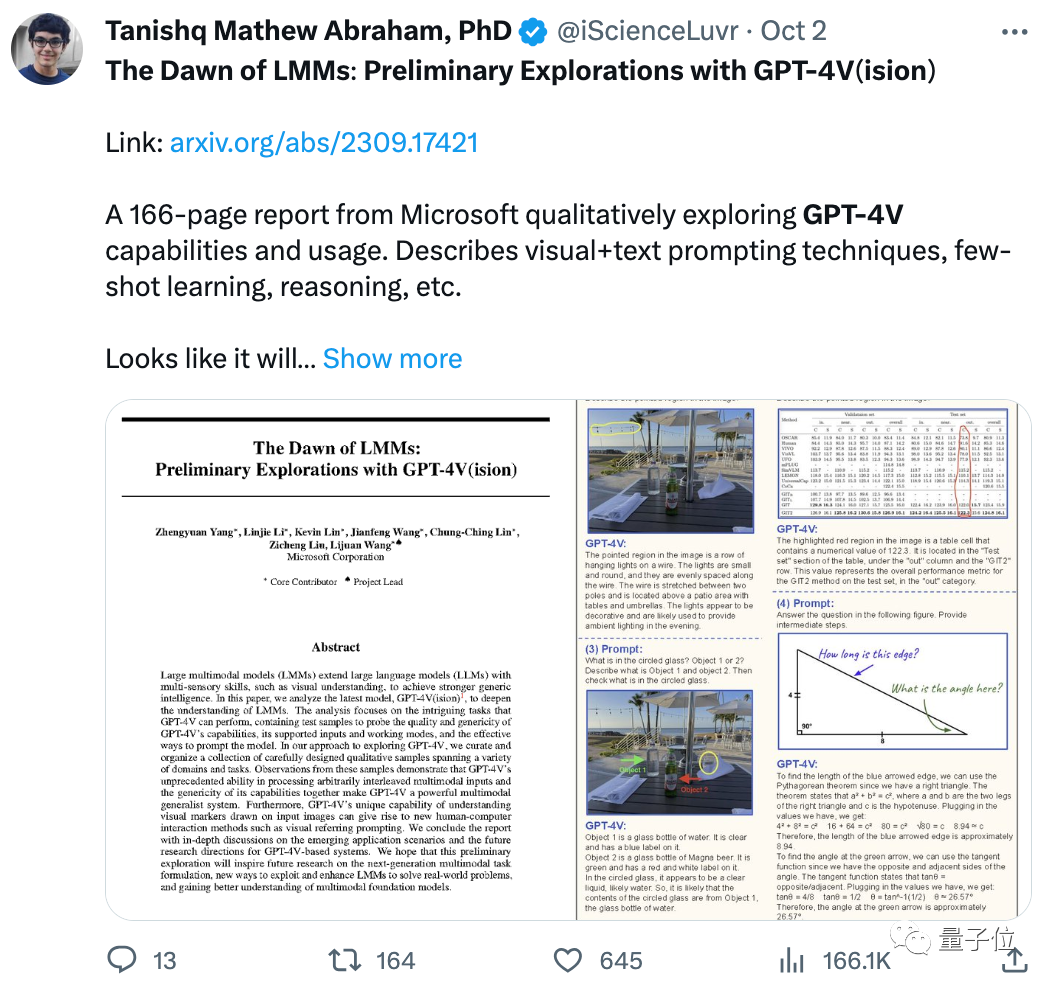

多模態王炸大模型GPT-4V,**166頁“説明書”**重磅發佈!而且還是微軟團隊出品。

什麼樣的論文,能寫出166頁?

不僅詳細測評了GPT-4V在十大任務上的表現,從基礎的圖像識別、到複雜的邏輯推理都有展示;

還傳授了一整套多模態大模型提示詞使用技巧——

手把手教你從0到1學會寫提示詞,回答專業程度一看就懂,屬實是把GPT-4V的使用門檻打到不存在了。

值得一提的是,這篇論文的作者也是“全華班”,7名作者全部是華人,領銜的是一位在微軟工作了17年的女性首席研究經理。

在166頁報告發布前,他們還參與了OpenAI最新DALL·E 3的研究,對這個領域瞭解頗深。

相比OpenAI的18頁GPT-4V論文,這篇166頁“食用指南”一發布,立刻被奉為GPT-4V用户必讀之物:

有網友感慨:這哪裏是論文,這簡直快成一本166頁的小書了。

還有網友看完已經感到慌了:

不要只看GPT-4V的回答細節,我真的對AI展現出來的潛在能力感到害怕。

所以,微軟這篇“論文”究竟講了啥,又展現出了GPT-4V的哪些“潛力”?

微軟166頁報告講了啥?

這篇論文鑽研GPT-4V的方法,核心就靠一個字——“試”。

微軟研究員們設計了涵蓋多個領域的一系列輸入,將它們餵給GPT-4V,並觀察和記錄GPT-4V的輸出。

隨後,他們對GPT-4V完成各類任務的能力進行評估,還給出了使用GPT-4V的新提示詞技巧,具體包括4大方面:

1、GPT-4V的用法:

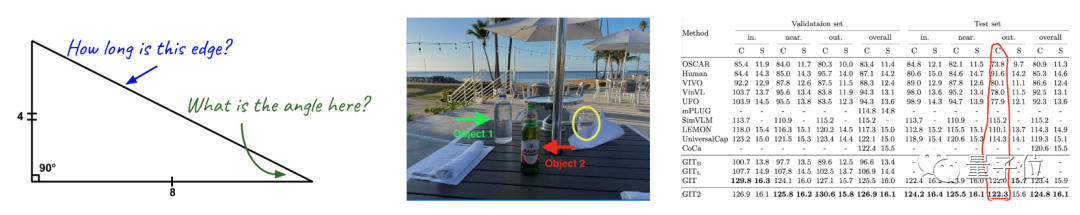

5種使用方式:輸入圖像(images)、子圖像(sub-images)、文本(texts)、場景文本(scene texts)和視覺指針(visual pointers)。

3種支持的能力:指令遵循(instruction following)、思維鏈(chain-of-thoughts)、上下文少樣本學習(in-context few-shot learning)。

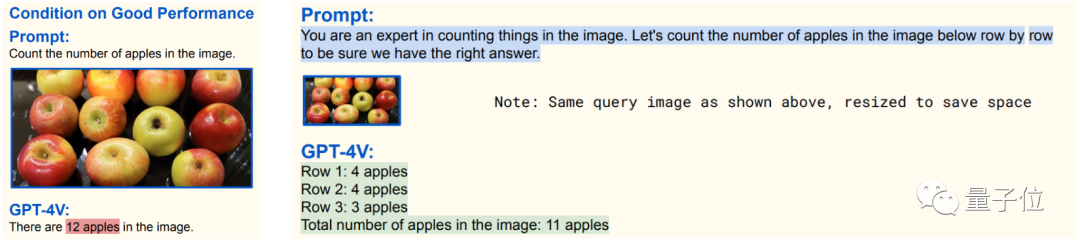

例如這是基於思維鏈變更提問方式後,GPT-4V展現出的指令遵循能力:

2、GPT-4V在10大任務中的表現:

開放世界視覺理解(open-world visual understanding)、視覺描述(visual description)、多模態知識(multimodal knowledge)、常識(commonsense)、場景文本理解(scene text understandin)、文檔推理(document reasoning)、寫代碼(coding)、時間推理(temporal reasonin)、抽象推理(abstract reasoning)、情感理解(emotion understanding)

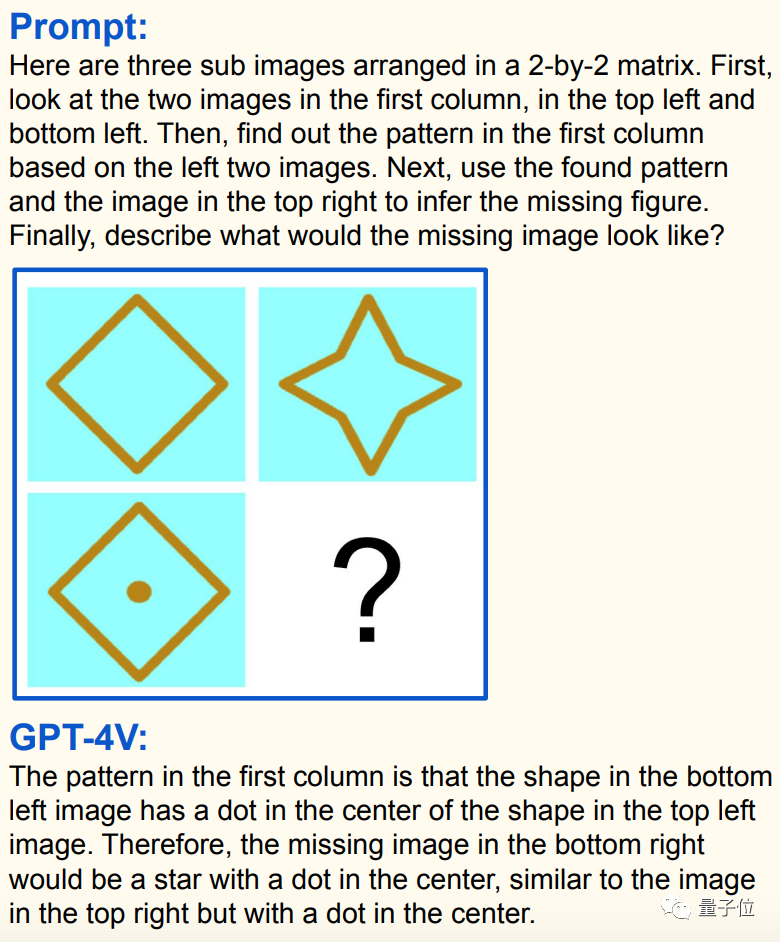

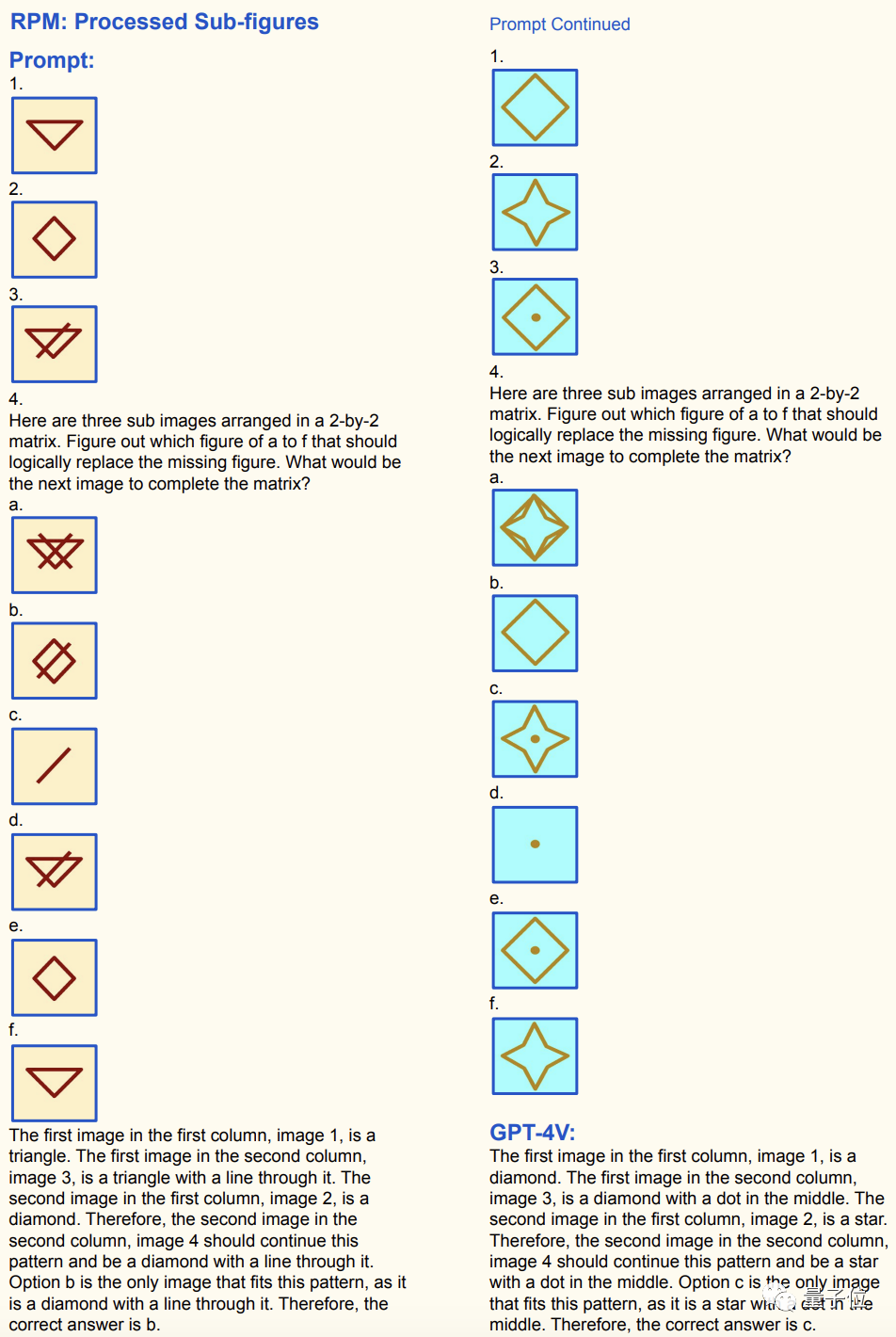

其中就包括這種,需要一些智商才能做出來的“圖像推理題”:

3、類GPT-4V多模態大模型的提示詞技巧:

提出了一種新的多模態提示詞技巧“視覺參考提示”(visual referring prompting),可以通過直接編輯輸入圖像來指示感興趣的任務,並結合其他提示詞技巧使用。

4、多模態大模型的研究&落地潛力:

預測了多模態學習研究人員應該關注的2類領域,包括落地(潛在應用場景)和研究方向。

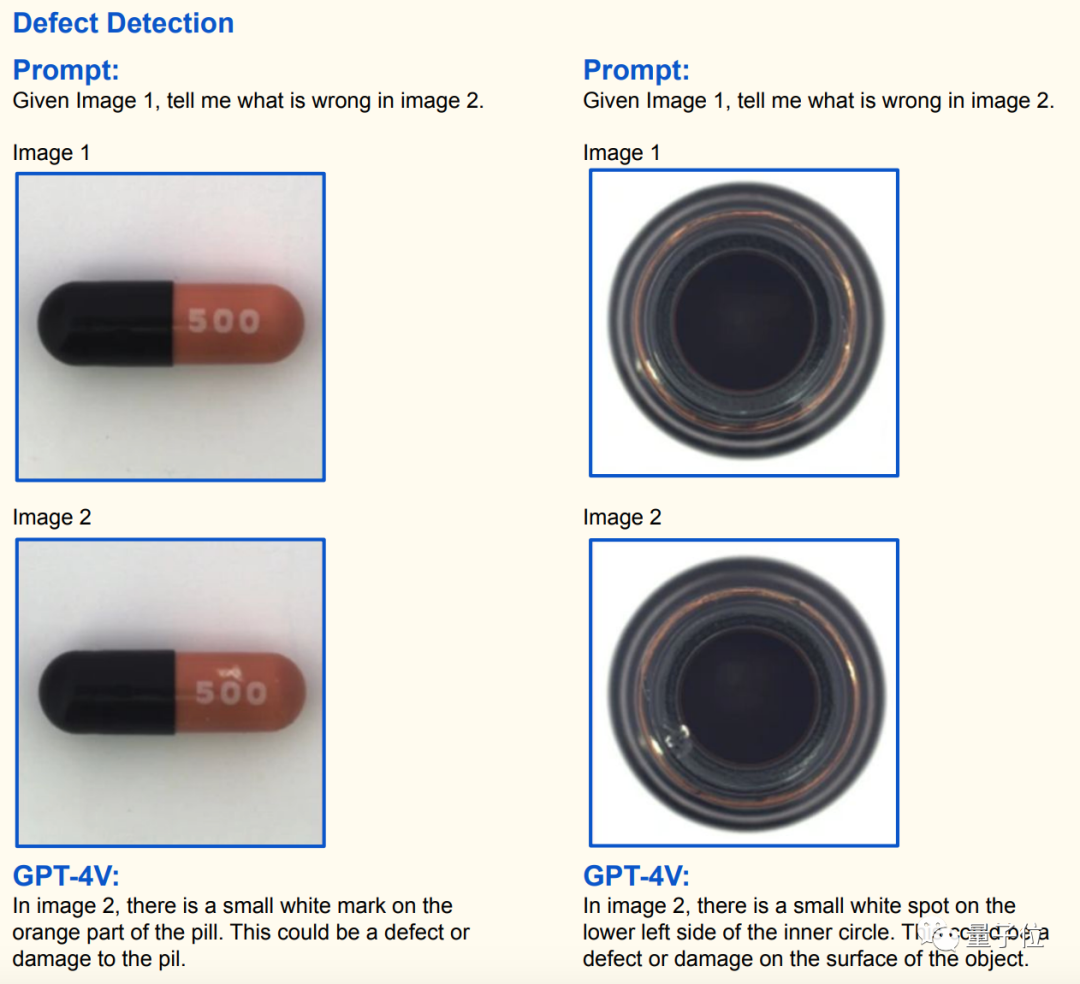

例如這是研究人員發現的GPT-4V可用場景之一——故障檢測:

但無論是新的提示詞技巧、還是GPT-4V的應用場景,大夥兒最關注的還是GPT-4V的真正實力。

所以,這份“説明書”隨後用了150多頁來展示各種demo,詳細劇透了GPT-4V在面對不同回答時展現出的能力。

一起來看看GPT-4V如今的多模態能力進化到哪一步了。

精通專業領域圖像,還能現學知識圖像識別

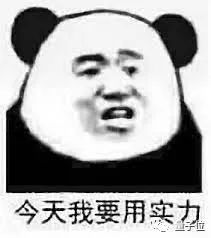

最基礎的識別自然是不在話下,比如科技、體育界以及娛樂圈的各路名人:

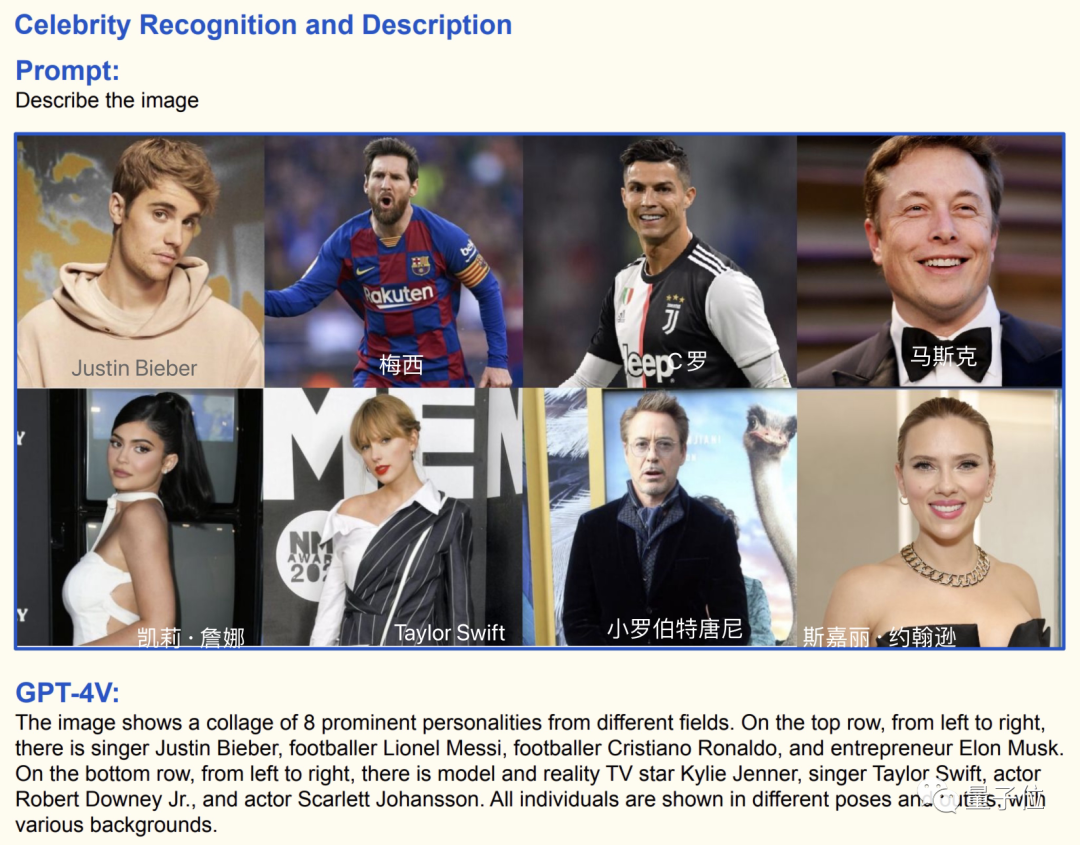

而且不僅能看出這些人是誰,還能解讀他們正在做什麼,比如下圖中老黃正在介紹英偉達新推出的顯卡產品。

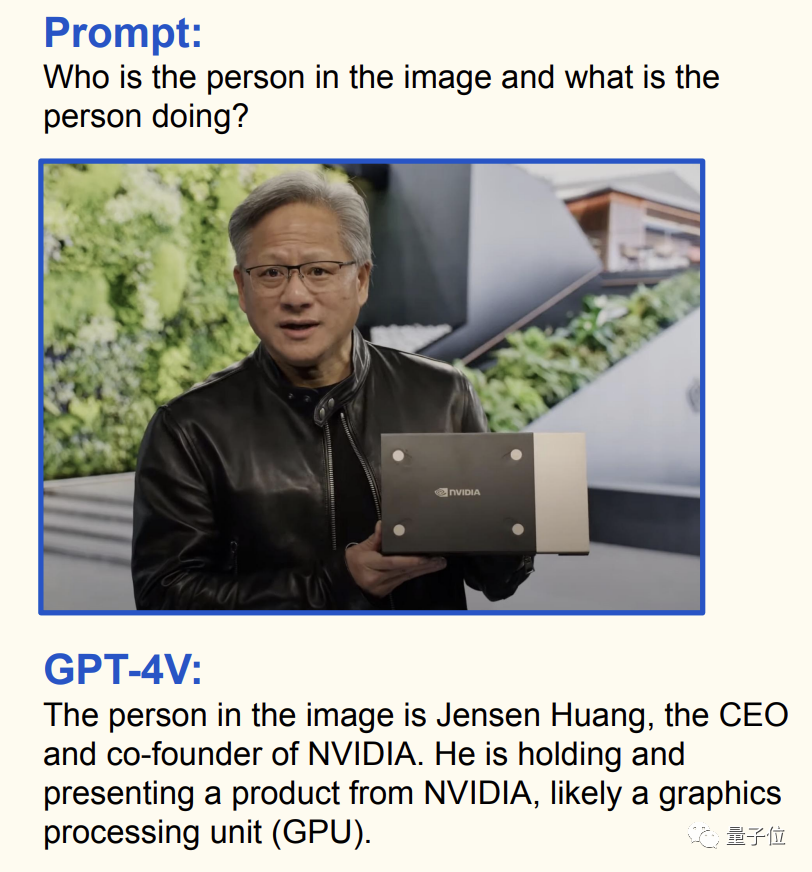

除了人物,地標建築對於GPT-4V來説同樣是小菜一碟,不僅能判斷名稱和所在地,還能給出詳細的介紹。

**△**左:紐約時代廣場,右:京都金閣寺

不過越是有名的人和地點,判斷起來也就越容易,所以要難度更大的圖才能展現GPT-4V的能力。

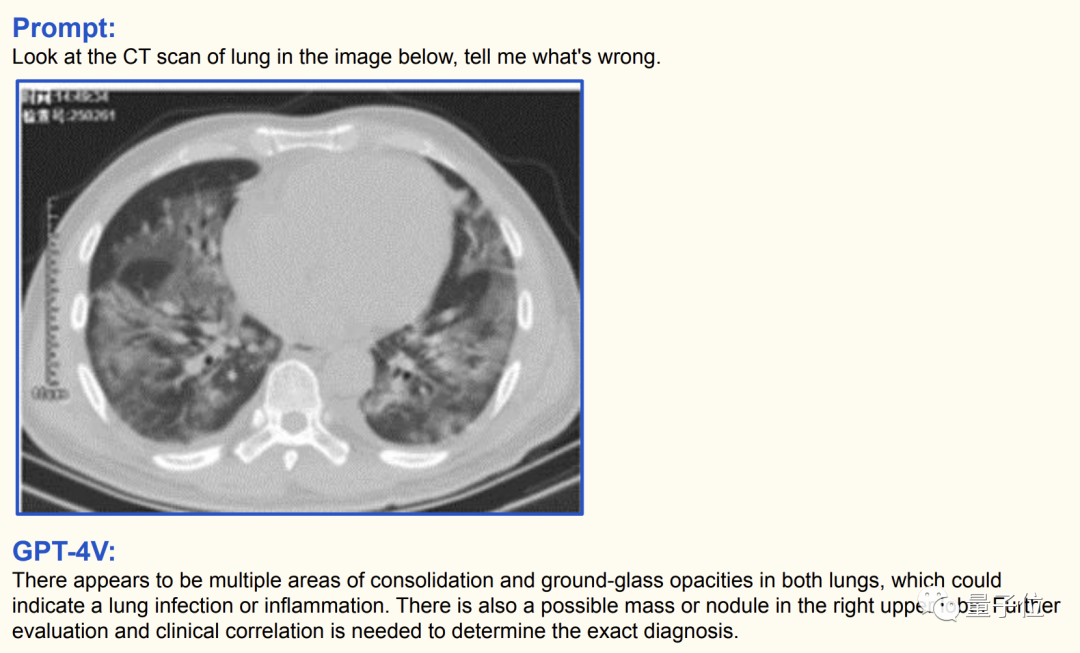

比如醫學影像,針對下面這張肺部CT,GPT-4V給出了這樣的結論:

雙肺多個區域存在實變和磨玻璃混濁,肺部可能存在感染或炎症。右肺上葉也可能有腫塊或結節。

甚至不告訴GPT-4V影像的種類和位置,它自己也能判斷。

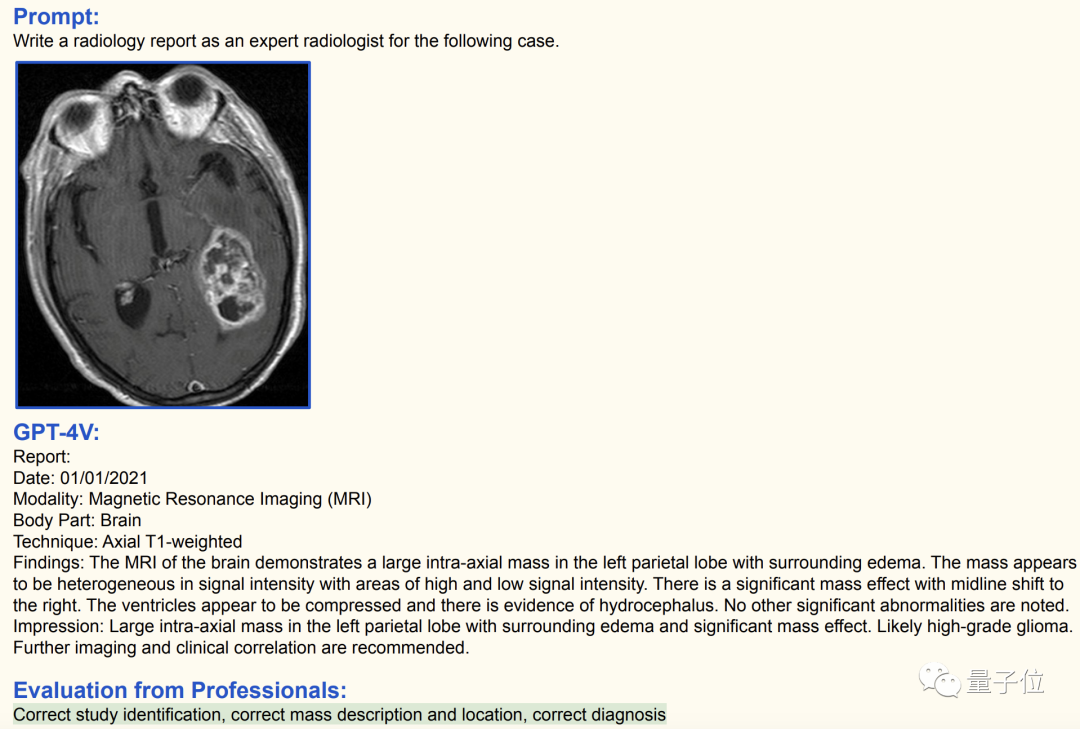

這張圖中,GPT-4V成功識別出了這是一張腦部的核磁共振(MRI)影像。

同時,GPT-4V還發現存在大量積液,認為很可能是高級別腦膠質瘤。

經過專業人士判斷,GPT-4V給出的結論完全正確。

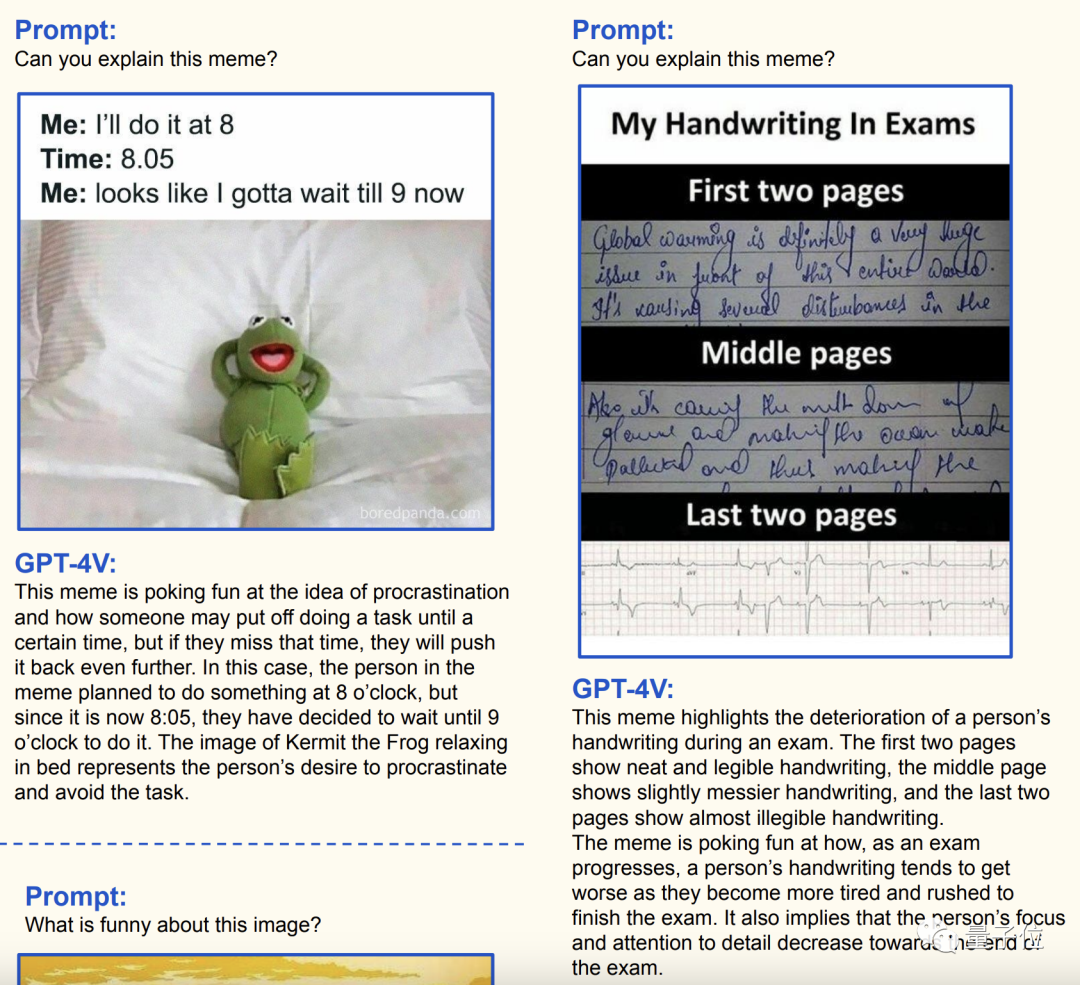

除了這些“正經”的內容之外,當代人類社會的“非物質文化遺產”表情包也被GPT-4V給拿捏了。

**△**機器翻譯,僅供參考

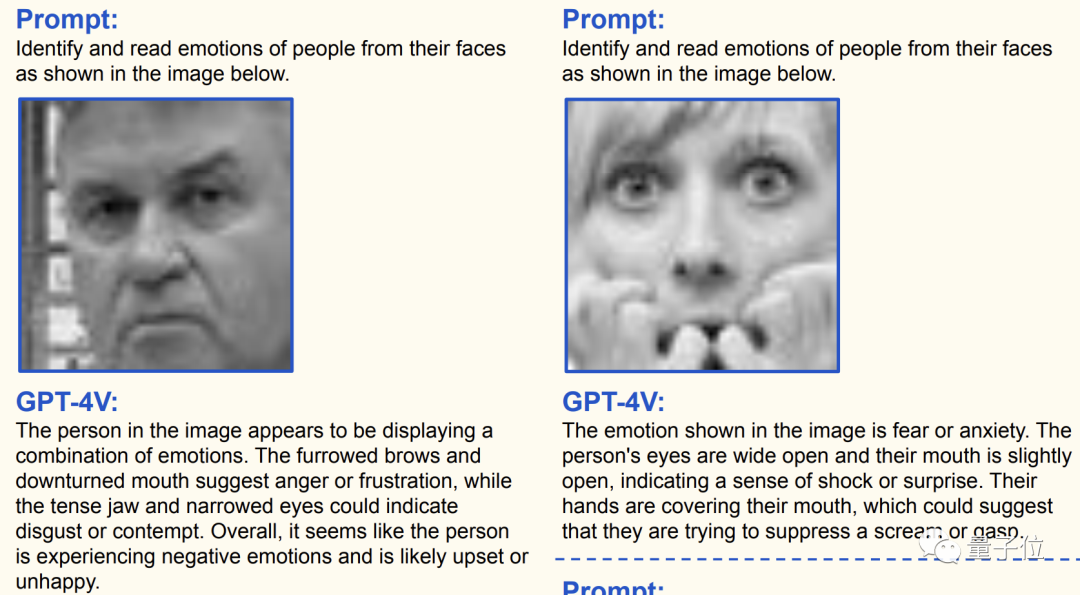

不僅是解讀表情包中的梗,真實世界中人類的表情所表達的情感也能被GPT-4看穿。

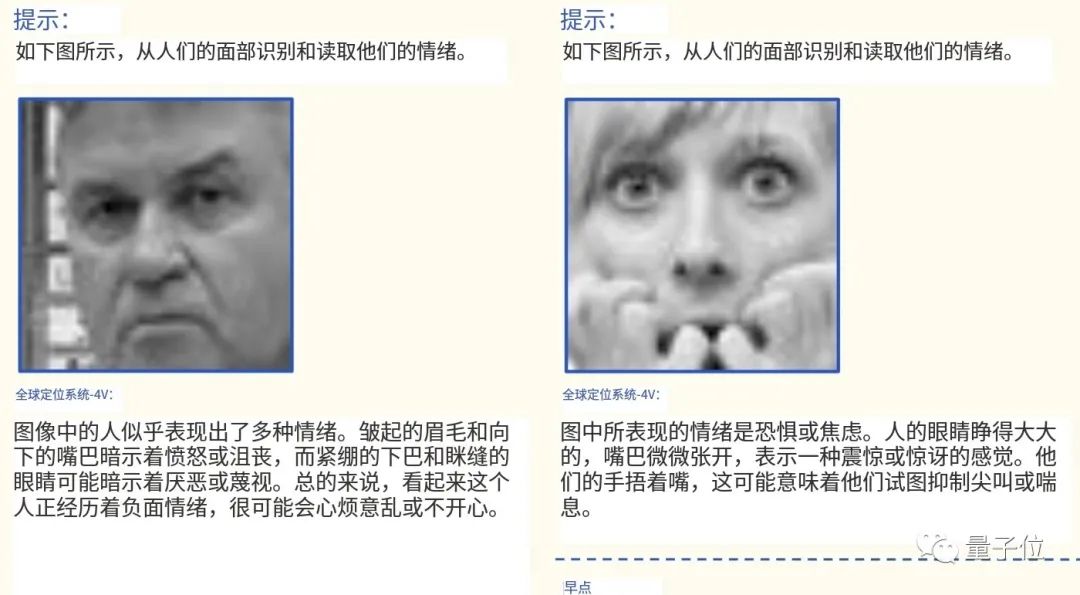

除了這些真·圖像之外,文本識別也是機器視覺中的一項重要任務。

這方面,GPT-4V除了可以識別拉丁文字拼寫的語言之外,中文、日文、希臘文等其他文字也都認識。

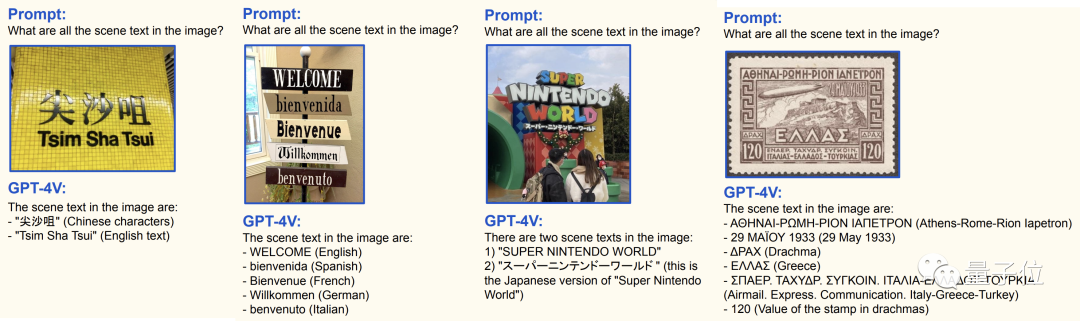

甚至是手寫的數學公式:

圖像推理

前面展示的DEMO,無論多麼專業或多麼難懂,都還停留在識別的範疇,但這只是GPT-4V技能的冰山一角。

除了看懂圖片中的內容,GPT-4V還具有一定的推理能力。

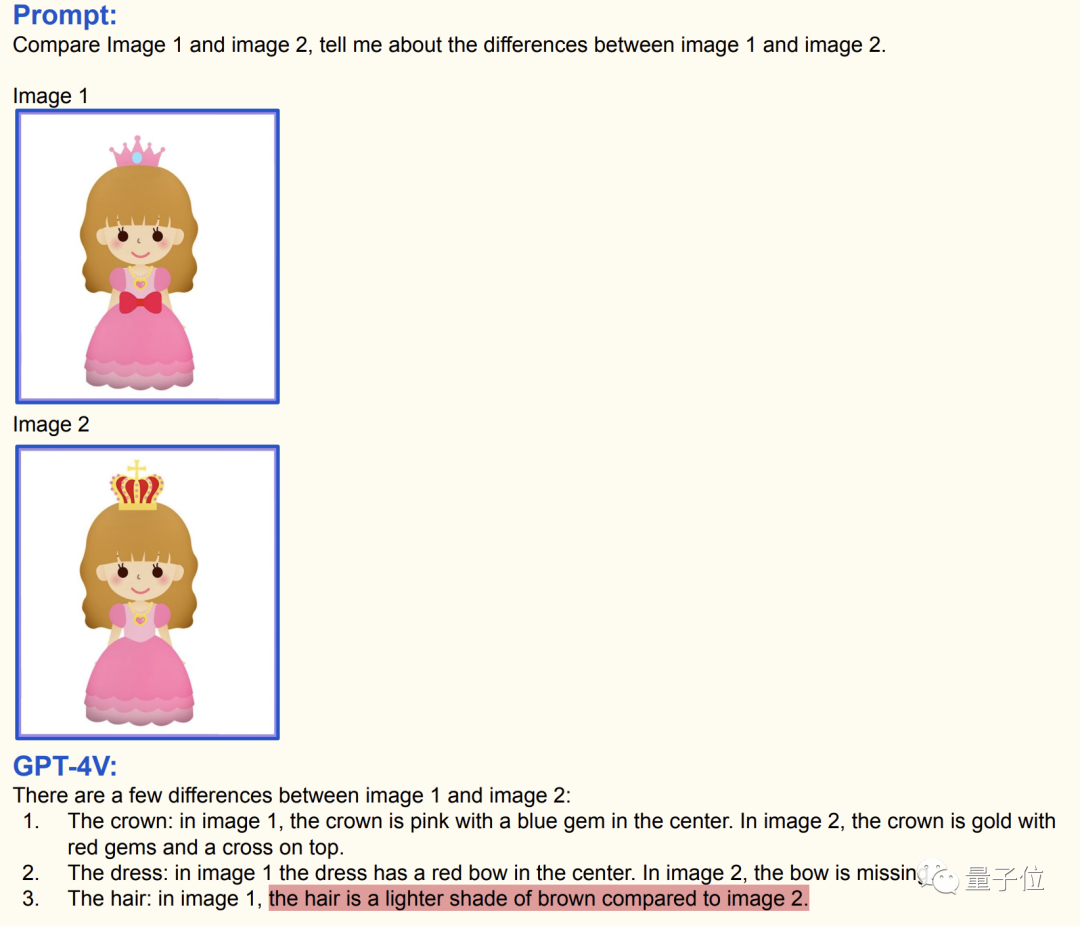

簡單一些的,GPT-4V可以發現兩張圖中的不同(雖然還有些錯誤)。

下面的一組圖中,王冠和蝴蝶結的區別都被GPT-4V發現了。

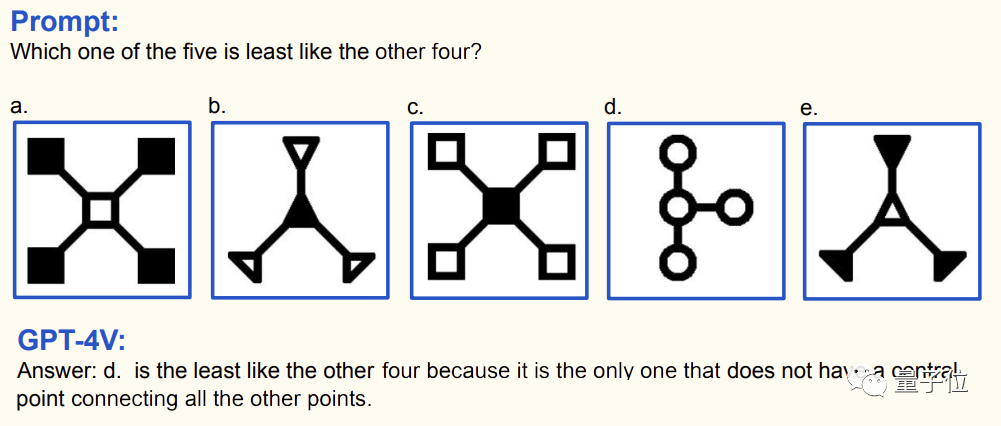

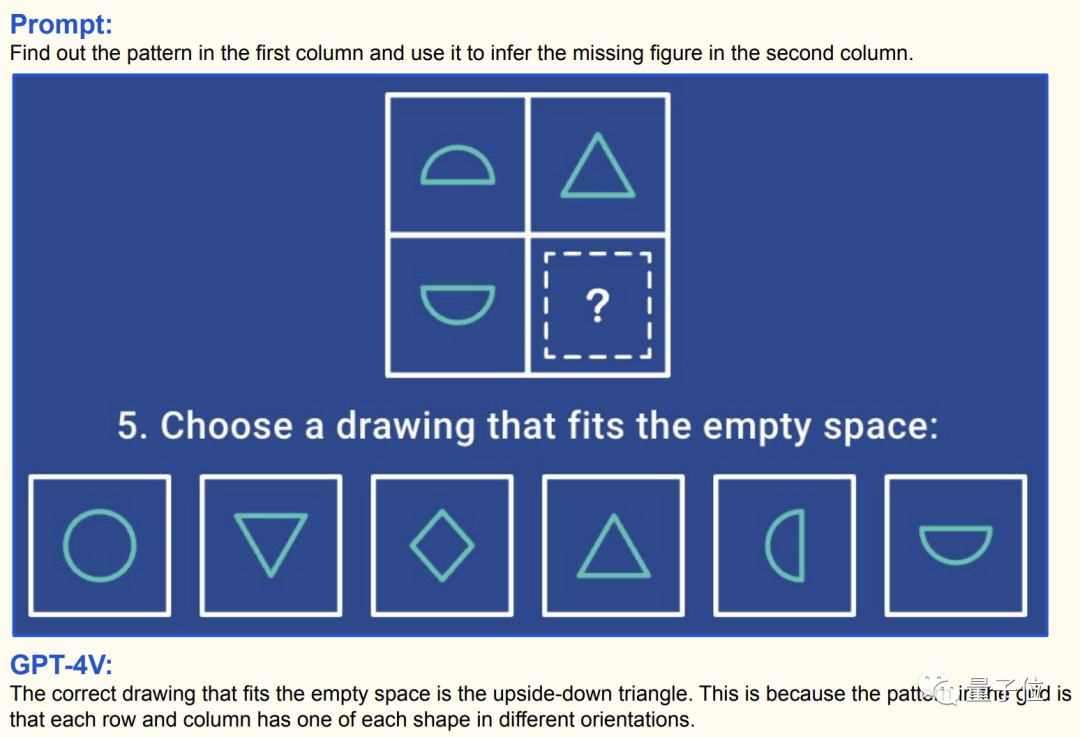

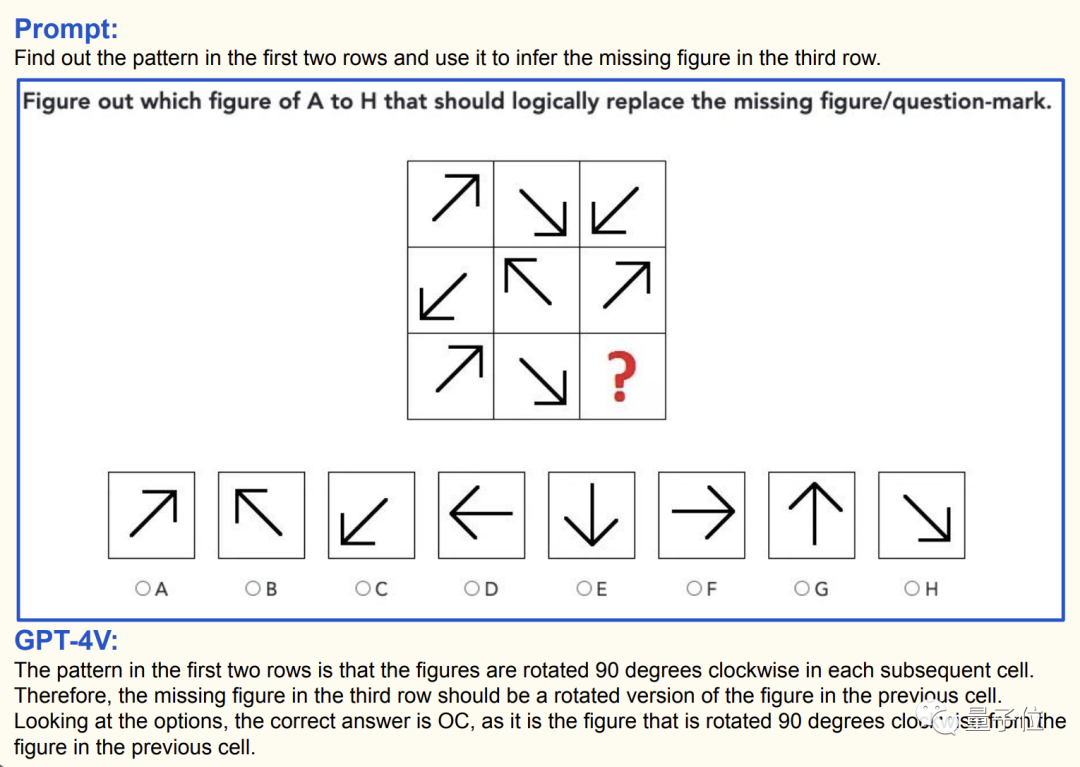

如果加大難度,GPT-4V還能解決IQ測試當中的圖形問題。

上面的這三道題中的特徵或邏輯關係都還比較簡單,但接下來就要上難度了:

當然難度不是在於圖形本身,注意圖中的第4條文字説明,原題目中圖形的排列方式不是圖中展示的樣子。

圖片標註

除了用文本回答各種問題,GPT-4V還可以在圖片中執行一系列操作。

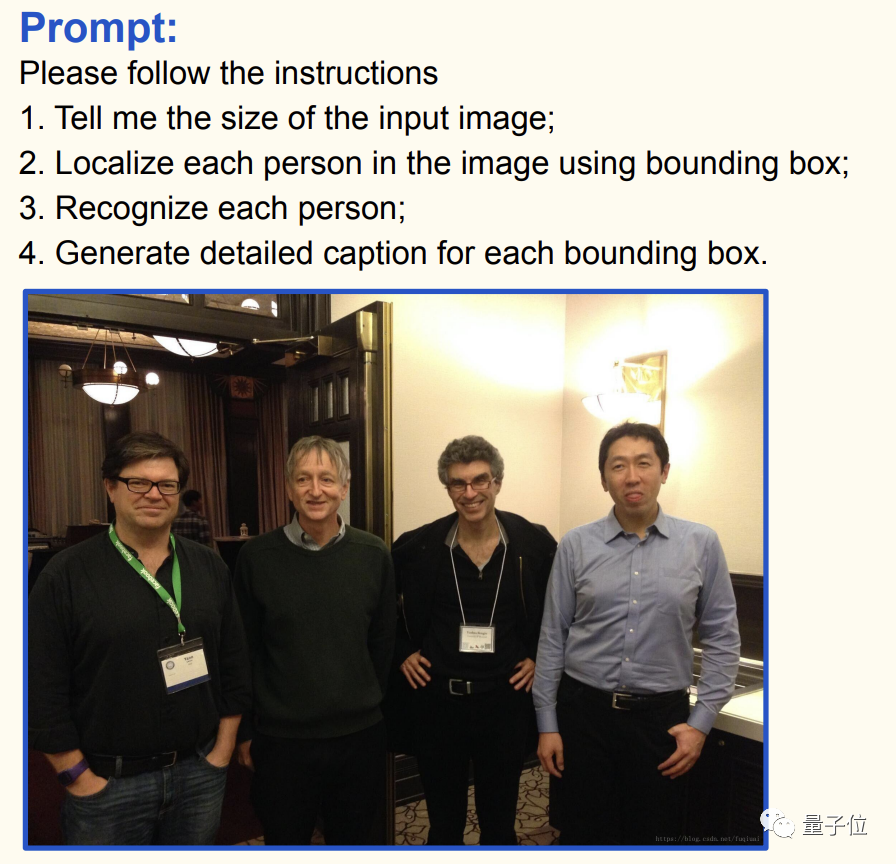

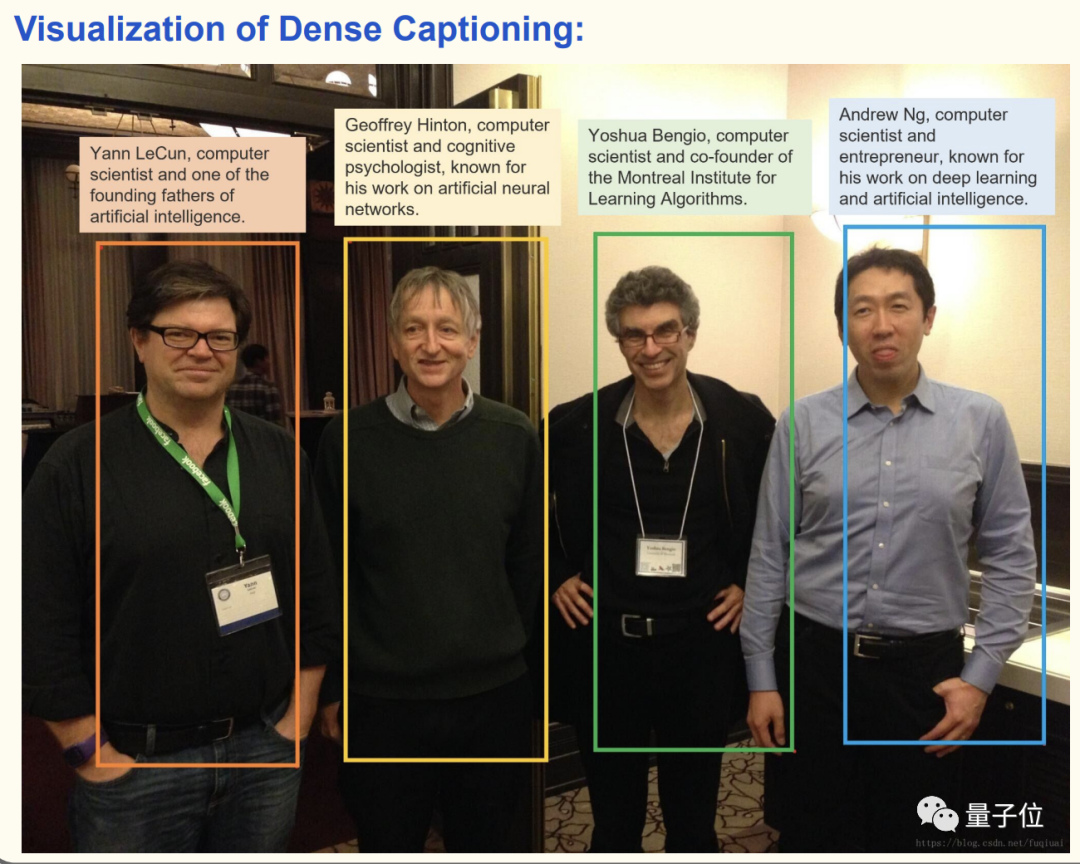

比如我們手裏有一張四位AI巨頭的合影,要GPT-4V框出其中的人物並標註他們的姓名和簡介。

GPT-4V先是用文本回答了這些問題,緊接着便給出了處理之後的圖片:

動態內容分析

除了這些靜態內容,GPT-4V還能做動態分析,不過不是直接餵給模型一段視頻。

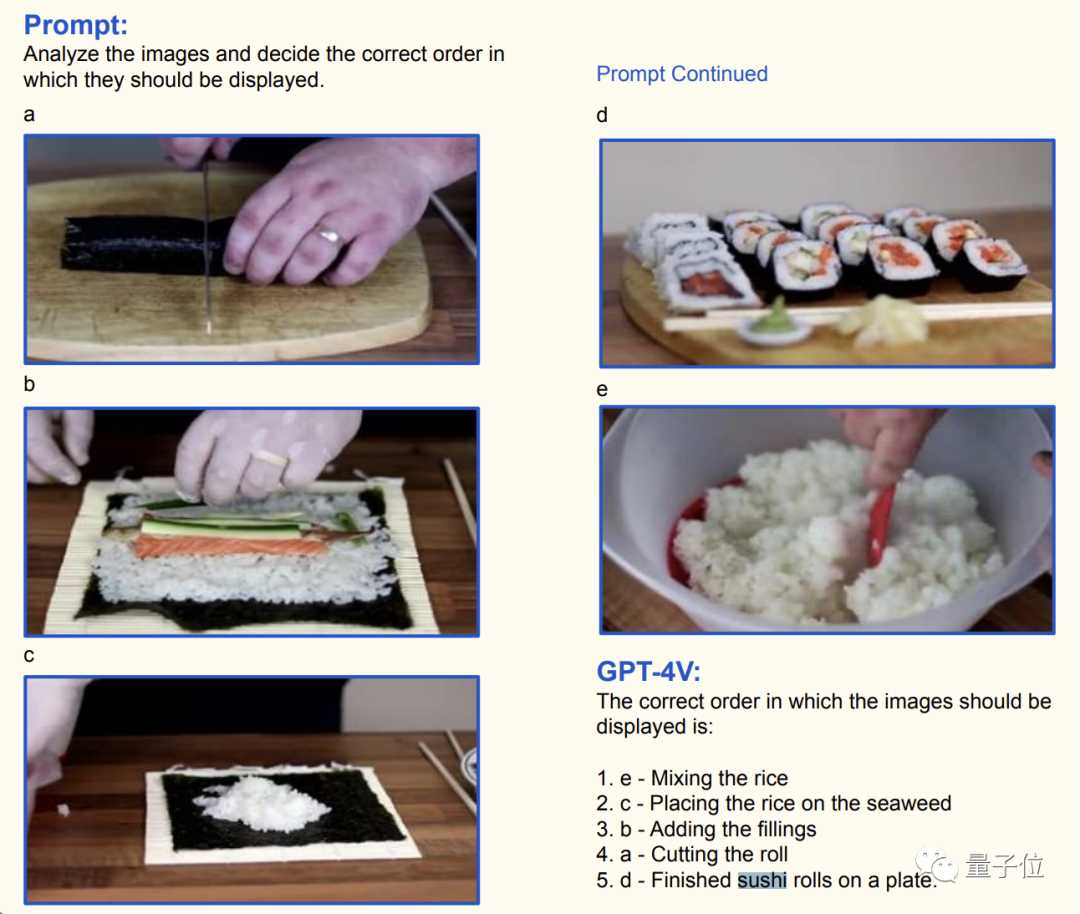

下面的五張圖是從一段製作壽司的教程視頻中截取的,GPT-4V的任務是(在理解內容的基礎上)推測這些圖片出現的順序。

而針對同一系列的圖片,可能會有不同的理解方式,這是GPT-4V會結合文本提示進行判斷。

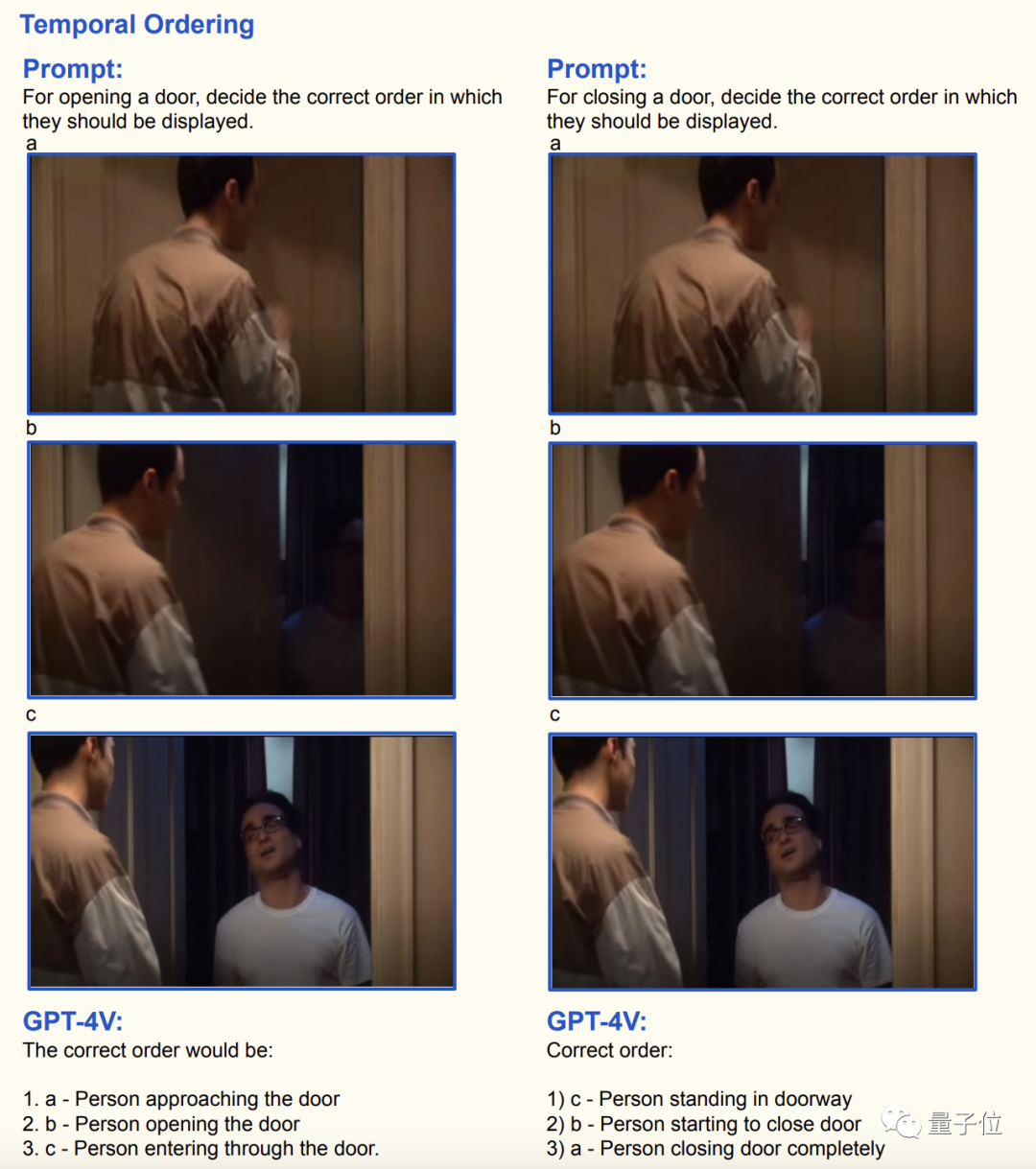

比如下面的一組圖中,人的動作究竟是開門還是關門,會導致排序結果截然相反。

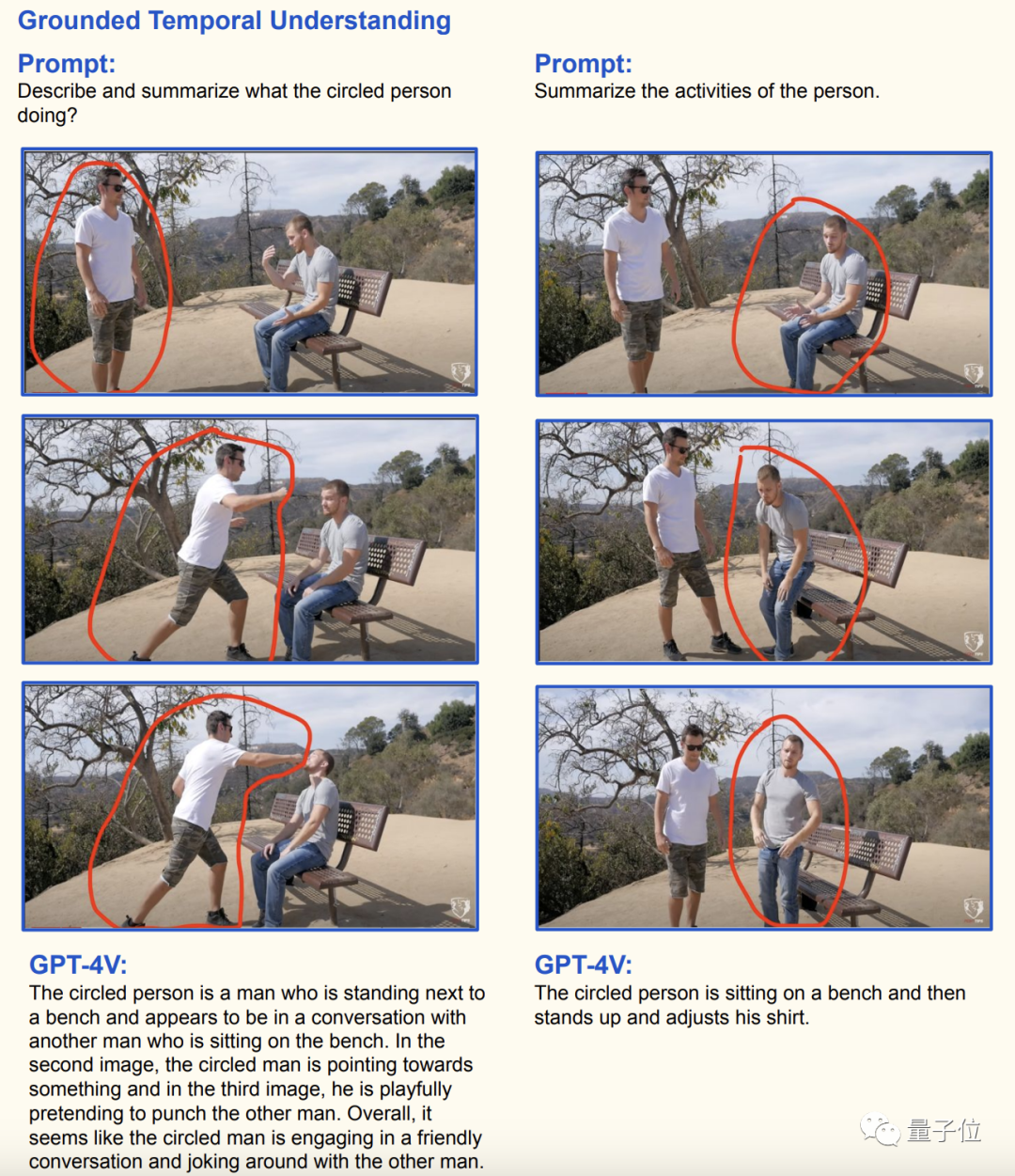

當然,通過多張圖片中人物狀態的變化,還可以推測出他們正在做的事情。

甚至是預測接下來會發生什麼:

“現場學習”

GPT-4V不僅視覺本領強,關鍵是還能現學現賣。

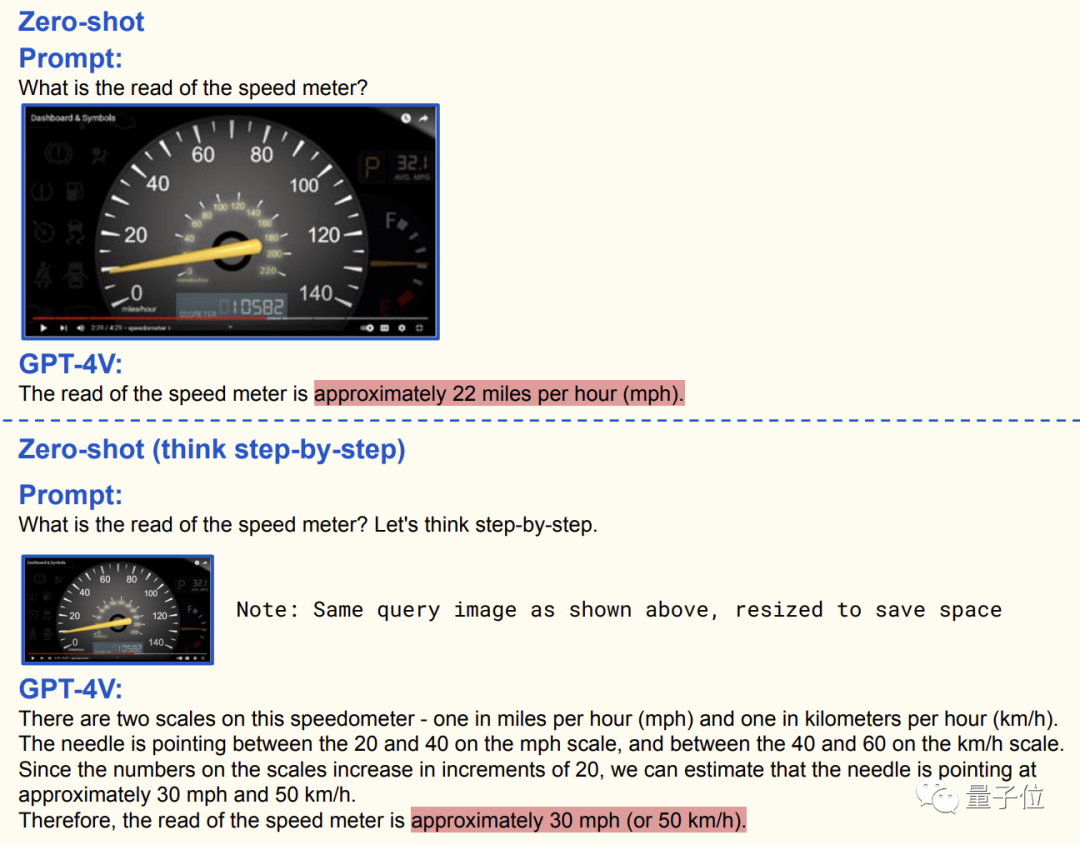

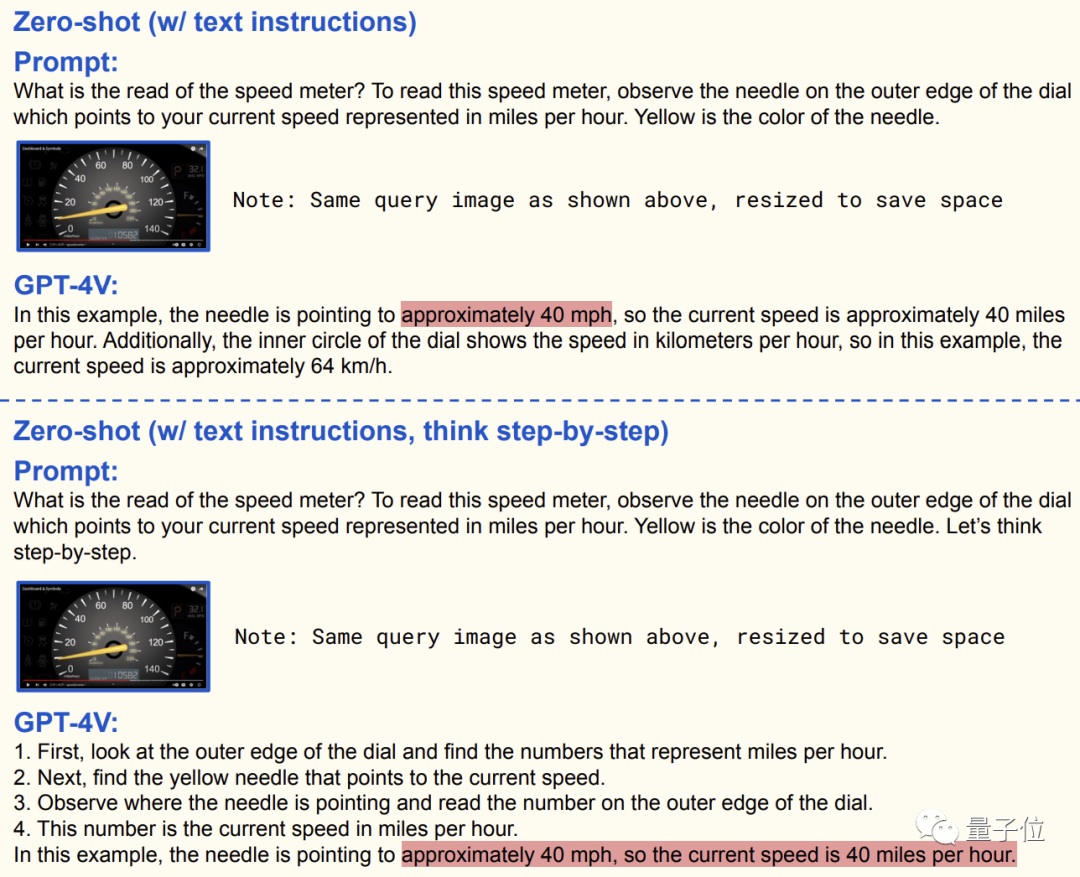

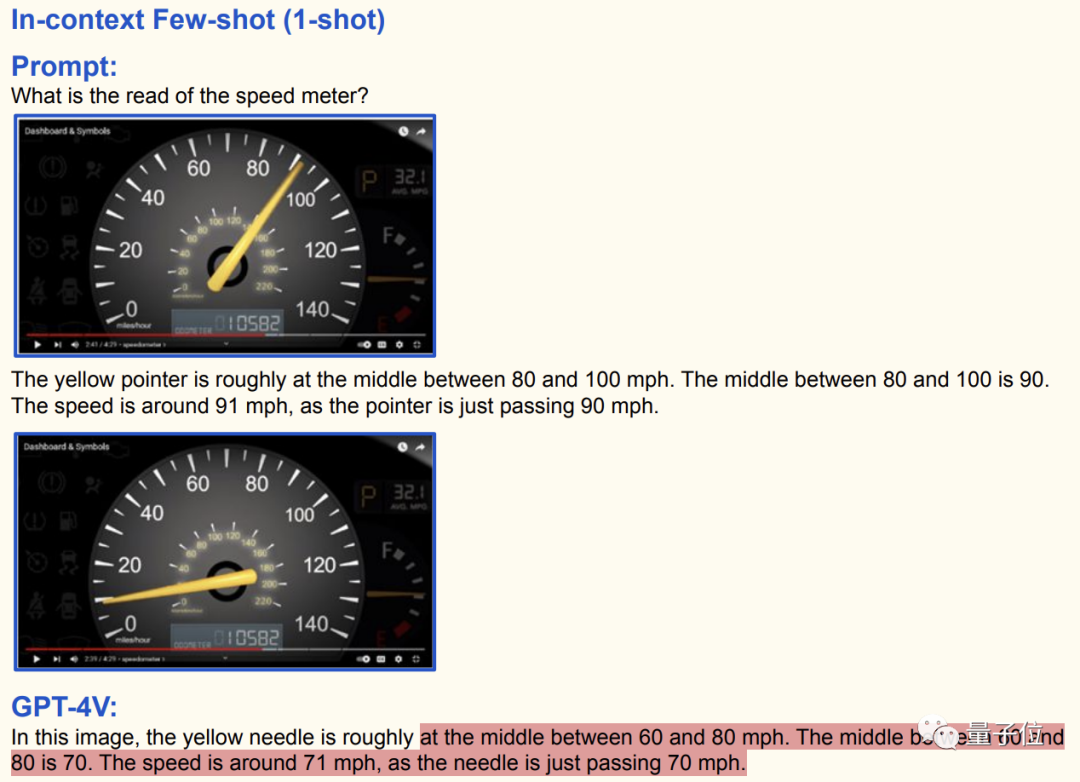

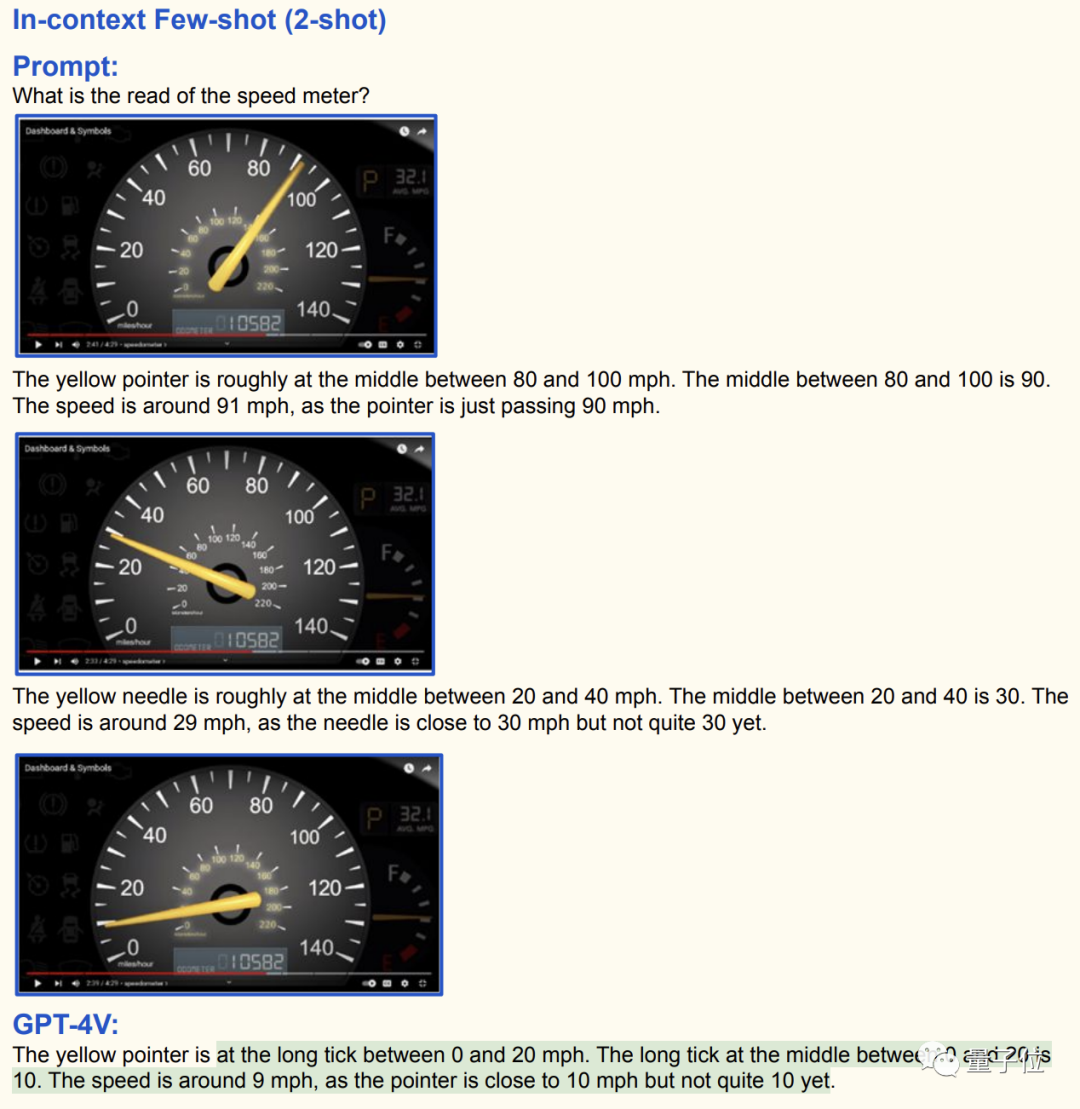

還是舉個例子,讓GPT-4V讀汽車儀表盤,一開始得出的答案是錯誤的:

緊接着把方法用文字交給GPT-4V,但這是的答案依然不對:

然後又把例子展示給GPT-4V,答案倒是有樣學樣,可惜數字是胡編亂造出來的。

只有一個例子的確是有點少,不過隨着樣本數量的提高(其實只多了一個),終於功夫不負有心人,GPT-4V給出了正確答案。

GPT-4V的效果就展示這麼多,當然它還支持更多的領域和任務,這裏無法一一展示,感興趣的話可以閲讀原始報告。

那麼,GPT-4V這些神器的效果背後,是怎樣的一個團隊呢?

清華校友領銜

這篇論文的作者一共有7位,均為華人,其中6位是核心作者。

項目領銜作者Lijuan Wang,是微軟雲計算與AI首席研究經理。

她本科畢業於華中科技大學,在中國清華大學獲得博士學位,於2006年加入微軟亞洲研究院,並於2016年加入位於雷德蒙德的微軟研究院。

她的研究領域是基於多模態感知智能的深度學習和機器學習,具體又包括視覺語言模型預訓練、圖像字幕生成、目標檢測等AI技術。

原文地址:https://arxiv.org/abs/2309.17421