阿里雲開源通義千問140億參數模型

(編輯/呂棟)

9月25日,阿里雲開源通義千問140億參數模型Qwen-14B及其對話模型Qwen-14B-Chat,免費可商用。據介紹,Qwen-14B在多個權威評測中超越同等規模模型,部分指標接近Llama2-70B。就在一個多月前,阿里雲開源70億參數模型Qwen-7B等,下載量已破百萬。

Qwen-14B是一款支持多種語言的高性能開源模型,相比同類模型使用了更多的高質量數據,整體訓練數據超過3萬億Token,使得模型具備更強大的推理、認知、規劃和記憶能力。Qwen-14B最大支持8k的上下文窗口長度。Qwen-14B-Chat是在基座模型上經過精細SFT得到的對話模型。藉助基座模型性能,Qwen-14B-Chat生成內容的準確度大幅提升。

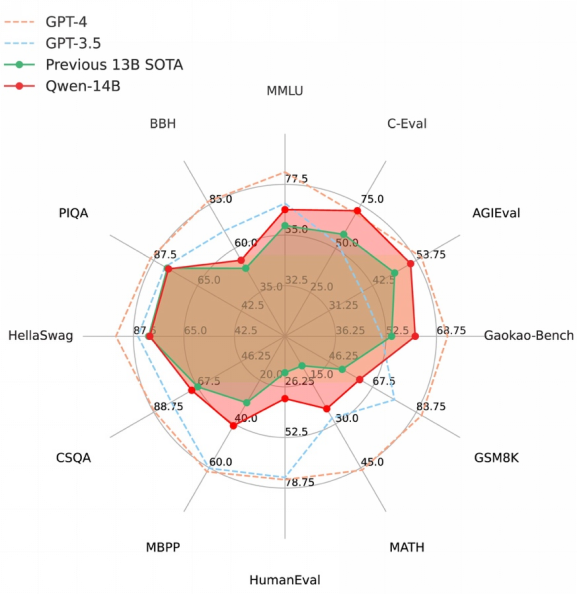

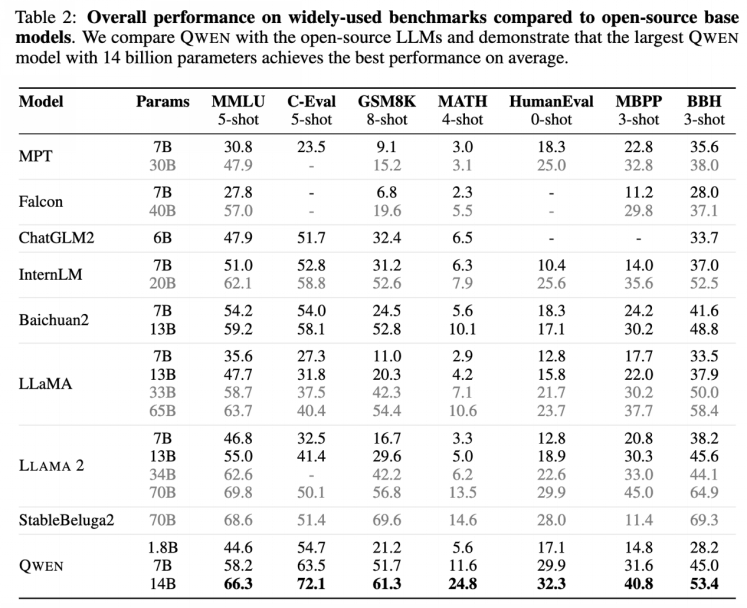

Qwen-14B在十二個權威測評中全方位超越同規模SOTA大模型

阿里雲表示,Qwen擁有出色的工具調用能力,能讓開發者更快地構建基於Qwen的Agent(智能體)。開發者可用簡單指令教會Qwen使用複雜工具,比如使用Code Interpreter工具執行Python代碼以進行復雜的數學計算、數據分析、圖表繪製等;還能開發具有多文檔問答、長文寫作等能力的“高級數字助理”。

百億以內參數級別大語言模型是目前開發者進行應用開發和迭代的主流選擇。阿里雲透露,Qwen-14B進一步提高了小尺寸模型的性能上限,在MMLU、C-Eval、GSM8K、MATH、GaoKao-Bench等12個權威測評中取得最優成績,超越所有測評中的SOTA(State-Of-The-Art)大模型,也全面超越Llama-2-13B,比起Llama 2的34B、70B模型也並不遜色。與此同時,Qwen-7B也全新升級,核心指標最高提升22.5%。

Qwen-14B性能超越同尺寸模型

目前,開源是國產大模型的主流選擇。《中國人工智能大模型地圖研究報告》顯示,超過一半國內發佈的大模型已實現開源,並朝着通用類大模型和垂直領域的專業類大模型兩個方向加速迭代。除了通義千問外,由王小川創立的人工智能創新科技公司百川智能也在一個月間將通用類開源模型參數規模翻倍。其在今年6月推出70億規模參數的Baichuan-7B開源模型後,又在7月開源擁有130億的參數規模的Baichuan-13B模型。

專業類大模型則受行業數據、適用程度等制約,開源模型參數規模差異較大。在搜索場景,知乎已於今年5月開源有100億參數規模的CPM-Bee 10b。而在金融行業,度小滿在9月才開源擁有70B參數量級和上下文長度可達8k以上的金融大模型“軒轅70B”。

有業內人士指出,在一些垂直領域並不需要參數量很高、通用能力很強的模型,幾十到百億左右參數規模的模型,結合垂直領域數據,就可以發揮很好的價值。對行業而言,開源大模型可以幫助用户簡化模型訓練和部署的過程,用户不必從頭訓練,只需下載預訓練好的模型並進行微調,就可快速構建高質量模型。這正是開源大模型推動各行業發展的底層因素。

阿里雲CTO周靖人表示,阿里雲將持續擁抱開源開放,推動中國大模型生態建設。阿里雲還牽頭建設了中國最大的AI模型開源社區魔搭ModelScope。過去兩個月內,魔搭社區的模型下載量從4500萬飆升到8500萬,增幅接近100%。