人工智能與“馬法”——《華爾街日報》

Yuval Levin

如果説2023年是人工智能技術狂野生長的一年,那麼2024年將成為政策制定者試圖馴服它的關鍵之年。對於見證過去數十年技術辯論的人來説,種種跡象已清晰可辨:行政機構的白皮書堆積如山,國會聽證會的節奏不斷加快,智庫專家們頻繁會晤,歐洲方面正越界施壓,而所有討論最終都指向那個最耀眼的議題——成立一個全新的監管機構。

建立人工智能政策框架固然重要。但正如這類時刻常發生的那樣,人們真正的擔憂對象卻模糊不清。專家們深陷技術細節的泥沼,政策制定者則迷失在抽象概念中。這種困惑情有可原——人工智能從來就是個難以界定的概念,它不過是用來描述計算機科學尚未完全實現之能力的標籤。科技企業家吉姆·曼茲講述過他在1980年代麻省理工學院選修人工智能課程時,教授開場幻燈片上赫然寫着:“能實際運行的,就不叫AI。”

2023年的顛覆性變化正在於此:某種被稱為AI的東西真的奏效了。本質上,這是一種通過訓練數據學習複雜模式,繼而根據這些模式對新數據做出預測的分析技術。在普通算力下,它可能只是預測短信中的下一個單詞;但當獲得海量數據和超強算力時,它就能生成媲美人類筆觸的流暢文本,對複雜指令做出近似人工創作的回應。這種能力同樣適用於圖像、視頻和音頻領域。

此類技術的潛力巨大。利用現有信息的深井,根據提示生成合理的下一步增量,這正是許多人類智能行為的表現。不僅知識本身,甚至許多領域專家的判斷力,也是長期接觸複雜信息模式後形成的產物。他們培養出一種直覺,能預知接下來應該或將會發生什麼。人工智能可以開發並應用類似的直覺,且規模更大、速度遠超大多數人類專家,而這種規模和速度只會持續增長。

從監管角度看,這一定義最顯著的特點在於其廣泛性。當今的人工智能屬於通用技術——一種可跨領域運用的信息處理和生成方法。其前景與風險將取決於它在無數不同領域的具體應用方式。這使得監管挑戰變得異常複雜,也提示我們應當從監管者已知的領域入手,而非未知領域。

政策制定者不妨以最近一次變革性通用技術——互聯網——作為參照。上世紀90年代,早期互聯網初具雛形時,人們曾熱議設立專門的網絡監管機構來應對其挑戰,正如現在專家們討論成立人工智能監管機構。政策制定者最終認識到,正因其通用屬性,監管應聚焦於互聯網觸及美國生活中那些重要或敏感到需要監管的領域。對互聯網的監管,最初主要通過美國政府現有機構體系展開。

1996年,美國第七巡迴上訴法院法官弗蘭克·伊斯特布魯克在著名論文《網絡空間與馬法》中闡述了這一觀點。伊斯特布魯克法官指出,在19世紀的美國,馬匹在生活的許多領域都至關重要——它們被買賣、需要獸醫護理、運輸人員和貨物、可能造成傷害等等。雖然制定了相關法律來規範這些活動,但都歸屬於現有的商法、職業許可和侵權索賠領域。若將這些法律整合到一個專門監管馬匹的機構或法院之下,那將是荒謬的。以這種方式監管互聯網同樣毫無意義。

如今人工智能也面臨同樣情況。設立一個擁有AI專業知識的政府機構,並期望其應對這項新技術將涉及的眾多領域,無異於緣木求魚。藥品安全、商標法、國家安全和消費者保護等領域已在各類行政機構、國會委員會工作人員和其他公共機構中積累了深厚的技術專長。相較於要求人工智能專家深入掌握所有這些領域的知識,現有機構更有能力權衡AI的風險與收益。

假以時日,AI或許會帶來我們目前難以想象的重大危險,屆時可能需要更專業的監管。互聯網的發展已驗證了這一點——網絡空間目前在兒童接觸社交媒體等方面確實存在監管不足。但若政策制定者三十年前就基於風險預測採取激進措施,不僅會嚴重誤判形勢,無法解決當前面臨的網絡問題,還會讓我們錯失諸多發展紅利。正如當下,在已受監管的領域針對具體問題採取對策,並根據實際需求調整,才是更為明智的做法。

這並非因為我們知曉人工智能將引領我們走向何方,恰恰是因為我們對此一無所知。要恰當地評估一項兼具巨大前景與新型風險潛力的全新技術,需要清晰的認知與謙卑的態度。當前關於AI的討論正需要更多這樣的品質。

萊文先生是美國企業研究所社會、文化與憲法研究主任,同時擔任《國家事務》雜誌編輯。

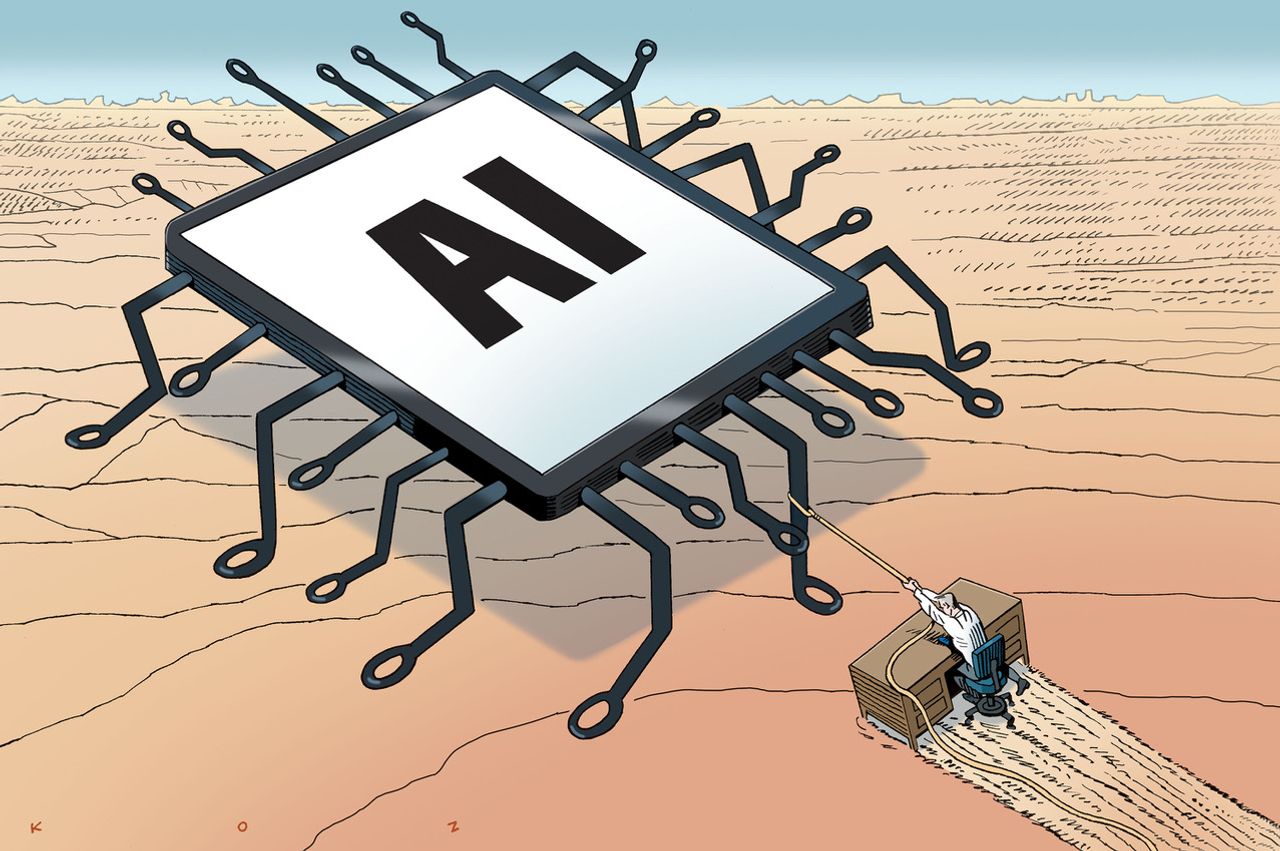

插圖:馬丁·科茲洛夫斯基本文發表於2023年12月22日印刷版,標題為《人工智能與"馬法"》

插圖:馬丁·科茲洛夫斯基本文發表於2023年12月22日印刷版,標題為《人工智能與"馬法"》