OpenAI發佈王炸級文生視頻,屬於作家的時代開啓_風聞

任易-清华大学硕士-微信公众号「任易」51分钟前

OpenAI再次碾壓了市場上的所有文生視頻企業,不服都不行。

作為大模型從業者,有一種我用盡全力還跟不上領頭羊的感覺,真的是深深的無力感。但是作為一個文字創作者,又充滿了興奮感,因為屬於作家的時代正在開啓。

文字工作者已經可以用100多個字作為提示詞來生成一幅圖片,比如這個來自日本的Prompt:

雪原を歩く巨大な毛むくじゃらのマンモスが描かれており、彼らの長い毛皮が風にそよいでいます。背景には雪に覆われた木々と、遠くに雪をかぶった壯大な山々が描かれています。午後の光とほのかな雲が温かな輝きを加え、低いカメラアングルからの視點が、これら大きな哺乳類の…

但是有了圖像,還想要生成視頻。我作為一個有技術功底的人,想做個3D視頻,還需要學習Unreal Engine,擺佈物體,擺放光源,讓人物走動,綁定表情和口唇,花大量時間去配置,需要的學習成本、時間成本實在太高,1000字的場景可能要花三天去做個Demo視頻,成本高到一箇中年人無法接受的程度。

幸好2024年出現了可靠的文生視頻技術。其實文生視頻已經有不少公司在搞,包括Runway、Pika,以及阿里雲推出來的一張圖生成跳舞視頻等等,試用過之後,還是沒法把我腦海裏的想象具現成視頻。

業界的原始方案,技術理念上也不復雜,就是逐幀生成連續動作的圖片,最後拼接在一起變成視頻,所以在2023年6月,我們會看見AI生成的視頻經常出現一閃一閃的效果,後來各家科技公司都在致力於消除這個效果。

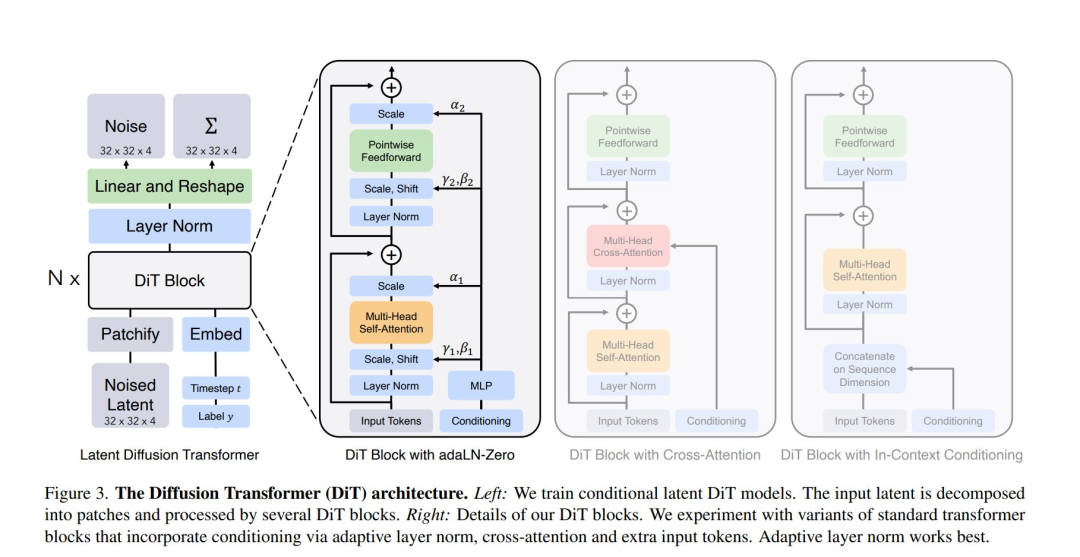

但是Openai這一次再次引領了一個新方向,也就是應用了Transformer。現在OpenAI Sora生成的視頻質量,跟業界其他產品相比,差別堪比大學生和小學生。比如剛才的猛獁象,openai就能生成一段穩定的、16:9的、高清的視頻。

隨着算力芯片的進一步發展,相信未來視頻畫質還能進一步增強,到那個時候,我們平民導演能夠拍攝的,就不會是簡單的二人小電影了。

未來短視頻平台,可能會再次爆發,利好抖音和快手。在AI Video時代,視頻的精緻程度,可能會變成最不重要的一環,而創意和有趣,會成為最有價值的賣點。

這就是技術平民化的價值。現在以Openai為引領,以頂尖名校為主力,以開源社區為基礎的AI大爆發,就是在把過去被牢牢把持在頂尖科技公司手裏的技術,快速普及到平民百姓家。

比如我一直在追《非人哉》,這個動畫很有趣,但是並不算是逐幀都非常精細的動畫,可惜這個動畫片兩三年才更新一季;如果有AI輔助創作者生成線稿、本子,再生成視頻,我是不是有可能每年追上一季?

如果創作者在AI的幫助下,產出效率極大提升,是不是有可能每天出上一集?對於那些有才華、沒有團隊、缺少投資的導演,完全可以創造出更驚豔的作品。

比如導演的説戲,就完全可以把自己的想法,先用AI生成一個Demo,給各位主要演員看清楚,這樣是不是能夠減少NG的次數?另外,這個技術並不利好現在一茬茬出來的新人小鮮肉和小花,因為他們的可替代性太強了,何況還有塌房風險。

如果導演一個人,再拉上一個技術人員,一個勤務人員,完全有可能管理好十個甚至上百個AI,那導演不僅可以做到令行禁止,還能顯著提高效率。

如果導演需要的投資變少了,那導演還需要捏着鼻子接受投資人安排過來的關係演員麼?如果AI塑造的演員角色比真人更聽話,更好調教,那導演還需要花每日一爽的價格聘請明星麼?

所以,隨着openai Sora展示出了生成一分鐘高保真視頻的能力,我堅信,這個技術會極大程度地顛覆影視行業和自媒體行業。

也許未來有一天,像我們這樣的普通作者,能夠僅僅從自己的作品中創作長篇電影,最終把對藝術和影片的解釋權,從好萊塢手裏奪走,講述我們自己的創意和自己的故事,每一個人都有能力去具現自己的想象。

開源精神萬歲

我在2023年,主要是以大模型訓練和大模型應用為主,等到自己開始動手做了,體會到創新的難度之後,現在我對OpenAI團隊全是仰慕,他們才代表了先進生產力的發展方向,不得不服。

什麼是開宗立派?就在於領先者探索出來一條有可能走得通的路,然後跟隨者看到了成果,堅定了信心,全球的才智之士都會繼續沿着這條路走下去。OpenAI做出的最大貢獻,就是開宗立派,隨後開源社區開始大規模跟上,並且提供了很多新的Idea。

而Openai Sora的方案,最大的特點是利用Transformer+Diffusion生成視頻,連續生成了30幀×60秒的視頻,也就是1800張圖片。

這個思路的創新點在於Transformer,這也不是OpenAI的首創,而是來自開源社區。前幾天 Berkeley 做的 LWM,也是拿 Transformer 來做視頻生成的方案。

到了今天我才明白為什麼meta要開源llama,顯著加速了開源社區在大模型領域的發展,原因就在於大模型這個東西發展到精確可控的文生視頻之後,再加上新一代的AR頭盔,而且吸引更多的開源團隊加入,真的有可能進一步催熟元宇宙。

openai首先靠大力出奇跡,搞出來首個1750億參數的大模型GPT-3,然後搞出來首個MOE架構的1750億參數大模型GPT-4,接着搞出來Function Call(功能調用)和agent,再次引領潮流。

隨後在文生圖領域拿出了DallE,誕生就是巔峯。然後又重新定義了在文生視頻領域後來居上,SORA從出生就碾壓了所有同類公司。

在AI領域,openai幹成的事情,製造的影響力,簡直比最近三十年各家科技公司都大,因為他讓普通用户體會到科技的力量,而且能引領着開源社區形成大模型創新上的合力,這才是科技以人為本的樣子。

技術創新都是雙刃劍。從2024年開始,大家必須需要掌握鑑別AI造假的能力,技術從來都是雙刃劍,發展到現在這個程度,用DeepFace、FaceFusion來給視頻換臉,然後用SoVITS克隆人聲,普通人完全可以輕易做出來一段假視頻,那時候有圖有視頻都不算真相了。

我在我的深度搜索課裏也曾經講過,孤證不立。如果只是利益相關方提供的一段視頻,沒有官方攝像頭作為印證,沒有其他在現場的人拍攝的視頻作為印證,沒有行人,沒有車輛,沒有可供驗證的地標,時間和光線角度不符;哪怕視頻看起來再真,也不能相信。連視頻都不能相信,那就更不能相信錄音和語音電話的真實性了。

但是,就算AI生成視頻是把雙刃劍,但是他帶來的便利,遠超過他帶來的風險。畢竟君子生非異也,善假於物也。大家必須在2024年學會,把大模型應用在你的工作流程中,否則你會被那些善用AI的人在效率上碾壓。

繼續保持謹慎樂觀。