都笨成這樣了,這個機器人為什麼還很重要?_風聞

酷玩实验室-酷玩实验室官方账号-31分钟前

舊金山的廣場、海邊、街頭,一個無頭機器人邁着僵硬的步伐踽踽獨行,同時它的手臂也以相同的頻率擺動。

這個不起眼的機器人,卻引起了SORA團隊的注意。

他們一個誇它牛逼,一個説它把AI帶入了現實。

説實話,看到這個機器人的視頻時,我的內心是毫無波瀾的。雖然這是一個來自著名的加州大學伯克利分校的團隊,但這步子僵硬且機械,似乎只能用一種頻率和幅度邁開,手臂也是一樣,而設計者甚至潦草到不給它裝個腦袋。

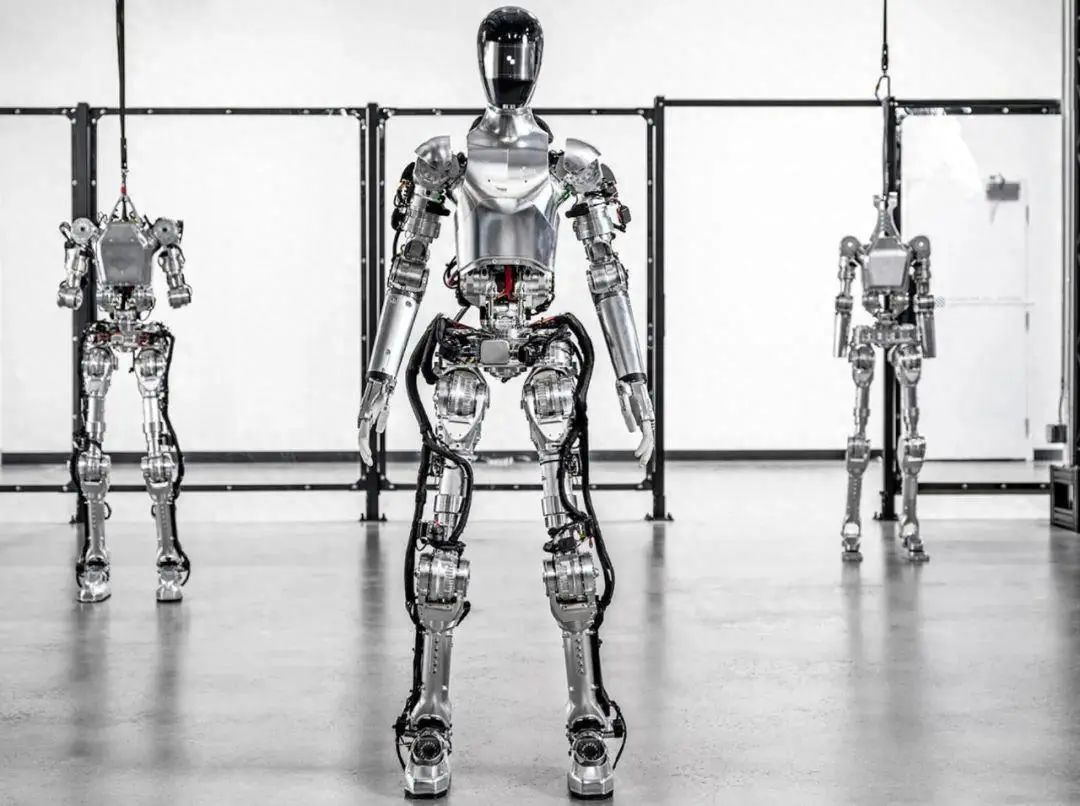

要知道,隔壁特斯拉的Optimus正在把玩雞蛋,Figure熟練地倒咖啡,而波士頓動力的ATLAS都開始跑酷了。

那Sora的人到底在吹什麼呢?它那蹩腳的步伐裏又藏着什麼意義?

簡單的説,因為加州大學伯克利分校的這篇論文,我們在科幻電影裏經常看到的,那個人形機器人與人類共存的時代可能很快就要來了。

01

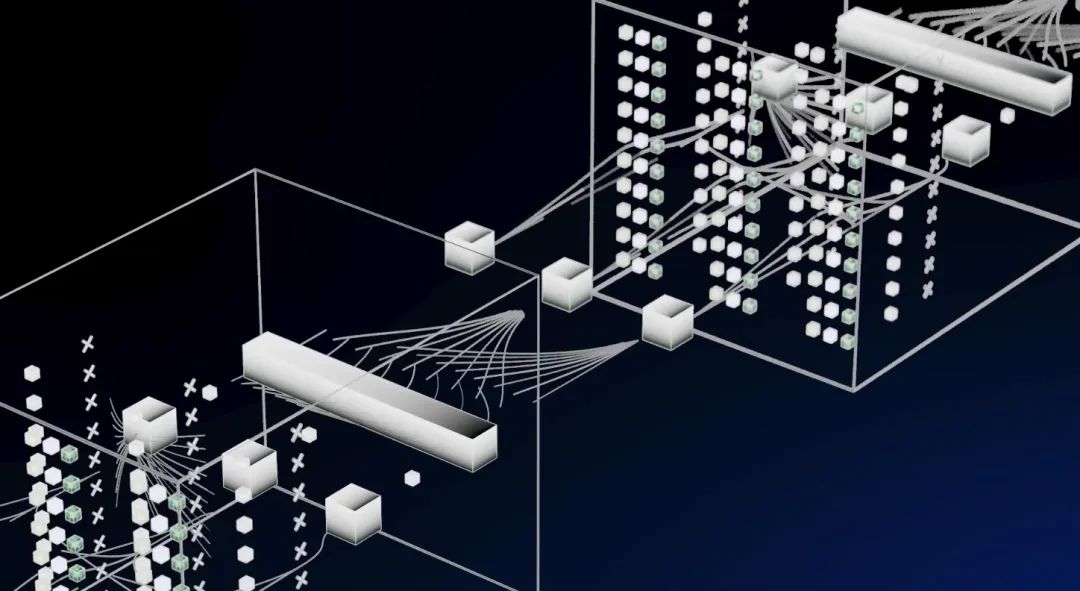

在他們的論文一開始,我就看到了一個熟悉的名字:Transformer。

我不禁收起了看樂子的心態,開始認真研究起來。

要知道這可是Transformer,搞出了GPT和Sora的Transformer。

不過,Transformer此前都是在搞文本和圖像方面的研究,它是怎麼用來訓練機器人運動的?

要理解這個問題,我們得首先知道機器人是如何運動的。

在機器人領域,通常把這三部分叫做感知層、決策層和執行層。

拿人來類比,感知層就相當於人體的眼睛、鼻子、耳朵、皮膚等一切感官;決策層就相當於大腦和脊髓組成中樞神經系統,負責對接收到的信息綜合處理,且對將要執行的動作進行規劃。執行層則相當於肌肉和骨骼,完成相應的動作;

人做一個動作是很輕鬆的。但對機器人而言,不論是從感知到決策,還是從決策到執行,都不是一件容易的事情。

比如簡簡單單邁一步,我需要根據視覺信息去繪製數字空間,決策層根據數字空間去規劃機器人每一部分的運動軌跡,要邁多大的步子,什麼樣的速度,運動時如何保持平衡等等,然後決策層將這些考慮因素輸出成機器人各部位能夠執行的指令傳遞出去。

在以往的機器人設計當中,這部分的指令是需要程序員人工編程的,而且是每一種可能遇到的情況,比如地面軟了、地面滑了、前高後低了、前低後高了,等等等等,都需要對每一個關節,每一台電機,重新編程。

程序員可以考慮一萬種情況,但一旦出現第一萬零一種情況,就需要重新單獨編程。

這也是為什麼,ATLAS永遠活在視頻裏,並且好幾個月才出現一次。因為換個動作,換個環境,它就會歇菜。

但請注意了,開頭這個邁着蹩腳步伐,在海邊、街道、廣場走的無頭機器人,它能適應從未見過的新情況,並且只用了27個小時的數據就訓練到了目前的程度!

02

為什麼Transformer的加入能帶來這個變化?

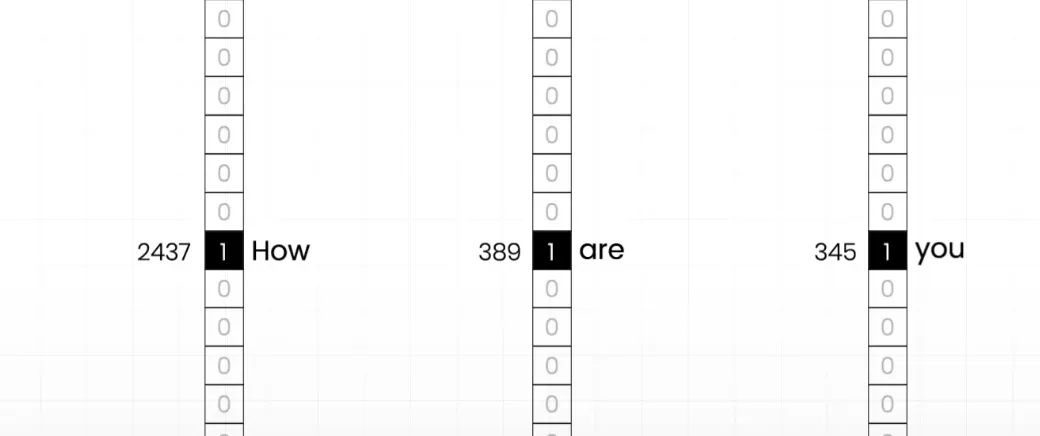

其實它本身的底層邏輯很簡單,就是在一段文字之後,不停地接下一個單詞,從而形成一整段的文字。

在Transformer出現前,這一領域中最熱門的模型是RNN。

RNN在做單詞接龍時同樣也會考慮到上下文,且它的網絡結構比Transformer更加精細,但當它的規模一大,就會出現自身無法解決的系統性問題。

因為當你在接龍時必須考慮到上下文,RNN的上下文信息是像擊鼓傳花一樣,從句子開頭傳到末尾,當上下文信息沒傳到句末,就沒法接詞,所以RNN難做並行運算,計算效率很低。

相比之下,Transformer的上下文信息是計算句末的詞與所有詞的關係得到,非常直給,也很容易規模化。

當你把規模做到一定程度,比如像ChatGPT3.5那樣的1750億參數,它就表現出遠超RNN的能力,不僅話語通順,還可以呈現出豐富的知識,很高的邏輯性和情商,跟用户對答如流。

那麼伯克利這個團隊是怎麼用Transformer的呢?

在該團隊的論文的摘要中,他們將“現實世界的人形機器人控制問題視為一個預測下一個token的問題。

簡單來説,機器人的運動就像一串文字,下一時刻該怎麼動,就類似下一個詞語該怎麼接。

他們的研究帶來了兩個巨大的改變:

第一,機器人不再單純地“模仿”了。

正如當Transformer的參數量大到一定程度後“智能”突然湧現出來一樣,這個機器人不僅能夠在從未訓練過的場景裏行走,還能做出“倒退”這樣訓練中從沒出現過的動作。

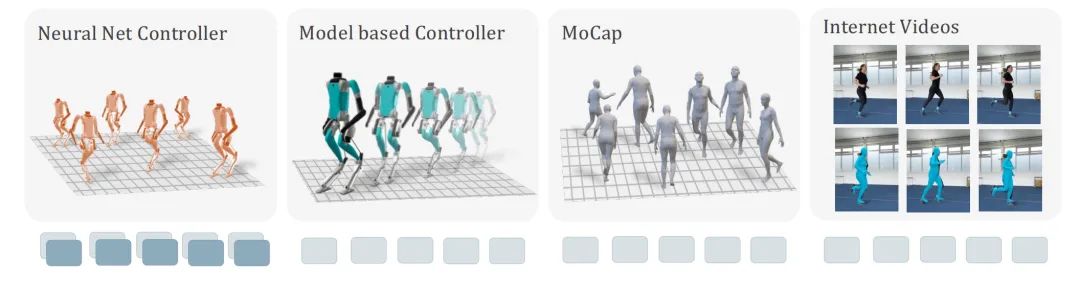

第二,他們搞定了規模做大的必需品,大規模的訓練數據。

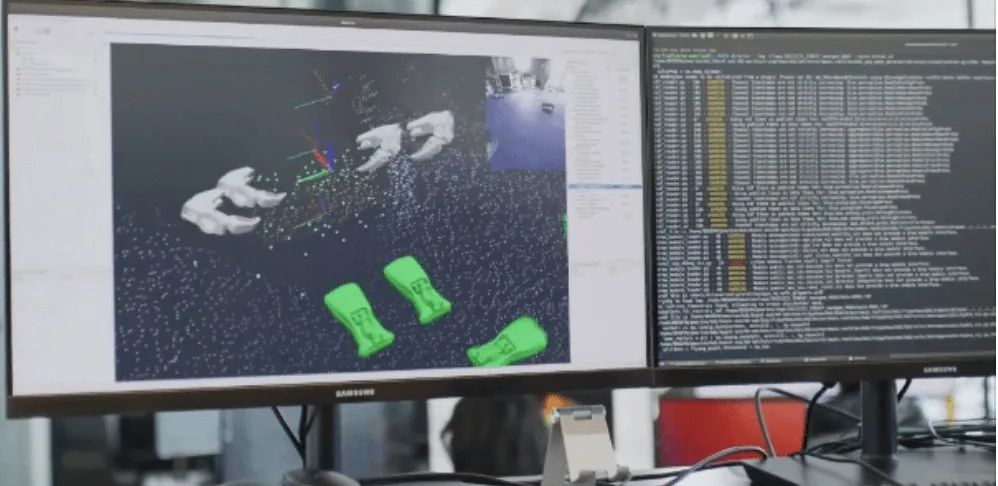

他們的訓練數據有四大來源:先前的神經網絡,基於模型的控制器,運動捕捉,以及YouTube上的人類視頻。

好傢伙,直接能把油管視頻拿來用了?

他們還真用了,不過不是直接把視頻扔進去訓練,而是得先把這些視頻“洗”一遍,也就是把這些視頻裏的人抽象成3D數字人,然後再拿去訓練。

要知道,同樣用了Transformer的GPT,正是用了從網絡中提取而來的大規模文本數據,才實現了規模效應,成長為今天這個樣子的。

這篇論文中,他們同樣發現,運用在機器人領域的Transformer,同樣具有規模效應。隨着數據量和參數規模的增大,預測的錯誤率都得到了很明顯的下降。

而這意味着,當規模大到一定程度,就像GPT-4能翻譯,能做題還能寫小説一樣,機器人不僅能適應全場景,而且能在手、頭、腰等多個部分有更加自然的動作。

03

我相信很多人都想象過,人與非常像人的機器人共生的世界。

在那個世界,機器人會代替我們去做任何我們不想幹的事兒,養老和單身也再也不會成為問題。另一方面,我們也需要時刻提防機器人可能的“起義”,“暴動”。

2024年是智能機器人成為風口的一年。

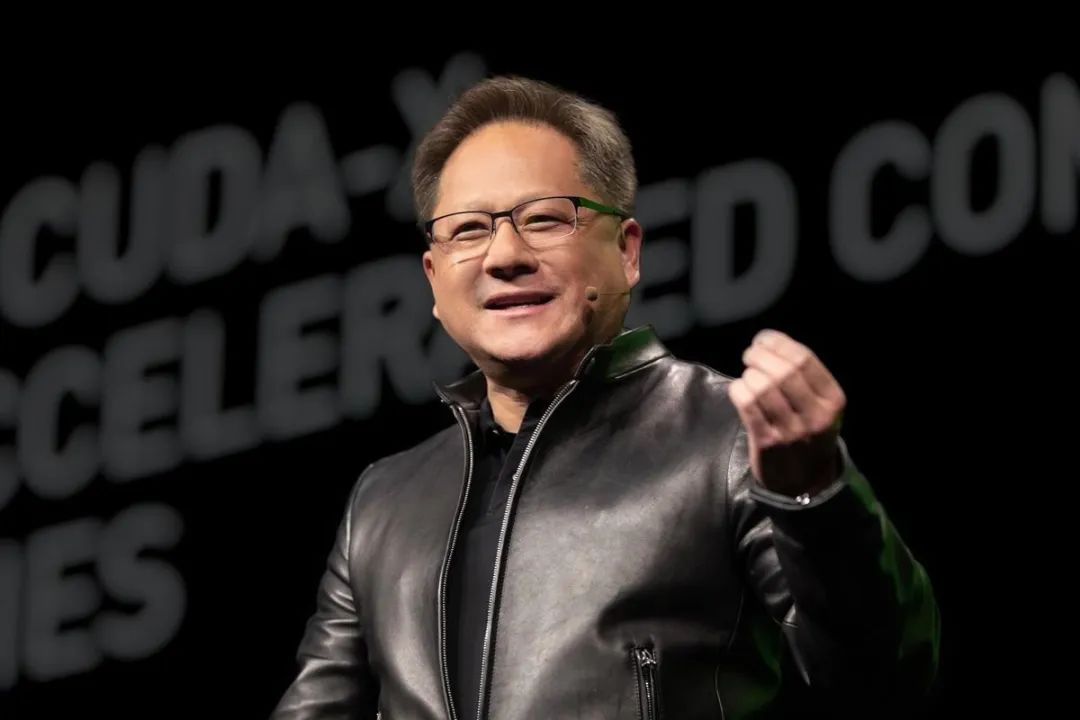

英偉達的CEO黃仁勳説機器人基礎模型可能即將出現,“從那時起,五年後,將看到一些非常令人驚奇的事情”。

開發通用人形機器人的AI機器人公司Figure AI,2月29日在B輪融資中籌集了6.75億美元,估值為26億美元,其投資者包括了微軟、OpenAI、英偉達、亞馬遜的CEO貝佐斯等多個處於硅谷金字塔尖的玩家。

OpenAI更是直接跟Figure達成合作協議,準備把多模態模型拓展到機器人身上。

這些引領着科技進步的勢力在人形機器人上看到了未來。

美國著名的科學哲學家托馬斯·庫恩在他的著作《科學革命的結構》中提出了“範式轉換”一詞。當科學的範式發生轉換,結果就是科學革命。

2017年,Transformer出現後,橫掃了自然語言領域,成為了新的範式,自此AI界發生了巨大變化,如今我們生活中遇到的幾乎所有知名AI,包括GPT、Claude、Sora、文心一言、華為的盤古、阿里的通義千問等等,全都採用了Transformer架構。

現在,它要準備征服機器人界了。

那一天,要來了嗎?