對標Sora,GPT4o,被截胡的谷歌開始反擊_風聞

酷玩实验室-酷玩实验室官方账号-1小时前

好傢伙,這兩天的硅谷比我老家的大集都熱鬧。

每年5月份的都是谷歌I/O大會主場,最新版本的安卓,谷歌最新的AI都是在I/O大會上發佈的,沒想到就在I/O大會前一天,OpenAI來了個截胡,讓自家的新模型GPT4o刷了屏。

但從今天凌晨的I/O來看,谷歌還是那個橫貫硅谷25年的老大哥,不僅帶來了和GPT4o同樣效果的個人助理,甚至還帶來了反擊Sora的Veo模型。不過我認為接連兩場的發佈會,更重要的是向全世界展示了硅谷的大廠們,正在用AI做一些什麼。

GPT4o?谷歌:我也有

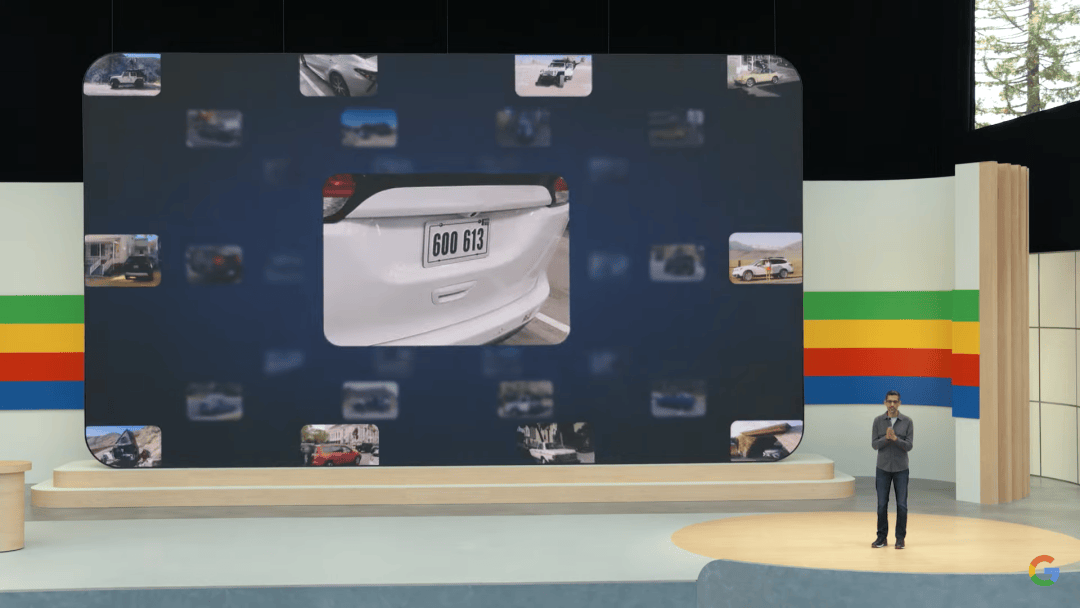

劈柴(谷歌CEO的中文諢名)上來沒講技術,直接"duang,duang"展示了幾個AI在谷歌應用中的案例,比如在谷歌相冊中,當你忘了自己車的牌照,就可以直接問AI,它會幫你從存在谷歌相冊中的所有照片尋找車牌的照片,當你想查看自家小孩的游泳成長曆程,谷歌相冊也會幫你按順序排好。

谷歌相冊能有這般能力,都是基於自家的Gemini大模型,期間劈柴一直強調,自家的Gemini是原生的多模態大模型,這背後針對的是誰,OpenAI和它的GPT4o最清楚。

劈柴統領全文後,就是谷歌的各個部門負責人上來演講了,與前幾年大不同,這次DeepMind率先登場,這支打造出AlphaGo而舉世聞名的團隊,今年已經和谷歌其它AI研究團隊徹底完成整合,成為了目前谷歌公司中,唯一研發AI的部門。

這也是DeepMind首次登上I/O,出場即巔峯,可以看出谷歌對於AI的重視。DeepMind也未辜負眾望,甩出了兩個王炸——Project Astra和Veo。

Project Astra是谷歌目前打造AI助理的計劃,按照谷歌的想法,未來的AI助理,不止是通過文字和人類交流,它應該能看人類所看,聽人類所聽,並且反應迅速,不能有延遲感。這不就是GPT4o麼?這針鋒相對的味道,太沖了。下面是Project Astra的演示視頻,強烈推薦觀看,尤其是找眼鏡那段,絕了!並且,這次谷歌也吸取了Gemini發佈時教訓,特意強調,這是一鏡到底的視頻。

接下來,還介紹了最新的Imagen3文生圖模型,效果確實不錯,但也沒有到領先Midjourney,Dall-E的地步。同樣的情況也發生在音樂模型上。只不過到了視頻模型Veo這裏,谷歌的聲音就大了很多。

下面這個視頻是由Veo生成的,老爺們可以先看看。Veo目前可以生成高品質,1080P,超過1分鐘時長的視頻。這1分多鐘可以是由一句提示詞生成,也可以是由多個提示詞組而生成。下面演示的這個視頻就是由4個提示詞組生成的。不知道大家感覺怎麼樣,整體看下來,我覺得它已經超過目前的Runway,但是和Sora相比,還略遜一點,但Veo優勢在它支持多個提示詞,來生成一個長視頻,這是Sora目前做不到的一點。

總之,牌桌上多一個玩家,肯定是用户收益,希望能早點用上這樣的視頻模型吧。

Gemini:更快,更長,更便宜

自從谷歌放棄了PaLM和Bard,轉投到Gemini下,這個模型的成長速度飛快。一年多的時間,已經進化到1.5版本了。這次I/O上,谷歌把Gemini1.5 Pro版本的大模型進行了蒸餾,推出了Gemini1.5 Flash版。這個版本的相應速度更快,每Token的價格更便宜,但是處理複雜問題的時候,就不如Pro版了。也就是説,這是介於Nano和Pro版本之間的一個模型。按照老羅的話説,谷歌現在有了,小杯(Nano),中杯(Flash),大杯(Pro)和超大杯(Ultra)。

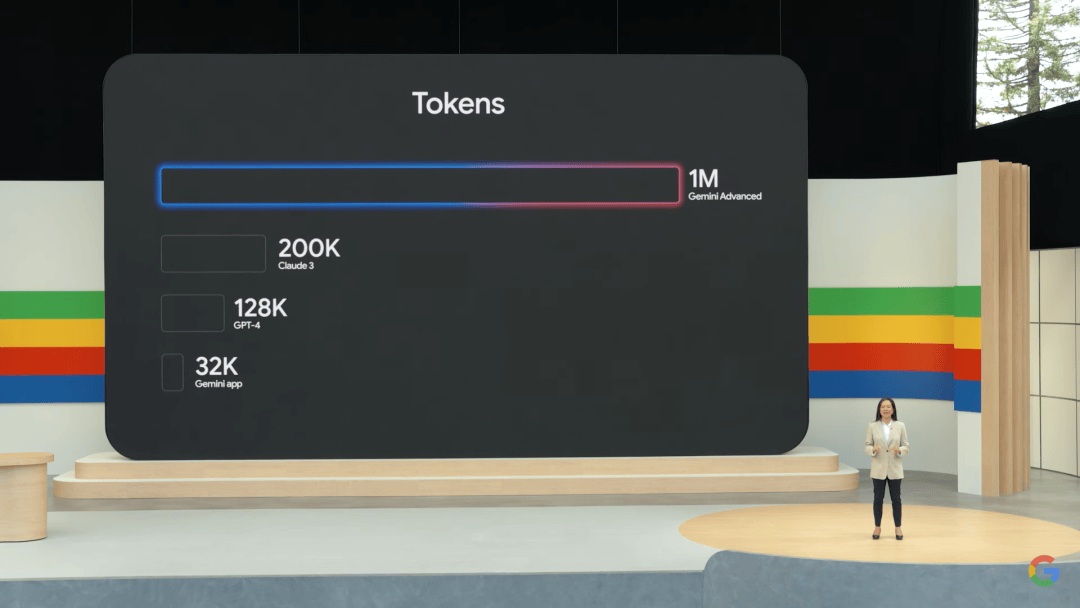

Gemini除了增加型號,在單個窗口的Token數量上也是猛增,目前單次對話已經支持到一百萬了。這是什麼概念呢?你可以上傳1500頁的PDF,或30000行的代碼,甚至是1個小時的視頻,AI都可以對上面這些數據進行分析。這也是目前大模型當中,唯一支持一百萬Token對話的,可以説是遙遙領先了。不過谷歌似乎還不滿足,劈柴説今後會把這個數字提升到兩百萬!

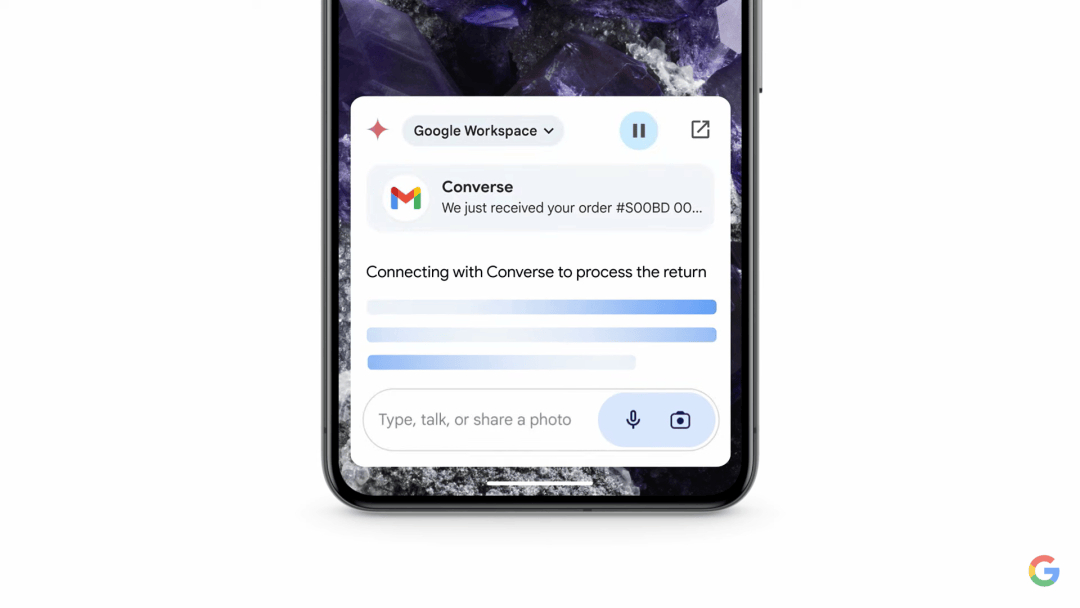

AI已經滲透到谷歌產品血液中I/O剩下的部分都是在講AI如何和自家產品結合的。我這裏舉幾個例子,大家感受下。當你網購的鞋子,尺碼小了,只需要跟AI説一聲,Gemini會自動從你的郵箱裏獲取訂單信息,從裏面分析出退貨地址,然後自動從快遞官網給你下單取貨,你唯一要做的,就是在最後確認下運費的價格。

遇到不會的問題,打開搜索引擎輸入文字或圖片是最常見的做法,而現在有了Gemini的加持,谷歌已經可以根據視頻來搜索回答問題了。比如I/O中的演示:眼前的黑膠唱機不工作了,支臂不停的"抽搐",把這段錄下來,發給谷歌,就會得到相應的解決辦法。

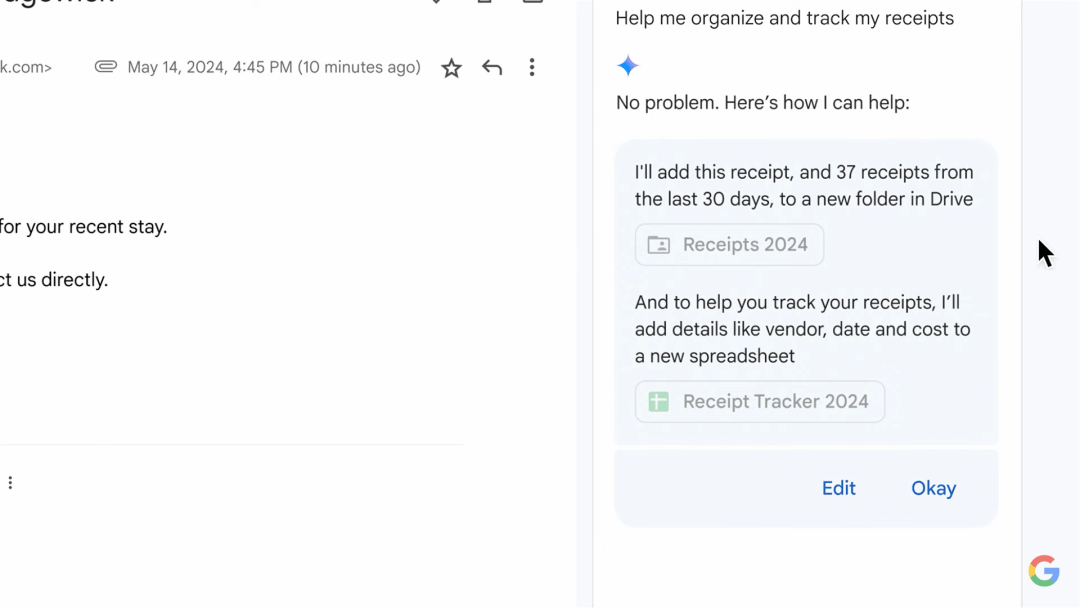

另外一個令我印象深刻的例子,就是谷歌家的多APP聯動,演示中,郵箱中塞滿了來自客户的賬單,Gemini站出來,直接就幫助把這些賬單用Excel給列好了,並且分類非常清楚,還會把相應的賬單照片放到雲盤裏歸類好。

説到這,日常很少用Email的老爺們可能感受不深,這樣想一下,你是個個體户老闆,每天微信上都有收不完的轉賬,以前你還得拿小本本記,在截屏備份,有了AI後,它把每一筆收款的都記錄到Excel中,並且都誰給的,什麼時間,買了啥都分類記好,然後再把截屏備份,放在一個AI創建好帶有日期的文件夾內。這是不是很爽?

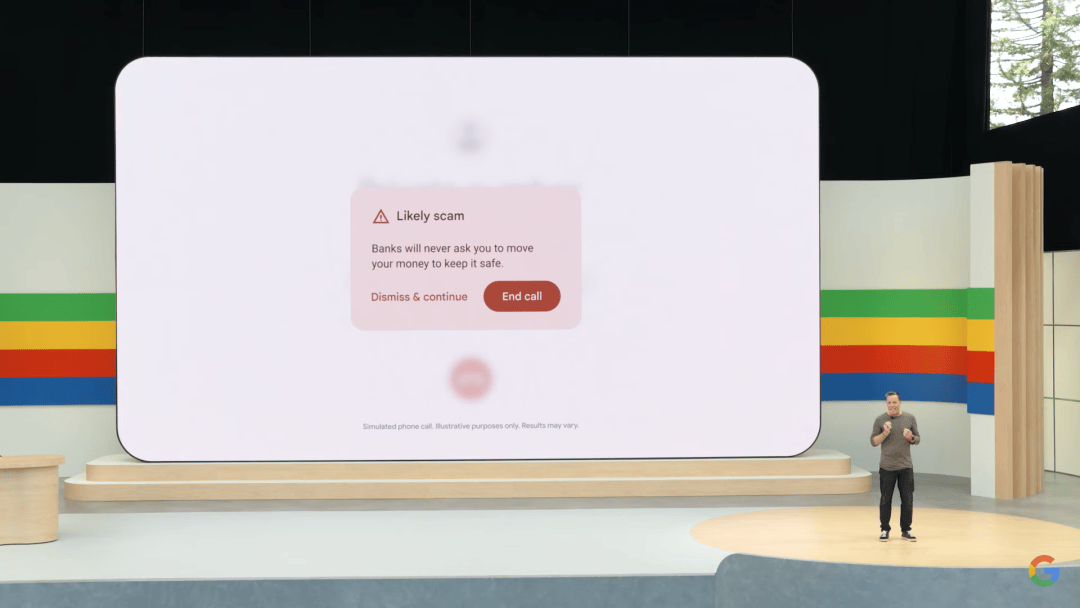

最後一個例子就是關於通話的,當AI檢測到你通話中有詐騙話術的時候,會跳出窗口提示你——目前的通話中疑似詐騙,銀行不會讓你轉移資金,建議掛斷電話。

能把AI集成到如此多的APP中,縱觀世界上,目前也只有谷歌一家能做到這一點。安卓,Gmail,Youtube,WorkSpace不僅市佔率非常高,並且基本上貫通了日常用的場景,像OpenAI,它要想做到以上,需要一家,一家的敲開其它APP大門才可以。

我們到底需要怎麼樣的AI?大家有沒有發現,AI進化的速度慢下來了,GPT5遲遲不見蹤影,其他家也沒有什麼更聰明的模型出來,這是為啥?

根據ScalingLaw來看,想要更強大的模型,需要從數據,算法,算力來看,目前AI基本上已經把互聯網上的資料"吃幹抹淨",算法沒有大突破,算力部署也被能源所限制。這麼一看,我們離那種高智商AI還有很遙遠的距離,對吧?

但是,我們真的需要如此的AI麼?我想説出一個逆天回答:大多數的情況下,可能不需要!

以我用GPT4的經驗來看,關於知識類的回答,它已經有百分之90的正確率,也就是説你問它任何一個問題,它都可以以本科生的水平來回答你。只是對於數學等強邏輯回答,它還是個初中生。但對於日常生活來講,解數學題不是其中的主旋律,如何讓AI參與到其中才是。

OpenAI的GPT4o以及今天的Project Astra都是大廠們給出的類似解,現在的AI應該在更多的感官途徑上展示出的它的能力。

而今天谷歌另外一個重點,也讓我們窺探到了在打通系統和主流APP的情況下,AI到底能給我們帶來多大的方便。不過很可惜,在短時間內,我們可能很難感受到。想要騰訊,阿里等一眾大廠互通,是不容易的一件事。

連續兩天的發佈會,也許在提醒我們,相比一個能解微積分,在每個行業都是頂級專家的AI,我們可能更需要一個普通的AI穿插在我們生活中。