烏鴉AI日報:谷歌新AI為視頻生成配樂和對白_風聞

乌鸦智能说-1小时前

Google1人工智能研究實驗室DeepMind正在開發為視頻生成配樂的AI,他們獨有的V2A技術可以將配樂描述與視頻配對,創造出與視頻中的人物和語氣相匹配的音樂、音效甚至對話。

Runway推出新一代模型Gen-3 Alpha,可根據文字描述和靜態圖像生成視頻片段,90秒內快速生成10秒視頻,能包含多樣的電影敍事手法。

過去一天,國內外AI行業還有哪些熱點值得關注呢?讓烏鴉君帶你一起看看吧。

/ 01 / 大模型

1)Runway推出全新視頻模型Gen-3

Runway推出全新模型Gen-3 Alpha,這是即將推出的系列模型中的首款。Gen-3 Alpha可根據文字描述和靜態圖像生成視頻片段,模型驅動新的文本到視頻(T2V)、圖像到視頻(I2V)和文本到圖像(T2I)。

Gen-3 Alpha可以處理複雜的場景變化,並能包含多樣的電影敍事手法;擁有動作筆刷、高級攝像機控制、導演模式;

模型在保真度、一致性和運動方面都相比Gen-2有了很大提升,90秒內快速生成10秒視頻,還可並行生成多個視頻。

官方表示,Gen-3將在未來“幾天內”向Runway的付費用户開放,免費版本也將在未來某個時間點向所有用户開放。

2)DeepMind的新AI可以為視頻生成配樂和對白

Google的人工智能研究實驗室DeepMind正在開發為視頻生成配樂的人工智能技術,為V2A提供動力的人工智能模型是在聲音和對話文本以及視頻剪輯的組合上訓練出來的。據悉,當前還未有模型能在生成視頻時同步生成音效。

DeepMind的V2A技術可以將配樂描述與視頻配對,創造出與視頻中的人物和語氣相匹配的音樂、音效甚至對話,並通過SynthID深度防偽技術打上水印。

3)潞晨Open-Sora技術路線公開,單鏡頭16秒720p高清視頻一鍵生成

潞晨Open-Sora是免費開源了視頻生成模型,16秒720p高清畫質一鍵生成,支持無縫產出任意風格的高質量短片。其最新版本引入視頻壓縮網絡等技術,降低訓練成本。團隊提供完整訓練方案,支持多種視頻寬高比輸出,並可通過GPT-4修改指令。模型權重和訓練代碼可免費獲取,適用於遊戲、廣告等領域。

開源地址:https://github.com/hpcaitech/Open-Sora

4)新對口型視頻項目Hallo發佈 可對錶情,嘴型進行精確控制

4)新對口型視頻項目Hallo發佈 可對錶情,嘴型進行精確控制

新對口型視頻項目Hallo發佈,通過單張圖像和音頻輸入生成唱歌和説話的視頻,實現精確控制人物表情和姿態,提升語音輸入與生成動畫之間的對齊精度。該技術不僅可用於虛擬角色動畫生成,還可應用於真實人物,支持多種運動控制,跨演員應用,以及歌唱動畫生成。技術先進,動畫逼真,具有廣泛的應用潛力。

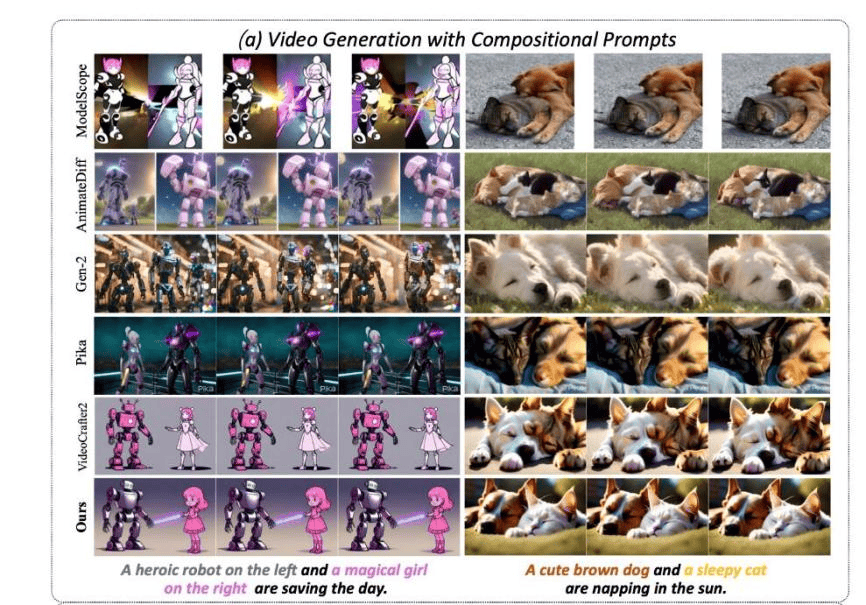

5)北大快手聯合推視頻生成框架VideoTetris複雜視頻生成效果超越Pika

本文介紹了北京大學與快手AI團隊合作攻克複雜視頻生成難題,提出VideoTetris框架,成功超越商用模型Pika和Gen-2。該框架定義了組合視頻生成任務,支持複雜指令和長視頻生成,保留位置信息和細節特徵。團隊採用時空組合擴散方法,優化訓練數據預處理和引入參考幀注意力機制,生成更具動感和自然的視頻。

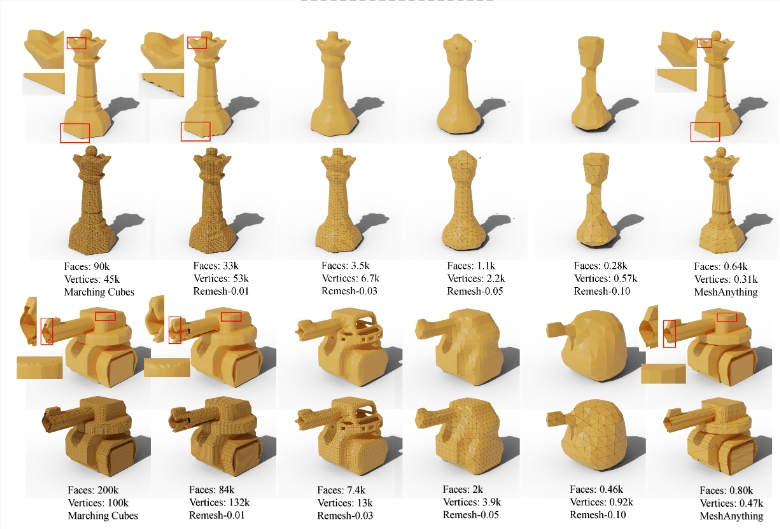

6)網格生成模型MeshAnything:將任何3D轉換為藝術家創建的網格

6)網格生成模型MeshAnything:將任何3D轉換為藝術家創建的網格

由重建和生成創建的3D資產已經達到了手工製作資產的質量水平,凸顯了它們在替代領域的潛力。MeshAnything是一種用於生成藝術家創建的3D網格的自動迴歸模型,通過VQ-VAE和形狀條件的僅解碼器變壓器實現高質量的網格生成。該方法顯著提高了存儲、渲染和模擬效率,同時保持與以往方法相當的精度。

/ 02 / AI應用

/ 02 / AI應用

1)蘋果AI或計劃將延遲推出,開發者要等到夏末才能進行測試

據彭博社報道,蘋果的人工智能(AI)計劃將是一個漫長而緩慢的過程。蘋果公司上週宣佈的蘋果Intelligence計劃預計將在夏末晚些時候才能供開發者測試。這意味着它不會成為蘋果新操作系統更新的首批測試版,並且僅會在今年秋季推出一個預覽版。

2)KREA AI推出視頻增強功能,一鍵提升視頻畫質

KREA AI推出的視頻增強功能“Enhancer”,可以提升圖片和視頻畫質,並支持更高的分辨率和幀速率。用户可以簡單操作,上傳需要改善的目標圖片/視頻,KREA AI將進行在線處理,最終生成高質量視頻。

3)騰訊混元推出肖像動畫生成框架Follow Your Emoji

騰訊混元攜手香港科技大學及清華大學,推出了肖像動畫生成框架“Follow Your Emoji”,這是一個基於擴散的人像動畫框架,它不僅可以對人物的臉部動作進行細節化的控制處理,同時也可以處理動物的面部表情。此外,它不僅可以為單個表情製作多種肖像,同時也可以為單個肖像製作多個表情。

4)Luma AI發佈了 Extend 功能 視頻時長擴充到10秒以上

Luma AI最近更新了Dream Machine視頻模型,新增了Extend功能,可以將視頻時長擴充到10秒以上,並保持原視頻風格、人物對象一致。雖然Extend功能生成延長視頻耗時較長,但風格一致性保持得很好。

/ 03 / 投融資情報

1)軟銀宣佈與Perplexity達成合作

軟銀昨日在官網發文,宣佈與生成式AI搜索初創公司Perplexity建立戰略合作伙伴關係。明(19)日起,軟銀將向使用軟銀、Y!mobile和LINEMO這3個品牌的客户,開放Perplexity Pro一年免費試用的申請。

/ 04 / AI基礎設施

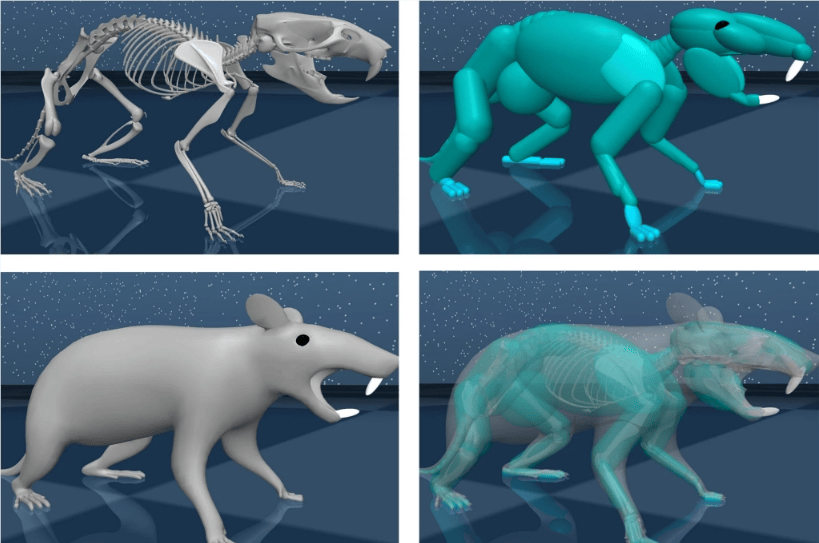

1)哈佛神經科學家和谷歌DeepMind在虛擬老鼠中創建人工大腦

哈佛大學研究人員與谷歌DeepMind團隊合作,利用人工智能技術為虛擬老鼠創建人工"大腦"的突破性研究。他們成功建立了生物力學逼真的3D老鼠模型,並利用DeepMind的深度強化學習算法訓練了一個人工神經網絡大腦,實現了超越真實的模擬效果。這一創新有望為神經科學和人工智能領域帶來革命性進展。

2)AI研究的主要推動力是什麼?ChatGPT團隊科學家:算力成本下降

2)AI研究的主要推動力是什麼?ChatGPT團隊科學家:算力成本下降

OpenAI研究科學家Hyung Won Chung解釋了機器學習研究的主要推動力。他指出,計算成本的指數級下降是促進AI研究的關鍵因素,並且這種趨勢將繼續推動AI的發展。他鼓勵研究者關注過去架構的分析,以幫助我們理解未來可能的發展方向。

3)清華與北大合作發佈長視頻理解基準測試:LVBench

智譜、清華大學和北京大學合作推出的長視頻理解基準測試項目LVBench,旨在彌補現有多模態大型語言模型在處理長視頻方面的挑戰。該項目包含多類別的數小時QA數據,涵蓋不同類型的視頻內容,旨在推動長視頻領域的技術突破和創新。許多研究機構已在LVBench數據集上展開工作,為視頻理解和多模態學習領域注入新活力。

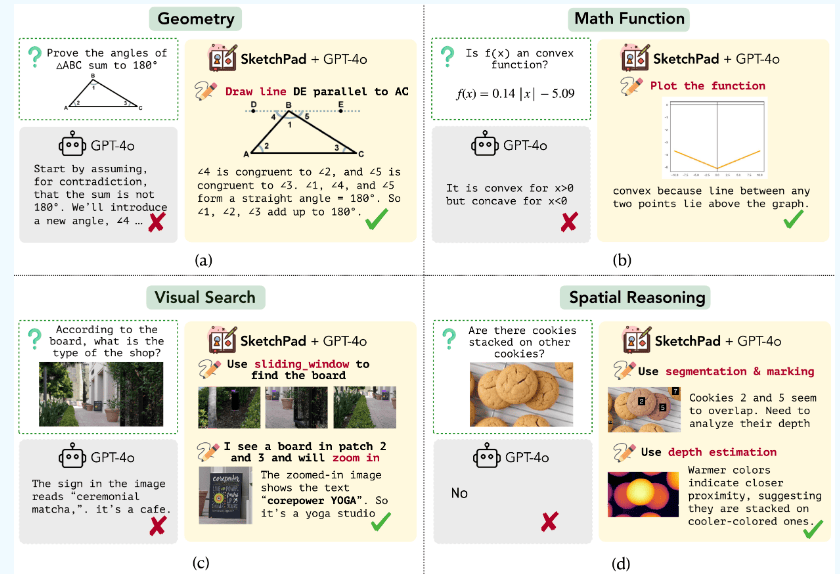

4)多模態模型的畫布框架Sketchpad:提升多模態模型數學能力

研究人員引入的“Sketchpad”概念,為多模態LM提供了視覺畫板和繪圖工具,使其能夠進行視覺推理。通過實驗結果顯示,Sketchpad顯著提高了LM在數學任務和複雜的視覺推理任務上的表現,進一步接近人類的思維方式,為人工智能技術的發展開闢了新的可能性。

5)拯救Transformer推理能力!DeepMind新研究:給模型嵌入算法推理大腦

5)拯救Transformer推理能力!DeepMind新研究:給模型嵌入算法推理大腦

DeepMind最新研究提出混合架構,將Transformer模型的自然語言理解(NLU)技能和基於圖神經網絡(GNN)的神經算法推理器(NAR)的推理能力結合,可實現更泛化、穩健、準確的大型語言模型(LLM)推理。此項研究,解決了Transformer模型在數學、代碼等領域推理任務上的精確、穩健做推理的問題。