官方點名!“被迫”罵人的雷軍,揭開百億灰產_風聞

金错刀-金错刀官方合作-科技商业观察家,爆品战略理论提出者55分钟前

文/ 金錯刀頻道

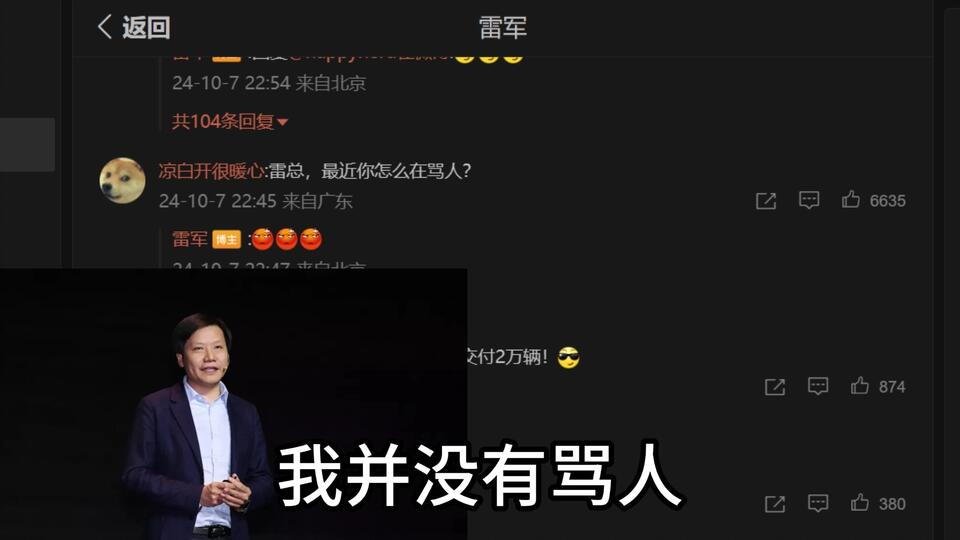

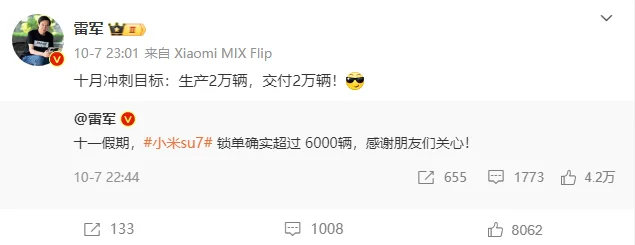

真正的雷軍,在慶祝小米Su7在十一期間爆單6000輛。

虛假的雷軍,卻在短視頻平台口吐芬芳。

十一期間,不少打着“雷軍罵人”標題的視頻火爆全網。

視頻中,雷軍操着標誌性的聲音瘋狂吐槽,一會要開着小米Su7創人,一會則對着調休制度開啓噴子模式。

要不是發言太離譜,這些語音真的有些真假難辨。

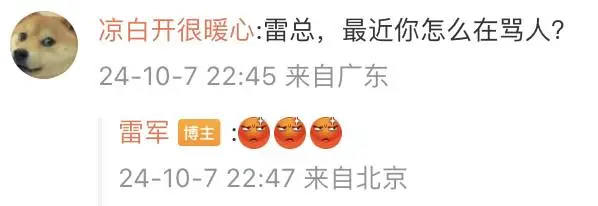

當有網友在本尊的賬號下面提及此事時,雷軍回覆了三個發怒的表情。

要知道,雷軍可以説是所有大佬中對網友玩梗最寬容的一位了。

從過去把“Are you OK?”的創作者正式收編,再到今年初把“軍兒,收手吧”放到發佈會,雷軍用幽默和寬容的態度贏得了不少網友的好感。

但是面對氾濫的AI玩梗,雷軍本尊也忍不了。

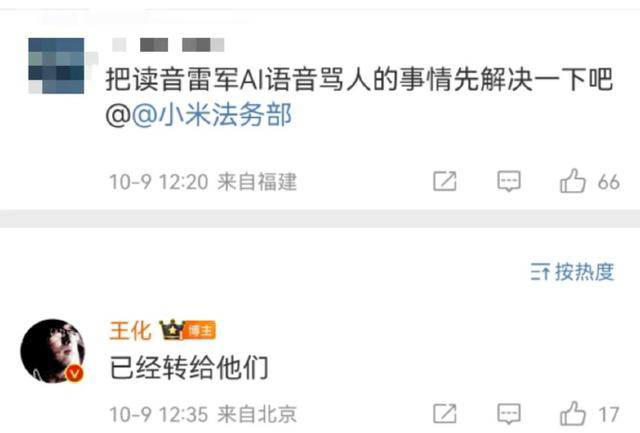

平時不怎麼對網梗出警的小米法務部也迅速行動,已經走上了法律程序。

當然,AI配音的受害者也不止雷軍,不論國內外,AI配音已經成為讓各路大佬和執法人員頭疼的“致命玩笑”。

上到作偽證干擾司法程序,下到明星的私密照片,甚至美國大選都難逃AI的干擾。

AI,怎麼就成了大佬們的心腹之患?

從特朗普到雷軍,都難逃AI“毒手”

不論中外,把名人“AI”一下,都是網友最熱衷的快樂源泉。

用AI偽造他人的形象、聲音、影像,統一稱為“Deep Fake(深度偽造)”。

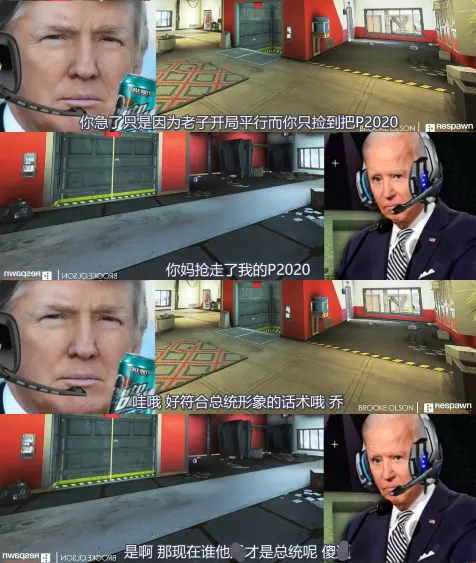

在B站,“美國總統鋭評”系列一度成為最熱的梗。

視頻裏,奧巴馬、特朗普和拜登會把最火的動漫角色,到熱映大片挨個吐槽一遍再做個排名,語氣之自然完全不像是演的。

對不少熱衷音樂的網友來説,AI更是自己“夢想成真”的神器。

比如,用AI孫燕姿的聲音唱周杰倫的歌,讓歐美巨星碧昂絲説一嘴正宗的北京話…

當然,玩梗娛樂只是AI工具最膚淺的用途之一。

在強大功能的加持下,AI成了不少心懷鬼胎之人手中的利器。

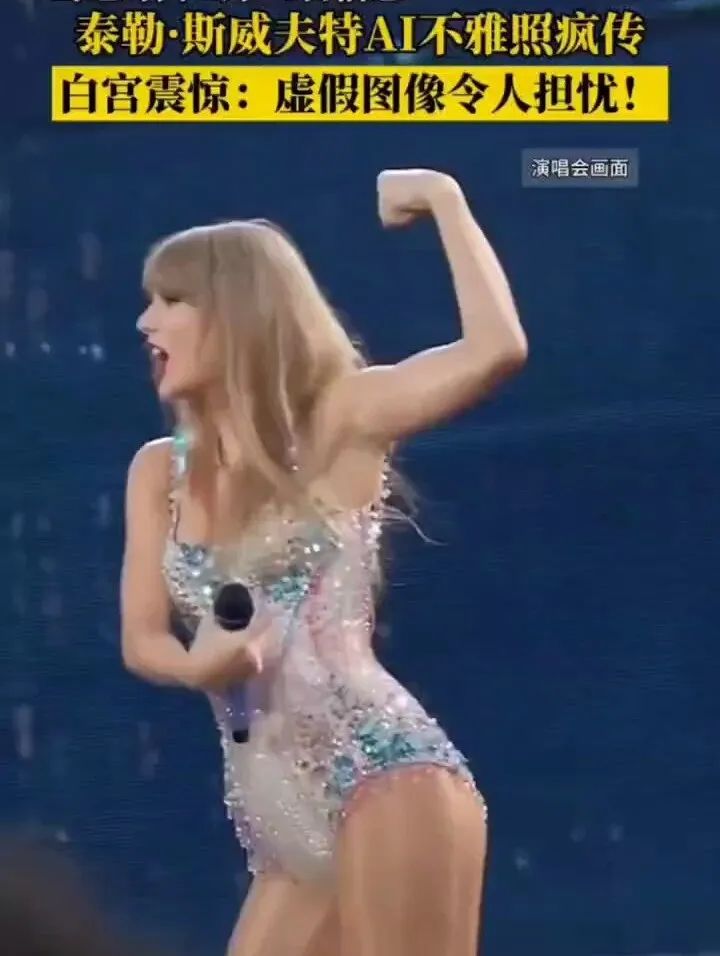

女明星是最早受災的一批人,頂流巨星“黴黴”泰勒·斯威夫特就慘遭“AI涉黃”。

各種換臉不雅照在X(推特)上瘋狂流竄,一張偽造圖片在一天內就獲得了4700萬次瀏覽,嚇得X平台直接屏蔽了“泰勒·斯威夫特”的關鍵詞搜索。

這條消息甚至引起了白宮辦公室的注意,白宮新聞發言人讓-皮埃爾表示:“網絡上的執法不嚴對女性影響更大,她們是受到網絡騷擾和欺凌的主要目標。”

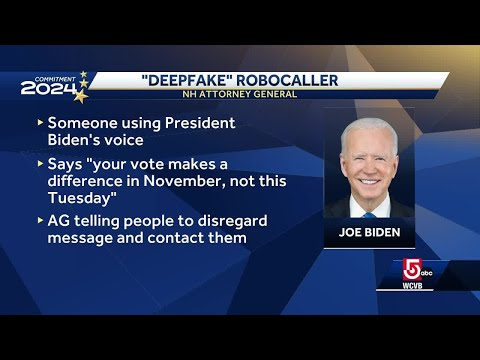

明星們的桃色照片只是小事,深度偽造早就把手伸向了美國大選。

在中國視頻平台上鋭評“二次元waifu”的美國總統,可能明天就會給美國新罕布什爾州的普通居民打電話,讓其“不要給自己投票”。

平時本就老實的美國紅脖子可不會分辨這是不是AI,每個總統都可能因為一段偽造的錄音錄像丟掉選票。

都不用關心美國大選,AI早就開始給國內的案件添亂。

不久前轟動全網的小楊哥塌房事件中,就有AI火上澆油。

在網友狂扒小楊哥猛料時,一條據稱是三隻羊董事長盧文慶的13分鐘語音被曝光。

語音中,盧文慶大爆猛料,言辭激烈,裏面所透露的勁爆內容引發了網友對三隻羊的口誅筆伐和無限猜想。

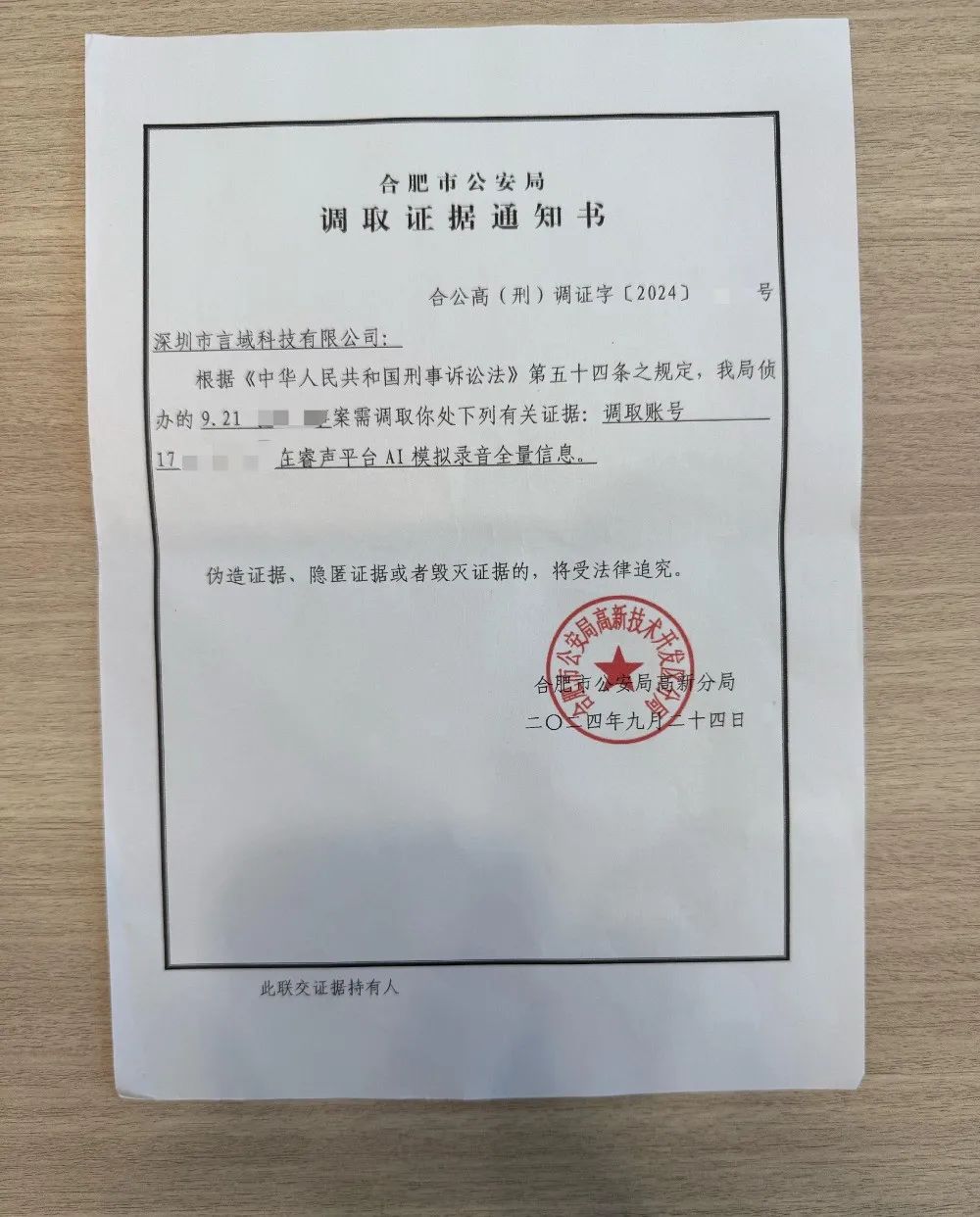

很快,合肥市警方證明,這條語音信息是由AI偽造而成。

儘管三隻羊欺騙消費者在先,活該被監管部門處罰,但是用這種惡劣手法造謠抹黑,也是對公眾的一種不負責任。

但不管是美國大選,還是三隻羊塌房,不少不法分子正在以AI作為武器,用一種十分低劣的手段入侵每個人的生活。

AI的危險性,已經不容忽視。

眾星捧月的AI,越卷越“灰”

自打誕生以來,大部分打工人對AI的態度都只有一點:

這玩意到底能不能代替我的工作?

但如今,原本設想中“更智能、更萬能”的AI似乎還為誕生,大部分人對AI的迭代越來越感到麻木。

不過,AI雖然沒有在智商上突破,但卷向了另一個反向:更好用。

過去訓練AI,往往需要精通數據和編程的專業人士對AI進行定點、定向的海量數據投放。

而在如今,這一工作已經可以被AI代替完成,部分AI應用的訓練已經變得格外簡單,門外漢也能輕鬆上手。

這一結果很快在深度偽造領域得到了應用。

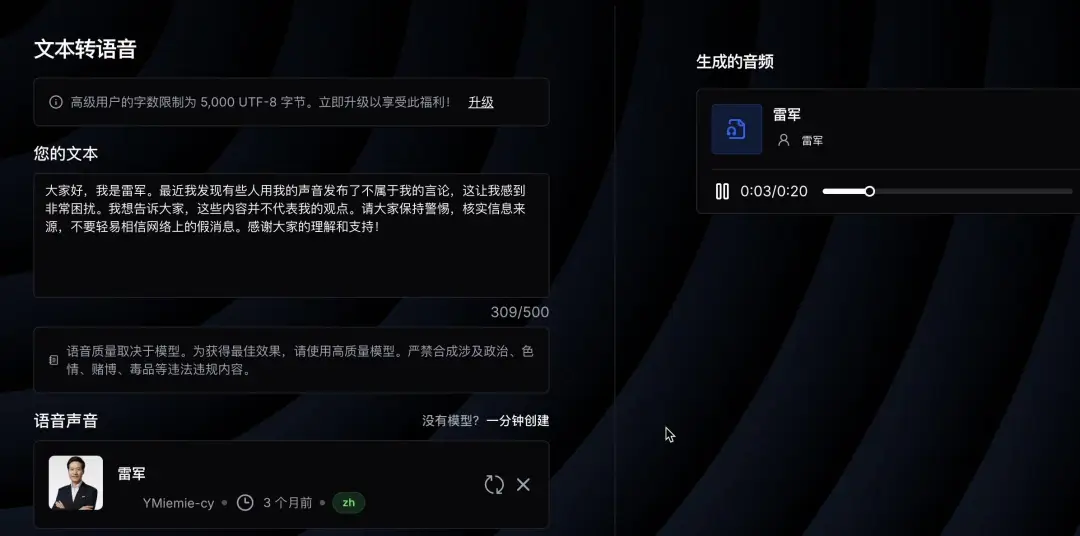

在AI雷軍和盧文慶偽造語音引發轟動後,一家名為言域科技的公司很快就出來“認領成果”,他們開發的Reecho睿聲,就是這兩個事件背後的主力軟件。

Reecho睿聲就主打克隆聲音功能,只要導入對應音頻,就能克隆對方的聲音,導入的素材越多,克隆的也就越像。

AI配音早就不稀罕了,但作為成立不到一年的新公司,言域科技相比於老前輩們,主打賣點就是“好上手”。

專業人士介紹,過去AI抓取人們的“聲音指紋”可能需要數十乃至上百分鐘的音頻素材,而如今,可能只要幾分鐘就能完成抓取。

比如,去年人們在AI網站上克隆孫燕姿的聲音,需要SoVITS 訓練模型,至少要求仿製者有一定編程基礎,且對電腦硬件有硬性要求。

到了如今的Reecho睿聲,人們只需要5~8s的語音素材,就能體驗到免費的聲音克隆服務。

而精度更高的付費克隆選項裏,只要花幾百元就能上傳更多的語音素材,打造更加擬真的AI語音。

睿聲的精度已經遠超人們想象,在三隻羊“錄音門”當中生成的盧文慶語音,就是由一段30s左右的語音作為素材生成而來。

更何況諸如雷軍等大佬的聲音幾乎全網都是,隨便截取一段發佈會發言就能獲得數個小時的語音包。

只用花幾百元,就可能改變一個公眾大佬在不少網友中的形象。

如此簡單的“作假”成本,也是深度偽造如此危險的原因。

儘管睿聲的技術還不是天花板級別的成熟,有用户説,自己使用睿聲生成的語音在10s之後就“沒法聽了”。

但對於別有用心之人來説,短短10s就足以興風作浪。

在睿聲的“語音市場”中,除了雷軍,還有諸如馬保國、孫燕姿、楊冪和成龍等人的聲音模擬,公眾人物的語音就像是遊戲中的皮膚一樣唾手可得。

當然,言域科技只是語音克隆功能越來越下沉的推手之一。

諸如剪映和豆包等剪輯軟件,也把“生成自己的語音”作為賣點之一,用户只要輸入一段自己的語音,就能生成和自己擬真的聲音。

以語音AI為首的深度偽造技術,已經成為國內各大廠都在卷的方向之一。

在中國,智能語音市場規模已經在2023年達到382億元,預計今年則會漲到469億元。

大廠們砸進AI裏的金錢和技術,很可能變成砸向自己的迴旋鏢。

AI煽起的邪火**,需要三招鎮壓**

用AI深度偽造引發的“事故”越來越常見。

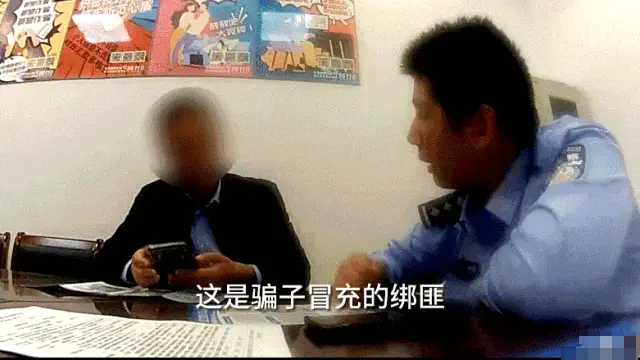

在今年,一位無錫的父親就接到了英國留學“兒子”打來的求助電話。

在經過警方辨別之後,才發現這條信息是由不法分子製作的AI語音。

如今的深度模仿技術,就連長期混跡互聯網的年輕人都難以辨別,更何況平時不怎麼上網的中老年人了。

面對瘋狂進化的AI技術,如果不加以遏制,很可能會成為整個社會的威脅。

版權原因,是很多公眾人物對深度仿製AI開火的主要武器。

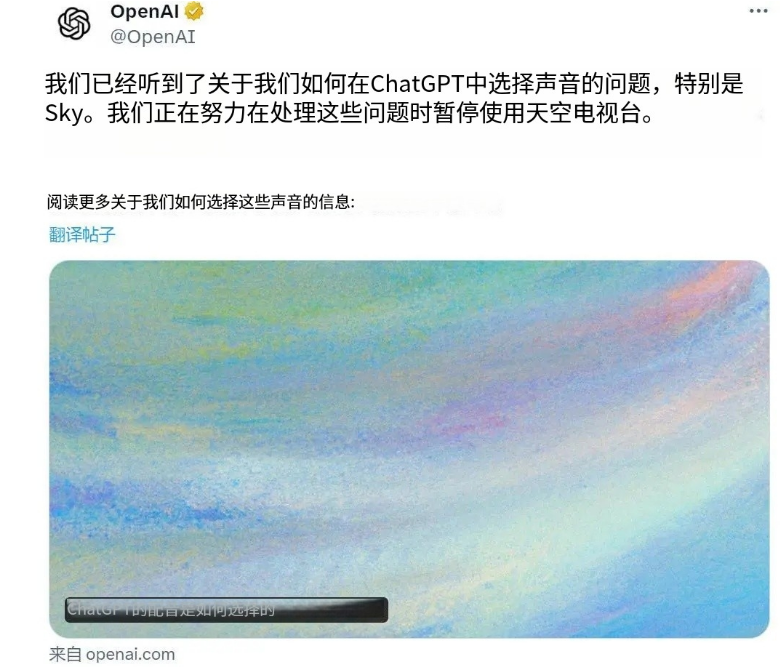

在今年5月份,美國影星斯嘉麗·約翰遜就對AI巨頭Open AI提起訴訟。

原因很簡單,Open AI曾經邀請她為Chat GPT進行配音,斯嘉麗並沒有接受這一邀約。

但之後在Chat GPT更新的語音系統包中,就出現了和斯嘉麗高度雷同的配音聲音,就連身邊親友都無法分辨真假。

很明顯,這是Open AI用斯嘉麗的聲音自己訓練出的結果。

在經過一系列起訴和怒斥之後,最終Open AI停用了這一功能。

但是斯嘉麗的勝利只是暫時的,有話語權的公眾人物能夠輕易用自己的影響力避雷侵權行為,對於普通人來説,這樣的做法無疑代價很高。

一些AI公司就是針對這一焦慮,推出了**“用魔法擊敗魔法”的反AI甄別應用。**

在過去,AI製作往往有着很明顯的“AI痕跡”,普通人都能隨意甄別,但是隨着AI技術越來越逼真,這些細節也越藏越深。

美國語音模仿AI公司ElevenLabs ,就曾經推出過一款甄別AI的語音軟件,但是據記者測試,這款軟件的正確率只有50%左右。

而且還有用户發現,如果給AI生成的語音加上一些噪音處理,就能極大程度地規避被“反AI軟件”甄別的概率。

但如今,致力於AI甄別的研究已經成為業界攻關的目標,國內外頂尖的AI項目組都在就“甄別AI”進行課題攻關。

今年早些時候,一位中科院的研究人員就開源了自己研發的甄別AI仿製圖像的大模型;浙江大學與清華大學業聯合推出了反AI語音的應用SafeEar。

技術高速發展的如今,“魔高一尺道高一丈”已經不是難點。

但反AI技術能否真正成為保護普通人的屏障,還得看大廠有沒有真金白銀的投入。

版權手段不好使、技術手段未完善,絕大多數普通人寄希望於平台和監管。

但對於平台來説,監管何嘗不是一件難事。

在AI模仿拜登打電話事件發生後,美國AI語音應用ElevenLabs立刻停止了關於拜登、特朗普等政治人物的語音權限。

但很快就有人發現,如果在上傳的語音素材中加入一分鐘空白,就能規避此類審查。

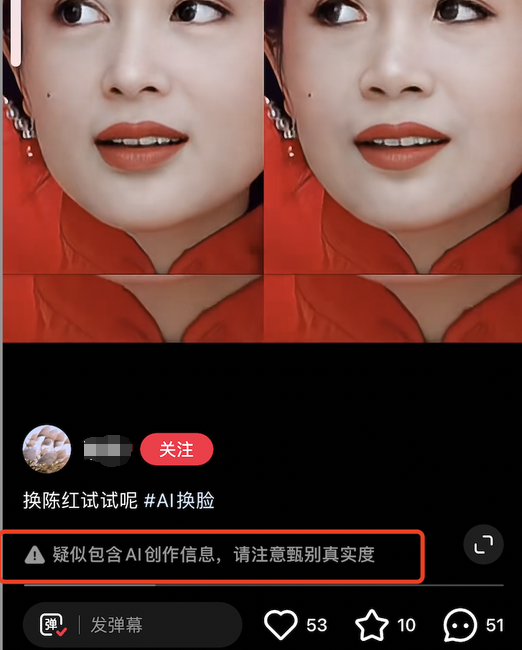

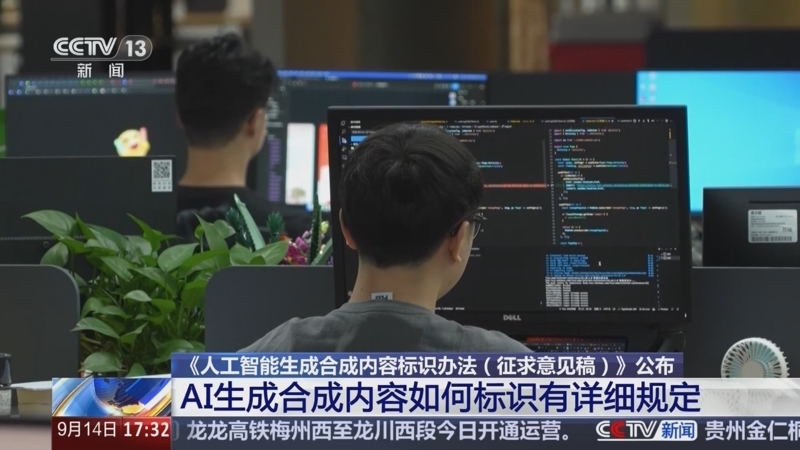

國內市場也在積極調整,在今年9月份,網信辦也發佈了《人工智能生成合成內容標識辦法(徵求意見稿)》。

其中規定,由AI生成的視頻、語音、圖像等素材,必須標註AI生成的字樣。

但是對於越來越下沉的AI應用來説,一條標準只能從行為道德層面約束用户,而不能真正杜絕AI被濫用。

説到底,AI只是人類創造的一個“好用的”工具,工具本身不分善惡,其性質完全取決於使用者的目的。

只不過,在人類沉迷於開發工具的可能性時,必須要敬畏其產生的後果。

科技必須進步,但人性不能脱繮。

圖片來源於網絡,侵權請聯繫刪除

@The End