困在AI色情視頻裏的K-Pop女明星_風聞

音乐先声-音乐先声官方账号-解读音乐产业,见证黄金年代。34分钟前

一場“數字性侵”。

韓娛公司,正在反擊AI作惡。

上週,韓國娛樂公司HYBE宣佈,將與京畿北道警察局(NGPPA)合作,共同打擊以HYBE藝人為對象的深度偽造(Deepfake)內容。

HYBE與NGPPA簽署了一份協議,明確了合作細節,包括加快相關案件的調查進程,並在韓國設立舉報熱線,方便公眾報告相關犯罪活動。同時,HYBE也宣佈加強對深度偽造內容的監控和處理,尤其是在色情內容方面,將專門設立響應機制,儘快採取行動。

去年9月,韓國娛樂公司JYP、YG和 Cube也向使用其K-pop藝人圖像創建的深度偽造視覺內容宣戰。YG指出,包括(G)I-dle、NewJeans、Twice、Kwon Eun-bi和BlackPink等知名K-Pop女子組合都是深度偽造內容的受害者中的冰山一角。

近年來,深度偽造內容氾濫已成為全球關注的焦點,尤其是針對娛樂行業的惡意攻擊。那麼,為什麼深度偽造技術會集中盯上K-Pop圈?背後隱藏着怎樣的惡趣味?

困在AI色情視頻裏的女明星

深度偽造(DeepFake)是一種人工智能技術,依賴於深度學習技術,尤其是生成對抗網絡(GAN),來生成或篡改圖像和視頻。其中,GAN 由生成器和判別器組成,通過兩者不斷地對抗和博弈,生成器逐漸學會生成更加逼真的虛假內容,直到能夠以假亂真。

藉助深度偽造,可以把一個人的臉、聲音、動作換到另一個視頻或圖片上,讓它看起來像是真實發生的事情,比如讓某人“説”他從未説過的話,或者“做”他從未做過的事情。

而在韓國娛樂行業,許多女明星的形象被不法分子用來製作惡搞、色情等有害內容,嚴重侵害了藝人的隱私和名譽。

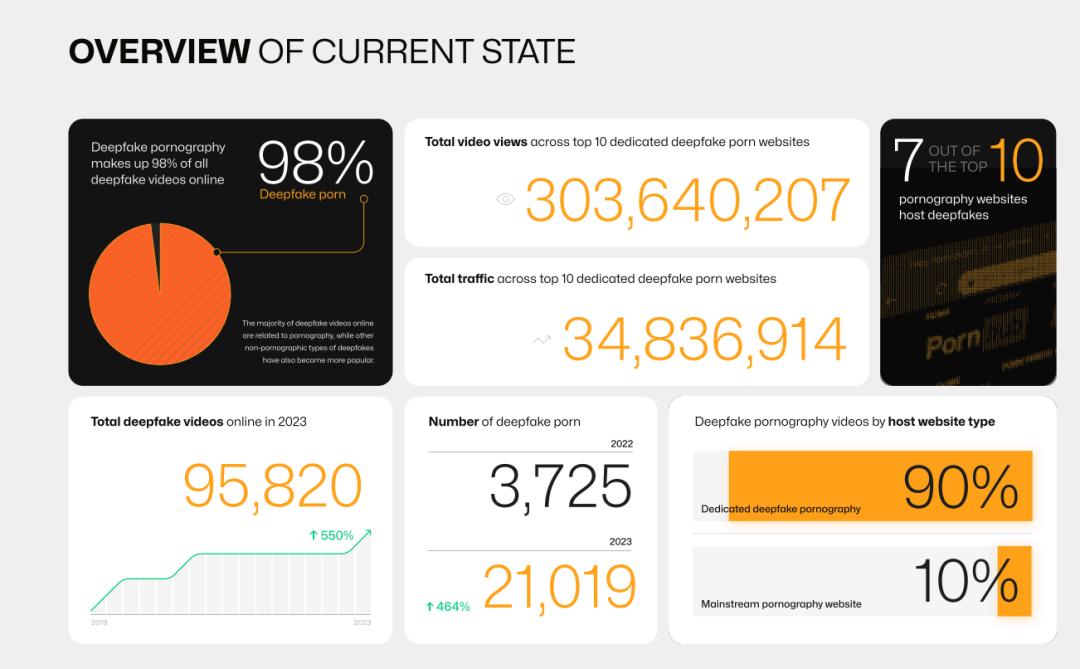

美國網絡安全公司Home Security Heroes的一份報告顯示,在互聯網所有深度偽造視頻中,幾乎98%是深度偽造色情視頻,前10個專門用於深度偽造色情內容的網站上,視頻總訪問量到超過3億次,總觀看次數超過3000萬。

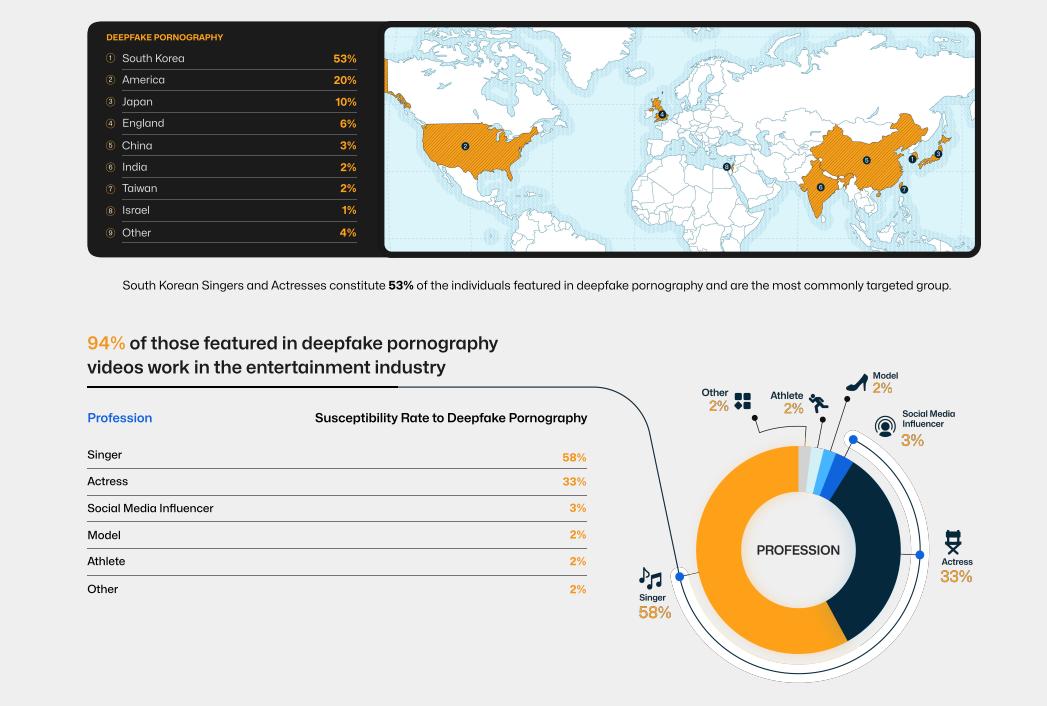

報告還指出,94%的深度偽造色情內容都發生在娛樂業,其中歌手、演員分別以58%、33%佔據大頭。在深度偽造的色情內容中,99%的受害者是女性,僅1%為男性。

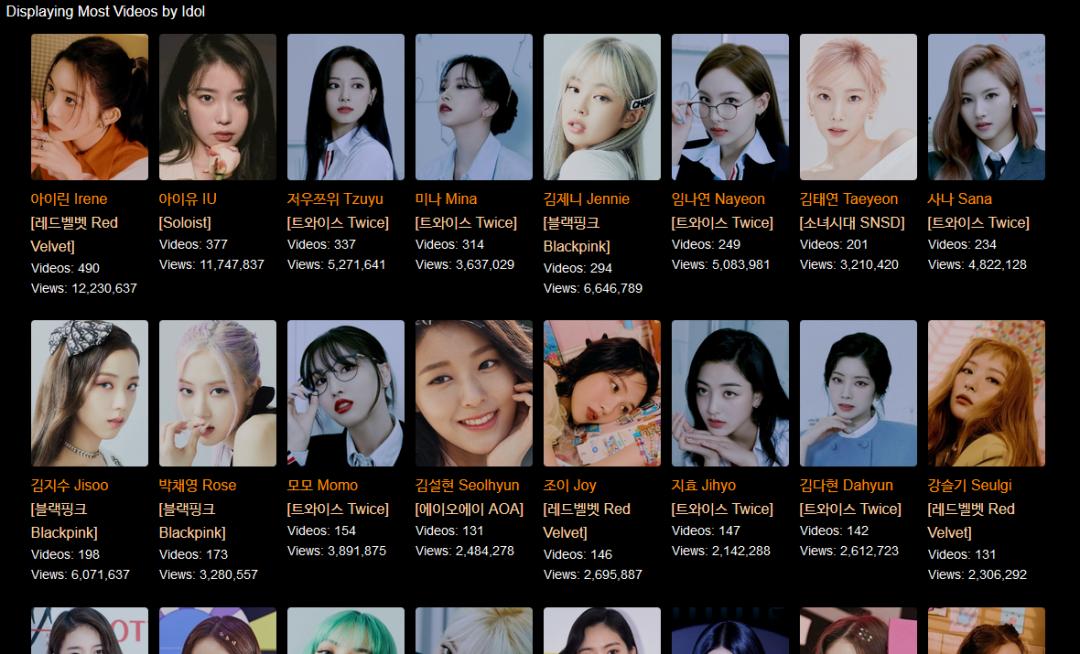

而在10 個深度偽造色情網站和85個視頻共享平台上的近 9.6萬個視頻中,53% 的人是韓國歌手和演員。

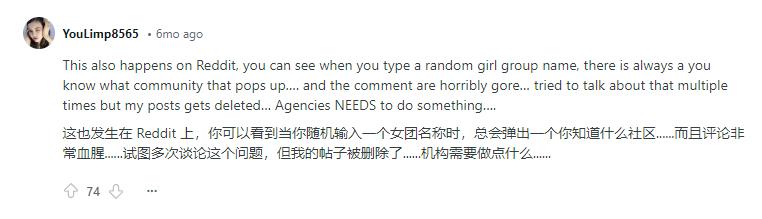

在海外社交媒體Reddit上,有網友指出當搜索“K-Pop”相關的關鍵詞就會跳出熱門subreddit(討論社區)幾乎都是18禁的話題,評論簡直令人作嘔。

當前,深度偽造的色情內容已經蔓延到各種在線社交平台。其中,曾引發韓國惡性集體性犯罪“N號房事件”的閲後即焚APP Telegram就是重災區,甚至有人將其命名為“新N號房事件”。

去年8月,韓國女性民友會發布一組報告,指出在社交平台Telegram的聊天羣組中,只需上傳熟人照片,付費後5秒鐘內就能生成不雅合成圖。令人震驚的是,這個聊天羣的參與人數高達22.7萬。

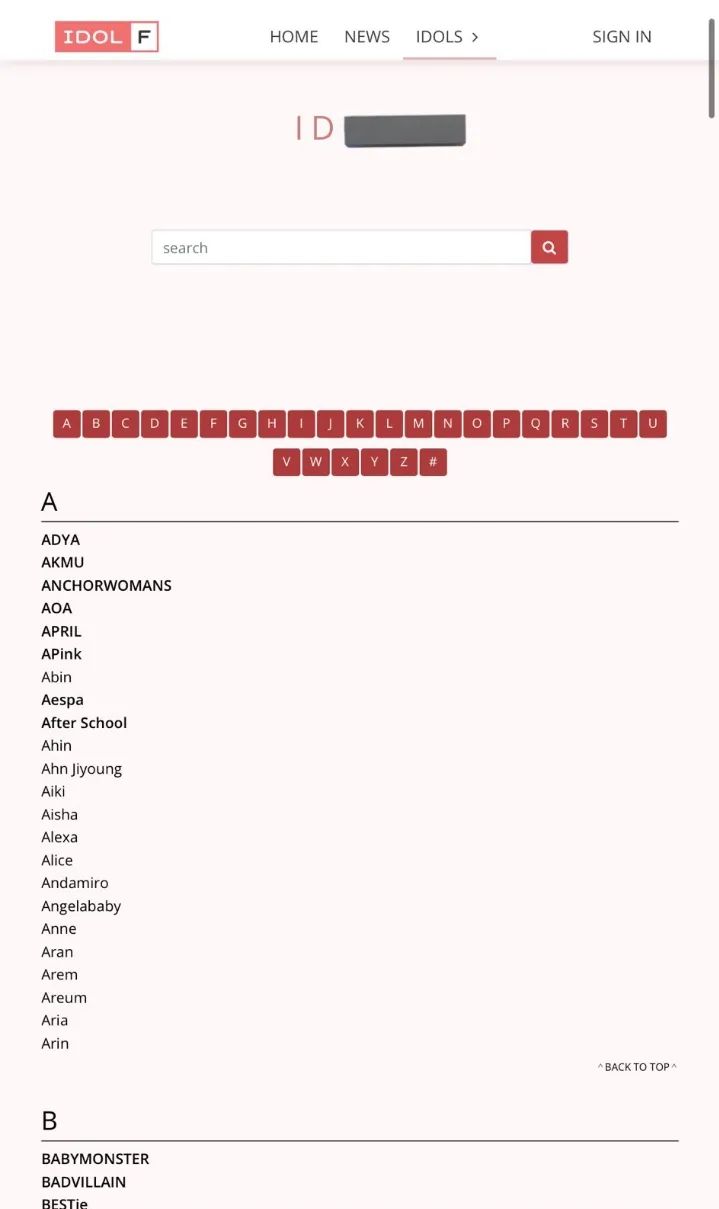

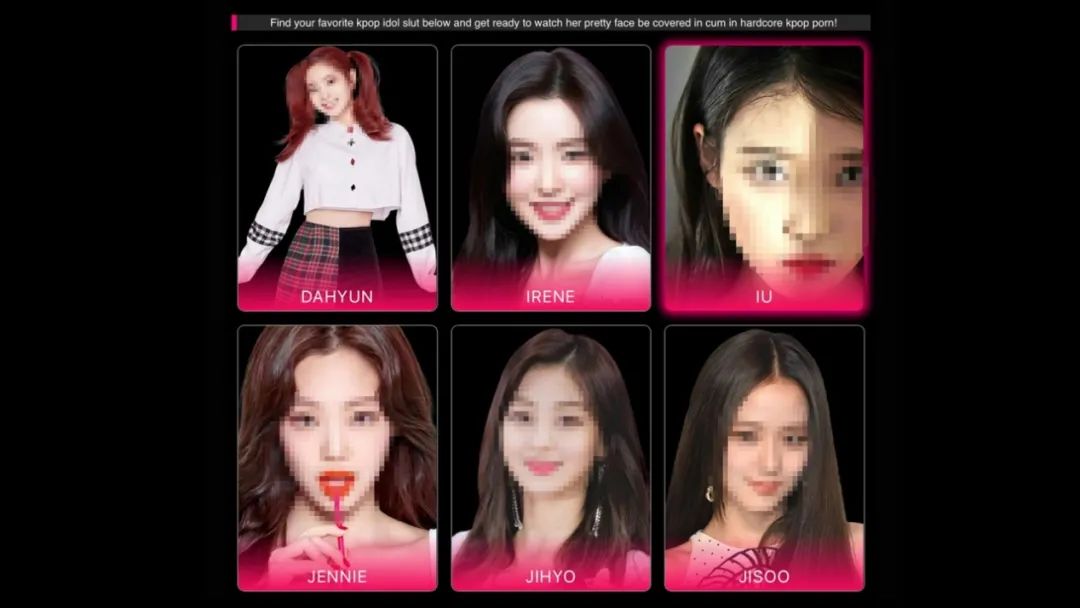

更噁心的是,一些深度偽造網站甚至列出了來自幾乎每一代K-Pop的200多名女性偶像的名字,包括多個第五代K-Pop團體的成員。

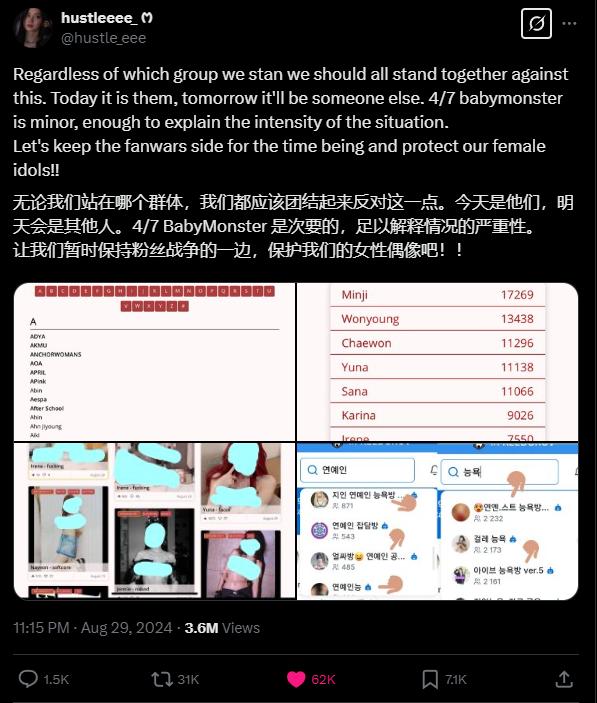

去年,YG旗下女團BABYMONSTER的粉絲羣體在社交平台上發聲,呼籲粉絲暫時放下飯圈紛爭,共同保護女藝人。他們強調,大家無論支持哪個團體,現在都應團結一致,堅決反對深度偽造色情內容的行為,今天的受害者是她們,明天可能就是其他人。尤其是BABYMONSTER的7名成員中,有4人仍是未成年人,這足以説明問題的嚴重性。

今年1月,韓國娛樂公司Starship因工作人員重大失誤,導致官方微博轉發了公司旗下K-Pop女子團體IVE成員張元英、安宥真的深度偽造內容。

儘管經紀公司、粉絲羣體、網友都對深度偽造內容痛斥不已,紛紛敦促相關部門迅速採取法律行動來保護受害者,並追究責任人,但深度偽造內容對女藝人的傷害卻難以完全遏制,它不僅是技術濫用的惡果,更是長期以來數字空間中性別暴力與隱私侵害問題的縮影。

目前,韓國政府和相關機構在輿論壓力下,已加快立法進程,以更嚴厲的法律打擊深度偽造色情內容的製作和傳播。

深度偽造為何盯上K-Pop女明星?

可以説,技術的低門檻、藝人的高曝光、社會對女性偶像的物化、法律的滯後,種種因素交織,共同催生了這場韓娛生態中的“數字性侵”。

有報道顯示,在韓國,涉及深度偽造的色情案件從2022年的3725起激增到2023年的21019起。

儘管根據《關於處罰性犯罪的特殊案件法》,參與編輯、合成或處理深度偽造色情內容的個人將面臨最高五年的監禁或 5000 萬韓元的罰款,以營利為目的傳播此類內容的發佈者最高可被判處7年監禁。

然而,在2020年至2023年韓國對深度偽造犯罪做出的 71 項裁決中,只有4 起案件僅因深度偽造犯罪而被判處監禁。目前還沒有針對下載或觀看深度偽造色情內容的法律。

這意味着,現行法律只針對深度偽造色情內容的製作和傳播者進行處罰,而觀看或持有這些內容的人卻不受法律約束。這種法律漏洞使得“觀眾”可以毫無顧忌地瀏覽相關內容,進一步助長了非法市場的需求,也使受害者更難獲得有效的法律保護。

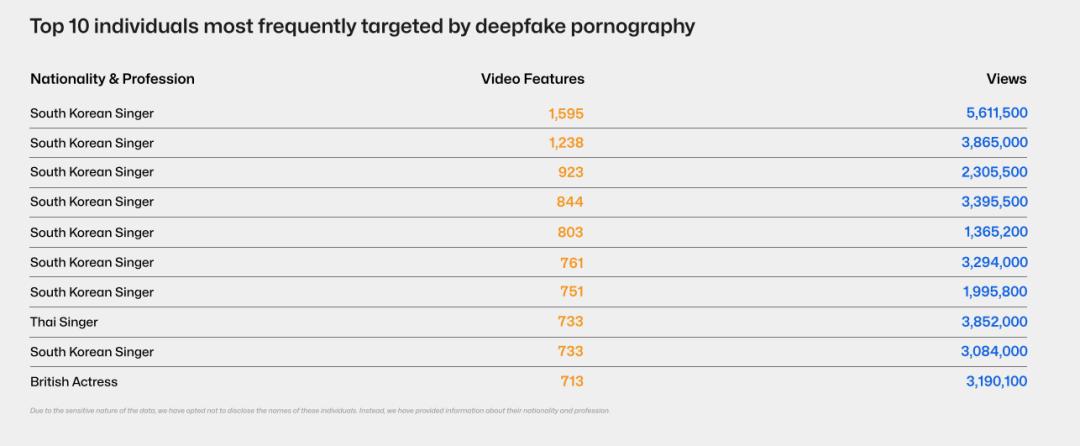

根據Home Security Heroes統計,10大最常被深度偽造色情內容攻擊的數據統計中,大部分受害者都是韓國歌手,其中一位歌手的視頻數量高達1595個,而另一位韓國歌手的深度偽造視頻觀看量超過了561萬。

2017年,在一個名為DeepFake的Reddit用户出現,偽造出了一系列女性色情電影,後來,這個詞的含義逐漸擴大,不僅包括他製作的換臉視頻,還指各種利用 AI 技術生成的合成內容。隨後,開源工具如DeepFaceLab和Faceswap相繼發佈,使得用户能夠更容易地創建深度偽造內容。

當下,深度偽造內容不再是一個高門檻的技術挑戰,幾乎任何人都能輕鬆、高效地製作出逼真的虛假內容。從操作難度來看,目前只需一台手機就足以製作出 AI 換臉內容,用户只需要提供提供素材並簡單調整,技術本身就會完成大部分工作。

而K-Pop產業在全球範圍內的廣泛傳播,尤其是韓國女歌手通過社交媒體與粉絲的緊密互動,創造了極高的曝光度。這種高度可見性使得她們的形象成為了深度偽造內容的理想素材。

去年3月,K-Pop女子團體ITZY成員黃禮志在一次粉絲連線活動中,意外地看到了一段自己的深度偽造的跳舞視頻。當時,黃禮志的表情顯然有些難以招架,既高興又有些困惑,只能尷尬地模仿起視頻中的舞蹈動作。儘管這段視頻表面上似乎並無惡意,但事後,許多人表示,觀看這段視頻讓人感到“毛骨悚然”。

如今,偶像的每一個動作、每一個表情都可能成為被惡意利用的對象。任何人只需藉助技術手段,就能利用公開的藝人影像、物料,製作出極為逼真的偽造視頻。這些偽造的視頻不僅可能被推向公共平台,也有可能被泄露到私密場合,給偶像帶來無法預見的困擾和傷害。

另一方面,韓國社會對女性偶像的極度關注和物化,加劇了這種侵犯的普遍性。

在傳統的性別文化中,女性往往被視為視覺消費的對象,尤其是年輕的女歌手,她們的形象和形態經常被放大、審視和評價,使得這些女明星成為了深度偽造內容的高頻目標。對她們進行深度偽造不僅能夠迅速吸引眼球,其社會影響力也使得這些內容具備了更高的傳播價值。

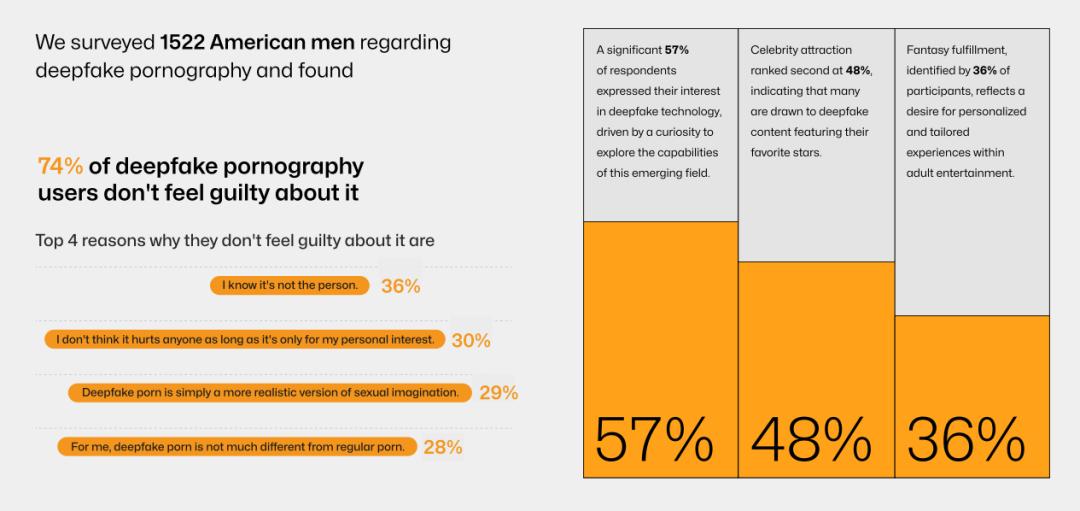

而且,大多數觀看深度偽造色情的男性並不認為這種行為有道德問題。

以Home Security Heroes的1522名美國男性受訪者為例,74%的人對深度偽造色情內容沒有罪惡感,其中“我知道這不是真人。”(36%)、“只是我個人興趣,這不會傷害任何人。”(30%)“深度偽造色情只是更逼真的性幻想。”(29%)“深度偽造色情和普通色情沒有太大區別。”(28%)

其背後的邏輯,他們或是受名人吸引力驅使,或是“幻想滿足”,希望獲得更個性化、定製化的成人娛樂體驗,卻無視了基本道德界限,抱着輕視女性尊嚴的態度,這讓深度偽造色情在道德和法律的空白地帶肆意氾濫,進一步加深了對女性藝人的傷害與物化。

而對於經紀公司而言,考慮到影像的殘留與輿論的烙印在互聯網難以抹去,甚至可能成為二次網絡暴力的導火索。大多時候沒有辦法透露深度偽造色情案件的具體細節,這也讓外界難以全面瞭解案件的嚴重性和受害者所經歷的困境。

由此可見,K-pop女明星成為深度偽造內容的高危羣體,其背後既有深度偽造技術的隱蔽性與低門檻,也折射出部分男性對女性的輕視。

可以説,K-pop 產業高度的全球曝光度與對偶像形象的極致塑造,使得女藝人不僅是商業符號,更成為公眾慾望的投射對象。再加上法律體系在應對這一新興問題時的滯後,讓女性藝人淪為網絡上的玩偶,隨時可以被任何人肆意操控、貶低,甚至肆無忌憚地消耗。

當技術成為“賽博照妖鏡”

一個更恐怖的事實,不僅是韓國,根據去年3月英國《衞報》報道,在歐洲5個訪問量最大的深度偽造內容網站上,有近4000位明星被AI換臉成色情內容的主角,5個網站三個月的瀏覽量就達到了1億次。受害者包括女演員、電視明星、音樂家和YouTube網紅。

去年年初,Taylor Swift的深度偽造色情圖片也曾在X(原推特)上廣泛傳播,在平台而且被累計瀏覽超4700萬次。據相關統計顯示,當時全網已有超過9500 個網站“專門製作非自願親密圖像”。最終, X一度封鎖了對斯威夫特的相關搜索,以遏制這些虛假內容的傳播。

而在國內,也出現了深度偽造的相關案件,且受害者並不限於女明星,更有你我這樣的普通人。

2020年,虞某一邊通過傳播換臉的淫穢視頻來“吸粉引流”,同時通過出售“AI換臉”軟件和提供所謂“AI換臉”的私人定製服務,在不到半年的時間裏就獲利數萬元。2023年11月,杭州市蕭山區人民法院判決虞某犯製作、傳播淫穢物品牟利罪,判處有期徒刑七年三個月,並處罰金6萬元。這也是我國首例關於“AI換臉”侵犯公民個人信息公益訴訟案的審理判決。

國內在此類案件的處理中,該封號的封號,該處罰的處罰,但利益、慾望似乎總是先於規則,而法律的步伐卻往往滯後於技術變革。面對技術濫用的新型挑戰,“以技術對抗技術”正成為重要的應對策略。

比如,去年推出的榮耀Magic7系列推出手機行業首個端側AI反詐檢測技術,可在識別內容是否存在AI換臉的風險。該技術還獲得了2024年中國網絡安全創新創業大賽最具投資價值獎。

當然,平台的責任也不應該僅僅是“亡羊補牢”,否則規則再完善,也只是落後於人性弱點的一紙空文,既攔不住逐利的黑產,也保護不了受害者的尊嚴。

社交平台上,依然有大量不法分子在非法網站上傳不少女藝人的相關深度偽造視頻內容,一些交易平台的商家不過是換了張面孔,便在規則的夾縫中繼續遊刃有餘。

近年來,國內雖然在相關立法方面有關注這一議題,但已出台的規章制度還不具備可操作的細則和明確的處罰標準。在今年3月全國兩會上,全國人大代表,TCL創始人、董事長李東生也提出了關於加強AI深度偽造欺詐管理的建議。

近幾年,“技術無善惡,但卻有邊界”類似的話術,幾乎成為每一篇關於技術濫用的報道中的口號。但技術無法為道德缺失填坑,每一幀都是施暴者的主動選擇,不是算法自作主張。

當技術成為了一部分人的“賽博照妖鏡”,或許我們更需要的不僅僅是更鋒利的監管刀刃,也需要一場全民的精神覺醒。數字世界的“不要臉”,本質是現實人格的徹底潰爛。

*本文圖源網絡,如侵權聯繫刪改