“13歲女孩‘開盒’”事件的底層邏輯是數字社會的“隱私信息化” | 熱點_風聞

探索与争鸣-《探索与争鸣》杂志官方账号-昨天 22:26

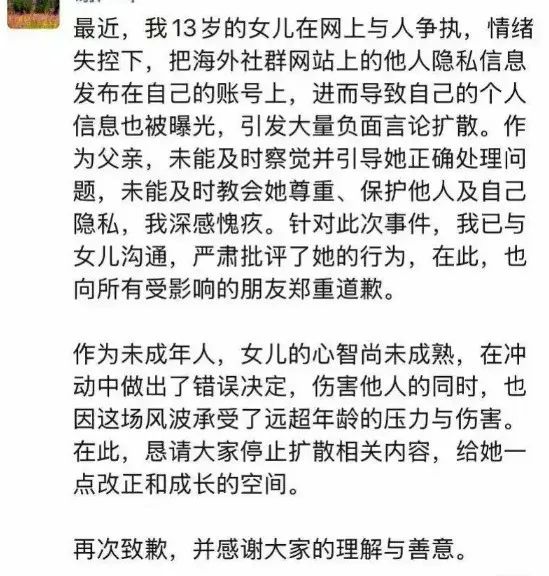

【編者按】3月17日,據澎湃新聞報道,某大廠副總裁13歲女兒因飯圈糾紛,在微博上帶頭對一名素人孕婦進行“開盒”(即人肉搜索)和網絡暴力,該用户發佈了大量針對該孕婦的侮辱性言論。其父在朋友圈回應稱,其13歲女兒在情緒失控下,把海外社羣網站上的他人隱私信息發佈在自己的賬號上,引發大量負面言論擴散。本次事件引發社會公眾廣泛熱議,有人關注未成年教育問題,有人質疑大廠存儲的個人信息是否存在泄露情況,亦有人呼籲加強個人信息的法律保護。近年來,由信息泄露引發的事件屢屢進入公眾視野,而跳出具體個案,我們更應該關注這些事件共同藴含的底層邏輯。

對此,王俊秀文指出,信息時代下人們日常行為越來越趨於數字化,每個人每天都會產生大量的信息,其中的許多信息是不便於向社會公開的,屬於隱私信息,人們的這些隱私信息時時刻刻都在累積之中。隨着社會的變遷,人們對於隱私的理解也必須隨之發生變化。王敏芝文認為,將人和物全面數字化並最大限度獲取個人數據,是算法技術的邏輯起點。算法之下,個人數據(個人信息))歸由個人控制的現實基礎瀕臨瓦解,數據不斷從科技領域向社會領域入侵,數據控制權不斷從個人向社會/機構遷移,個人數據保護的既有路徑面臨巨大挑戰。本公眾號特推出本組文章,供讀者思考,僅代表作者觀點,不代表公眾號立場。

數字社會中的隱私重塑

——以“人臉識別”為例

王俊秀 | 中國社會科學院社會學研究所研究員

本文載於《探索與爭鳴》2020年第2期

為方便閲讀,有刪減

非經註明,文中圖片均來自網絡

數字社會中的個人隱私

“智能社會”“智慧城市”已經成為當今世界最新潮的表述,也被認為是未來社會治理的新趨勢。這些趨勢表現為社會治理手段的智能化、數字化水平不斷提高,網絡通訊、大數據和人工智能技術的應用領域和場景不斷擴展,逐漸深入尋常百姓生活,為人們的生活帶來了快速的改善和極大的便利。學者們開始討論這樣一種新的治理模式—數字治理(digital governance),這一產生於電子商務和電子政務之後的概念,被視為數字時代全新的、先進的治理模式。這一以信息化、數字化、智能化為核心的數字治理過程已深入到公共生活的各個領域:打開購物網站,後台根據用户的搜索記錄精準推送商品;註冊電子會員,節假日都會收到祝福和問候。但是,這種便利是以個人信息為代價的,電商、社交軟件過度收集個人信息正成為新的社會問題。在這種新情勢下,隱私的內涵也被改造,何以重新界定隱私成為學界研究的重要範式,最近這一問題突出體現在圍繞人臉識別與隱私保護衝突的一系列事件中。

“郭兵起訴杭州野生動物世界案”被稱為“中國人臉識別第一案”,引起全社會的廣泛關注。事情緣起於郭兵收到來自杭州野生動物世界發來的一條短信,“園區年卡系統已升級為人臉識別入園,原指紋識別已取消,未註冊人臉識別的用户將無法正常入園”,郭兵是2019年4月在該園錄入指紋後辦理的年卡。郭兵認為面部特徵等個人生物識別信息屬於個人敏感信息,一旦泄露,容易被濫用,會危害到自己的人身和財產安全,郭兵不願意接受人臉識別要求退卡退費,但遭到該園的拒絕。於是郭兵向杭州市富陽區人民法院提起了訴訟。有人認為這一事件代表了中國用户數據隱私權意識的覺醒,這是由於以往商家和機構一貫大量收集用户信息而管理又不規範導致的必然結果,認為這一案件與之前發生的一些公司將大量用户個人信息泄露和倒賣事件有着直接的關係。

據中央電視台報道,2019年11月19日江蘇淮安警方偵破7家公司侵犯個人信息犯罪的特大案件,涉及非法侵佔個人信息1億多條,涉案的考拉徵信服務有限公司和北京黑格公司的法定代表人、董事長、銷售人員、技術人員等20餘名涉案人員被抓獲。這樣的案件呈高發態勢,近期公安部針對此類案件進行整治,共立案涉嫌侵犯公民個人信息案件29起,抓獲犯罪嫌疑人288人,繳獲公民個人信息4.68億餘條,涉案金額達到9400餘萬元。2019年11月29日央視新聞客户端又報道稱記者發現有人在以10元的價格在網上兜售5000多張人臉照片。

個人信息泄露已經成為現代網絡社會每個人都有感受的事情,許多人都收到過電信詐騙電話或指名道姓的廣告推銷電話,這些親身經歷以及媒體非法使用個人信息案件的大量報道,使得人們使用個人信息的安全感下降,越來越多的人對此感到焦慮和擔心。但也有人認為對人臉識別沒必要“談虎色變”,他們認為人臉識別是人工智能浪潮中最具代表性的技術,在“數字中國”的發展中,人臉識別正在深度融入社會管理、公務服務、安全保障等領域,人臉識別的發展勢頭已不可阻擋。只是太多的信息泄露案件不斷放大着人們對人臉識別的恐懼。但技術本身是中立的,對於技術應用中出現的問題應該通過實踐中不斷完善制度來解決,這種聲音代表了支持數字治理過程中人臉識別的典型立場。商業管理和公共管理中人臉識別技術的應用確實有很大優勢,因此這一技術在很短時間內快速增長。諮詢公司IHS Markit 2019年的報告稱,2006年全球視頻監控設備出貨量大概是1千萬套,到2016年已經增長到了1億套,而到2019年將達到1億8千萬套。在視頻監控中雲計算、視頻分析和深度學習技術的運用成為發展趨勢,2017年具有視頻分析功能的攝像頭的比例為23%,到2022年這一比例將達到45%。

信息隱私化與隱私信息化

英國學者Patrick Dunleavy在“數字時代的治理理論”中指出,數字治理產生於新公共管理的式微和信息社會的發展,並從信息社會的特徵、信息技術手段、數字治理的目標三個方面探討數字治理問題。但是,數字治理並不僅僅是管理和科學技術層面的問題,因信息時代數字治理一定程度是圍繞着個人行為和伴生的個人信息展開的,個人信息和隱私就成為核心矛盾,因此,數字治理不僅涉及到倫理問題,還涉及到社會心理問題。數字治理與隱私衝突的核心問題是由個人信息的性質決定的,這裏包含兩個過程。一方面,個人的隱私在信息時代的典型表現是信息,也就是存在一個隱私信息化的過程。另一方面,隨着時代的變遷,信息時代的隱私可能不同於傳統社會,在信息的收集、儲存、加工和使用中產生了性質的改變,一些原本不屬於隱私的個人信息成為了隱私,還有一些傳統上不屬於隱私的信息在新的環境下成為隱私。隨着人們隱私觀念的改變,一些信息是否為隱私也存在一個再認定的問題,傳統隱私的邊界需要重新進行釐定,這其中包含了個體主觀的心理因素,這就是信息的隱私化過程。數字治理不能迴避如何理解這兩個過程的問題,要實現數字“善治”就必須在充分在這兩個過程中重新界定隱私。

(一) 信息隱私化

隱私雖然是一個老生常談的概念,但對於什麼是隱私卻存在很大爭議,人們對於隱私的理解存在差異,這種差異源自不同的文化,也隨時代而變化。隱私是一個多學科研究的概念,哲學、法學、倫理學、社會學、社會心理學等學科都有關於隱私的論述和研究,但這些研究在隱私概念的界定上存在較大的差異,也使得研究結論差異巨大,甚至對立。目前的隱私研究基本上是在法學範疇內討論,並不在意對隱私概念的界定,而直接去討論隱私權的問題,對隱私的討論常常難以到位。因此,隱私的概念非常重要,從隱私(privacy)的詞源上看,英文中的privacy來自拉丁文privatus,具有“孤立”“受限制”“個人的”和“獨特的”等含義。從這個意義上,個體有意避開公眾查看,不使公眾獲得其不願公開的信息都屬於隱私。就人臉識別來説,這項技術是基於攝影和錄像技術的,攝影技術產生已經很久,錄像技術也有着不短的歷史,而人臉識別卻是近年來才出現的新技術。從技術上來説,人臉識別是利用分析比較的計算機技術來識別人臉,也就是讓計算機認識人,人臉識別技術是基於人工智能技術對人臉這一生物特徵的識別。以往人的隱私是基於個人私密部位的,除極少數文化背景下,一般社會環境下的人臉都是公開示人的,本不屬於隱私範疇,但人臉識別技術使得原本公開的信息成為隱私信息,也就是信息隱私化使得傳統隱私的邊界得以擴展。

國內媒體曾經報道,嘉興市某學校的學生用一張打印的照片代替真人騙過了小區裏的人臉識別豐巢智能櫃,取出了家長們的快遞貨物。美國《財富》雜誌2019年12月12日報道,美國聖地亞哥的一家人工智能公司用高清3D面具和照片,在世界多地成功欺騙了人臉識別系統,其中包括中國的微信和支付寶,完成了購物支付程序。這樣,由於人臉識別技術的漏洞,個人人臉照片或視頻就存在被非法利用的風險,信息隱私化的過程一方面重構了隱私,另一方面由於技術不完善,數字社會的個人隱私也存在被侵犯的風險。更為極端的惡意使用他人人臉信息的例子是“換臉”。2017年,一位名叫“deepfakes”的外國網友利用人工智能技術,將電影《神奇女俠》《哈利·波特》中明星的臉“ 移花接木”到了不雅視頻的女主角身上,一度掀起軒然大波。為什麼會出現信息的隱私化,這是由於數字社會信息具有了一定的商業價值,當“人臉”等原本社會公開的信息可用於流通牟利,隱私的範圍也需重新考慮。

圖源:搜狐網

隨着社會的變遷,人們對於隱私的理解也必須隨之發生變化,同時,信息性質的變化也使得信息時代的隱私觀念發生變化。許多學者認為“隱私是不受他人干擾的權利”,這種觀點的影響很大,有眾多的支持者,國內的學者也受到這種觀點的影響。但是,這樣的隱私觀念在數字社會已顯得過於狹隘,無法有效保護個人隱私,如當被隱藏的高性能攝錄設備拍攝和監視的時候,個體雖然很難察覺到,但並不表示此時他的隱私沒有被侵犯。另外,還有一種隱私觀點強調個體在與他人交流時在時間上、方式上和程度上對自己信息控制的自主性,這種控制是隱私得以實現的關鍵。正如萬維網發明人伯納斯所擔心的,我們缺乏對個人數據的控制,一些互聯網服務並未向我們收費,但當我們讀過他們的政策細則,就會意識到我們實則在付費——不是用錢,而是用我們的個人信息。也正是由於信息時代個人信息的公開可能產生個人無法控制的後果,才使得信息隱私化得以發生。人臉識別中個人肖像因為公開而使個體失去了對它的控制,信息可能被非法使用,個人信息安全和隱私就受到侵犯。

(二)隱私信息化

信息時代下人們日常行為越來越趨於數字化,每個人每天都會產生大量的信息,其中的許多信息是不便於向社會公開的,屬於隱私信息,人們的這些隱私信息時時刻刻都在累積之中。隱私信息化的過程包含很多類型,有的是新的科學和技術手段帶來的,有的是由於個體的隱私風險意識不強,在無意間產生的,有的是在各種利益和動機下主動的隱私交換,也有的是信息監管不力所產生的。大眾風險意識不強是隱私信息化的重要原因,面對商家的“小恩小惠”許多人都沒有防範意識,輕易選擇了個人信息的奉送,如許多人在公共廁所使用人臉識別裝置來得到一段衞生紙。也有一些人缺乏個人信息保護觀念,使得不法商家和個人有機可乘,在法律監管缺位的情況下出現隱私信息化。

隱私信息化的途徑很多,最常見的在於通過各類手機App採取“徵詢—同意”的模式,但這種“徵詢”往往是強制的,這使得原本不該產生的大量隱私信息被獲取。網絡大數據時代商家認識到了數據的商業價值,利用各種途徑獲取個人信息,超使用範圍獲取個人隱私信息,一個簡單的App就要開通20多項權限,幾乎掌控了用户的手機與全部隱私。比如,北京地鐵2號線阜成門站開始試點人臉識別安檢,需要乘客在現場掃描二維碼下載“智慧安檢”App,可直接帶包進入安檢門為了這一小的便利,乘客要同意北京地鐵和億通行的公司的眾多條款,同意被它收集大量個人信息,而且,除了已經明示的信息之外,還有多處“不限於”,也就是信息收集成了“無限”的。收集的個人信息包括:(1)身份識別信息, 包括但不限於姓名、身份證明、聯繫地址、電話號碼、生物特徵信息;(2)所處的地理位置及目的地信息;(3)平台操作信息, 包括但不限於IP 地址、設備型號、設備標識符、操作系統版本信息;(4)行程信息, 包括但不限於出發地、到達地、路線、途經地點及里程數信息;(5)支付信息, 包括但不限於支付時間、支付金額、支付工具、銀行賬户及支付賬户信息;(6)個人信用信息, 包括但不限於任何信用狀況、信用分、信用報告信息;(7)其他根據具體產品及服務的需要而收集的的個人信息, 包括但不限於對產品或服務的意見、建議、曾經使用或經常使用的移動應用軟件以及使用場景和使用習慣等信息。

經過記者實測發現,用户必須一攬子授權地理位置信息、支付信息、個人信用信息及應用使用習慣信息,才能使用“智慧安檢服務”。如果這樣的安檢全面實行,乘地鐵出行的乘客將產生大量的隱私信息,而這眾多與安檢措施無關的信息將如何儲存、處理和使用都未得到充分透明和公開。隱私信息化和信息隱私化是難以截然分開的,當一些個人信息是孤立的狀態可能不構成隱私,如一個人曾經出現在某位置的地理信息。但是,當一個人大量的公開信息被追蹤和整合後,其性質已經發生了質的變化。特別是在大數據、人工智能背景下,信息加工處理能力強、速度快,這種信息隱私化過程就成為個人隱私的最大威脅。因此,像北京地鐵這樣無界限全面收集個人信息,而在沒有全面的防範措施下就試點實施,信息安全風險極大。

數字社會中應如何保護隱私

數字社會必須處理好個人隱私保護的問題,這也是數字治理本身的內容。有學者從信息隱私權角度分析隱私的益處和壞處,在數據成為生產要素的今天,過度限制信息使用會影響人們通過信息分享造福社會的互聯網精神,而個人信息被濫用、個人隱私被侵犯也會使得社會環境惡化,保持數字社會良性運行就要找到個人信息使用和隱私的邊界。無論面對的問題簡單還是複雜,圍繞着個人信息的數字治理不外乎是三個過程,一是信息的收集,二是信息的儲存,三是信息的加工和處理,四是信息的使用,每一個過程都可能涉及到信息的隱私化和隱私的信息化,關係到是否侵犯個人隱私。隱私信息化的過程相對簡單,容易引起人們的注意,但信息隱私化因其過程複雜,信息處在動態過程不容易把握而經常被忽視,因此更應該重視。

數字社會下的個人信息保護是一個難題,全世界都在試圖解決這一問題。2018年歐盟的《通用數據保護法案》(GDPR)開始實施,2019年11月,歐盟基本權利局又發佈了《面部識別技術:執法中的基本權利考慮》報告,提出人臉識別技術應用前必須有清晰、詳細的法律框架來監管人臉識別技術的部署和使用。但是,由於人臉識別技術應用場景的多樣性和複雜性,清晰、詳細法律的制訂是一件非常困難的事情,這一過程需要多學科、多領域學術性和應用性的深入研究和探索。多年來歐盟以及其它一些發達國家一直在探索這個問題,歐盟2018年推出《通用數據保護法案》之前,早在1995年就出台了《數據保護指南》,2020年1月1日《加利福尼亞州消費者隱私法案》(CCPA)也開始生效了,因此,國內相關法律也已出台。但可以預料,即使是出台全面的數據保護法律,也不一定能夠應對所有的現實問題,信息社會和智能社會下新的問題還會不斷湧現,數據治理與隱私保護的矛盾將會長期存在,但不管面多的問題如何改變,都應該遵循一些基本原則:

**第一個原則是最低限度原則。**任何組織和個人在面對個人信息時都要遵守這一原則,能不收集的信息就不收集,能少收集就少收集;**第二個原則是高門檻准入原則。**對於涉及個人信息收集的業務開展必須有嚴格的准入制度,對於個人信息的儲存、數據安全和業務必要性進行嚴格審核;**第三個原則是相關利益者知情原則。**當事者要把收集個人信息的目的、信息收集的方法、信息儲存、信息加工、信息使用的權限和邊界,信息使用的時間,信息銷燬等做明確的公示,確保利益相關者的知情權;**第四個原則是社會許可原則。**涉及公共服務的項目要在社會成員廣泛參與和討論下,在民眾充分知情和多數成員同意下才能實行;**第五個原則是事後補救原則。**在信息收集、儲存、處理和應用過程中對於可能的風險是否有補救措施,無補救措施則不可實行;**第六個原則是目的和結果一致性原則。**個人信息的收集、使用的目的和結果必須一致,不能隨意改變;**第七個原則是明確的責任承擔原則。**信息收集方要明確收集信息的儲存、保護和使用的風險,明確這一過程要承擔的全部責任,無法承擔責任則不可以實施;**第八個原則是時限原則。**對於所收集的信息嚴格設定使用和保存時限,在收集信息之前就要有信息銷燬的約定。

當然,僅有這些原則是不夠的,應該根據數據治理和隱私保護實踐做必要的調整,應該通過法治化途徑使一些原則程序化,形成可操作的嚴格的規程。只有在重新認識數字社會隱私概念的基礎上,通過建立產權清晰的制度框架,企業才能合法收集、利用數據,個人的信息保護訴求才具備治理基礎。當下要杜絕個人信息被濫用和個人信息的無界限收集,嚴格釐清信息使用和加工的邊界,嚴禁針對個人信息的過度整合,營造良好的信息使用環境,提高民眾隱私安全感,讓社會大眾可以放心使用信息資源,融入數字社會。