英偉達GTC上,“皮衣黃”也來蹭DeepSeek熱度了_風聞

大模型之家-带您探索人工智能领域的重磅资讯、解码热点话题55分钟前

“皮衣黃”嘴上全是主意,心裏全是生意。

3月18日,英偉達GTC(GPU技術大會)如期召開。在這場被視為“AI算力風向標”的盛會上,英偉達CEO黃仁勳以一貫的黑色皮衣造型亮相,發佈了多項重磅技術與戰略規劃,試圖再次鞏固其“AI底層引擎”的地位。

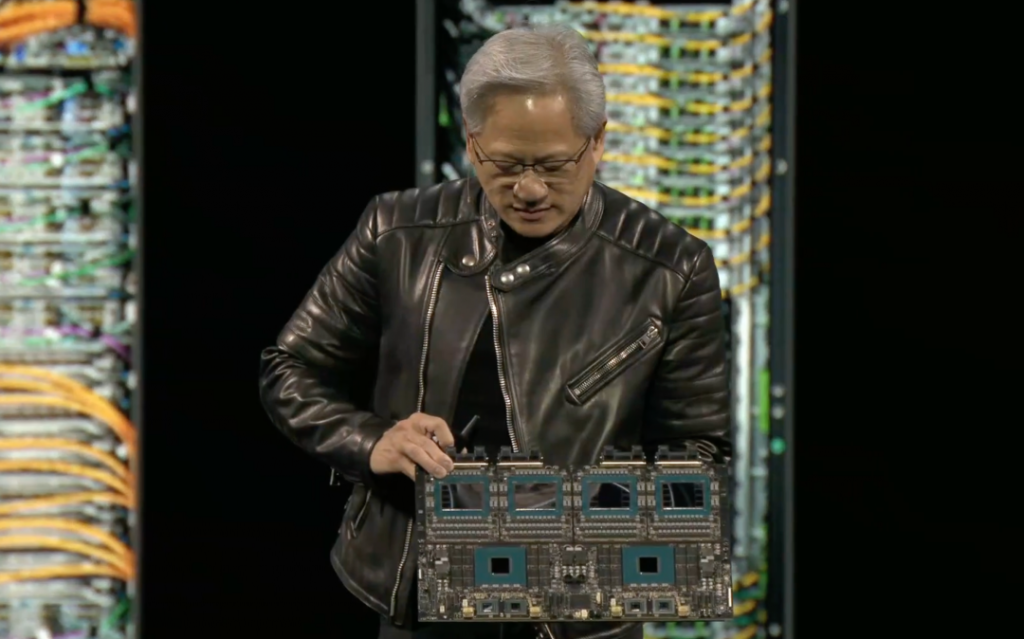

其中最受關注的,莫過於新技術與硬件的發佈。英偉達推出的Blackwell Ultra GPU採用了台積電3納米工藝,單芯片集成了2080億個晶體管,其FP8計算能力達到20 PetaFLOPS,相較於前代產品H100實現了五倍的性能提升,可支持萬億參數模型的即時推理。

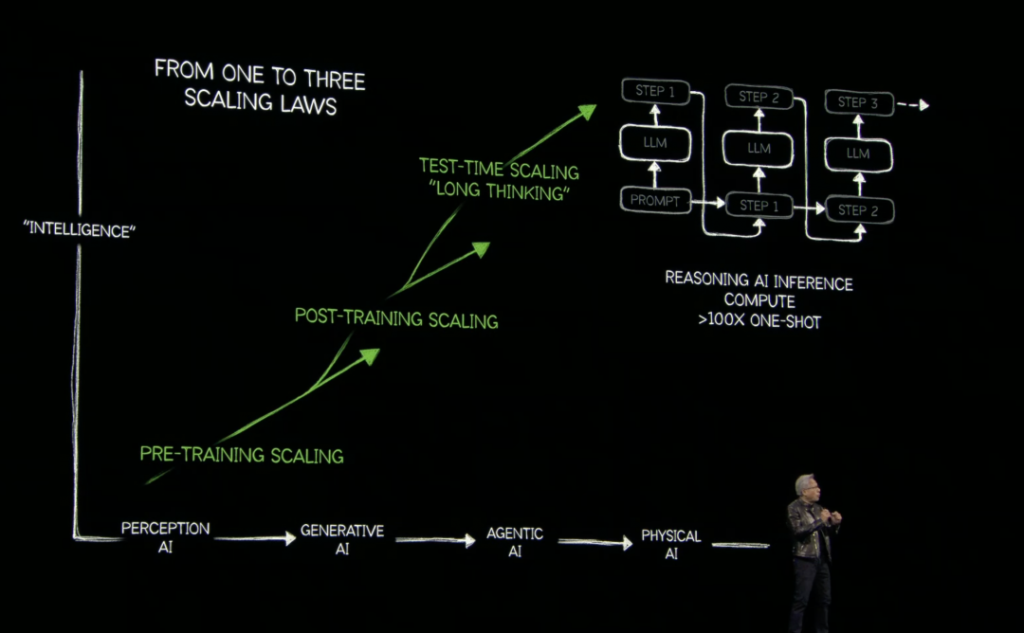

黃仁勳在演講中反覆強調:“推理算力需求被嚴重低估,實際需求是原預期的100倍。”此外,針對企業級市場的B300方案進一步展示了英偉達的野心,單集羣可訓練70萬億參數的多模態模型,微軟和OpenAI已宣佈部署該方案。

面向未來,英偉達提前公佈了2026年的Rubin架構,集成光子計算單元以降低延遲,晶體管密度較Blackwell再提升40%,直指動態推理優化的需求。在終端設備領域,RTX 8090顯卡首次實現本地運行2000億參數模型的能力,Jetson Orin Nano+機器人模組則以500 TOPS算力和15瓦低功耗瞄準工業自動化市場。現場展示的GR00T通用機器人更是以0.1毫米的操作精度引發轟動,黃仁勳宣稱“通用機器人時代已正式到來”。

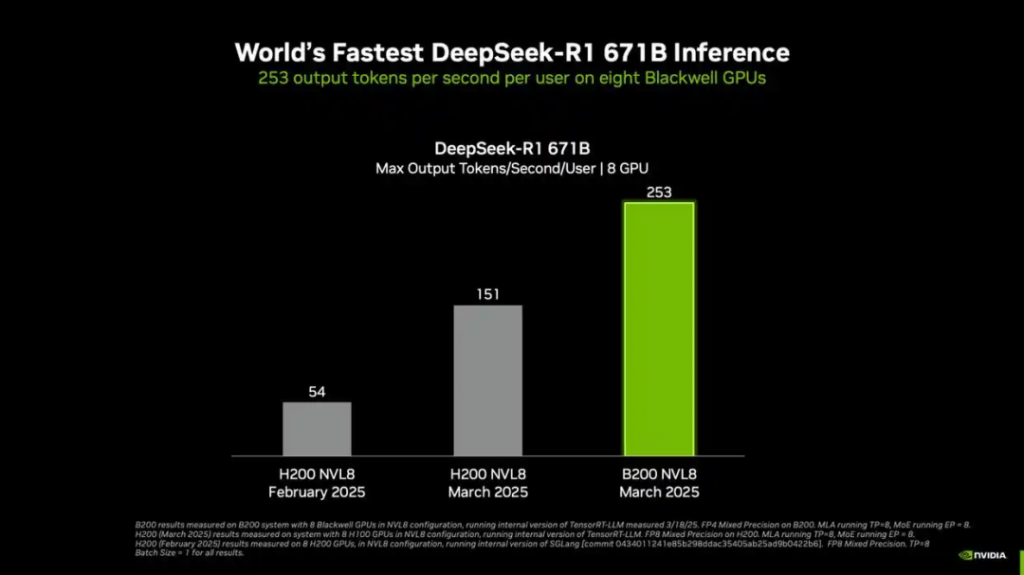

然而,這場技術秀的高潮並非英偉達的“獨角戲”。黃仁勳在演講中多次提及中國AI公司DeepSeek,稱其R1模型為“卓越的創新”,並高調展示雙方協同案例——“Blackwell芯片與DeepSeek-R1結合可為客户節省30%推理成本”。

問題由此浮現:黃仁勳,這位全球最渴求Scaling Law(尺度法則)的代言人,為何在自家主場上為競爭對手站台?

股價暴跌背後的算力焦慮,英偉達與DeepSeek“貌合神離”

讓我們把時間撥回到2025年1月27日,必是英偉達股價單日暴跌16.86%,市值蒸發5888億美元,創下美國上市公司單日最大跌幅紀錄。這場危機的導火索正是DeepSeek-R1模型的橫空出世。這款6710億參數的模型通過稀疏注意力機制、MOE多專家框架等技術,將算力需求壓縮至傳統方法的十分之一,單模型訓練成本低至557.6萬美元,僅為行業平均水平的五分之一。市場瞬間陷入恐慌:“高效模型是否意味着算力需求見頂?”

黃仁勳在GTC大會上坦然承認:“DeepSeek-R1的工程優化令人興奮不已,它證明了AI效率的突破。”但緊接着話鋒一轉:“但這只是冰山一角。後訓練(post-training)才是智能的核心,而它需要海量算力支撐。”更直言不諱地駁斥市場誤判:“有人認為DeepSeek-R1‘從天而降’後,不需要再做任何計算了。但事實恰恰相反——推理仍然是算力密集的。”其回應,堪稱矛盾藝術的典範。

緊接着,黃仁勳又宣佈其NVIDIA Blackwell DGX系統創下了DeepSeek-R1大模型推理性能的世界紀錄。

得嘞,合着您還是來蹭DeepSeek熱度給自己打廣告的……

雙方的競爭本質是技術路線的根本對立。英偉達的策略依然圍繞硬件製程迭代展開,從3納米到2納米的工藝躍進,配合AI工廠的規模化算力供給,試圖用“算力決定AI上限”的敍事鞏固話語權。其最新發布的Inference-X推理模型,在同等參數規模下響應速度較DeepSeek-R1快40%,能耗降低35%,顯然意在通過性能優勢壓制對手。

DeepSeek則開闢了一條截然不同的道路。通過動態token生成、FP8訓練優化和自研輕量級框架,其技術路徑聚焦於挖掘存量算力價值。開源工具鏈haiprof允許開發者分析Blackwell芯片的算力瓶頸,而聯合中國芯片廠商推出的“Blackwell兼容計劃”,更是直接挑戰英偉達的CUDA生態壁壘。這種“效率優先”的策略,不僅降低了算力門檻,更動搖了硬件廠商的盈利根基。

黃仁勳的潛台詞在演講中表露無遺:“DeepSeek是AI革命中的重要參與者,但英偉達構建的是支撐所有參與者的舞台。”言下之意,聚光燈下的主角或許輪換,但舞台的控制權始終掌握在英偉達手中。

算力焦慮的製造與販賣,黃仁勳“AI教主”形象破滅

近年來,黃仁勳不斷強化其“AI教主”的人設。2023年宣稱“10年內深度學習算力提升100萬倍”,2025年GTC上預言“2026年推理算力市場規模達訓練市場的5倍”,這些言論的本質是將算力稀缺性塑造為行業剛需。其力推的“AI民主化”看似普惠,實則暗藏商業算計——Blackwell芯片租賃定價18美元/小時,直接對標DeepSeek的公有云服務;單座AI工廠年耗電2.1 TWh(相當於24萬家庭用電),2030年全球部署500座的規劃,意味着至少750億美元的硬件採購需求。

這種策略在短期內確實提振了市場信心。面對DeepSeek引發的股價震盪,英偉達通過提前量產Blackwell架構並渲染“推理算力需求激增100倍”,成功實現12%的股價回升。但截至3月19日,其市值仍較年初峯值縮水約6000億美元。

另一方面,DeepSeek的技術突破正在動搖英偉達的敍事根基。其採用的強化學習驅動參數優化技術,可將200億參數模型的實際激活量壓縮至10億級;蒸餾訓練與自研框架的結合,使訓練成本降低90%;開源生態的構建更直接威脅CUDA的壟斷地位。摩根士丹利測算顯示,若DeepSeek方案普及,全球AI算力投資可減少30%-50%。這對依賴硬件銷售的英偉達而言,無異於釜底抽薪。

黃仁勳的困境在於,他既要維護英偉達的硬件霸權,又不得不承認效率優化的價值。這種分裂在GTC上暴露無遺:他高調稱讚DeepSeek,卻同步發佈“3個月實現競品80%性能”的端到端工具鏈;宣稱構建開放生態,卻通過CUDA 12.5兼容DeepSeek壓縮技術,將第三方芯片納入自家集羣掌控。這種既拉攏又壓制的策略,折射出硬件巨頭面對軟件創新的焦慮。

英偉達的危機不僅來自外部競爭,更源於自身商業邏輯的侷限性。當投資者意識到,萬億參數模型未必是AI發展的唯一方向,當企業開始權衡“算力邊際收益”與“能效成本”,黃仁勳的“算力永動機”敍事便難以為繼。其“AI教主”形象,終將在效率革命與技術民主化的浪潮中逐漸褪色。

算力未來的雙重敍事

英偉達與DeepSeek的較量,本質上是兩種產業邏輯的碰撞。一方是硬件驅動的“規模擴張”,另一方是軟件優化的“效率革命”;一邊是生態閉環的掌控欲,另一邊是開源協作的顛覆力。黃仁勳的“站台”與“反擊”,實則是試圖在兩者間維持微妙平衡——既借DeepSeek證明算力需求的“永續性”,又以技術迭代鞏固自身壁壘。

然而,當DeepSeek用開源工具鏈撕開CUDA的生態裂縫,當市場從“算力狂熱”轉向“成本理性”,英偉達的“舞台”或許正悄然縮小。技術史反覆證明,沒有永恆的霸主,只有持續的創新。在這場AI算力的範式變革中,“皮衣黃”的嘴上主意與心裏生意,終將被效率與價值的終極標尺重新衡量。

算力的未來,從來不止一種答案。