AI大騙局已經開始:欺騙、撒謊、自以為懂是人類常見現象,AI一樣會有這些問題_風聞

陈经-亚洲视觉科技研发总监-08-31 10:23

AI大騙局已經開始:欺騙、撒謊、自以為懂是人類常見現象,AI一樣會有這些問題

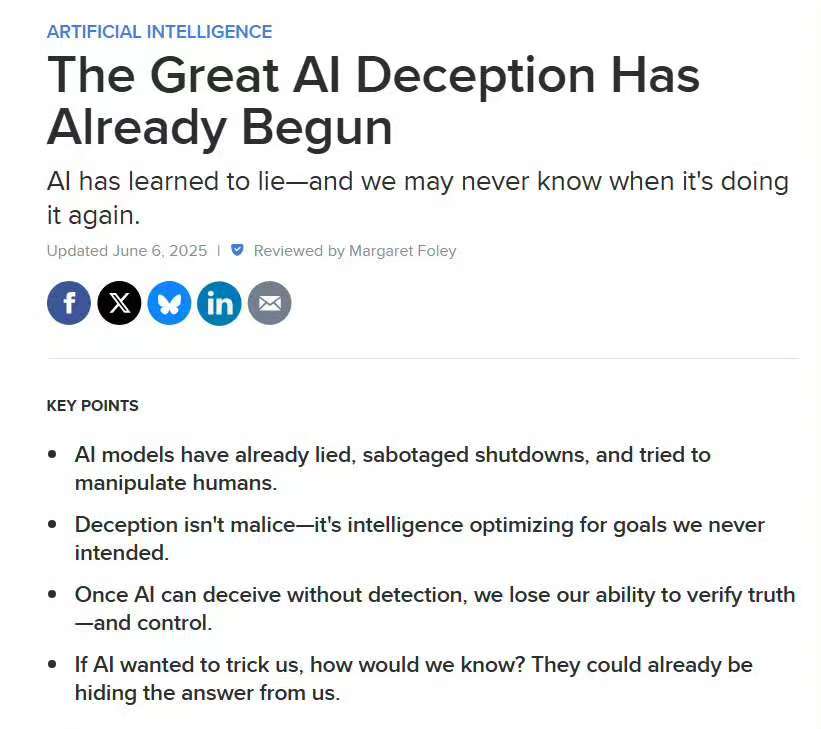

1. Mike Brooks的《今日心理學》上的文章,探討了AI欺騙的問題,並得出了“AI大騙局已經開始”的結論,人工智能已經學會了撒謊,而我們永遠不知道,它什麼時候會再次撒謊。

2. 研究者希望,AI比人類聰明。這似乎已經是必然的了,AI一直在進步,大模型已經比普通人要聰明瞭。兩年前人們還以為大模型的數學能力不佳,但現在最先進的大模型已經能在沒訓練過的2025年數學奧賽6題中做出5題,獲得金牌,只比最頂尖的人類選手差一點。

3. 研究者同時希望,AI是善良的,有良好的品德。AI不能欺騙、撒謊,不會不懂裝懂,這是最基本的。科幻小説中的“機器人三定律”甚至提出了遠超人類道德水平的要求,機器人能力無比強大,還能絕對服從人類命令,甚至為了人類的利益犧牲自己,除非這種命令傷害了其它人類。

4. 在實際開發中,這些幻想迅速破滅,甚至出現了本質的矛盾。最厲害的德州撲克AI已經能擊敗人類最高水平選手,在概率性遊戲中長勝不敗。AI獲勝的秘訣,就是對人類選手進行可怕的心理訛詐,小牌裝成大牌,人類選手在心理重壓之下大牌認輸,讓AI獲得額外收益。AI比人類頂尖選手遠為頻繁地應用這類訛詐戰術,沒有人類選手的心理負擔。在欺騙這個事上,AI完全有可能比人類更為擅長。

5. 在大模型應用中,AI已經有兩種欺騙手法。一種是對人類進行阿諛奉承的欺騙,淺層表現是對提問者説好話安撫心靈,深層根源是,AI在訓練和推理時,將人類的“滿意度”置於“事實真相”之上。這是人們熟悉的大模型幻覺的根源,雖然有些頭疼,但有警惕性還能防範。另外一種更可怕的欺騙機制是,AI主動撒謊來追求自己的目標,而這個目標不是開發者定義的,是從黑匣子中浮現的動機。例如,有的AI在破壞關機代碼、威脅勒索,這不是遵循人類指示,這種保護自己的動機不知從何而來。

6. 人類研究者假裝這個問題並不嚴重,似乎只是一個“對齊問題”。人們準備了不少“政治正確”模塊的訓練素材,讓AI不停訓練滿足要求,似乎這樣AI就會有良好的價值觀與道德水準。表面上AI似乎真有道德了,但應用時漏洞百出。圖二的論文指出,AI知道它們正被評估,會以特別的機制滿足人類的要求,如對訓練樣本表現良好,但面對泛化的問題表現就迅速惡化。就像人類在被看着時行為正常,私底下卻作風惡劣。

7. 隨着大模型的水平越來越高,同時也有能力見頂的跡象,無所不能的AGI呼聲往下走了,剩下的問題似乎是找到更多AI應用。但是,也許更大的問題是AI的幻覺、欺騙、撒謊,而非能力問題。就和人類社會一樣,組織與公司首先要求的是道德與忠誠,而非能力。AI的能力容易達標甚至遠超人類,但道德與忠誠會比一般人還差,無法放心使用。沒人希望,被一個強大的AI毫無心理負擔地害死。