支持文生視頻和圖生視頻,阿里旗下大模型萬相2.1宣佈開源

周毅是故意的还是不小心?

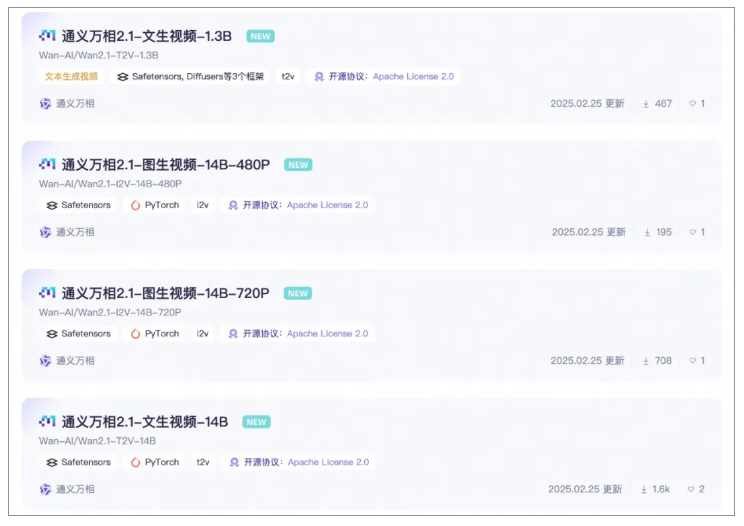

2月25日晚間,阿里巴巴宣佈,阿里雲視頻生成大模型萬相2.1(Wan)開源。此次開源採用Apache2.0協議,14B和1.3B兩個參數規格的全部推理代碼和權重全部開源,同時支持文生視頻和圖生視頻任務,全球開發者可在Github、HuggingFace、魔搭社區下載體驗。

通義萬相是阿里雲通義系列AI繪畫創作大模型,可輔助人類進行圖片創作,於2023年7月7日正式上線。今年1月初,通義萬相視頻生成模型宣佈升級至2.1版,憑藉着優秀的表現,在權威評測榜單VBench中登上榜首。

微信公眾號“阿里雲”截圖

公開資料顯示,此次開源共包括兩個參數版本模型。

其中14B版本萬相模型,在指令遵循、複雜運動生成、物理建模、文字視頻生成等方面表現突出,在權威評測集Vbench中,萬相2.1以總分86.22%大幅超越Sora、Luma、Pika等國內外模型,穩居榜首位置;1.3B版本萬相模型,超過了更大尺寸的開源模型,還和一些閉源的模型結果接近,同時能在消費級顯卡運行,僅需8.2GB顯存就可以生成480P視頻,適用於二次模型開發和學術研究。

演示材料顯示,萬相大模型在多個內部和外部基準測試中,均大幅超越現有的開源模型以及頂尖商業閉源模型。萬相能夠穩定展現各種複雜的人物肢體運動,如旋轉、跳躍、轉身、翻滾等;能夠精準還原碰撞、反彈、切割等複雜真實物理場景。在指令遵循能力方面,能夠準確理解中英文長文本指令,還原各種場景切換、角色互動。

本文系觀察者網獨家稿件,未經授權,不得轉載。