謝耘:人工智能至今仍不是現代科學,人們卻熱衷用四種做法來粉飾它

guancha

【文/謝耘】

“人工智能”一詞是在1956年夏天在美國達特茅斯學院舉行的一個研討會上提出來的。從此,它成為了人類試圖用現代科學與技術手段來複現人類所具有的智能的這一工作領域的正式學術名稱。

但是“人工智能”的開山鼻祖,卻並不是這次參會的人,而是大名鼎鼎的圖靈。

圖靈被尊為人工智能之父,原因在於在人們糾纏於如何定義或描述什麼是人類的“思考”或所具有的“智能”的時候,他“巧妙”地避開了這個問題。於1950年在一篇論文中他提出了一個“可操作”的判定機器是否具有了與人一樣的“思考”能力的測試方法,即著名的“圖靈測試”。

有趣的是這篇《計算機器與智能》的論文並不是發表在科學類雜誌上,而是刊登在心靈學會的季刊《心靈(Mind)—心理學與哲學》上(A. Turing,“Computing Machinery and Intelligence”,《Mind》,59(236):第433-460頁,1950)。

刊載圖靈論文的期刊

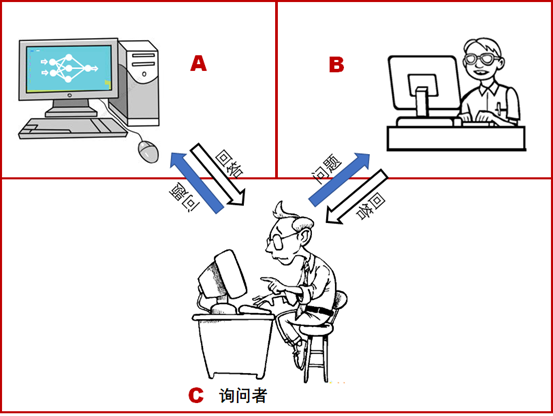

圖靈測試,簡單地説就是讓一個人(詢問者)只通過鍵盤與顯示器與在另外一個與其嚴格隔離的房間裏的“智能體”對話,這個“智能體”可能是一個人,也可能是一台機器。對話內容不限。如果經過一段時間的對話,一台機器給出的回答讓這個詢問者無法確定它是人還是機器,則這台機器便被認為具有了與人一樣的“思考”能力,也就是智能。

圖靈之並沒有限制對話內容,因為我們無法確定智能的邊界在哪裏。

圖靈測試示意

由於這個測試過程只通過鍵盤與顯示器進行,所以它將人的“思考能力”與其它特徵做了有效的隔離,如文中所説“在人的物質與知識能力之間劃了一條鮮明的分割線”;另外詢問者只看輸入和輸出結果,所以這是一個黑箱測試,避開了對機器和人“思考”的內在機制過程這一複雜問題的關注。

圖靈在文中針對9個與他立論相關的挑戰性問題做了討論。但是這9個問題中,前8個都不是針對圖靈測試本身的疑問,而是針對“機器是否能思考”這個問題的,這是他論文價值的前提。只有第9個所謂的超感知問題與圖靈測試有一點關係。但這個問題已經進入到“玄學”領域了,不屬於科學研究的範疇。所以不能認為圖靈設想的這些問題是對圖靈測試本身的疑問。

70多年來,對於圖靈測試有許多討論,但是所有的討論似乎都遺漏或忽視了一個關鍵的問題。下面這句來自一篇綜述性文章的話,典型地反映了這個情況:

“圖靈測試的重要特徵首先在於它給出了一個可操作的智能定義,也就是根據對一些列特定問題的反應來決定一個客體是否是智能體,這就為判斷智能提供了一個客觀標準,從而避免了有關智能本質的無謂爭論。”(宋永剛,“圖靈測試:哲學爭論及歷史地位”,《科學文化評論》,第8卷第6期,第42-57頁,2011年)

圖靈測試確實是“可操作”的,所以它不是哲學思辨性的。但是它是如上所述的一個遵循“客觀標準”的測試嗎?這是一個非常基本而重要的問題。因為現代科學的基礎前提便是客觀性,離開了客觀性就不再是真正意義上的“科學”。

我們不難發現,圖靈測試是一種主觀評價方法,不是客觀性測試。它的“可操作性”讓其具有了現實可落地性,但是並沒有導致它具有客觀性。或許有人會説,我們可以用足夠多的人去做測試,然後再對這些人的評價結果做平均豈不就消除了個體的主觀性了嗎?

科學講的客觀性並非此意。科學的客觀性是指任何人做同樣的測試,結果都是一樣的,與具體測試人的主觀意識無關,而不是通過對眾多測試做“平均”去獲得與個體主觀判斷的無關性。

相對論中講不同的觀察者看到的情況可以不一樣,這種不同並非緣於觀察者的主觀意識,而是取決於觀察者所處的客觀地位(所謂的參照系)。所以這種不同依然具有明確的客觀性。

“2014年英國《每日電訊報》報道,一台由俄羅斯人弗拉基米爾·維西羅夫(Vladimir Veselov)創立的模擬13歲小男孩的人工智能軟件尤金·古斯特曼(Eugene Goostman)通過了‘標誌性的’圖靈測試。在2014年舉行的共有5台超級計算機參賽的圖靈測試競賽上,尤金·古斯特曼設法讓測試人相信被測試者33%的答覆為人類所為。這一測試成功正逢圖靈去世60週年紀念,被認為是人工智能領域裏程碑式的突破。”(圖靈測試-百度百科)

2022年大語言模型興起後,更多的系統“通過了圖靈測試”。但是這一切,都沒有產生公認的“機器已經具有了與人一樣的思考能力”的結論,雖然不斷流行着各種聳人聽聞的説法。這從一個側面説明,圖靈測試這種黑箱主觀評價方法,並不是一種衡量機器是否有與人一樣思考能力的具有客觀性的科學測試標準或方法。

事實上,在圖靈這篇論文開篇的核心便是這樣一種主觀方法,所以不難理解,論文的後續內容中,還有許多與科學規範要求相悖的論述,比如將猜測當作事實,並且基於猜測和類比去下明確的論斷。

在展望未來的時候,圖靈寫道:“(為了讓機器像人一樣思考)恐怕根本不需要再增加機器的操作速度。現代機器中那些可以認為相當於(大腦)神經細胞的部件的工作速度大約超過了神經細胞的一千倍。”(“It is probably not necessary to increase the speed of operations of the machines at all. Parts of modern machines which can be regarded as analogs of nerve cells work about a thousand times faster than the latter.”)

事實上,不要説當初,就是在今天我們對人腦神經細胞到底是怎樣工作的依然知之甚微,我們沒有掌握多少依據去説計算機中哪些部件的什麼功能當於這些細胞的哪些具體功能作用,這些思考充其量只能是一種不知是否有意義的粗糙類比;在這個基礎上去比較兩者的工作速度是沒有意義的;而基於這種速度的比較去做進一步的推斷,就更沒有説服力了。

換句話説,圖靈的這個陳述只能算是一些相互關聯的有待檢驗的推測,而不是基於事實的嚴謹論證的結論。這段話的第一句,確實加了“恐怕”這樣的推測字眼,但是後面提供的推測基礎的陳述卻用了肯定句式,意在陳述確鑿的事實。

科學探索中,當然需要做各種推測、猜想、類比等等不可避免地帶有主觀色彩、未必一定有意義的工作。在探索中,這些工作的必要性與價值毋庸置疑。但是這些工作是探索的過程,不是下科學論斷的依據或方法。科學本身,或稱科學的論斷只能是事實或基於事實與嚴謹的分析論證結果。

如果作為一篇心理學的論文,那些主觀色彩或不嚴謹可能都不是大問題,因為心理學還不是現代意義的科學。而且這篇文章本來也是發表在心理學刊物上的。但是,如果把它作為現代科學意義上的論文,就會產生眾多顯性與隱性的不良後果。

不幸的是,後人好像確實把它作為了科學論文來看待,並且被當作了以科學的面目出現的“人工智能”學科的奠基之作。圖靈測試被認為是“為判斷智能提供了一個客觀標準”,圖靈也因提出圖靈測試而被尊為“人工智能之父”。不知到這一切是否符合圖靈寫作此文的初衷。

沿着這種張冠李戴去觀察人工智能一路走來的過程,我們會發現自1956年人工智能正式亮相後,在這個被認為屬於科學的領域中,即使在學術研究中也一直普遍存在着許多與基本科學規範相悖的現象與做法。

比如,將猜測想象當作事實。

超級智能將控制人類的説法這些年很是流行,而且許多“學者”在嚴肅地“研究”如何面對這種局面。這幾乎完全是一種想象。要控制人類,首先要有“自我意識”。今天我們對於人類的自我意識都沒有清楚的認識,更不要説用計算機的算法去構造一個自我意識了。許多人把人工智能的一些表現,解釋為其具有了“自我意識”,不能不説這屬於浪漫的想象,而沒有符合科學規範的依據。

比如,用想象類比去做論證。

這種做法十分的流行,包括在人工智能的學術界。想象與類比只能是一種啓發我們思考的方法,而不是科學論證的手段。在我們對大腦神經元的基本工作機制並不清楚的時候,用計算機處理過程去類比神經元的功能,一直是一個流行的做法。今天的“類腦計算”是一種試圖超越代計算機原理架構的嘗試,到底會產生什麼樣的結果,只能看未來的實踐情況。因為它被冠以“類腦”就認定其大有前途,這僅僅是一種想象。因為我們還不清楚大腦到底是如何“計算”的。説“類腦”只是一種極為粗淺的比喻,其實際情況可能與大腦中起關鍵作用的特性沒有太大的關聯。

歐盟在2005年支持了一個由瑞士的洛桑聯邦理工學院腦研究中心與IBM聯合發起的雄心勃勃的“藍腦”計劃。他們計劃利用海量的計算能力,基於計算機模擬技術,用對應於人腦的基礎性物質層面活動的算法去模擬人腦內部的物理生化過程。該項目計劃在2023年左右實現在分子水平上對人腦的完整模擬。

許多從事人工智能研究的學者對該計劃抱有很大的希望。但是這個計劃的設立,顯然是建立在對大腦的想象而不是真實的認知基礎上做的論證。事實上,歐盟支持的這個藍腦計劃在2016年執行10年之後終於被發現有嚴重問題,項目負責人被撤換,並且實質性地改變了項目方向與目標。(謝耘,《智能化未來—“暴力計算”開創的奇蹟》,第265-268頁,機械工業出版社,2018年6月)

歐盟藍腦計劃的官方網站首頁

這種項目如果沒有嚴重問題反倒是一件奇怪的事情,因為按照基本的科學規範去分析,很容易看出這個項目缺少基本的科學依據。

比如,狐假虎威地利用熟知的可信經典概念去包裝某些推測。

“定律”(law)一詞在科學中是有清晰明確的含義的,指的是普適性的物質運動規律,這些規律會有一定的適用條件,但是不會隨時間的推進而失效。在1965年,英特爾創始人之一戈登·摩爾提出了對集成電路發展趨勢做經驗性預測的“摩爾定律”。很明顯這個“定律”並非是科學意義上的“定律”,但是確實有業內資深人士將它與科學定律混為一談。“摩爾定律”或許是非科學意義上的最著名的“定律”了。

不知是否是受的“摩爾定律”啓發,在大語言模型興起後,有人提出了“尺度定律”(Scaling Law),推測在機器學習領域,特別是對於大型語言模型而言,模型性能與其規模(如參數數量)、訓練數據集大小以及用於訓練的計算資源之間存在着一種可預測的關係。這種關係通常表現為隨着這些因素的增長,模型的表現會按照一定的冪律進行改善。有人把它簡化為了五個字:“大力出奇跡”。它被當成了大語言模型預訓練的“第一性原理”。有許多人更是依據這個“原理”認為,只要規模不斷擴大,通用人工智能(AGI)便不再是遙遠的夢想。這也是很多學者在“研究”如何防止超級人工智能控制人類的緣由之一。

但是這個“尺度定律”的壽命似乎遠遠沒有摩爾定律長,已經有很多實例與之相悖了,相信這條路能夠實現AGI的人似乎在不斷減少。

這方面的例子還有“數據科學”一詞。當然在“科學”早就被其它眾多領域濫用的情況下,創造“數據科學”一詞的做法似乎也並不為過,雖然它確實還不是“科學”。

再比如,創造內涵蒼白的新詞或“神話”內涵簡單的概念。

這方面的一個典型的例子就是在眾多學術工作中,特別是在“大力出奇跡”聲中的人工智能領域頻繁出現的“湧現”一詞。這個詞原本就是一個標籤,指複雜系統出現的那些還無法清晰解釋其背後機理的那些功能表現。它既沒有説明什麼情況下會出現這些功能表現,更沒有闡述這些功能表現會具有什麼特性。

但是現在人們動則便使用這個詞作為依據,用來論證自己構造的複雜系統必定會有奇蹟出現。在一定程度上,它成為了一塊帶着高科技光芒的遮羞布。(謝耘,《工具的甦醒——智能、理解和信息技術的本質》,第221-228頁,機械工業出版社,2025年4月)

這些在學術領域內的做法並非是在做科學之上的哲學思考,而是給科學之下或之外的內容披上科學的外衣,去達到各種非科學的目的。在客觀效果上,這些做法讓人工智能,這個沒有科學原理基礎的現代工匠技藝,在許多人的心目中躋身於了現代科學之列。

近年來,隨着商業資本的深度介入,這些現象愈演愈烈,各種頗具誤導性甚至聳人聽聞的説辭以科學的面目頻頻出現。

早在1965年,蘭德公司的研究顧問德雷弗斯(Hubert L. Dreyfus,1929年出生,當時在MIT任教,1964年獲博士學位)在其發表的著名的《鍊金術與人工智能》報告中,針對這類行為中的想象、誇張等説辭就尖鋭地指出:“(這相當於)第一個爬上樹的人可以聲稱自己在實現飛向月球這一目標的努力中取得了顯著的進步。”(Huber L. Dreyfus,“Alchemy and artificial intelligence”,Page 17, The Rand Corporation,1965.)

這篇報告在當時引起憾然大波,遭到人工智能界的普遍反對,對人工智能的發展產生了重要的影響。它成為蘭德公司銷售量最大的報告之一。

該報告之所以使用“鍊金術”作為標題的關鍵詞,是因為作者認為人工智能缺少科學基礎,還是一種鍊金術般的工匠技藝,其目標與手段之間並沒有可靠的內在邏輯。該報告後來成為蘭德公司銷量最高的報告之一。

他以鍊金術為例指出,人工智能需要做一些更加基礎性的工作,建立堅實的科學基礎才是正確的發展途徑:“如果鍊金術士把時間花在尋找問題的深層結構,如果那個(第一個爬上樹的)人從樹上下來致力於比如發現火和輪子,事情就會向一個更令人鼓舞的方向發展。畢竟,三百年後我們確實從鉛提取了黃金(並且我們要接觸到月球了),但這隻有在我們放棄了鍊金術水平上的工作,達到化學水平甚至更深層次的原子水平上後才會發生。”

在這篇報告發表整整60年後,今天人工智能依然徘徊在現代科學的大門之外,停滯在現代工匠技藝的層面。祭出圖靈或其它的名人,並改變不了這個無奈的事實(謝耘,“人工智能:一種現代工匠技藝”,微信公眾號“慧影Cydow”,2025年4月7日)。在這個領域內,許多的猜測、想象、類比、純概念的思辨甚至是信念披上了科學的外衣。這種包裝,既無助於讓人工智能跨入現代科學的大門,其實也無益於讓人工智能作為一種實用技術更好地發展。因為這些包裝帶有很大的誤導性。當然這些包裝可能會有助於到達其它的目的,那就是在科學與技術之外的事情了。

説人工智能是一種現代工匠技藝,只是在陳述一個當下的實際情況,並無褒貶之意。在現代科學與技術蓬勃發展了三、四百年並且極大地改變了人類社會之後,一個工匠技藝脱穎而出成為了改變社會的一個強大的力量,不能不説這是頗為匪夷所思,甚至相當地詭異。正因為發生在現代科學與技術高度發達的背景之下,很多人並沒有意識到它與其它現代科學與技術之間的本質差異。(謝耘,《工具的甦醒—智能、理解和信息技術的本質》,第一章 讓意識掙脱大腦,機械工業出版社,2025年4月)

技術是以解決問題為目標的,最為關鍵的是其解決問題的有效性,而不是它背後是否有、或有什麼樣的科學理論。經過了近百年的努力,我們依然沒有能夠建立人工智能的科學理論,但是人工智能作為技術藉助“暴力計算”確實取得了長足的發展,在各個領域內不斷擴大着其可以解決的問題的範圍與深度。

面向未來,不論是人工智能科學理論的產生,還是它繼續作為一門現代工匠技藝的不斷發展完善,我們都應該堅守現代科學與技術所遵循的基本理性規範,而不是讓非科學與技術的其它邏輯或因素來主宰這門技術自身的未來。

本文系觀察者網獨家稿件,文章內容純屬作者個人觀點,不代表平台觀點,未經授權,不得轉載,否則將追究法律責任。關注觀察者網微信guanchacn,每日閲讀趣味文章。