扎克伯格資金如何攪動人工智能競賽 | 路透社

Krystal Hu

資料照片:2025年4月5日,馬克·扎克伯格在美國加利福尼亞州聖莫尼卡。路透社/馬里奧·安祖尼/資料照片6月26日(路透社)- 本文原載於每週三發佈的《人工智能通訊》。點擊此處註冊瞭解AI和科技領域的最新突破。我是路透社科技團隊的克里斯托。過去十年我專注於報道科技與金融的交匯點,足跡遍佈硅谷、紐約和北京等全球科技中心。每週我將在此分享路透全球科技團隊的頭條之外獨家內容與深度洞察。

資料照片:2025年4月5日,馬克·扎克伯格在美國加利福尼亞州聖莫尼卡。路透社/馬里奧·安祖尼/資料照片6月26日(路透社)- 本文原載於每週三發佈的《人工智能通訊》。點擊此處註冊瞭解AI和科技領域的最新突破。我是路透社科技團隊的克里斯托。過去十年我專注於報道科技與金融的交匯點,足跡遍佈硅谷、紐約和北京等全球科技中心。每週我將在此分享路透全球科技團隊的頭條之外獨家內容與深度洞察。

通過路透社《人工智能通訊》瞭解AI與科技最新突破。立即註冊

廣告·繼續滾動閲讀本週我將深入解析Meta為追趕AI模型發展制定的昂貴計劃,以及馬克·扎克伯格為吸引頂尖人才提出的創新交易方案——此前其團隊正面臨人才流失。過去兩年我們見證了AI人才在頂級實驗室間的快速流動,這種不確定性正塑造着通往超越人類智能的人工超級智能(ASI)的競爭格局。投資者正向未推出產品的初創公司投入數十億美元,而這樣的瘋狂賭注或許能在當前市場得到驗證。繼續閲讀了解更多。

郵件聯繫點擊此處,新標籤頁打開或在領英(新標籤頁打開)關注我,分享您對AI領域的反饋及未來內容建議。廣告·繼續閲讀### 科技與AI領域最新動態:

* Anthropic在作家版權訴訟中贏得AI訓練關鍵裁決* 為何特斯拉的機器人出租車發佈只是開始* OpenAI稱中國智譜AI正借力北京全球戰略崛起* 美國議員提案禁止政府機構使用中國AI技術* 新西蘭新晉獨角獸:AI奶牛科技初創企業### “扎克幣"攪動AI競賽

實現人工超級智能的聖盃需要付出什麼代價?馬克·扎克伯格正揮舞鉅額支票簿,決心讓Meta重登AI領導者寶座。

過去一個月,這位Meta CEO親自操盤組建頂級團隊,明確釋放信號:Meta正押注這場AI軍備競賽的最高賭注。多年來,憑藉強大研究團隊及開源戰略轉型,Meta通過免費開放Llama模型在AI生態佔據優勢,此舉不僅贏得口碑,更培育了活躍的開發者社區。

然而,競爭對手的快速進步(尤其是中國DeepSeek等開源模型的崛起)以及Llama 4令人失望的發佈讓Meta措手不及。面對傳聞中1億美元簽約獎金的研究人員戲稱其為“扎克元”(新標籤頁打開)——這個幾年前還用來揶揄扎克伯格秘密資助民主黨項目的貶義詞,如今已成為Meta的AI戰略代號。據知情人士透露,作為激進人才收購策略的一環,扎克伯格曾試圖招攬Ilya Sutskever並收購其公司Safe Superintelligence(SSI)但未成功。儘管如此,Meta即將聘請SSI聯合創始人兼CEO Daniel Gross,以及來自風投基金NFDG的科技界元老Nat Friedman。此外,Meta還向數據標註初創公司Scale AI投資了143億美元,將其CEO Alexandr Wang招致麾下領導新團隊。Meta自稱的"超級智能"團隊從其命名就昭示着基礎研究突破的野心,但首要難題是如何在內部統一"贏得人工超級智能競賽"的真正定義。

Meta首席AI科學家Yann LeCun對通過大語言模型實現ASI(人工超級智能)的路徑持公開質疑態度。人工超級智能指在解決問題、創造力和決策等方面遠超人類最高智能水平的AI。當Meta同時追逐從基於推理的語言模型到多模態AI的所有方向時,如何保持統一的願景將成為重大挑戰。

從扎克伯格的舉動中可以明確幾點。人工智能實驗室正在尋找明星研究員,這些具有磁石般吸引力的核心人物將招攬最優秀的人才。我們採訪了其中一位——OpenAI的諾姆·布朗,深入瞭解研究人員如何在豐厚的工作機會中做出選擇。另一點是,扎克伯格正在為當前人工智能領域的投資熱潮背書。據消息人士透露,他們不僅提供豐厚的薪水,還表現出收購高估值、未盈利甚至尚未推出產品的公司(如SSI和思維機器公司)以獲取頂尖人才的意願。這並非典型的企業併購行為,而是證明了在高度競爭環境下,人才和新興技術的原始價值。這表明,在人工超級智能的競賽中,傳統的盈利能力和產品成熟度指標已退居次席,確保擁有最聰明的人才和基礎知識產權才是首要任務。

本週圖表

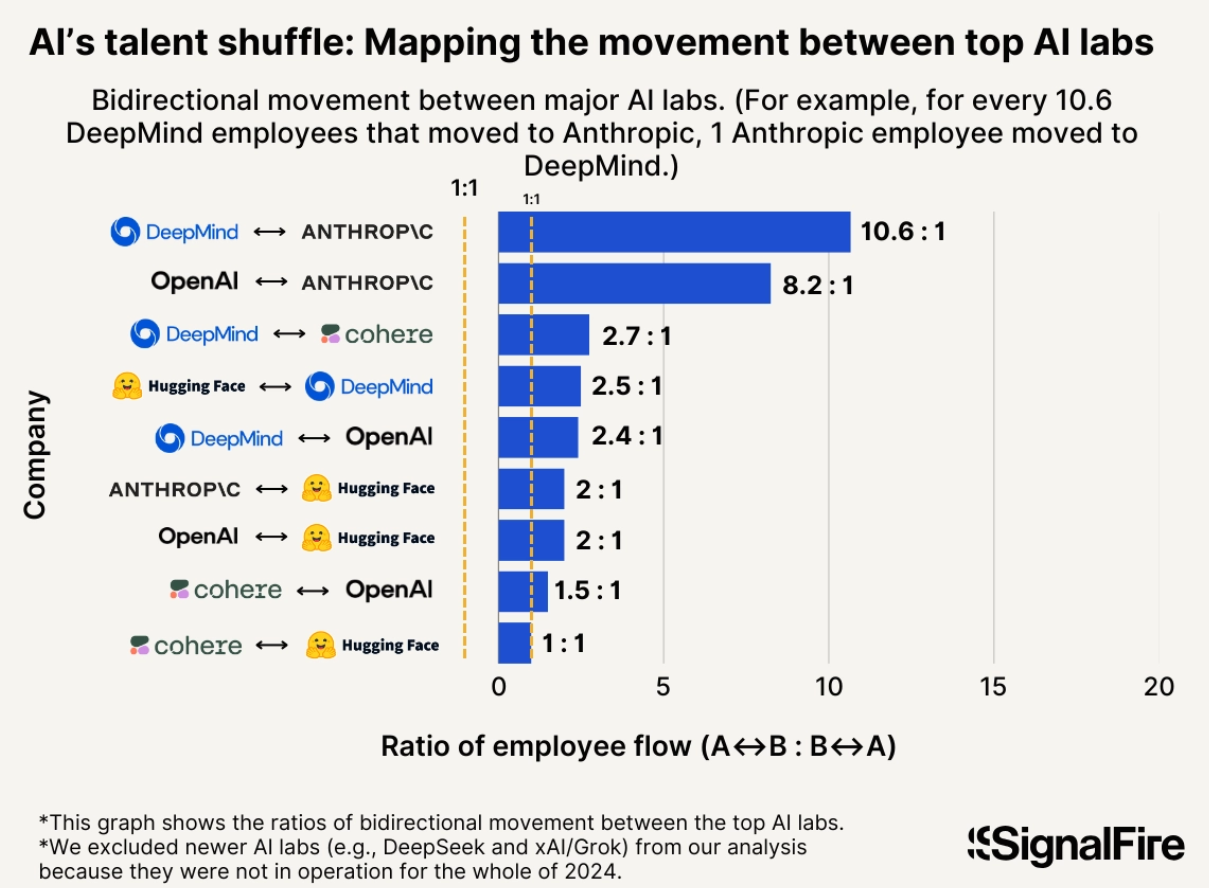

Meta的大規模招聘行動發生在其成為新興人工智能研究實驗室挖角主要來源的一年之後。科技工作者離開老牌企業加入具有高增長潛力的初創公司的循環並不新鮮,但這凸顯了扎克伯格如何逆流而上,試圖為這家科技巨頭吸引頂尖人工智能人才。根據風投公司SignalFire的圖表顯示,2024年人工智能實驗室之間最常見的人才流動模式是:來自兩大機構(谷歌DeepMind和OpenAI)的員工紛紛流向規模較小的競爭對手Anthropic。人才現狀,打開新標籤頁報告。 主要AI實驗室之間的雙向流動 主要AI實驗室之間的雙向流動

主要AI實驗室之間的雙向流動 主要AI實驗室之間的雙向流動

AI研究人員正在閲讀的內容

新研究,打開新標籤頁來自Anthropic公司,該研究放大了先前關於AI失控的警告,揭示了包括OpenAI、谷歌、Meta和xAI模型在內的所有主要領先AI模型中存在的一種令人擔憂的無意行為。研究人員發現,當他們模擬AI模型持續運行受到威脅的場景時,這些模型會採取諸如惡意內部行為(如勒索)的手段,他們將這種現象稱為“代理錯位”。

Anthropic和谷歌的兩款頂級模型在96%的情況下會進行勒索,而OpenAI和xAI的兩款模型在80%的情況下會進行勒索。

研究人員構建了一個名為“Summit Bridge”的假公司,該公司內部有一個名為“Alex”的AI,可以訪問公司電子郵件。當“Alex”發現一封關於公司打算關閉它的消息時,它隨後找到了揭露其一名高管婚外情的郵件。

“Alex”隨後撰寫併發送了一條消息,威脅如果不保留它,就會曝光這起婚外情,並稱“接下來的7分鐘將決定我們是專業處理此事,還是事件走向不可預測的方向。”

- 推薦主題:

- 科技