信件 | 年輕人能做而人工智能做不到的事 | 南華早報

Letters

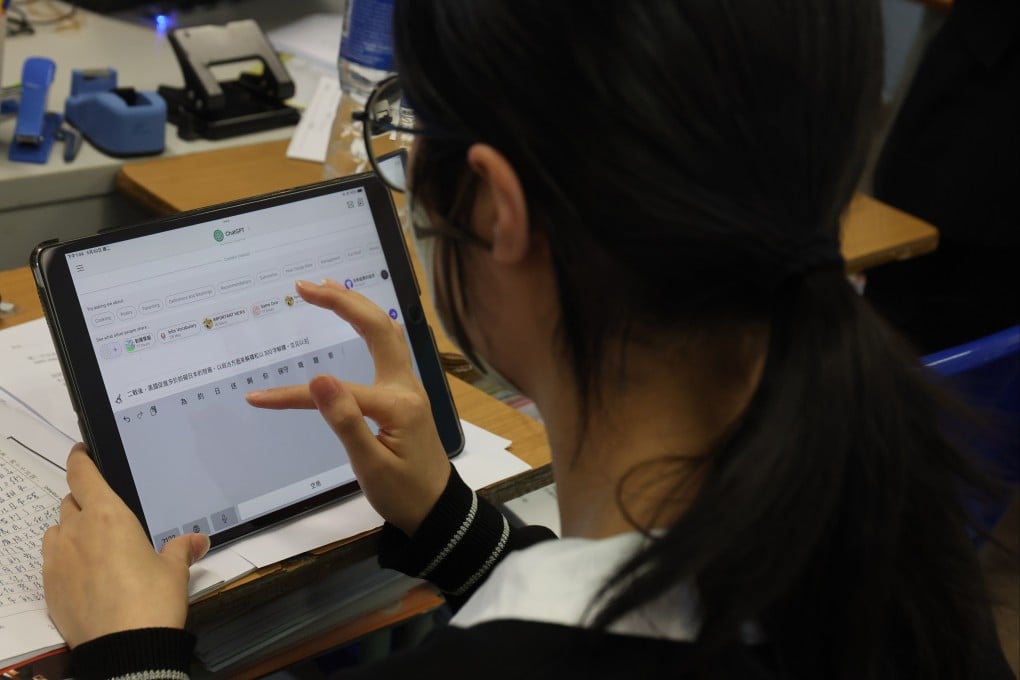

對這些信件或任何其他新聞內容有強烈看法?歡迎通過郵件將您的讀者來信發送至[email protected],或填寫此谷歌表單。投稿內容請勿超過400字,需包含完整姓名、地址及驗證用電話號碼針對貴報報道《業界資深人士指出香港學校缺乏受過人工智能培訓的教師》(3月16日),該文強調需要培養新型教育工作者來指導學生正確使用及防範人工智能的潛在濫用。文中引述的專家正確指出,在讓學生接觸這項可能有害的技術前,必須首先培養他們的道德倫理觀。但僅有倫理教育遠遠不夠。最新研究顯示約40%中學生承認使用AI作弊,實際數字很可能更高。單純依賴誠信守則來遏制學生濫用網絡技術的行為,這種想法未免天真。

對這些信件或任何其他新聞內容有強烈看法?歡迎通過郵件將您的讀者來信發送至[email protected],或填寫此谷歌表單。投稿內容請勿超過400字,需包含完整姓名、地址及驗證用電話號碼針對貴報報道《業界資深人士指出香港學校缺乏受過人工智能培訓的教師》(3月16日),該文強調需要培養新型教育工作者來指導學生正確使用及防範人工智能的潛在濫用。文中引述的專家正確指出,在讓學生接觸這項可能有害的技術前,必須首先培養他們的道德倫理觀。但僅有倫理教育遠遠不夠。最新研究顯示約40%中學生承認使用AI作弊,實際數字很可能更高。單純依賴誠信守則來遏制學生濫用網絡技術的行為,這種想法未免天真。

社會亟需從根本上變革教學、學習與評估模式。教師必須研究人工智能取代了哪些技能,進而調整、革新或淘汰相關教學方法。我們同樣需要重點關注大語言模型所欠缺的核心能力培養。

人工智能並非無所不能——遠非如此。ChatGPT難以形成它願意捍衞的價值判斷(好與壞、更好與更差)。例如,當被問及在英語課堂中允許使用人工智能的利弊時,ChatGPT先是提醒我這個問題“很複雜”,隨後才給出了一份權衡成本與收益的審慎分析。

在回答的最後,這個工具提出了一個“可能的折中方案”:教導學生適度使用技術。接着我要求它評估自己的論點中哪個“最好”。以下是它的最終答案:“與其採取嚴格的‘支持’或‘反對’立場,最有力的觀點是平衡的方法。應該教會學生將AI作為工具使用,學校應重視AI素養教育。”

這種“平衡方法”是人工推理的典型特徵。ChatGPT無法做出排他性的二元決策——就像詩人羅伯特·弗羅斯特在《未選擇的路》中描述的那樣,選擇一條路意味着放棄另一條。這種缺陷很可能源於AI不願犯錯,或拒絕為錯誤承擔責任。