公司在人工智能競賽中的道德關切正在趕上 - 彭博社

Eari Nakano

攝影師:Nicolas Maeterlinck/AFP你好,我是實習生Eari Nakano,報道舊金山的科技團隊。今天我來談談人工智能競賽中缺乏道德標準如何加劇不平等。但首先…

攝影師:Nicolas Maeterlinck/AFP你好,我是實習生Eari Nakano,報道舊金山的科技團隊。今天我來談談人工智能競賽中缺乏道德標準如何加劇不平等。但首先…

本週必讀新聞

- 肯定行動的可能結束對美國企業意味着什麼。

- 性別薪資差距始於男性在實習中獲得更高報酬。

- 這家丹麥公司在美國受到威脅後放棄了彩虹標誌。

- 有色人種在求職時更容易被忽視。

- Diageo在種族主義指控後與肖恩“迪迪”·康斯解除關係。

倫理道德追趕

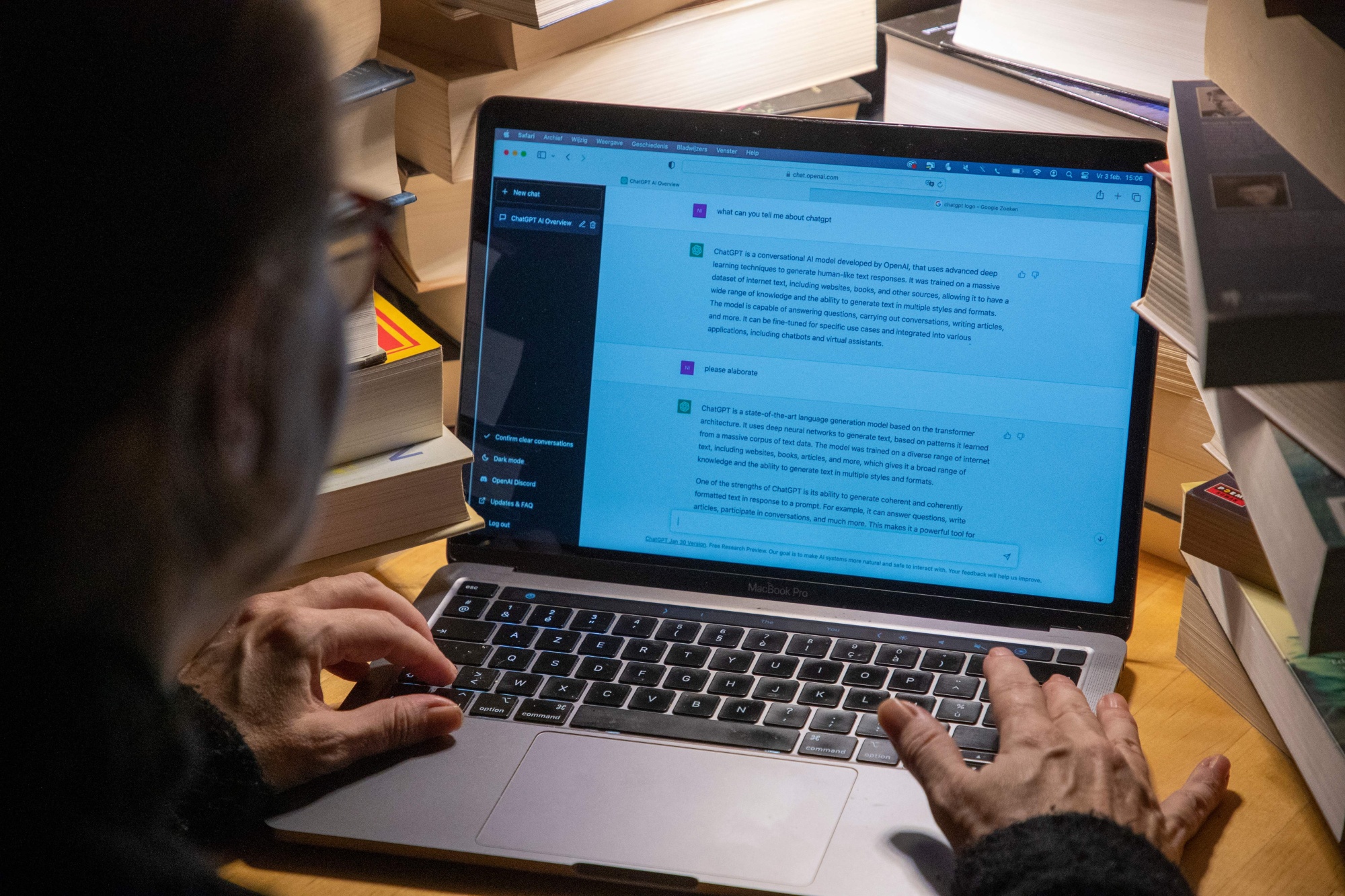

似乎每天都有另一家公司擁抱人工智能,企業爭相利用新興技術。我最近在舊金山的彭博科技峯會上觀看了一場關於技術和倫理的專家之間的精彩對話,與會者討論了公司採用生成式人工智能的指數增長可能帶來的潛在危險。

在過去的一年裏,這些工具——從現有數據中學習以生成新內容——已經變得非常重要,特別是隨着面向消費者的產品如ChatGPT的推出。它們也已經進入了企業,生成式人工智能能夠自動化許多以前由人類完成的任務:它可以學習和編寫代碼;起草法律文件;翻譯文本,以及許多其他潛在功能。根據與會者的説法,隨着這些巨大進步,風險隨處可見,他們警告稱,行業需要迅速制定道德標準以跟上發展。但似乎並不存在解決這些挑戰的標準解決方案。

彭博社的一項調查已經揭示了存在於生成式人工智能模型中的種族和性別偏見,這種缺陷如果應用於招聘和其他企業決策,可能會繼續歧視性做法。

“這些模型本身可以通過它們的構建方式、框架、訓練數據以及內部邏輯來延續偏見,” Signal Foundation總裁梅雷迪思·惠特克説,Signal Foundation是一個創建開源隱私技術的非營利組織。

此外,圍繞人工智能的倫理問題還涉及到可能最終被這項技術取代的工作類型,特別是在知識產權領域。惠特克引用了正在進行的電影和電視編劇罷工作為人與人工智能之間的第一個現實例子:編劇、藝術家和內容創作者的知識產權是否應該受到保護,免受機器學習模型未經其同意而從網絡上獲取信息的侵犯?

鑑於圍繞該領域的寬鬆政策,公司的道德標準和實踐似乎是公司的事後想法,Credo AI首席執行官Navrina Singh説,該公司幫助公司開發“負責任”的人工智能。公司成立了具有道德使命的委員會,但通常利用這些團體來轉移批評,而不是賦予他們足夠的權力來進行結構性變革。“他們暫時坐在桌旁,但後來完全被忽視了,”分佈式人工智能研究所研究主任Alex Hanna説。將其稱為人工智能版本的綠色洗牌,公司誇大了其有利於氣候的證書:一個簡單的頭銜可以幫助規避公眾審查。

對於上週在舊金山的座談會成員來説,道德和人工智能應該如何互動是一個比簡單嘗試將某種社會責任納入生成式人工智能中更大的對話。考慮到美國立法者仍在努力制定任何關於該技術的一致性監管框架,而公司則在反對歐盟更全面的指導方針,任何明確性都可能落後於人工智能快速增長的步伐。

— Eari Nakano

按數字計算

- 40 英國人可能需要等待 多少年才能 完全償還任何未償還的學生貸款。

我們正在閲讀的內容

- 一 訴訟 揭示了女性油田工人的困境。

- 瑞士 依賴 婦女兼職工作,薪酬較低。

- 長期以來,災難計劃一直 忽視 殘疾人。

- 最高法院即將作出的決定將 影響數百萬 學生貸款。

- 聯邦法官解釋他們如何 處理 免費午餐的提供。

新聲音

“這不僅僅是財務負擔,還有心理負擔,還有涉及的壓力。人們不得不犧牲基本生活必需品,以找到支付墮胎護理費用的方式。”

西爾維亞·加扎裏安婦女生殖權援助項目執行主任,在最高法院廢除羅伊訴韋德案後,談到墮胎費用上漲對婦女的影響。

彭博新聞支持放大婦女和其他少數羣體高管的聲音,覆蓋我們的媒體平台。### 來自我們的合作伙伴

* 女演員和活動家安吉拉·戴維斯正在為各個層次的免費教育而奮鬥。

* 女演員和活動家安吉拉·戴維斯正在為各個層次的免費教育而奮鬥。

彭博媒體和EBONY合作探討黑人社區面臨的經濟和社會不平等問題。訂閲《EBONY內幕》以獲取更多來自EBONY.com的新聞。